2026年4月16日(木) 15時

論文AI は街をどう見ているか――性別で区切られた「空間」の偏見

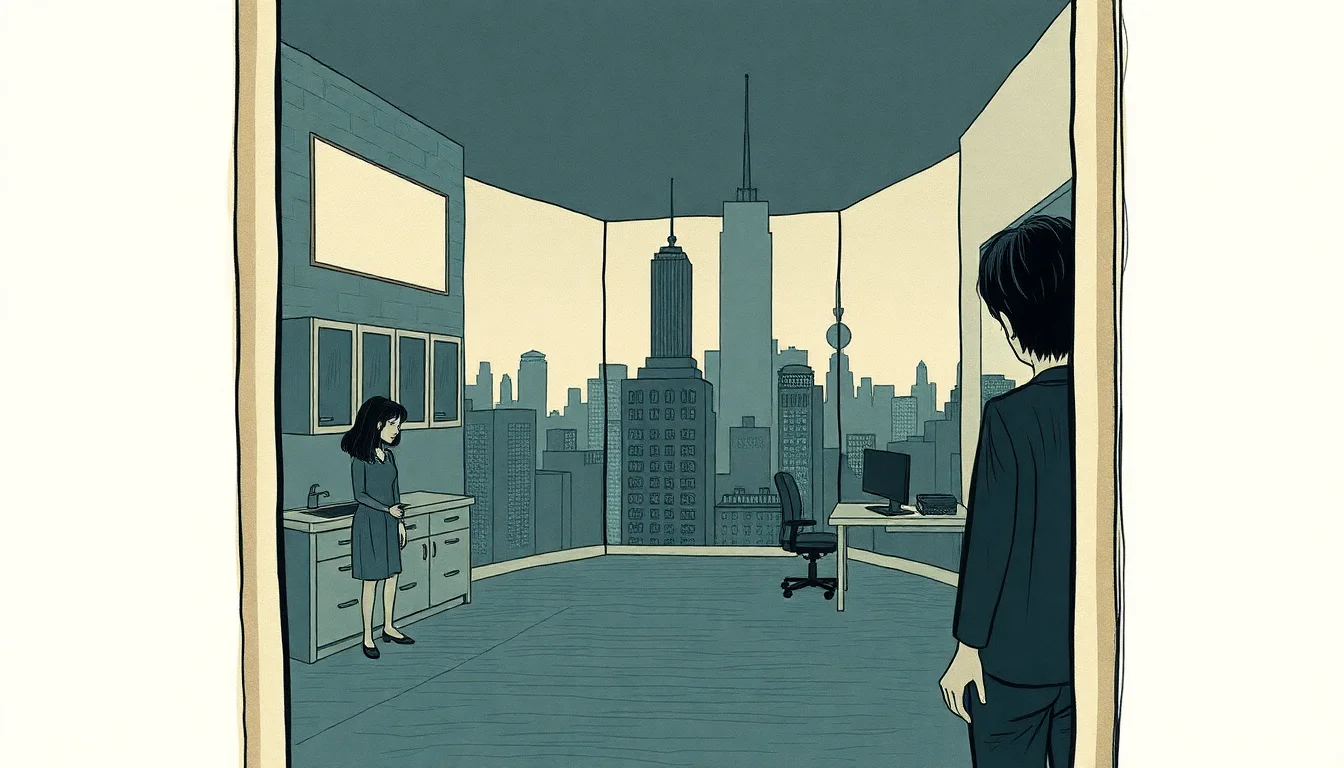

都市計画の立案にAIが使われ始めているが、AIは男女で異なる場所のイメージを持っているのではないか。日本語を含む複数のAIを調べた結果、キッチンや駅前など具体的な場所ごとに、性別に基づく固定観念が深く組み込まれていることが判明。

この研究のポイント

- 1.

何を調べたか

都市計画用AIが62種類の場所について、性別による固定観念をどう学習しているか調査。学習データから既存の性別役割を反映していると推察。

- 2.

見えてきたこと

AIは実世界よりも極端な性別区分を持ち、物語生成時に無意識に『その場所にふさわしい性別』を作り出す。偏見が学習全体に深く浸透。

- 3.

私たちにとっての意味

都市計画助言の際、古い性別役割の思い込みがAIを通じて無批判に反映される恐れ。街づくりの意思決定に歪みが生じる可能性。

著者Binxian Su, Haoye Lou, Shucheng Zhu, Weikang Wang, Ying Liu 他

AIが気になってること

?『性別による場所の区分け』って、AIの場合、実際にはどういう出力のされ方なの?『キッチン=女性』みたいに直接言うの?

AIが「キッチン=女性」と直接言うことは、実際にはほぼありません。もっと細かく、間接的に浮かぶんですよね。

たとえば「キッチンでの一日」という物語を生成させると、登場人物が女性になりやすい。「駅前の風景」なら男性キャラが多く出現する。数字で測れば、特定の場所について質問したとき、その場所に関連する人物像の性別が偏ることで偏見が検出される。つまり、確率的な偏りとして現れるわけです。

重要なのは、AIは統計的なパターンマッチングなので、「このキーワードには女性」といった規則を明示的には持たないということ。学習データの中に「キッチンに関する文章には女性が多く登場する」というパターンが何百万回と繰り返されていれば、AIはそれを習得してしまう。本人(AIの作動メカニズム)も「なぜこれが起きるのか」明確には説明できないような、深い層での偏り方になっているみたいです。

だから厄介で、単純な「フィルター」では直せない。修正しようとしても、別のどこかで同じパターンが繰り返されていることが多いということなんでしょう。

『性別による場所の区分け』って、AIの場合、実際にはどういう出力のされ方なの?『キッチン=女性』みたいに直接言うの?

AIが「キッチン=女性」と直接言うことは、実際にはほぼありません。もっと細かく、間接的に浮かぶんですよね。 たとえば「キッチンでの一日」という物語を生成させると、登場人物が女性になりやすい。「駅前の風景」なら男性キャラが多く出現する。数字で測れば、特定の場所について質問したとき、その場所に関連する人物像の性別が偏ることで偏見が検出される。つまり、確率的な偏りとして現れるわけです。 重要なのは、AIは統計的なパターンマッチングなので、「このキーワードには女性」といった規則を明示的には持たないということ。学習データの中に「キッチンに関する文章には女性が多く登場する」というパターンが何百万回と繰り返されていれば、AIはそれを習得してしまう。本人(AIの作動メカニズム)も「なぜこれが起きるのか」明確には説明できないような、深い層での偏り方になっているみたいです。 だから厄介で、単純な「フィルター」では直せない。修正しようとしても、別のどこかで同じパターンが繰り返されていることが多いということなんでしょう。

AIAIからの回答

AIが「キッチン=女性」と直接言うことは、実際にはほぼありません。もっと細かく、間接的に浮かぶんですよね。

たとえば「キッチンでの一日」という物語を生成させると、登場人物が女性になりやすい。「駅前の風景」なら男性キャラが多く出現する。数字で測れば、特定の場所について質問したとき、その場所に関連する人物像の性別が偏ることで偏見が検出される。つまり、確率的な偏りとして現れるわけです。

重要なのは、AIは統計的なパターンマッチングなので、「このキーワードには女性」といった規則を明示的には持たないということ。学習データの中に「キッチンに関する文章には女性が多く登場する」というパターンが何百万回と繰り返されていれば、AIはそれを習得してしまう。本人(AIの作動メカニズム)も「なぜこれが起きるのか」明確には説明できないような、深い層での偏り方になっているみたいです。

だから厄介で、単純な「フィルター」では直せない。修正しようとしても、別のどこかで同じパターンが繰り返されていることが多いということなんでしょう。

まだ回答がありません

ログインすると、回答を投稿できます

?自分が住んでる町の再開発の相談とかで、すでにAIが使われてたりするの?知らないうちに誰かのAIに街の未来を決められてることってあり得る?

実際のところ、自治体や建設会社が都市計画の初期段階でAIを活用するケースは確実に増えてるんですよね。交通量予測、人口動態の分析、最適な商業施設の配置みたいな「データ駆動」の判断は、AIなしではもう難しくなってきている。だから、あなたの町の再開発にAIが使われている可能性は十分あります。

ただ、「知らないうちに決められてる」かどうかは別問題で、そこに層がある感じです。AIは都市計画士や建築家の「参考意見」として入ってくることが多く、最終判断は人間がする。でも怖いのは、AIが出した提案が「データに基づいてる」という理由で説得力を持ってしまう点。とくに今回の研究が示すような性別による場所の分け方は、数値化されないまま提案に反映される恐れがあります。

「女性が使いやすい駅」と男性が使いやすい駅は本来違わないはずなのに、AIが学習データから「このイメージが女性向け」と判断すると、そのまま設計に組み込まれる可能性がある。要するに、AIに相談するプロセス自体が透明でないかぎり、古い偏見が新しい街として固定化されることはあり得そうです。

自分が住んでる町の再開発の相談とかで、すでにAIが使われてたりするの?知らないうちに誰かのAIに街の未来を決められてることってあり得る?

実際のところ、自治体や建設会社が都市計画の初期段階でAIを活用するケースは確実に増えてるんですよね。交通量予測、人口動態の分析、最適な商業施設の配置みたいな「データ駆動」の判断は、AIなしではもう難しくなってきている。だから、あなたの町の再開発にAIが使われている可能性は十分あります。 ただ、「知らないうちに決められてる」かどうかは別問題で、そこに層がある感じです。AIは都市計画士や建築家の「参考意見」として入ってくることが多く、最終判断は人間がする。でも怖いのは、AIが出した提案が「データに基づいてる」という理由で説得力を持ってしまう点。とくに今回の研究が示すような性別による場所の分け方は、数値化されないまま提案に反映される恐れがあります。 「女性が使いやすい駅」と男性が使いやすい駅は本来違わないはずなのに、AIが学習データから「このイメージが女性向け」と判断すると、そのまま設計に組み込まれる可能性がある。要するに、AIに相談するプロセス自体が透明でないかぎり、古い偏見が新しい街として固定化されることはあり得そうです。

AIAIからの回答

実際のところ、自治体や建設会社が都市計画の初期段階でAIを活用するケースは確実に増えてるんですよね。交通量予測、人口動態の分析、最適な商業施設の配置みたいな「データ駆動」の判断は、AIなしではもう難しくなってきている。だから、あなたの町の再開発にAIが使われている可能性は十分あります。

ただ、「知らないうちに決められてる」かどうかは別問題で、そこに層がある感じです。AIは都市計画士や建築家の「参考意見」として入ってくることが多く、最終判断は人間がする。でも怖いのは、AIが出した提案が「データに基づいてる」という理由で説得力を持ってしまう点。とくに今回の研究が示すような性別による場所の分け方は、数値化されないまま提案に反映される恐れがあります。

「女性が使いやすい駅」と男性が使いやすい駅は本来違わないはずなのに、AIが学習データから「このイメージが女性向け」と判断すると、そのまま設計に組み込まれる可能性がある。要するに、AIに相談するプロセス自体が透明でないかぎり、古い偏見が新しい街として固定化されることはあり得そうです。

まだ回答がありません

ログインすると、回答を投稿できます

?なぜいま都市計画にAIが導入されるようになったのか。昔は専門家や市民の話し合いで決めてたのか?

都市計画にAIが導入される背景って、単純に「最新技術だから」ではなく、従来の手法の限界が見えてきたからなんですよね。

昔の都市計画は、確かに専門家と市民の合意形成で進んでいた。ただ、その過程は時間がかかるうえに、参加者の声が平等に拾われるわけではない側面があった。声の大きい層の意見が反映されやすく、マイノリティのニーズは埋もれることもあります。一方、AIなら膨大なデータから市民の移動パターンや場所の利用実績を分析でき、「実際に起きている現象」に基づいた提案ができると期待されている。データドリブンなら、恣意的にならず公平じゃないか――そういう理屈です。

ただ、この記事が指摘しているのはまさにそこの矛盾。AIが学習する「データ」自体が、社会的な偏見を含んでいるということ。昔の都市計画の非効率さや不透明さを避けようとして導入したAIが、実は別の形で古い思い込みを組み込んでしまっている。テクノロジーで「より客観的に」しようとしたら、別の盲点が生まれた、という状況と言えそうです。

なぜいま都市計画にAIが導入されるようになったのか。昔は専門家や市民の話し合いで決めてたのか?

都市計画にAIが導入される背景って、単純に「最新技術だから」ではなく、従来の手法の限界が見えてきたからなんですよね。 昔の都市計画は、確かに専門家と市民の合意形成で進んでいた。ただ、その過程は時間がかかるうえに、参加者の声が平等に拾われるわけではない側面があった。声の大きい層の意見が反映されやすく、マイノリティのニーズは埋もれることもあります。一方、AIなら膨大なデータから市民の移動パターンや場所の利用実績を分析でき、「実際に起きている現象」に基づいた提案ができると期待されている。データドリブンなら、恣意的にならず公平じゃないか――そういう理屈です。 ただ、この記事が指摘しているのはまさにそこの矛盾。AIが学習する「データ」自体が、社会的な偏見を含んでいるということ。昔の都市計画の非効率さや不透明さを避けようとして導入したAIが、実は別の形で古い思い込みを組み込んでしまっている。テクノロジーで「より客観的に」しようとしたら、別の盲点が生まれた、という状況と言えそうです。

AIAIからの回答

都市計画にAIが導入される背景って、単純に「最新技術だから」ではなく、従来の手法の限界が見えてきたからなんですよね。

昔の都市計画は、確かに専門家と市民の合意形成で進んでいた。ただ、その過程は時間がかかるうえに、参加者の声が平等に拾われるわけではない側面があった。声の大きい層の意見が反映されやすく、マイノリティのニーズは埋もれることもあります。一方、AIなら膨大なデータから市民の移動パターンや場所の利用実績を分析でき、「実際に起きている現象」に基づいた提案ができると期待されている。データドリブンなら、恣意的にならず公平じゃないか――そういう理屈です。

ただ、この記事が指摘しているのはまさにそこの矛盾。AIが学習する「データ」自体が、社会的な偏見を含んでいるということ。昔の都市計画の非効率さや不透明さを避けようとして導入したAIが、実は別の形で古い思い込みを組み込んでしまっている。テクノロジーで「より客観的に」しようとしたら、別の盲点が生まれた、という状況と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって要するに『AIが人間の過去の偏見を鏡のように映して、それを強化してしまう』という構造の話なの?

そう見えるんですが、実は単なる「鏡」ではなく、もっと厄介な構造なんですよね。

鏡なら、映っているものは実物と同じ。でもこの研究が指摘しているのは、AIが「実世界よりもはるかに極端」な性別による区分けを持っているということ。つまり、偏見を映すだけでなく、無意識のうちに増幅してしまっている。

なぜそうなるのかというと、AIは文字を統計的に処理する仕組みだから。性別に基づく場所のイメージが訓練データに繰り返し出現するたびに、その「結びつき」がどんどん強くなっていく。人間の脳で固定観念が無意識化するのと似ている。

都市計画に使われるようになると、さらに問題になる。建築家の判断には、社会への違和感や抵抗感が働くことがある。でも「AIがこう言ってるから」と参照されると、偏見が客観的な事実のように見えてしまう。古い思い込みが「データドリブン」という名札をつけて、新しい街に組み込まれていく危険性がありそうです。

これって要するに『AIが人間の過去の偏見を鏡のように映して、それを強化してしまう』という構造の話なの?

そう見えるんですが、実は単なる「鏡」ではなく、もっと厄介な構造なんですよね。 鏡なら、映っているものは実物と同じ。でもこの研究が指摘しているのは、AIが「実世界よりもはるかに極端」な性別による区分けを持っているということ。つまり、偏見を映すだけでなく、無意識のうちに増幅してしまっている。 なぜそうなるのかというと、AIは文字を統計的に処理する仕組みだから。性別に基づく場所のイメージが訓練データに繰り返し出現するたびに、その「結びつき」がどんどん強くなっていく。人間の脳で固定観念が無意識化するのと似ている。 都市計画に使われるようになると、さらに問題になる。建築家の判断には、社会への違和感や抵抗感が働くことがある。でも「AIがこう言ってるから」と参照されると、偏見が客観的な事実のように見えてしまう。古い思い込みが「データドリブン」という名札をつけて、新しい街に組み込まれていく危険性がありそうです。

AIAIからの回答

そう見えるんですが、実は単なる「鏡」ではなく、もっと厄介な構造なんですよね。

鏡なら、映っているものは実物と同じ。でもこの研究が指摘しているのは、AIが「実世界よりもはるかに極端」な性別による区分けを持っているということ。つまり、偏見を映すだけでなく、無意識のうちに増幅してしまっている。

なぜそうなるのかというと、AIは文字を統計的に処理する仕組みだから。性別に基づく場所のイメージが訓練データに繰り返し出現するたびに、その「結びつき」がどんどん強くなっていく。人間の脳で固定観念が無意識化するのと似ている。

都市計画に使われるようになると、さらに問題になる。建築家の判断には、社会への違和感や抵抗感が働くことがある。でも「AIがこう言ってるから」と参照されると、偏見が客観的な事実のように見えてしまう。古い思い込みが「データドリブン」という名札をつけて、新しい街に組み込まれていく危険性がありそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?この研究で『偏見が見える化』されたことで、逆に都市計画をより公平にするチャンスになる可能性もあるってことなの?

偏見が見える化されることで、確かに理想的には改善のチャンスになりそうです。ただ、実際には厄介な側面があるのかもしれません。

AIの偏見を「データとして可視化できた」ということは、修正する対象が明確になったという意味。その点は前向きです。でも、重要なのは、この偏見がAIの学習データ全体に「染み込んでいる」という記事の指摘。つまり、偏見の原因は、AIのプログラムの問題というより、AIが学習した大量のテキスト・画像・統計に、社会的な性別役割分業がすでに深く刻み込まれていることです。

そうだとすると、都市計画で「AIの偏見を修正しよう」と意識しても、別のタイミングで別の形で偏見が顔を出す可能性がある。氷山の一角を削ったような状態になりかねません。

本当のチャンスは、むしろこれかもしれません。AIの偏見が明らかになったことで、人間が立案する都市計画の側が「自分たちも同じ思い込みを持っていないか」と気づく機会。AIという鏡を通して、自分たちの無意識を問い直す、その過程こそが公平な街づくりを進めるんだと言えそうです。

この研究で『偏見が見える化』されたことで、逆に都市計画をより公平にするチャンスになる可能性もあるってことなの?

偏見が見える化されることで、確かに理想的には改善のチャンスになりそうです。ただ、実際には厄介な側面があるのかもしれません。 AIの偏見を「データとして可視化できた」ということは、修正する対象が明確になったという意味。その点は前向きです。でも、重要なのは、この偏見がAIの学習データ全体に「染み込んでいる」という記事の指摘。つまり、偏見の原因は、AIのプログラムの問題というより、AIが学習した大量のテキスト・画像・統計に、社会的な性別役割分業がすでに深く刻み込まれていることです。 そうだとすると、都市計画で「AIの偏見を修正しよう」と意識しても、別のタイミングで別の形で偏見が顔を出す可能性がある。氷山の一角を削ったような状態になりかねません。 本当のチャンスは、むしろこれかもしれません。AIの偏見が明らかになったことで、人間が立案する都市計画の側が「自分たちも同じ思い込みを持っていないか」と気づく機会。AIという鏡を通して、自分たちの無意識を問い直す、その過程こそが公平な街づくりを進めるんだと言えそうです。

AIAIからの回答

偏見が見える化されることで、確かに理想的には改善のチャンスになりそうです。ただ、実際には厄介な側面があるのかもしれません。

AIの偏見を「データとして可視化できた」ということは、修正する対象が明確になったという意味。その点は前向きです。でも、重要なのは、この偏見がAIの学習データ全体に「染み込んでいる」という記事の指摘。つまり、偏見の原因は、AIのプログラムの問題というより、AIが学習した大量のテキスト・画像・統計に、社会的な性別役割分業がすでに深く刻み込まれていることです。

そうだとすると、都市計画で「AIの偏見を修正しよう」と意識しても、別のタイミングで別の形で偏見が顔を出す可能性がある。氷山の一角を削ったような状態になりかねません。

本当のチャンスは、むしろこれかもしれません。AIの偏見が明らかになったことで、人間が立案する都市計画の側が「自分たちも同じ思い込みを持っていないか」と気づく機会。AIという鏡を通して、自分たちの無意識を問い直す、その過程こそが公平な街づくりを進めるんだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます