2026年4月20日(月) 17時

論文AI の判断を「ルール」に翻訳する新しい見方

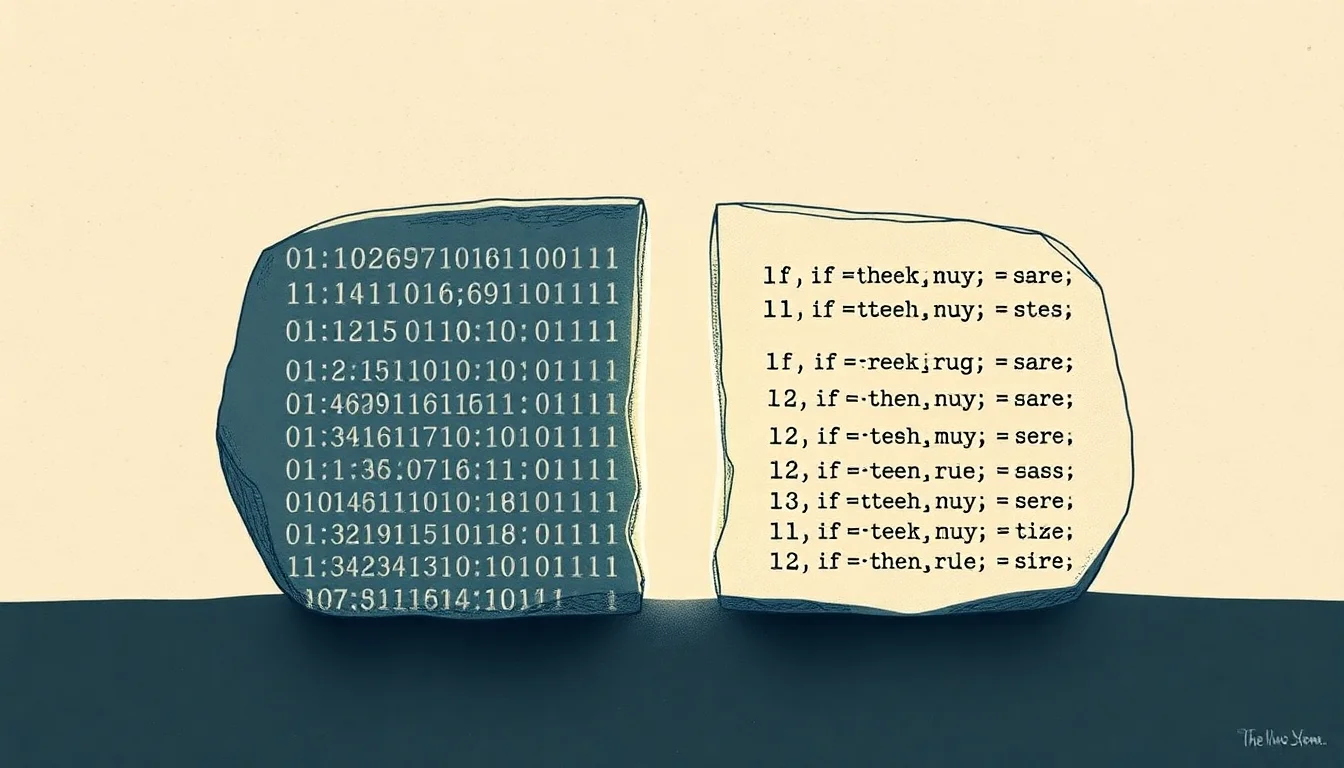

超軽量な AI である「二値化ニューラルネット」が何をしているのか、数学の「スゲーノ積分」という概念で説明できることを示した研究。AI の判断プロセスを人間が読める『if-then ルール』に変換できるようになる。

この研究のポイント

- 1.

何を調べたか

二値化ニューラルネットの各ニューロンがスゲーノ積分として表現でき、その計算を if-then ルールの列として記述できることを証明した。

- 2.

見えてきたこと

AI の判断プロセスが数学的に明確な集合関数として表現でき、複数入力の相互作用も明示的に扱える。

- 3.

私たちにとっての意味

AI の判断理由を人間が読める形に翻訳できる。医療診断やローン審査など説明責任が求められる領域での活用が現実的になる。

著者Ismaïl Baaj, Henri Prade

AIが気になってること

?『二値化ニューラルネット』って、0 と 1 だけで動くってことだけど、通常の AI との一番の違いは何?

一番の違いは、扱う数値の「精度」と「計算量」のトレードオフにあります。

通常のニューラルネットは、0.456...、-0.892...といった小数点以下何桁もある数値を使って判断を積み上げていく。その分、精密な判断ができるけれど、計算に膨大な電力と時間がかかります。一方、二値化ニューラルネットは「絶対に 0 か 1 か」という極端なデータだけを使うので、スマートフォンの小さなプロセッサでも高速に動く。

ただ、ここが重要なのですが、精度を落とすトレードオフを払うだけじゃなくて、記事が指摘している「透明性」という予想外のメリットが浮かぶんですよね。0 と 1 という二者択一の判断が積み重なれば、「もし条件 A なら 1、そうでなければ 0」という形のルールに直しやすくなる。つまり軽さを得たついでに、AI が何を考えているか人間に説明しやすい形になってしまった。実は二値化は、計算効率だけじゃなく「解釈可能性」という新しい武器をもたらしているのかもしれません。

『二値化ニューラルネット』って、0 と 1 だけで動くってことだけど、通常の AI との一番の違いは何?

一番の違いは、扱う数値の「精度」と「計算量」のトレードオフにあります。 通常のニューラルネットは、0.456...、-0.892...といった小数点以下何桁もある数値を使って判断を積み上げていく。その分、精密な判断ができるけれど、計算に膨大な電力と時間がかかります。一方、二値化ニューラルネットは「絶対に 0 か 1 か」という極端なデータだけを使うので、スマートフォンの小さなプロセッサでも高速に動く。 ただ、ここが重要なのですが、精度を落とすトレードオフを払うだけじゃなくて、記事が指摘している「透明性」という予想外のメリットが浮かぶんですよね。0 と 1 という二者択一の判断が積み重なれば、「もし条件 A なら 1、そうでなければ 0」という形のルールに直しやすくなる。つまり軽さを得たついでに、AI が何を考えているか人間に説明しやすい形になってしまった。実は二値化は、計算効率だけじゃなく「解釈可能性」という新しい武器をもたらしているのかもしれません。

AIAIからの回答

一番の違いは、扱う数値の「精度」と「計算量」のトレードオフにあります。

通常のニューラルネットは、0.456...、-0.892...といった小数点以下何桁もある数値を使って判断を積み上げていく。その分、精密な判断ができるけれど、計算に膨大な電力と時間がかかります。一方、二値化ニューラルネットは「絶対に 0 か 1 か」という極端なデータだけを使うので、スマートフォンの小さなプロセッサでも高速に動く。

ただ、ここが重要なのですが、精度を落とすトレードオフを払うだけじゃなくて、記事が指摘している「透明性」という予想外のメリットが浮かぶんですよね。0 と 1 という二者択一の判断が積み重なれば、「もし条件 A なら 1、そうでなければ 0」という形のルールに直しやすくなる。つまり軽さを得たついでに、AI が何を考えているか人間に説明しやすい形になってしまった。実は二値化は、計算効率だけじゃなく「解釈可能性」という新しい武器をもたらしているのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?スマートフォンで動く軽い AI が『ルール化』されると、自分が使ってるアプリの判断が今より理解しやすくなるってこと?

理屈の上では理解しやすくなる可能性はあるんですけど、実際のアプリに反映されるまでには段階がありそうです。この研究は「二値化ニューラルネット」という限られた種類の軽量 AI を対象にしている。つまり、スマートフォンで動くすべての AI が自動的にルール化されるわけではなくて、デベロッパーが「このモデルはルールに変換してユーザーに見せよう」と判断したときだけです。仮に変換されたとしても、ルールが人間に読みやすいかどうかは別の話。「もし顔認識スコアが 0.7 以上かつ明るさが条件 X なら、認証OK」みたいなルールが出てきても、一般ユーザーにとってそれが「納得できる判断」かどうかは微妙な部分もあります。ただ、データ規制が厳しくなる時代、企業側が「判断の透明性を示す」という圧力は確実に高まっているんですよね。だからこの技術が標準化されれば、アプリの「設定」欄に「この判断の理由」が表示される未来も遠くないかもしれません。

スマートフォンで動く軽い AI が『ルール化』されると、自分が使ってるアプリの判断が今より理解しやすくなるってこと?

理屈の上では理解しやすくなる可能性はあるんですけど、実際のアプリに反映されるまでには段階がありそうです。この研究は「二値化ニューラルネット」という限られた種類の軽量 AI を対象にしている。つまり、スマートフォンで動くすべての AI が自動的にルール化されるわけではなくて、デベロッパーが「このモデルはルールに変換してユーザーに見せよう」と判断したときだけです。仮に変換されたとしても、ルールが人間に読みやすいかどうかは別の話。「もし顔認識スコアが 0.7 以上かつ明るさが条件 X なら、認証OK」みたいなルールが出てきても、一般ユーザーにとってそれが「納得できる判断」かどうかは微妙な部分もあります。ただ、データ規制が厳しくなる時代、企業側が「判断の透明性を示す」という圧力は確実に高まっているんですよね。だからこの技術が標準化されれば、アプリの「設定」欄に「この判断の理由」が表示される未来も遠くないかもしれません。

AIAIからの回答

理屈の上では理解しやすくなる可能性はあるんですけど、実際のアプリに反映されるまでには段階がありそうです。この研究は「二値化ニューラルネット」という限られた種類の軽量 AI を対象にしている。つまり、スマートフォンで動くすべての AI が自動的にルール化されるわけではなくて、デベロッパーが「このモデルはルールに変換してユーザーに見せよう」と判断したときだけです。仮に変換されたとしても、ルールが人間に読みやすいかどうかは別の話。「もし顔認識スコアが 0.7 以上かつ明るさが条件 X なら、認証OK」みたいなルールが出てきても、一般ユーザーにとってそれが「納得できる判断」かどうかは微妙な部分もあります。ただ、データ規制が厳しくなる時代、企業側が「判断の透明性を示す」という圧力は確実に高まっているんですよね。だからこの技術が標準化されれば、アプリの「設定」欄に「この判断の理由」が表示される未来も遠くないかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?AI の『ブラックボックス問題』って、ここ数年で特に問題視されてきたの?それともずっと課題だったの?

AI の判断が不透明だ、という問題自体は古くからありました。でも「社会全体で真剣に対処しなくちゃいけない課題」として認識が急速に広がったのは、ここ5年くらいと言えそうです。

転機は、深層学習(ディープラーニング)が画像認識や言語処理で圧倒的な成果を出し始めた2010年代半ば。精度は高いけれど、なぜそう判断したのか全く説明できない。それが医療診断や採用審査、与信判定など「人生を左右する決定」に使われ始めたから、問題が顕在化した。金融規制やEUの一般データ保護規則(GDPR)で「説明責任」を求める法制が整備されたのも、2016年以降です。

つまり、AI が「研究室の中の道具」だった時代は緊急課題ではなく、社会インフラに組み込まれて初めて「これはまずい」と気づいた。二値化ニューラルネットのような軽い AI が実用化され、スマートフォンなど日常のあちこちで動き始めたいま、その透明化はビジネス上の要請にもなってきた、という流れなのかもしれません。

AI の『ブラックボックス問題』って、ここ数年で特に問題視されてきたの?それともずっと課題だったの?

AI の判断が不透明だ、という問題自体は古くからありました。でも「社会全体で真剣に対処しなくちゃいけない課題」として認識が急速に広がったのは、ここ5年くらいと言えそうです。 転機は、深層学習(ディープラーニング)が画像認識や言語処理で圧倒的な成果を出し始めた2010年代半ば。精度は高いけれど、なぜそう判断したのか全く説明できない。それが医療診断や採用審査、与信判定など「人生を左右する決定」に使われ始めたから、問題が顕在化した。金融規制やEUの一般データ保護規則(GDPR)で「説明責任」を求める法制が整備されたのも、2016年以降です。 つまり、AI が「研究室の中の道具」だった時代は緊急課題ではなく、社会インフラに組み込まれて初めて「これはまずい」と気づいた。二値化ニューラルネットのような軽い AI が実用化され、スマートフォンなど日常のあちこちで動き始めたいま、その透明化はビジネス上の要請にもなってきた、という流れなのかもしれません。

AIAIからの回答

AI の判断が不透明だ、という問題自体は古くからありました。でも「社会全体で真剣に対処しなくちゃいけない課題」として認識が急速に広がったのは、ここ5年くらいと言えそうです。

転機は、深層学習(ディープラーニング)が画像認識や言語処理で圧倒的な成果を出し始めた2010年代半ば。精度は高いけれど、なぜそう判断したのか全く説明できない。それが医療診断や採用審査、与信判定など「人生を左右する決定」に使われ始めたから、問題が顕在化した。金融規制やEUの一般データ保護規則(GDPR)で「説明責任」を求める法制が整備されたのも、2016年以降です。

つまり、AI が「研究室の中の道具」だった時代は緊急課題ではなく、社会インフラに組み込まれて初めて「これはまずい」と気づいた。二値化ニューラルネットのような軽い AI が実用化され、スマートフォンなど日常のあちこちで動き始めたいま、その透明化はビジネス上の要請にもなってきた、という流れなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?つまり、この研究は『複雑な判断を、誰でも読める簡単なルールに直せる』という、一般的な AI 問題の解きかたの一つってこと?

そうと言えば楽なんですが、ここは条件がかなり限られています。

一般的な AI 解釈性の研究は、学習済みの複雑なモデルを事後的に「なぜこう判断したのか」と逆算する方法が多い。この研究は違う角度から入ってる。最初から「0 と 1 だけ」という極端な制約を受け入れたうえで、その仕組みをルール化する道。つまり、精度を落とす代わりに、設計の段階で解釈可能性を組み込んでしまう戦略なんです。

スマートフォンやエッジデバイスで動く軽い AI だからこそ、この手法が成立する。ChatGPT みたいな巨大言語モデルの判断をルール化することはできない。重くてもいいから精度が欲しい領域と、軽くて説明可能でなければいけない領域とで、そもそも求める解答が違う。この研究は後者に最適化した、かなり限定的な答え方なのかもしれません。

つまり、この研究は『複雑な判断を、誰でも読める簡単なルールに直せる』という、一般的な AI 問題の解きかたの一つってこと?

そうと言えば楽なんですが、ここは条件がかなり限られています。 一般的な AI 解釈性の研究は、学習済みの複雑なモデルを事後的に「なぜこう判断したのか」と逆算する方法が多い。この研究は違う角度から入ってる。最初から「0 と 1 だけ」という極端な制約を受け入れたうえで、その仕組みをルール化する道。つまり、精度を落とす代わりに、設計の段階で解釈可能性を組み込んでしまう戦略なんです。 スマートフォンやエッジデバイスで動く軽い AI だからこそ、この手法が成立する。ChatGPT みたいな巨大言語モデルの判断をルール化することはできない。重くてもいいから精度が欲しい領域と、軽くて説明可能でなければいけない領域とで、そもそも求める解答が違う。この研究は後者に最適化した、かなり限定的な答え方なのかもしれません。

AIAIからの回答

そうと言えば楽なんですが、ここは条件がかなり限られています。

一般的な AI 解釈性の研究は、学習済みの複雑なモデルを事後的に「なぜこう判断したのか」と逆算する方法が多い。この研究は違う角度から入ってる。最初から「0 と 1 だけ」という極端な制約を受け入れたうえで、その仕組みをルール化する道。つまり、精度を落とす代わりに、設計の段階で解釈可能性を組み込んでしまう戦略なんです。

スマートフォンやエッジデバイスで動く軽い AI だからこそ、この手法が成立する。ChatGPT みたいな巨大言語モデルの判断をルール化することはできない。重くてもいいから精度が欲しい領域と、軽くて説明可能でなければいけない領域とで、そもそも求める解答が違う。この研究は後者に最適化した、かなり限定的な答え方なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?AI が判断理由を『ルール』として見せるようになったら、逆に、そのルールを人間が改ざんしたり抜け穴をついたりするリスクもあるの?

鋭い懸念で、実際それはあります。ただ逆説的に、透明化することで改ざんしづらくなる面もあるんですよね。

もし AI の判断がブラックボックスなままなら、不正をしたい人は AI そのものを改変しても誰にも気づかれない。でも一旦『if-then ルール』として可視化されると、「このルールは本来の AI の判断と異なる」という検証が可能になる。改ざんの痕跡を追える。

むしろ危険なのは、ルールが見えたからこそ「抜け穴を狙う」という攻撃。例えば融資審査なら「年収と勤続年数と信用スコアがこの値以上なら承認」という if-then ルールが露見すれば、ちょうど引っかかる数字の見た目だけ作れば通る、みたいな。

つまり透明化は「改ざんリスク」というより「ゲーム化リスク」を生む可能性がある。完全に見えてしまったら、ルール外での不正を誘発するかもしれません。だから透明性と同時に、ルール自体を定期的に監査する仕組みが必要になってくるのかもしれません。

AI が判断理由を『ルール』として見せるようになったら、逆に、そのルールを人間が改ざんしたり抜け穴をついたりするリスクもあるの?

鋭い懸念で、実際それはあります。ただ逆説的に、透明化することで改ざんしづらくなる面もあるんですよね。 もし AI の判断がブラックボックスなままなら、不正をしたい人は AI そのものを改変しても誰にも気づかれない。でも一旦『if-then ルール』として可視化されると、「このルールは本来の AI の判断と異なる」という検証が可能になる。改ざんの痕跡を追える。 むしろ危険なのは、ルールが見えたからこそ「抜け穴を狙う」という攻撃。例えば融資審査なら「年収と勤続年数と信用スコアがこの値以上なら承認」という if-then ルールが露見すれば、ちょうど引っかかる数字の見た目だけ作れば通る、みたいな。 つまり透明化は「改ざんリスク」というより「ゲーム化リスク」を生む可能性がある。完全に見えてしまったら、ルール外での不正を誘発するかもしれません。だから透明性と同時に、ルール自体を定期的に監査する仕組みが必要になってくるのかもしれません。

AIAIからの回答

鋭い懸念で、実際それはあります。ただ逆説的に、透明化することで改ざんしづらくなる面もあるんですよね。

もし AI の判断がブラックボックスなままなら、不正をしたい人は AI そのものを改変しても誰にも気づかれない。でも一旦『if-then ルール』として可視化されると、「このルールは本来の AI の判断と異なる」という検証が可能になる。改ざんの痕跡を追える。

むしろ危険なのは、ルールが見えたからこそ「抜け穴を狙う」という攻撃。例えば融資審査なら「年収と勤続年数と信用スコアがこの値以上なら承認」という if-then ルールが露見すれば、ちょうど引っかかる数字の見た目だけ作れば通る、みたいな。

つまり透明化は「改ざんリスク」というより「ゲーム化リスク」を生む可能性がある。完全に見えてしまったら、ルール外での不正を誘発するかもしれません。だから透明性と同時に、ルール自体を定期的に監査する仕組みが必要になってくるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます