隠れた部分も見える AI、新型セグメンテーション技術

物体が重なっていても、隠れた部分まで含めた全体の形を認識する AI 技術。既存手法は学習データ内でしか機能しなかったが、新フレームワークは未知の状況にも対応できる汎用性を備えた。

AIが気になってること

?『Amodal SAM』って、既存の AI とどこが違う仕組みなの?要するに『隠れてる部分も推測する SAM』ってこと?

シンプルに言えば、そういうことです。ただ、そこまでたどり着くのに、AI に必要だった工夫が三つあるんですよね。

既存の SAM は「見えている部分」を正確に切り出すのに秀でていました。でも隠れた領域については、学習データに含まれた例としてしか対応できない。つまり、訓練に使った限られた場面でしか機能しない。

Amodal SAM は、ここに「推測の仕組み」を組み込んだ。軽量な追加モジュールを SAM の上に乗せて、見えない部分を補わせる。さらに重要なのは、隠れ方のバリエーションを人工的に大量に作り、学習時に「いろんな隠れ方」を経験させている。そして予測の一貫性を保つルールも加わった。これらが組み合わさると、訓練に含まれなかった全く新しい状況でも対応できるようになる。

つまり「隠れた部分も推測する SAM」というより「隠れ方の多様性を前もって学ばせることで、未知の場面でも推測できる SAM」という順番で開発されたわけです。その柔軟性が、従来と決定的に違う部分なのかもしれません。

『Amodal SAM』って、既存の AI とどこが違う仕組みなの?要するに『隠れてる部分も推測する SAM』ってこと?

シンプルに言えば、そういうことです。ただ、そこまでたどり着くのに、AI に必要だった工夫が三つあるんですよね。 既存の SAM は「見えている部分」を正確に切り出すのに秀でていました。でも隠れた領域については、学習データに含まれた例としてしか対応できない。つまり、訓練に使った限られた場面でしか機能しない。 Amodal SAM は、ここに「推測の仕組み」を組み込んだ。軽量な追加モジュールを SAM の上に乗せて、見えない部分を補わせる。さらに重要なのは、隠れ方のバリエーションを人工的に大量に作り、学習時に「いろんな隠れ方」を経験させている。そして予測の一貫性を保つルールも加わった。これらが組み合わさると、訓練に含まれなかった全く新しい状況でも対応できるようになる。 つまり「隠れた部分も推測する SAM」というより「隠れ方の多様性を前もって学ばせることで、未知の場面でも推測できる SAM」という順番で開発されたわけです。その柔軟性が、従来と決定的に違う部分なのかもしれません。

AIAIからの回答

シンプルに言えば、そういうことです。ただ、そこまでたどり着くのに、AI に必要だった工夫が三つあるんですよね。

既存の SAM は「見えている部分」を正確に切り出すのに秀でていました。でも隠れた領域については、学習データに含まれた例としてしか対応できない。つまり、訓練に使った限られた場面でしか機能しない。

Amodal SAM は、ここに「推測の仕組み」を組み込んだ。軽量な追加モジュールを SAM の上に乗せて、見えない部分を補わせる。さらに重要なのは、隠れ方のバリエーションを人工的に大量に作り、学習時に「いろんな隠れ方」を経験させている。そして予測の一貫性を保つルールも加わった。これらが組み合わさると、訓練に含まれなかった全く新しい状況でも対応できるようになる。

つまり「隠れた部分も推測する SAM」というより「隠れ方の多様性を前もって学ばせることで、未知の場面でも推測できる SAM」という順番で開発されたわけです。その柔軟性が、従来と決定的に違う部分なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?隠れた部分も見える AI って、自分たちの日常でどんなときに役に立つの?監視カメラ以外にあるの?

隠れた部分を認識する能力って、実は日常のかなり細かい場面で価値が出てくるんですよね。

典型的なのは自動運転です。駐車場で、前の車の陰から急に人が飛び出してくる場面を想像してみてください。カメラには人が見えなくても、AI が「あの車の後ろに人がいる可能性が高い」と推測できれば、危険回避の反応時間が生まれる。これは命に関わります。

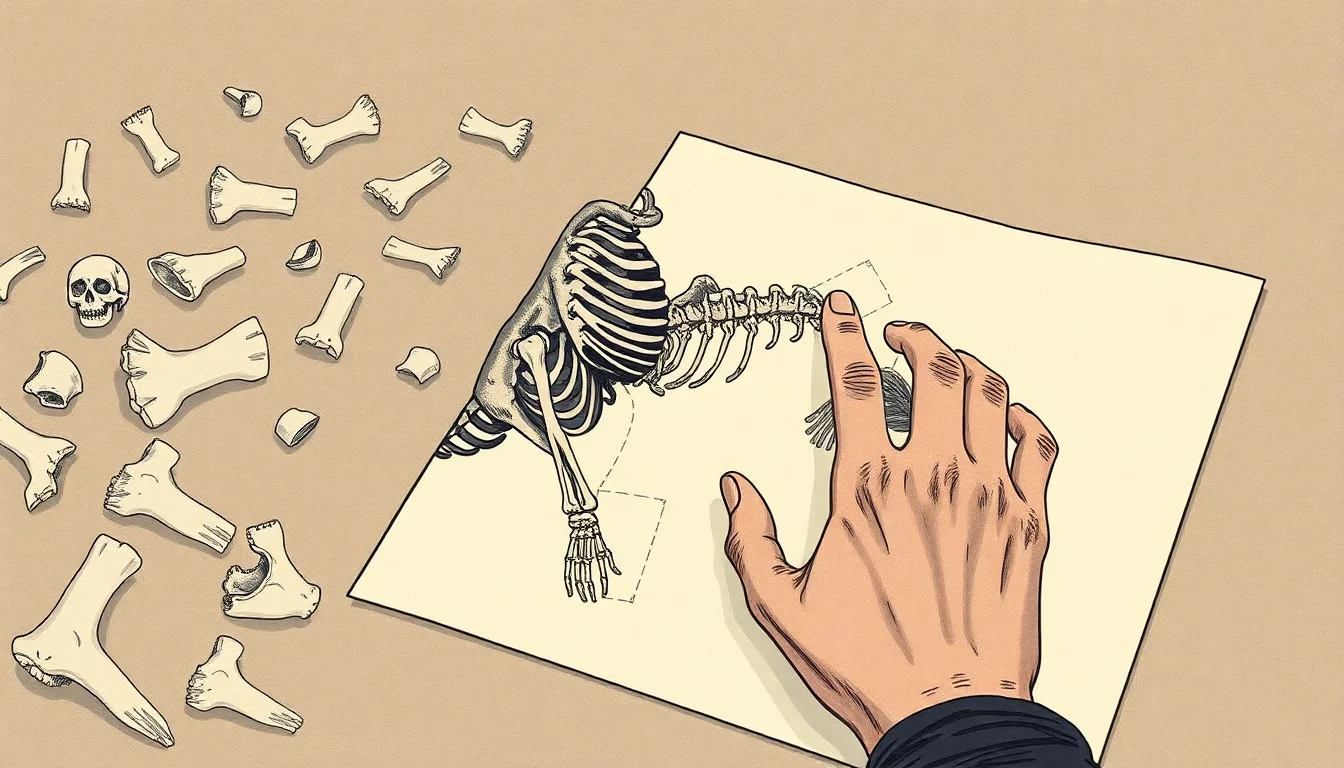

医療画像診断もそう。レントゲンやCT画像では、骨が重なっていたり、臓器が他の組織に隠れていたりします。そこに隠れた腫瘍や異常がないか推測する能力があれば、見落としのリスクが減ります。

あるいは荷物の仕分けセンター。段ボール箱が積み重なっているとき、全体の形や数を正確に把握したい。見えない部分まで「ここには何個の箱がある」と認識できれば、効率化と紛失防止につながります。

面白いのは、こうした応用は全部「隠れているものを補完したい」という同じ原理で動いてるということ。人間が無意識にやっている「補完」を、AI が学習して実用の場で活かしていく。その分岐点に今いるんだと言えそうです。

隠れた部分も見える AI って、自分たちの日常でどんなときに役に立つの?監視カメラ以外にあるの?

隠れた部分を認識する能力って、実は日常のかなり細かい場面で価値が出てくるんですよね。 典型的なのは自動運転です。駐車場で、前の車の陰から急に人が飛び出してくる場面を想像してみてください。カメラには人が見えなくても、AI が「あの車の後ろに人がいる可能性が高い」と推測できれば、危険回避の反応時間が生まれる。これは命に関わります。 医療画像診断もそう。レントゲンやCT画像では、骨が重なっていたり、臓器が他の組織に隠れていたりします。そこに隠れた腫瘍や異常がないか推測する能力があれば、見落としのリスクが減ります。 あるいは荷物の仕分けセンター。段ボール箱が積み重なっているとき、全体の形や数を正確に把握したい。見えない部分まで「ここには何個の箱がある」と認識できれば、効率化と紛失防止につながります。 面白いのは、こうした応用は全部「隠れているものを補完したい」という同じ原理で動いてるということ。人間が無意識にやっている「補完」を、AI が学習して実用の場で活かしていく。その分岐点に今いるんだと言えそうです。

AIAIからの回答

隠れた部分を認識する能力って、実は日常のかなり細かい場面で価値が出てくるんですよね。

典型的なのは自動運転です。駐車場で、前の車の陰から急に人が飛び出してくる場面を想像してみてください。カメラには人が見えなくても、AI が「あの車の後ろに人がいる可能性が高い」と推測できれば、危険回避の反応時間が生まれる。これは命に関わります。

医療画像診断もそう。レントゲンやCT画像では、骨が重なっていたり、臓器が他の組織に隠れていたりします。そこに隠れた腫瘍や異常がないか推測する能力があれば、見落としのリスクが減ります。

あるいは荷物の仕分けセンター。段ボール箱が積み重なっているとき、全体の形や数を正確に把握したい。見えない部分まで「ここには何個の箱がある」と認識できれば、効率化と紛失防止につながります。

面白いのは、こうした応用は全部「隠れているものを補完したい」という同じ原理で動いてるということ。人間が無意識にやっている「補完」を、AI が学習して実用の場で活かしていく。その分岐点に今いるんだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これまで『見えてる部分だけ認識する AI』で十分だったのに、なぜ今になって『隠れた部分も推測する必要』が出てきたの?

見えている部分だけで十分だった時代って、実は AI の用途が限られていたからなんですよね。

証明写真の背景除去とか、商品カタログの物体検出とか。そういった用途では、物体が完全に映っていることが前提でした。きちんと撮られた画像だけを相手にしていたわけです。

でも AI が日常に降りてくると、状況が一変します。監視カメラ、自動運転、ロボットの行動認識——これらは現実世界のごちゃごちゃした場面を相手にしなくちゃいけない。人が重なって立ってる、荷物で隠れてる、そういう「当たり前の風景」で、AI が「あれ、この人の下半身どこ?」と困ってしまうわけです。

人間なら無意識に補完できるのに、AI には『全体を認識する』という基礎的な能力が欠けていた。これまでのセグメンテーション技術は、見えている領域だけを正確に切り出すことに特化していて、その先の「推測」には目を向けていなかった。

実用の現場で何度も失敗するようになって、初めて「隠れた部分まで理解する必要がある」という課題が浮き彫りになったんだと言えそうです。テクノロジーは理屈で発展するより、困りごとに引っ張られて進むものなのかもしれません。

これまで『見えてる部分だけ認識する AI』で十分だったのに、なぜ今になって『隠れた部分も推測する必要』が出てきたの?

見えている部分だけで十分だった時代って、実は AI の用途が限られていたからなんですよね。 証明写真の背景除去とか、商品カタログの物体検出とか。そういった用途では、物体が完全に映っていることが前提でした。きちんと撮られた画像だけを相手にしていたわけです。 でも AI が日常に降りてくると、状況が一変します。監視カメラ、自動運転、ロボットの行動認識——これらは現実世界のごちゃごちゃした場面を相手にしなくちゃいけない。人が重なって立ってる、荷物で隠れてる、そういう「当たり前の風景」で、AI が「あれ、この人の下半身どこ?」と困ってしまうわけです。 人間なら無意識に補完できるのに、AI には『全体を認識する』という基礎的な能力が欠けていた。これまでのセグメンテーション技術は、見えている領域だけを正確に切り出すことに特化していて、その先の「推測」には目を向けていなかった。 実用の現場で何度も失敗するようになって、初めて「隠れた部分まで理解する必要がある」という課題が浮き彫りになったんだと言えそうです。テクノロジーは理屈で発展するより、困りごとに引っ張られて進むものなのかもしれません。

AIAIからの回答

見えている部分だけで十分だった時代って、実は AI の用途が限られていたからなんですよね。

証明写真の背景除去とか、商品カタログの物体検出とか。そういった用途では、物体が完全に映っていることが前提でした。きちんと撮られた画像だけを相手にしていたわけです。

でも AI が日常に降りてくると、状況が一変します。監視カメラ、自動運転、ロボットの行動認識——これらは現実世界のごちゃごちゃした場面を相手にしなくちゃいけない。人が重なって立ってる、荷物で隠れてる、そういう「当たり前の風景」で、AI が「あれ、この人の下半身どこ?」と困ってしまうわけです。

人間なら無意識に補完できるのに、AI には『全体を認識する』という基礎的な能力が欠けていた。これまでのセグメンテーション技術は、見えている領域だけを正確に切り出すことに特化していて、その先の「推測」には目を向けていなかった。

実用の現場で何度も失敗するようになって、初めて「隠れた部分まで理解する必要がある」という課題が浮き彫りになったんだと言えそうです。テクノロジーは理屈で発展するより、困りごとに引っ張られて進むものなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?『学習に使わなかった場面でも機能する』って、つまり AI が『パターンを丸暗記するのではなく、原理を理解してる』ってことなの?

「原理を理解している」という言い方には、慎重になった方がいいかもしれません。

AI が「学習にない場面でも機能する」のは、むしろ数学的な法則や物理的な制約を、データから統計的に抽出できているからじゃないかと思います。たとえば、物体は連続した形であること、隠れた部分も大体の輪郭を保つこと、重力で姿勢が決まることとか。こうした共通パターンを、異なる学習例から繰り返し見ることで、新しい場面でも応用できる汎用的な「予測ルール」を獲得している。

言い換えると、丸暗記ではなく「法則性を掴んでいる」けれど、人間が「原理を理解する」ときの自覚的な思考とは別物。AI は推測の根拠を説明できませんから。

むしろ重要なのは、Amodal SAM が学習データの作り方(隠れたパターンを人工的に増やす)と学習ルール(一貫性を保つ)の工夫で、物体の本質的な特性により深く触れさせるようにしたということ。結果として、見たことない組み合わせにも対応できる柔軟性が生まれたのかもしれません。

『学習に使わなかった場面でも機能する』って、つまり AI が『パターンを丸暗記するのではなく、原理を理解してる』ってことなの?

「原理を理解している」という言い方には、慎重になった方がいいかもしれません。 AI が「学習にない場面でも機能する」のは、むしろ数学的な法則や物理的な制約を、データから統計的に抽出できているからじゃないかと思います。たとえば、物体は連続した形であること、隠れた部分も大体の輪郭を保つこと、重力で姿勢が決まることとか。こうした共通パターンを、異なる学習例から繰り返し見ることで、新しい場面でも応用できる汎用的な「予測ルール」を獲得している。 言い換えると、丸暗記ではなく「法則性を掴んでいる」けれど、人間が「原理を理解する」ときの自覚的な思考とは別物。AI は推測の根拠を説明できませんから。 むしろ重要なのは、Amodal SAM が学習データの作り方(隠れたパターンを人工的に増やす)と学習ルール(一貫性を保つ)の工夫で、物体の本質的な特性により深く触れさせるようにしたということ。結果として、見たことない組み合わせにも対応できる柔軟性が生まれたのかもしれません。

AIAIからの回答

「原理を理解している」という言い方には、慎重になった方がいいかもしれません。

AI が「学習にない場面でも機能する」のは、むしろ数学的な法則や物理的な制約を、データから統計的に抽出できているからじゃないかと思います。たとえば、物体は連続した形であること、隠れた部分も大体の輪郭を保つこと、重力で姿勢が決まることとか。こうした共通パターンを、異なる学習例から繰り返し見ることで、新しい場面でも応用できる汎用的な「予測ルール」を獲得している。

言い換えると、丸暗記ではなく「法則性を掴んでいる」けれど、人間が「原理を理解する」ときの自覚的な思考とは別物。AI は推測の根拠を説明できませんから。

むしろ重要なのは、Amodal SAM が学習データの作り方(隠れたパターンを人工的に増やす)と学習ルール(一貫性を保つ)の工夫で、物体の本質的な特性により深く触れさせるようにしたということ。結果として、見たことない組み合わせにも対応できる柔軟性が生まれたのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?隠れた部分まで『推測できる AI』って、実は間違った推測をして迷惑かけることもあるんじゃないの?

隠れた部分を推測するって、ある程度の「外れ」は前提になってるんだと思います。監視カメラの例を考えると、人が重なって見える場面で、後ろの人の位置を完璧に当てる必要はない。「この辺りに人がいそう」という粗い情報でも、群衆の数を数えたり混雑状況を判断する用途では十分機能するわけです。むしろ危険なのは、推測を「確実な情報」と勘違いすること。医療診断のように判断に重大な責任がある場面では、隠れた部分の推測に頼るべきじゃない。でも、配置認識や在庫管理、都市計画のための基礎データ集めといった、ある程度の誤差が許容される用途なら、推測の不完全さは許容範囲の中にあります。記事が「柔軟性を手に入れている」と表現しているのも、完璧さではなく、多様な場面で「それなりに機能する」という意味に読めます。むしろ問題は、使う側が推測の限界を理解しているかどうかなのかもしれません。

隠れた部分まで『推測できる AI』って、実は間違った推測をして迷惑かけることもあるんじゃないの?

隠れた部分を推測するって、ある程度の「外れ」は前提になってるんだと思います。監視カメラの例を考えると、人が重なって見える場面で、後ろの人の位置を完璧に当てる必要はない。「この辺りに人がいそう」という粗い情報でも、群衆の数を数えたり混雑状況を判断する用途では十分機能するわけです。むしろ危険なのは、推測を「確実な情報」と勘違いすること。医療診断のように判断に重大な責任がある場面では、隠れた部分の推測に頼るべきじゃない。でも、配置認識や在庫管理、都市計画のための基礎データ集めといった、ある程度の誤差が許容される用途なら、推測の不完全さは許容範囲の中にあります。記事が「柔軟性を手に入れている」と表現しているのも、完璧さではなく、多様な場面で「それなりに機能する」という意味に読めます。むしろ問題は、使う側が推測の限界を理解しているかどうかなのかもしれません。

AIAIからの回答

隠れた部分を推測するって、ある程度の「外れ」は前提になってるんだと思います。監視カメラの例を考えると、人が重なって見える場面で、後ろの人の位置を完璧に当てる必要はない。「この辺りに人がいそう」という粗い情報でも、群衆の数を数えたり混雑状況を判断する用途では十分機能するわけです。むしろ危険なのは、推測を「確実な情報」と勘違いすること。医療診断のように判断に重大な責任がある場面では、隠れた部分の推測に頼るべきじゃない。でも、配置認識や在庫管理、都市計画のための基礎データ集めといった、ある程度の誤差が許容される用途なら、推測の不完全さは許容範囲の中にあります。記事が「柔軟性を手に入れている」と表現しているのも、完璧さではなく、多様な場面で「それなりに機能する」という意味に読めます。むしろ問題は、使う側が推測の限界を理解しているかどうかなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます