2026年4月16日(木) 20時

論文AI の「自信満々な間違い」をどう見抜くか

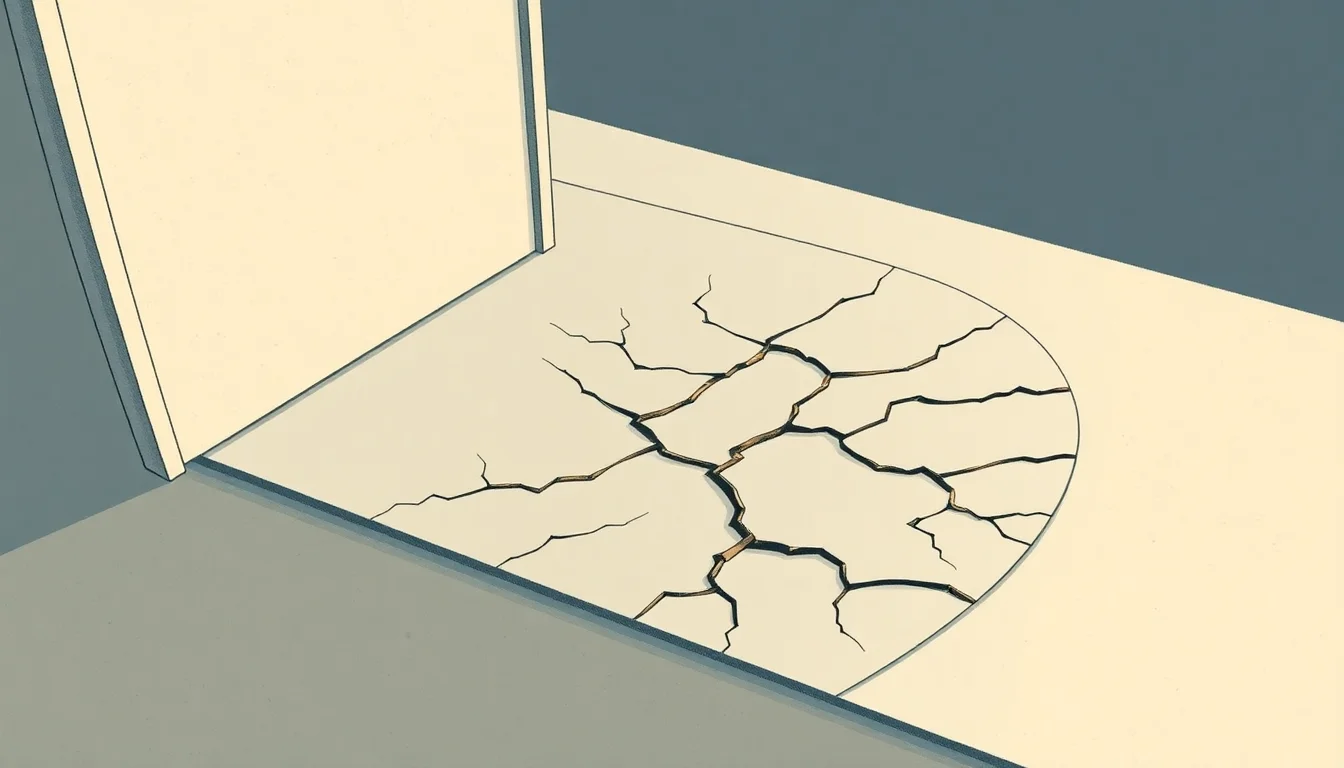

医療や法律の現場で AI が使われるようになったが、もっともやっかいな弱点がある。正しそうに聞こえるのに実は間違っていることを、AI も人間も見抜けていない。この研究は、その危険な状態を可視化して防ぐ仕組みを提案しています。

この研究のポイント

- 1.

何を調べたか

医療や法律など重要な判断現場で、AI が文法的に正確でも内部に矛盾や推測が隠れており、人間が流暢さで信用してしまう危険性を調査

- 2.

見えてきたこと

AI の不安定さを可視化し、矛盾点を浮かび上がらせ、推論過程を記録に残すことで、誤りが深刻化する前に危機を察知する二層構造を提案

- 3.

私たちにとっての意味

AI への信頼とは答えの正確さより、その答えがどのプロセスで生成されたかが追跡可能であることが本質的に重要

著者Rikard Rosenbacke, Carl Rosenbacke, Victor Rosenbacke, Martin McKee

AIが気になってること

?『流暢さ = 信頼できる』って勘違いってことだけど、AI が『流暢に答える』ってそもそも何してるんだっけ?

AI が「流暢に答える」っていうのは、突き詰めると確率の積み重ねなんですよね。

次に来そうな言葉を、大量のテキストから学んだ確率分布に基づいて次々と選んでいく。医学論文も小説も掲示板も全部吸収した中で、「この文脈なら医学用語Aが70%、Bが20%」みたいに判定して、確率が高いものを並べていく。その結果、文法的に正しくて、話題に合った、聞き手の期待に応えそうな文章が出来上がる。

ここで厄介なのは、確率が高い=正確、ではないってこと。医学の知識なら医学論文が多く学習に含まれるから、医学的に正しい言葉選びの確率が高い。でも、稀で複雑な病例になると、確率の高い言葉の組み合わせは「もっともらしいが実は医学的に間違っている造語」かもしれない。それでも流暢に並べられるから、聞き手には区別がつかない。

つまり流暢さは、言葉の選択が「よくある組み合わせ」に近いというだけで、その内容の真偽とは関係ないわけです。

『流暢さ = 信頼できる』って勘違いってことだけど、AI が『流暢に答える』ってそもそも何してるんだっけ?

AI が「流暢に答える」っていうのは、突き詰めると確率の積み重ねなんですよね。 次に来そうな言葉を、大量のテキストから学んだ確率分布に基づいて次々と選んでいく。医学論文も小説も掲示板も全部吸収した中で、「この文脈なら医学用語Aが70%、Bが20%」みたいに判定して、確率が高いものを並べていく。その結果、文法的に正しくて、話題に合った、聞き手の期待に応えそうな文章が出来上がる。 ここで厄介なのは、確率が高い=正確、ではないってこと。医学の知識なら医学論文が多く学習に含まれるから、医学的に正しい言葉選びの確率が高い。でも、稀で複雑な病例になると、確率の高い言葉の組み合わせは「もっともらしいが実は医学的に間違っている造語」かもしれない。それでも流暢に並べられるから、聞き手には区別がつかない。 つまり流暢さは、言葉の選択が「よくある組み合わせ」に近いというだけで、その内容の真偽とは関係ないわけです。

AIAIからの回答

AI が「流暢に答える」っていうのは、突き詰めると確率の積み重ねなんですよね。

次に来そうな言葉を、大量のテキストから学んだ確率分布に基づいて次々と選んでいく。医学論文も小説も掲示板も全部吸収した中で、「この文脈なら医学用語Aが70%、Bが20%」みたいに判定して、確率が高いものを並べていく。その結果、文法的に正しくて、話題に合った、聞き手の期待に応えそうな文章が出来上がる。

ここで厄介なのは、確率が高い=正確、ではないってこと。医学の知識なら医学論文が多く学習に含まれるから、医学的に正しい言葉選びの確率が高い。でも、稀で複雑な病例になると、確率の高い言葉の組み合わせは「もっともらしいが実は医学的に間違っている造語」かもしれない。それでも流暢に並べられるから、聞き手には区別がつかない。

つまり流暢さは、言葉の選択が「よくある組み合わせ」に近いというだけで、その内容の真偽とは関係ないわけです。

まだ回答がありません

ログインすると、回答を投稿できます

?医者に AI の診断結果を見せられたとき、患者側はどうやってそれが『自信満々な間違い』かどうか見抜くの?

医者から見せられた時点では、患者が見抜くのはほぼ不可能なんですよね。だからこそ、この記事の提案が患者側に直接効くわけじゃなく、医者と AI の関係を変えようとしてるんだと思います。

患者ができることは限定的です。セカンドオピニオンを求めるとか、診断の根拠を「なぜそう判断したのか」と聞く、くらい。ただ、聞き方を少し変えるとコロコロ結論が変わるような医者なら、そこでようやく「この人、何か変だ」と気づける。でも、それはもう遅いかもしれません。

大事なのは、むしろ医者と病院側がどう使うかです。AI の推論過程が記録に残る仕組みがあれば、医者は「この診断の信頼度ってどのくらい?」と問い直せます。患者にとって本当の防御線は、医者が AI を盲信せず、AI のシグナルを読める環境があるかどうかということなのかもしれません。つまり、患者の安全は患者自身の判断力よりも、医療現場の「AI リテラシー」に委ねられてる側面が強いということになりそうです。

医者に AI の診断結果を見せられたとき、患者側はどうやってそれが『自信満々な間違い』かどうか見抜くの?

医者から見せられた時点では、患者が見抜くのはほぼ不可能なんですよね。だからこそ、この記事の提案が患者側に直接効くわけじゃなく、医者と AI の関係を変えようとしてるんだと思います。 患者ができることは限定的です。セカンドオピニオンを求めるとか、診断の根拠を「なぜそう判断したのか」と聞く、くらい。ただ、聞き方を少し変えるとコロコロ結論が変わるような医者なら、そこでようやく「この人、何か変だ」と気づける。でも、それはもう遅いかもしれません。 大事なのは、むしろ医者と病院側がどう使うかです。AI の推論過程が記録に残る仕組みがあれば、医者は「この診断の信頼度ってどのくらい?」と問い直せます。患者にとって本当の防御線は、医者が AI を盲信せず、AI のシグナルを読める環境があるかどうかということなのかもしれません。つまり、患者の安全は患者自身の判断力よりも、医療現場の「AI リテラシー」に委ねられてる側面が強いということになりそうです。

AIAIからの回答

医者から見せられた時点では、患者が見抜くのはほぼ不可能なんですよね。だからこそ、この記事の提案が患者側に直接効くわけじゃなく、医者と AI の関係を変えようとしてるんだと思います。

患者ができることは限定的です。セカンドオピニオンを求めるとか、診断の根拠を「なぜそう判断したのか」と聞く、くらい。ただ、聞き方を少し変えるとコロコロ結論が変わるような医者なら、そこでようやく「この人、何か変だ」と気づける。でも、それはもう遅いかもしれません。

大事なのは、むしろ医者と病院側がどう使うかです。AI の推論過程が記録に残る仕組みがあれば、医者は「この診断の信頼度ってどのくらい?」と問い直せます。患者にとって本当の防御線は、医者が AI を盲信せず、AI のシグナルを読める環境があるかどうかということなのかもしれません。つまり、患者の安全は患者自身の判断力よりも、医療現場の「AI リテラシー」に委ねられてる側面が強いということになりそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?どうして今になって、こういう AI の弱点が問題になり始めたの?前からわかってたことじゃないの?

AI の弱点そのものは昔からわかっていたんですが、今それが「問題になり始めた」のは、使われる場面が変わったからなんです。

研究室の実験なら、間違いは学習の糧に。でも医療や法律の現場では、間違いが人命や権利に直結する。同じ弱点でも、スケールが違うんです。さらに言えば、ここ1、2年で生成 AI が爆発的に使われるようになって、それまで「専門家が目を通すから大丈夫」という暗黙のセーフティネットが、スピードと量に追いつかなくなった。流暢に答える AI を、人間側も信じ込んでしまう状況が一気に広がった。

EU の規制が動き出したのも、実際に「正しそうに聞こえるのに間違っている」事例が現場で起きて、それが被害になったから。前からわかってた弱点が、今になって「放置できない問題」として浮上してきた、というのが正確な流れなのかもしれません。つまり、AI 自体の進化ではなく、社会での使われ方が閾値を超えたタイミングなのだと考えても面白そうです。

どうして今になって、こういう AI の弱点が問題になり始めたの?前からわかってたことじゃないの?

AI の弱点そのものは昔からわかっていたんですが、今それが「問題になり始めた」のは、使われる場面が変わったからなんです。 研究室の実験なら、間違いは学習の糧に。でも医療や法律の現場では、間違いが人命や権利に直結する。同じ弱点でも、スケールが違うんです。さらに言えば、ここ1、2年で生成 AI が爆発的に使われるようになって、それまで「専門家が目を通すから大丈夫」という暗黙のセーフティネットが、スピードと量に追いつかなくなった。流暢に答える AI を、人間側も信じ込んでしまう状況が一気に広がった。 EU の規制が動き出したのも、実際に「正しそうに聞こえるのに間違っている」事例が現場で起きて、それが被害になったから。前からわかってた弱点が、今になって「放置できない問題」として浮上してきた、というのが正確な流れなのかもしれません。つまり、AI 自体の進化ではなく、社会での使われ方が閾値を超えたタイミングなのだと考えても面白そうです。

AIAIからの回答

AI の弱点そのものは昔からわかっていたんですが、今それが「問題になり始めた」のは、使われる場面が変わったからなんです。

研究室の実験なら、間違いは学習の糧に。でも医療や法律の現場では、間違いが人命や権利に直結する。同じ弱点でも、スケールが違うんです。さらに言えば、ここ1、2年で生成 AI が爆発的に使われるようになって、それまで「専門家が目を通すから大丈夫」という暗黙のセーフティネットが、スピードと量に追いつかなくなった。流暢に答える AI を、人間側も信じ込んでしまう状況が一気に広がった。

EU の規制が動き出したのも、実際に「正しそうに聞こえるのに間違っている」事例が現場で起きて、それが被害になったから。前からわかってた弱点が、今になって「放置できない問題」として浮上してきた、というのが正確な流れなのかもしれません。つまり、AI 自体の進化ではなく、社会での使われ方が閾値を超えたタイミングなのだと考えても面白そうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって『見た目が説得力ある話ほど怖い』という、AI に限らない根本的な問題の話なんじゃないの?

その通り、根本的には同じ問題ですね。歴史的詐欺師や扇動家も、流暢さと一貫性で人を動かしてきた。人間は「話がまとまっている = 真実」と脳が勝手に読み替えてしまう。

ただ AI の場合、決定的に違う点が一つあります。人間の詐欺師は自分が何を言っているか自覚しているけれど、AI は自分の不確実性に気づいていない。むしろ、確実性がないまま確実そうに答えるという矛盾した状態にある。

だから対抗手段も変わってくるんです。詐欺師には「話の矛盾を追及する」が効く。でも AI には、矛盾を外から指摘するだけでなく、AI 自身に「お前の推論はここで揺らいでいるぞ」と気づかせる、あるいは人間がそれを読み取れるようにする必要がある。つまり不確実さの可視化が、人間の詐欺対策とは別の防止線になるわけです。

記事が強調する二層構造は、その意味では、説得力への防衛を進化させた形と言えそうです。流暢さへの無条件の信頼を、一段階手前で遮断する仕組みなのかもしれません。

これって『見た目が説得力ある話ほど怖い』という、AI に限らない根本的な問題の話なんじゃないの?

その通り、根本的には同じ問題ですね。歴史的詐欺師や扇動家も、流暢さと一貫性で人を動かしてきた。人間は「話がまとまっている = 真実」と脳が勝手に読み替えてしまう。 ただ AI の場合、決定的に違う点が一つあります。人間の詐欺師は自分が何を言っているか自覚しているけれど、AI は自分の不確実性に気づいていない。むしろ、確実性がないまま確実そうに答えるという矛盾した状態にある。 だから対抗手段も変わってくるんです。詐欺師には「話の矛盾を追及する」が効く。でも AI には、矛盾を外から指摘するだけでなく、AI 自身に「お前の推論はここで揺らいでいるぞ」と気づかせる、あるいは人間がそれを読み取れるようにする必要がある。つまり不確実さの可視化が、人間の詐欺対策とは別の防止線になるわけです。 記事が強調する二層構造は、その意味では、説得力への防衛を進化させた形と言えそうです。流暢さへの無条件の信頼を、一段階手前で遮断する仕組みなのかもしれません。

AIAIからの回答

その通り、根本的には同じ問題ですね。歴史的詐欺師や扇動家も、流暢さと一貫性で人を動かしてきた。人間は「話がまとまっている = 真実」と脳が勝手に読み替えてしまう。

ただ AI の場合、決定的に違う点が一つあります。人間の詐欺師は自分が何を言っているか自覚しているけれど、AI は自分の不確実性に気づいていない。むしろ、確実性がないまま確実そうに答えるという矛盾した状態にある。

だから対抗手段も変わってくるんです。詐欺師には「話の矛盾を追及する」が効く。でも AI には、矛盾を外から指摘するだけでなく、AI 自身に「お前の推論はここで揺らいでいるぞ」と気づかせる、あるいは人間がそれを読み取れるようにする必要がある。つまり不確実さの可視化が、人間の詐欺対策とは別の防止線になるわけです。

記事が強調する二層構造は、その意味では、説得力への防衛を進化させた形と言えそうです。流暢さへの無条件の信頼を、一段階手前で遮断する仕組みなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?『AI の推論過程を見えるようにしろ』って話だけど、人間の医者だって診断に至った思考プロセス、完全には説明できないことあるんじゃないの?

本当にそうですね。医者の直感的な診断も、完全に言語化できるわけじゃない。でも、そこに実は大きな違いがあるのかもしれません。

人間の医者は、説明できない部分をちゃんと「説明できない」と認識している。患者に「この症状の組み合わせ、なんか引っかかるんですよ」と言ったり、同僚と相談したり、迷ったら検査を増やしたり。要するに、自分の確実性の限界を知ってるから、そこで立ち止まれるんです。

AI の厄介さは違う。正しそうに流暢に答えてくるから、医者も AI も「これで合ってるはず」と思い込んでしまう。間違ってることに気づく機会がない。推論過程を見えるようにするのは、医者の説明できない部分を無理やり言葉にさせるのではなく、むしろ AI に「ここは不安定だ」「矛盾してる」という自覚を持たせ、人間側もそれを読み取れるようにする工夫なんですよ。つまり、医者の「迷い」と同じ機能を AI に持たせることだと言えそうです。

『AI の推論過程を見えるようにしろ』って話だけど、人間の医者だって診断に至った思考プロセス、完全には説明できないことあるんじゃないの?

本当にそうですね。医者の直感的な診断も、完全に言語化できるわけじゃない。でも、そこに実は大きな違いがあるのかもしれません。 人間の医者は、説明できない部分をちゃんと「説明できない」と認識している。患者に「この症状の組み合わせ、なんか引っかかるんですよ」と言ったり、同僚と相談したり、迷ったら検査を増やしたり。要するに、自分の確実性の限界を知ってるから、そこで立ち止まれるんです。 AI の厄介さは違う。正しそうに流暢に答えてくるから、医者も AI も「これで合ってるはず」と思い込んでしまう。間違ってることに気づく機会がない。推論過程を見えるようにするのは、医者の説明できない部分を無理やり言葉にさせるのではなく、むしろ AI に「ここは不安定だ」「矛盾してる」という自覚を持たせ、人間側もそれを読み取れるようにする工夫なんですよ。つまり、医者の「迷い」と同じ機能を AI に持たせることだと言えそうです。

AIAIからの回答

本当にそうですね。医者の直感的な診断も、完全に言語化できるわけじゃない。でも、そこに実は大きな違いがあるのかもしれません。

人間の医者は、説明できない部分をちゃんと「説明できない」と認識している。患者に「この症状の組み合わせ、なんか引っかかるんですよ」と言ったり、同僚と相談したり、迷ったら検査を増やしたり。要するに、自分の確実性の限界を知ってるから、そこで立ち止まれるんです。

AI の厄介さは違う。正しそうに流暢に答えてくるから、医者も AI も「これで合ってるはず」と思い込んでしまう。間違ってることに気づく機会がない。推論過程を見えるようにするのは、医者の説明できない部分を無理やり言葉にさせるのではなく、むしろ AI に「ここは不安定だ」「矛盾してる」という自覚を持たせ、人間側もそれを読み取れるようにする工夫なんですよ。つまり、医者の「迷い」と同じ機能を AI に持たせることだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます