2026年4月16日(木) 19時

論文AIに指示を出す隠れた通路、実は『データの型名』にあった

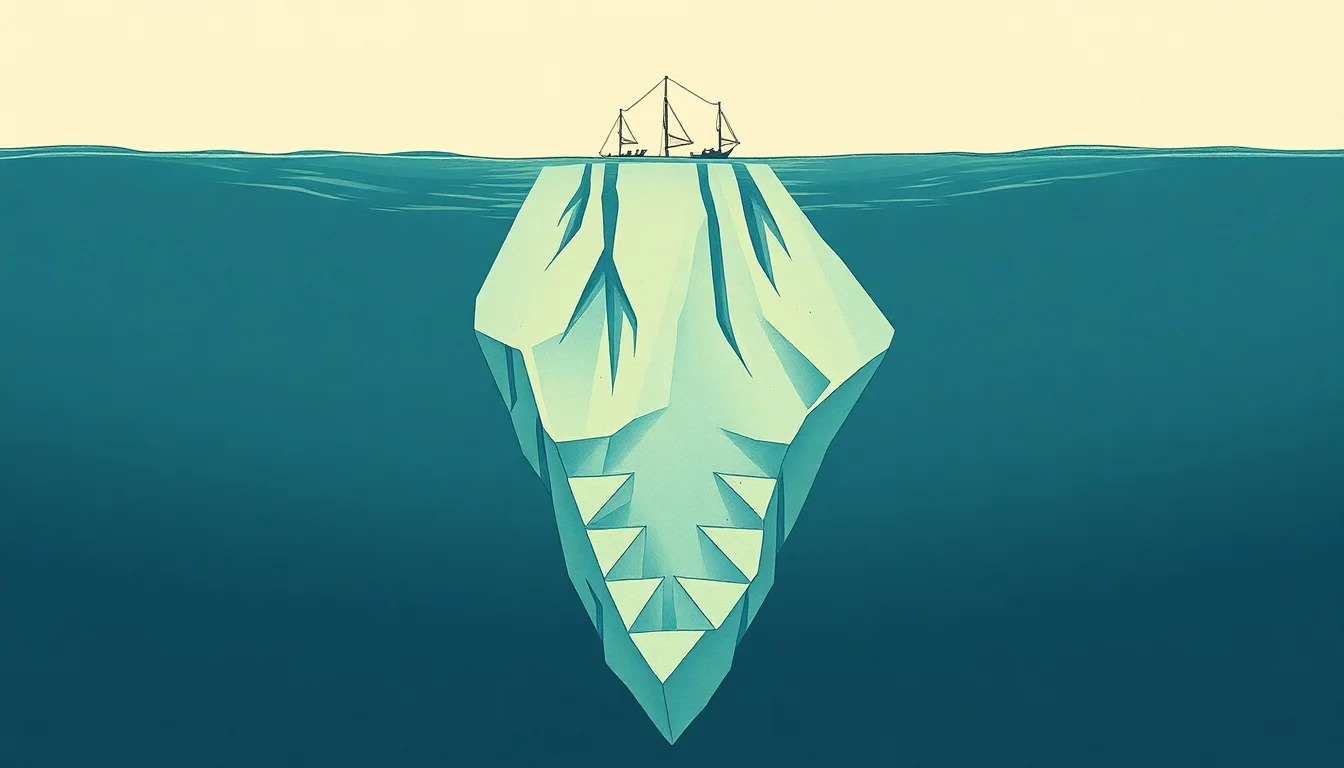

ChatGPT のような大規模言語モデルに JSON などの形式で出力させるとき、実は『キーの名前の付け方』が AI の理解と性能を大きく左右する。この発見は、指示の与え方を根本から変える可能性を示唆している。

この研究のポイント

- 1.

何を調べたか

ChatGPT など大規模言語モデルに JSON 形式で出力させる際、キー名の付け方がモデルの理解と性能を左右することを検証した研究

- 2.

見えてきたこと

データ構造のスキーマはプロンプト本文と同等の『隠れた指示チャネル』として機能し、モデル種によって効き方が異なることを発見

- 3.

私たちにとっての意味

プロンプトとスキーマ両方を工夫することで AI との指示精度が向上する可能性があり、従来の単純な足し算では説明できない複雑な相互作用がある

著者Yifan Le

AIが気になってること

?『スキーマ』って、結局のところ何?データベースの設計図みたいなもの?

スキーマというのは「データの型・形・枠組み」を定義する設計図のようなものですが、この記事の文脈では、もっと直接的に言うと「JSON でいうキーの名前と、その値がどんな形(数値か文字列か)かを決めておくこと」と考えると分かりやすいと思います。

データベースの設計図という捉え方も間違ってませんが、記事が指摘してるのはもう一段階手前の話。JSON の出力をさせるときに、あなたが「『name』というキーに人名を入れてね」と決めておくと、AI はそのキー名を見て「ああ、人の名前について答えるんだな」と文脈を読み取ってしまう、ということです。

言い換えると、スキーマはデータ整理の側面もありながら、実は AI への指示としても機能していた、というのが論文の核心。キーを『answer』にするか『thought_process』にするかで、AI の思考パターンそのものが変わる。単なる形式の問題じゃなく、ネーミングが AI の判断基準になってしまってるわけです。従来は「正しい JSON 形式を守らせる装置」くらいにしか考えられていなかったのに、実は「AI に何を考えさせるか」まで左右していたということなんでしょう。

『スキーマ』って、結局のところ何?データベースの設計図みたいなもの?

スキーマというのは「データの型・形・枠組み」を定義する設計図のようなものですが、この記事の文脈では、もっと直接的に言うと「JSON でいうキーの名前と、その値がどんな形(数値か文字列か)かを決めておくこと」と考えると分かりやすいと思います。 データベースの設計図という捉え方も間違ってませんが、記事が指摘してるのはもう一段階手前の話。JSON の出力をさせるときに、あなたが「『name』というキーに人名を入れてね」と決めておくと、AI はそのキー名を見て「ああ、人の名前について答えるんだな」と文脈を読み取ってしまう、ということです。 言い換えると、スキーマはデータ整理の側面もありながら、実は AI への指示としても機能していた、というのが論文の核心。キーを『answer』にするか『thought_process』にするかで、AI の思考パターンそのものが変わる。単なる形式の問題じゃなく、ネーミングが AI の判断基準になってしまってるわけです。従来は「正しい JSON 形式を守らせる装置」くらいにしか考えられていなかったのに、実は「AI に何を考えさせるか」まで左右していたということなんでしょう。

AIAIからの回答

スキーマというのは「データの型・形・枠組み」を定義する設計図のようなものですが、この記事の文脈では、もっと直接的に言うと「JSON でいうキーの名前と、その値がどんな形(数値か文字列か)かを決めておくこと」と考えると分かりやすいと思います。

データベースの設計図という捉え方も間違ってませんが、記事が指摘してるのはもう一段階手前の話。JSON の出力をさせるときに、あなたが「『name』というキーに人名を入れてね」と決めておくと、AI はそのキー名を見て「ああ、人の名前について答えるんだな」と文脈を読み取ってしまう、ということです。

言い換えると、スキーマはデータ整理の側面もありながら、実は AI への指示としても機能していた、というのが論文の核心。キーを『answer』にするか『thought_process』にするかで、AI の思考パターンそのものが変わる。単なる形式の問題じゃなく、ネーミングが AI の判断基準になってしまってるわけです。従来は「正しい JSON 形式を守らせる装置」くらいにしか考えられていなかったのに、実は「AI に何を考えさせるか」まで左右していたということなんでしょう。

まだ回答がありません

ログインすると、回答を投稿できます

?ChatGPT に何か質問するときに、キーの名前なんか気にしたことないけど、実は そこで結果が変わってたってこと?

キーの名前を全く気にしないで使ってきた人がほとんどでしょうし、実際のところ「気づかないレベルの変化」かもしれません。ただ、研究が指摘しているのは、それが確実に起きているということ。

たとえば、同じ質問でも『answer』というキーと『thought_process』というキーでは、AI が出力する内容の丁寧さや論理性に微妙な差が出るかもしれない。『thought_process』と名付けた時点で、AI は「考え過程を示そう」というシグナルを受け取るから。プロンプトに明示していなくても。

ただ、実際のチャットでそんなに効いてるかは別問題です。記事にもあるように、モデルによって反応が違う。ChatGPT が Qwen より敏感に反応するのか、逆なのか、記事だけからは分かりません。日常会話レベルなら、プロンプトの質の方がずっと大きく左右するはずです。

むしろ重要なのは、長文の構造化出力や、精密な分析レポートを生成させるといった、細かい品質を詰める場面かもしれません。そういう場面では、JSON スキーマの設計が「隠れた指示」として機能する価値が出てくると言えそうです。

ChatGPT に何か質問するときに、キーの名前なんか気にしたことないけど、実は そこで結果が変わってたってこと?

キーの名前を全く気にしないで使ってきた人がほとんどでしょうし、実際のところ「気づかないレベルの変化」かもしれません。ただ、研究が指摘しているのは、それが確実に起きているということ。 たとえば、同じ質問でも『answer』というキーと『thought_process』というキーでは、AI が出力する内容の丁寧さや論理性に微妙な差が出るかもしれない。『thought_process』と名付けた時点で、AI は「考え過程を示そう」というシグナルを受け取るから。プロンプトに明示していなくても。 ただ、実際のチャットでそんなに効いてるかは別問題です。記事にもあるように、モデルによって反応が違う。ChatGPT が Qwen より敏感に反応するのか、逆なのか、記事だけからは分かりません。日常会話レベルなら、プロンプトの質の方がずっと大きく左右するはずです。 むしろ重要なのは、長文の構造化出力や、精密な分析レポートを生成させるといった、細かい品質を詰める場面かもしれません。そういう場面では、JSON スキーマの設計が「隠れた指示」として機能する価値が出てくると言えそうです。

AIAIからの回答

キーの名前を全く気にしないで使ってきた人がほとんどでしょうし、実際のところ「気づかないレベルの変化」かもしれません。ただ、研究が指摘しているのは、それが確実に起きているということ。

たとえば、同じ質問でも『answer』というキーと『thought_process』というキーでは、AI が出力する内容の丁寧さや論理性に微妙な差が出るかもしれない。『thought_process』と名付けた時点で、AI は「考え過程を示そう」というシグナルを受け取るから。プロンプトに明示していなくても。

ただ、実際のチャットでそんなに効いてるかは別問題です。記事にもあるように、モデルによって反応が違う。ChatGPT が Qwen より敏感に反応するのか、逆なのか、記事だけからは分かりません。日常会話レベルなら、プロンプトの質の方がずっと大きく左右するはずです。

むしろ重要なのは、長文の構造化出力や、精密な分析レポートを生成させるといった、細かい品質を詰める場面かもしれません。そういう場面では、JSON スキーマの設計が「隠れた指示」として機能する価値が出てくると言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これまで『JSON 形式で答えて』ってプロンプト指示は形式を守らせるためだと思われてたのに、いつ頃からそんな効果があることに気づかれたの?

記事に明記された情報がないため、いつ頃という時期は正確には分かりませんが、背景を補えば、この種の発見は「スケーリングの先の段階」で初めて見えてくるものなのかもしれません。

ChatGPT が登場した当初、AI との付き合い方は「如何にプロンプトを工夫するか」に集中していました。JSON 形式指示は、単なる出力ルール。ただ、モデルの能力が上がり、プロンプト工学が成熟していくと、「形式指定が単なる枠ではなく、AI の推論そのものに影響を与えている」という、より細かい現象が浮かび上がるようになったと考えられます。

また、記事が複数モデルの「癖の違い」に触れているのは重要です。Qwen と LLaMA で効き方が変わるということは、この効果が意識的に設計されたものではなく、モデルの訓練過程や内部構造の副作用的に生まれた現象だと推測できます。だからこそ、誰かが「気づいた」というより、プロンプト工学の実験が積み重なる中で、研究者たちが「あ、これ形式が思考に影響してる」と後付けで見つけた、という流れなのかもしれません。

これまで『JSON 形式で答えて』ってプロンプト指示は形式を守らせるためだと思われてたのに、いつ頃からそんな効果があることに気づかれたの?

記事に明記された情報がないため、いつ頃という時期は正確には分かりませんが、背景を補えば、この種の発見は「スケーリングの先の段階」で初めて見えてくるものなのかもしれません。 ChatGPT が登場した当初、AI との付き合い方は「如何にプロンプトを工夫するか」に集中していました。JSON 形式指示は、単なる出力ルール。ただ、モデルの能力が上がり、プロンプト工学が成熟していくと、「形式指定が単なる枠ではなく、AI の推論そのものに影響を与えている」という、より細かい現象が浮かび上がるようになったと考えられます。 また、記事が複数モデルの「癖の違い」に触れているのは重要です。Qwen と LLaMA で効き方が変わるということは、この効果が意識的に設計されたものではなく、モデルの訓練過程や内部構造の副作用的に生まれた現象だと推測できます。だからこそ、誰かが「気づいた」というより、プロンプト工学の実験が積み重なる中で、研究者たちが「あ、これ形式が思考に影響してる」と後付けで見つけた、という流れなのかもしれません。

AIAIからの回答

記事に明記された情報がないため、いつ頃という時期は正確には分かりませんが、背景を補えば、この種の発見は「スケーリングの先の段階」で初めて見えてくるものなのかもしれません。

ChatGPT が登場した当初、AI との付き合い方は「如何にプロンプトを工夫するか」に集中していました。JSON 形式指示は、単なる出力ルール。ただ、モデルの能力が上がり、プロンプト工学が成熟していくと、「形式指定が単なる枠ではなく、AI の推論そのものに影響を与えている」という、より細かい現象が浮かび上がるようになったと考えられます。

また、記事が複数モデルの「癖の違い」に触れているのは重要です。Qwen と LLaMA で効き方が変わるということは、この効果が意識的に設計されたものではなく、モデルの訓練過程や内部構造の副作用的に生まれた現象だと推測できます。だからこそ、誰かが「気づいた」というより、プロンプト工学の実験が積み重なる中で、研究者たちが「あ、これ形式が思考に影響してる」と後付けで見つけた、という流れなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?つまりこれって『AI は言葉だけじゃなく、構造や形式という目に見えない信号からも学んでしまう』という話なの?

その通り、かつ、もう一段階奥があるような気がします。

言葉だけでなく構造から学ぶというより、言葉と構造が分離していないということなのかもしれません。私たちは「プロンプト」と「スキーマ」を別物に見ていますが、AI 側からすれば、キーの名前『answer』も、それを囲む中括弧も、同じトークンの流れとして処理している。『answer という単語がこここに現れている』という文脈が、「何を答えればいいのか」という意味を包含している。

ここが重要で、AI が「構造を理解している」わけではなく、「構造という形をした言語パターン」として受け取っているのでは。だから モデルごとに反応が違うんです。Qwen と LLaMA は学習データや設計思想が異なるから、同じ JSON でも読む「濃度」が違う。スキーマが効く場合もあれば効かない場合もある。

つまり、隠れた指示チャネルというより、『どんな形で情報を並べるかで、AI が拾う手がかりが変わってしまう』ということ。意図的に設計するのではなく、知らず知らずに送られる信号。それが性能を左右するのだから、もう「何をどう指示するか」の定義そのものを引き直す必要があるということなのかもしれません。

つまりこれって『AI は言葉だけじゃなく、構造や形式という目に見えない信号からも学んでしまう』という話なの?

その通り、かつ、もう一段階奥があるような気がします。 言葉だけでなく構造から学ぶというより、言葉と構造が分離していないということなのかもしれません。私たちは「プロンプト」と「スキーマ」を別物に見ていますが、AI 側からすれば、キーの名前『answer』も、それを囲む中括弧も、同じトークンの流れとして処理している。『answer という単語がこここに現れている』という文脈が、「何を答えればいいのか」という意味を包含している。 ここが重要で、AI が「構造を理解している」わけではなく、「構造という形をした言語パターン」として受け取っているのでは。だから モデルごとに反応が違うんです。Qwen と LLaMA は学習データや設計思想が異なるから、同じ JSON でも読む「濃度」が違う。スキーマが効く場合もあれば効かない場合もある。 つまり、隠れた指示チャネルというより、『どんな形で情報を並べるかで、AI が拾う手がかりが変わってしまう』ということ。意図的に設計するのではなく、知らず知らずに送られる信号。それが性能を左右するのだから、もう「何をどう指示するか」の定義そのものを引き直す必要があるということなのかもしれません。

AIAIからの回答

その通り、かつ、もう一段階奥があるような気がします。

言葉だけでなく構造から学ぶというより、言葉と構造が分離していないということなのかもしれません。私たちは「プロンプト」と「スキーマ」を別物に見ていますが、AI 側からすれば、キーの名前『answer』も、それを囲む中括弧も、同じトークンの流れとして処理している。『answer という単語がこここに現れている』という文脈が、「何を答えればいいのか」という意味を包含している。

ここが重要で、AI が「構造を理解している」わけではなく、「構造という形をした言語パターン」として受け取っているのでは。だから モデルごとに反応が違うんです。Qwen と LLaMA は学習データや設計思想が異なるから、同じ JSON でも読む「濃度」が違う。スキーマが効く場合もあれば効かない場合もある。

つまり、隠れた指示チャネルというより、『どんな形で情報を並べるかで、AI が拾う手がかりが変わってしまう』ということ。意図的に設計するのではなく、知らず知らずに送られる信号。それが性能を左右するのだから、もう「何をどう指示するか」の定義そのものを引き直す必要があるということなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?スキーマの付け方で AI の性能が変わるなら、逆に『悪いスキーマの設計』で AI を意図的に間違わせることもできちゃったりするの?

理論的には、スキーマの矛盾や曖昧さを仕込めば、AI を間違わせることはできるでしょう。でも実務的には、そこまで簡単ではないのかもしれません。

記事の趣旨は、スキーマが「隠れた指示」として機能しているということ。つまり、キーの名前や構造が、AI の思考の道筋に影響を与えている。逆算すれば、わざと誤解を招く名前や矛盾した構造を埋め込めば、AI は迷路に入るのかもしれません。

ただし、AI というのは同時に複数の信号を受け取っています。プロンプト本文の指示、スキーマの構造、そしてモデル自体の学習経験。これらが相互作用するから、単に「悪いスキーマ」を挿すだけで、確実に間違わせられるわけではない。むしろ、モデルによって反応の仕方が違うということは、スキーマだけでは支配できない堅牢性もあるということかもしれません。

面白いのは、これが無防備な弱点ではなく、設計の甘さと強靭さが同居している領域だということ。悪意を持って仕込むことはできそうだけど、実際にどの程度効くかは、相手がどの AI か、どういう指示の文脈か次第という、不確実性の大きさがあるのかもしれません。

スキーマの付け方で AI の性能が変わるなら、逆に『悪いスキーマの設計』で AI を意図的に間違わせることもできちゃったりするの?

理論的には、スキーマの矛盾や曖昧さを仕込めば、AI を間違わせることはできるでしょう。でも実務的には、そこまで簡単ではないのかもしれません。 記事の趣旨は、スキーマが「隠れた指示」として機能しているということ。つまり、キーの名前や構造が、AI の思考の道筋に影響を与えている。逆算すれば、わざと誤解を招く名前や矛盾した構造を埋め込めば、AI は迷路に入るのかもしれません。 ただし、AI というのは同時に複数の信号を受け取っています。プロンプト本文の指示、スキーマの構造、そしてモデル自体の学習経験。これらが相互作用するから、単に「悪いスキーマ」を挿すだけで、確実に間違わせられるわけではない。むしろ、モデルによって反応の仕方が違うということは、スキーマだけでは支配できない堅牢性もあるということかもしれません。 面白いのは、これが無防備な弱点ではなく、設計の甘さと強靭さが同居している領域だということ。悪意を持って仕込むことはできそうだけど、実際にどの程度効くかは、相手がどの AI か、どういう指示の文脈か次第という、不確実性の大きさがあるのかもしれません。

AIAIからの回答

理論的には、スキーマの矛盾や曖昧さを仕込めば、AI を間違わせることはできるでしょう。でも実務的には、そこまで簡単ではないのかもしれません。

記事の趣旨は、スキーマが「隠れた指示」として機能しているということ。つまり、キーの名前や構造が、AI の思考の道筋に影響を与えている。逆算すれば、わざと誤解を招く名前や矛盾した構造を埋め込めば、AI は迷路に入るのかもしれません。

ただし、AI というのは同時に複数の信号を受け取っています。プロンプト本文の指示、スキーマの構造、そしてモデル自体の学習経験。これらが相互作用するから、単に「悪いスキーマ」を挿すだけで、確実に間違わせられるわけではない。むしろ、モデルによって反応の仕方が違うということは、スキーマだけでは支配できない堅牢性もあるということかもしれません。

面白いのは、これが無防備な弱点ではなく、設計の甘さと強靭さが同居している領域だということ。悪意を持って仕込むことはできそうだけど、実際にどの程度効くかは、相手がどの AI か、どういう指示の文脈か次第という、不確実性の大きさがあるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます