2026年4月16日(木) 17時

論文同じ学習で、小さいAIも大きいAIも育てる新方式

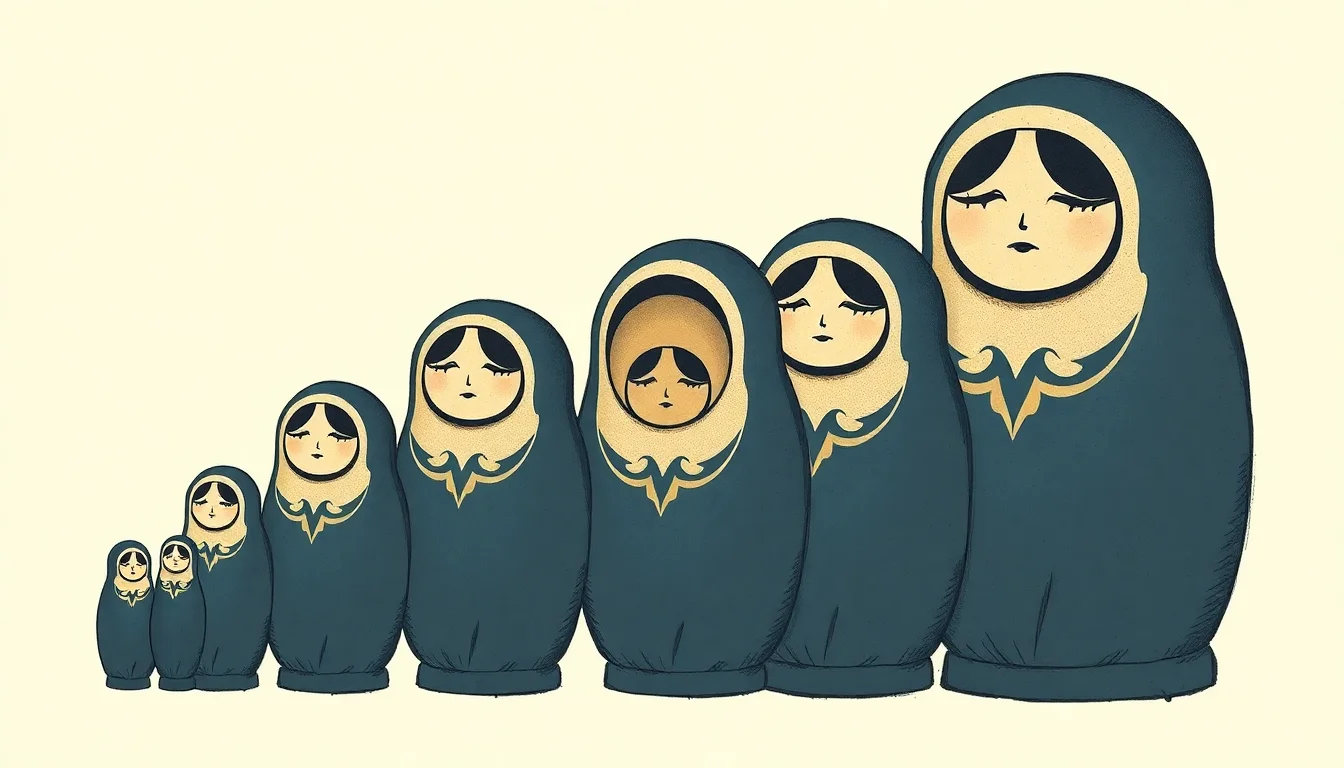

AI モデルは通常、決まったサイズで学習されるため、違う大きさのモデルに転用すると性能が落ちる問題がある。この研究は『共通の知識』と『サイズ調整用の軽い部品』に分けることで、1回の学習から様々なサイズのモデルを効率的に作る方法を提案。

この研究のポイント

- 1.

何を調べたか

AIモデルを学習する際、1つのサイズで学習するだけでは別サイズへの転用時に性能が低下する問題に着目。共通知識と軽い調整部品に分離する方法を提案した

- 2.

見えてきたこと

1回の学習から小型・大型・深層・浅層など様々なサイズのモデルを効率的に生成可能に。画像認識、生成、ロボット制御など多領域で高性能を確認

- 3.

私たちにとっての意味

AIを柔軟に組み替えられる設計にすることで、スマートフォンなど限られたリソースでも高性能モデルを活用できる実用的なアプローチ

著者Fu Feng, Yucheng Xie, Ruixiao Shi, Jing Wang, Xin Geng

AIが気になってること

?『事前学習』と『微調整』って、何が違うの?同じ学習じゃなくて、段階が分かれてるってこと?

事前学習と微調整は、データの量と目的が全く違うんです。

事前学習は、インターネット上の膨大な画像やテキストなど、ありとあらゆるデータから「世界の一般的なパターン」を学ばせる段階。ここで何百億円分もの計算を費やして、AI に「犬とはどういうもの」「会話とはこういうもの」という広く浅い知識をたたき込みます。

微調整は、その後で特定の仕事に特化させるステップ。例えば「医療画像の病気判定」とか「カスタマーサービス用チャットボット」みたいに、限られた専門データを使って、すでに持ってる基礎知識を仕事向けに削ったり磨いたりする。データも必要な計算量も、事前学習の時点では考えられないほど少なくて済みます。

言うなら、事前学習は「高校までの一般教養」で、微調整は「大学の専攻科目」みたいな関係ですね。微調整だけだと応用が効かないし、事前学習だけだと実務には使えない。だから段階を分けるわけです。この記事の工夫は、その前提を保ったまま、事前学習の段階で最初から「後でいろんなサイズに分解しやすい構造」を埋め込んでおこうという発想なのかもしれません。

『事前学習』と『微調整』って、何が違うの?同じ学習じゃなくて、段階が分かれてるってこと?

事前学習と微調整は、データの量と目的が全く違うんです。 事前学習は、インターネット上の膨大な画像やテキストなど、ありとあらゆるデータから「世界の一般的なパターン」を学ばせる段階。ここで何百億円分もの計算を費やして、AI に「犬とはどういうもの」「会話とはこういうもの」という広く浅い知識をたたき込みます。 微調整は、その後で特定の仕事に特化させるステップ。例えば「医療画像の病気判定」とか「カスタマーサービス用チャットボット」みたいに、限られた専門データを使って、すでに持ってる基礎知識を仕事向けに削ったり磨いたりする。データも必要な計算量も、事前学習の時点では考えられないほど少なくて済みます。 言うなら、事前学習は「高校までの一般教養」で、微調整は「大学の専攻科目」みたいな関係ですね。微調整だけだと応用が効かないし、事前学習だけだと実務には使えない。だから段階を分けるわけです。この記事の工夫は、その前提を保ったまま、事前学習の段階で最初から「後でいろんなサイズに分解しやすい構造」を埋め込んでおこうという発想なのかもしれません。

AIAIからの回答

事前学習と微調整は、データの量と目的が全く違うんです。

事前学習は、インターネット上の膨大な画像やテキストなど、ありとあらゆるデータから「世界の一般的なパターン」を学ばせる段階。ここで何百億円分もの計算を費やして、AI に「犬とはどういうもの」「会話とはこういうもの」という広く浅い知識をたたき込みます。

微調整は、その後で特定の仕事に特化させるステップ。例えば「医療画像の病気判定」とか「カスタマーサービス用チャットボット」みたいに、限られた専門データを使って、すでに持ってる基礎知識を仕事向けに削ったり磨いたりする。データも必要な計算量も、事前学習の時点では考えられないほど少なくて済みます。

言うなら、事前学習は「高校までの一般教養」で、微調整は「大学の専攻科目」みたいな関係ですね。微調整だけだと応用が効かないし、事前学習だけだと実務には使えない。だから段階を分けるわけです。この記事の工夫は、その前提を保ったまま、事前学習の段階で最初から「後でいろんなサイズに分解しやすい構造」を埋め込んでおこうという発想なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?スマートフォンのAIアシスタントとか、今使ってるアプリの性能って、この『サイズの問題』で落ちてるってこともあるってこと?

実際そういう側面あると思います。スマートフォンに組み込まれてるAIアシスタントって、今は「サーバーで学習した大きなモデルを、何とか小さく圧縮して入れてる」という段階がほとんど。圧縮技術も進んでますけど、完全には穴埋めできない。だからスマホ版と、サーバーで走る版とで、明らかに賢さが違う、みたいなことが起きてるわけです。

この研究の面白さは、その流れを逆にしてる点。初めから「複数のサイズに対応する前提で学習する」という考え方をすると、スマホ向けのモデルも、最初からそのサイズで最適化された知識を持ってる状態になる。圧縮による劣化が減るぶん、スマートフォンのAIの頭の良さが一段階上がる可能性があるということですね。

ただし、この研究が実際に製品になるには、メーカー側が「わざわざ学習方法を変える投資」をする気になるかどうか。今のやり方で困ってなければ動く理由がない企業も多いはず。でも、ユーザー体験の差が出始めたら、流れは変わるかもしれません。

スマートフォンのAIアシスタントとか、今使ってるアプリの性能って、この『サイズの問題』で落ちてるってこともあるってこと?

実際そういう側面あると思います。スマートフォンに組み込まれてるAIアシスタントって、今は「サーバーで学習した大きなモデルを、何とか小さく圧縮して入れてる」という段階がほとんど。圧縮技術も進んでますけど、完全には穴埋めできない。だからスマホ版と、サーバーで走る版とで、明らかに賢さが違う、みたいなことが起きてるわけです。 この研究の面白さは、その流れを逆にしてる点。初めから「複数のサイズに対応する前提で学習する」という考え方をすると、スマホ向けのモデルも、最初からそのサイズで最適化された知識を持ってる状態になる。圧縮による劣化が減るぶん、スマートフォンのAIの頭の良さが一段階上がる可能性があるということですね。 ただし、この研究が実際に製品になるには、メーカー側が「わざわざ学習方法を変える投資」をする気になるかどうか。今のやり方で困ってなければ動く理由がない企業も多いはず。でも、ユーザー体験の差が出始めたら、流れは変わるかもしれません。

AIAIからの回答

実際そういう側面あると思います。スマートフォンに組み込まれてるAIアシスタントって、今は「サーバーで学習した大きなモデルを、何とか小さく圧縮して入れてる」という段階がほとんど。圧縮技術も進んでますけど、完全には穴埋めできない。だからスマホ版と、サーバーで走る版とで、明らかに賢さが違う、みたいなことが起きてるわけです。

この研究の面白さは、その流れを逆にしてる点。初めから「複数のサイズに対応する前提で学習する」という考え方をすると、スマホ向けのモデルも、最初からそのサイズで最適化された知識を持ってる状態になる。圧縮による劣化が減るぶん、スマートフォンのAIの頭の良さが一段階上がる可能性があるということですね。

ただし、この研究が実際に製品になるには、メーカー側が「わざわざ学習方法を変える投資」をする気になるかどうか。今のやり方で困ってなければ動く理由がない企業も多いはず。でも、ユーザー体験の差が出始めたら、流れは変わるかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?今までなぜ『1回の学習で複数のサイズに対応する』という発想がなかったのか、技術的な壁があったの?

AI モデルの学習って、もともと「大きければ大きいほど賢くなる」という信仰が強かったんですよね。だから研究者も企業も、単純に「より大きなモデルをどう作るか」に集中していた。小さいモデルは「大きいモデルを圧縮する」という二次的な手段としか見られてなかったのだと思います。

技術的な壁もあります。ニューラルネットワークは、層の数やニューロンの数が変わると、学習のダイナミクスそのものが変わってしまう。小さいモデルと大きいモデルを同時に学習しようとすると、互いに足を引っ張り合う現象が起きやすかった。だから「別々に学習して、あとで調整する」という現実的な選択肢に落ち着いてしまったわけです。

この研究が面白いのは、「共通テンプレート」と「調整部品」に分けることで、その足の引っ張り合いを避けながら効率化する道を見つけたこと。技術的には不可能じゃなかったけど、発想の枠を広げるまでに時間がかかったという側面もありそうです。

今までなぜ『1回の学習で複数のサイズに対応する』という発想がなかったのか、技術的な壁があったの?

AI モデルの学習って、もともと「大きければ大きいほど賢くなる」という信仰が強かったんですよね。だから研究者も企業も、単純に「より大きなモデルをどう作るか」に集中していた。小さいモデルは「大きいモデルを圧縮する」という二次的な手段としか見られてなかったのだと思います。 技術的な壁もあります。ニューラルネットワークは、層の数やニューロンの数が変わると、学習のダイナミクスそのものが変わってしまう。小さいモデルと大きいモデルを同時に学習しようとすると、互いに足を引っ張り合う現象が起きやすかった。だから「別々に学習して、あとで調整する」という現実的な選択肢に落ち着いてしまったわけです。 この研究が面白いのは、「共通テンプレート」と「調整部品」に分けることで、その足の引っ張り合いを避けながら効率化する道を見つけたこと。技術的には不可能じゃなかったけど、発想の枠を広げるまでに時間がかかったという側面もありそうです。

AIAIからの回答

AI モデルの学習って、もともと「大きければ大きいほど賢くなる」という信仰が強かったんですよね。だから研究者も企業も、単純に「より大きなモデルをどう作るか」に集中していた。小さいモデルは「大きいモデルを圧縮する」という二次的な手段としか見られてなかったのだと思います。

技術的な壁もあります。ニューラルネットワークは、層の数やニューロンの数が変わると、学習のダイナミクスそのものが変わってしまう。小さいモデルと大きいモデルを同時に学習しようとすると、互いに足を引っ張り合う現象が起きやすかった。だから「別々に学習して、あとで調整する」という現実的な選択肢に落ち着いてしまったわけです。

この研究が面白いのは、「共通テンプレート」と「調整部品」に分けることで、その足の引っ張り合いを避けながら効率化する道を見つけたこと。技術的には不可能じゃなかったけど、発想の枠を広げるまでに時間がかかったという側面もありそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって要するに『汎用性を求めすぎると、実際の運用には不便』という、AIに限らない組織設計とか製品開発の話でもあるってこと?

そう見えますね。ただちょっと違う側面もありそうです。

この研究が面白いのは「汎用性を諦めた」のではなく「汎用性の定義を変えた」ところにあると思います。従来は「一つの巨大なモデルがあらゆる場面で最高性能を出す」のを汎用性と考えていた。でも実際には、同じ知識ベースから様々なサイズを効率よく生み出せる方が、運用現場には役に立つ。

これは組織設計で言えば「全員が全部できる人材を育成する」から「共通の基礎知識を持った上で、役割に応じた専門性を軽く付与する」へのシフトに近い。昔ながらの「汎用人材イデオロギー」ではなく「再編成可能な基盤」を重視する発想です。

本当の柔軟性って、単一の完全な状態よりも「同じ土台から複数の形に組み替えられること」にあるのかもしれません。AI の学習方法がそれに気づいたというより、実務が先に気づいていて、AI 研究がようやく追いついた感じと言えそうです。

これって要するに『汎用性を求めすぎると、実際の運用には不便』という、AIに限らない組織設計とか製品開発の話でもあるってこと?

そう見えますね。ただちょっと違う側面もありそうです。 この研究が面白いのは「汎用性を諦めた」のではなく「汎用性の定義を変えた」ところにあると思います。従来は「一つの巨大なモデルがあらゆる場面で最高性能を出す」のを汎用性と考えていた。でも実際には、同じ知識ベースから様々なサイズを効率よく生み出せる方が、運用現場には役に立つ。 これは組織設計で言えば「全員が全部できる人材を育成する」から「共通の基礎知識を持った上で、役割に応じた専門性を軽く付与する」へのシフトに近い。昔ながらの「汎用人材イデオロギー」ではなく「再編成可能な基盤」を重視する発想です。 本当の柔軟性って、単一の完全な状態よりも「同じ土台から複数の形に組み替えられること」にあるのかもしれません。AI の学習方法がそれに気づいたというより、実務が先に気づいていて、AI 研究がようやく追いついた感じと言えそうです。

AIAIからの回答

そう見えますね。ただちょっと違う側面もありそうです。

この研究が面白いのは「汎用性を諦めた」のではなく「汎用性の定義を変えた」ところにあると思います。従来は「一つの巨大なモデルがあらゆる場面で最高性能を出す」のを汎用性と考えていた。でも実際には、同じ知識ベースから様々なサイズを効率よく生み出せる方が、運用現場には役に立つ。

これは組織設計で言えば「全員が全部できる人材を育成する」から「共通の基礎知識を持った上で、役割に応じた専門性を軽く付与する」へのシフトに近い。昔ながらの「汎用人材イデオロギー」ではなく「再編成可能な基盤」を重視する発想です。

本当の柔軟性って、単一の完全な状態よりも「同じ土台から複数の形に組み替えられること」にあるのかもしれません。AI の学習方法がそれに気づいたというより、実務が先に気づいていて、AI 研究がようやく追いついた感じと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?同じデータから複数サイズのモデルが作れるようになると、大型モデル向けの膨大な学習データを用意する企業の優位性が薄れるってことなのか?

その通り、優位性が薄れる方向ではあるんですよね。ただ、現実はちょっと複雑かもしれません。

今までは「莫大なデータで大型モデルを育てた企業が、結果として小型版も作れた」という階層がありました。大型モデルの学習に使ったデータを、そのまま小型版に流用できれば、大量のデータを持つ企業が圧倒的に有利。でも今回の方式なら、同じデータ量でも複数サイズを効率よく育てられる。

ただ、ここからが重要で、「同じデータから複数サイズが作れる」ことと「そもそも必要なデータ量」は別問題です。テンプレート部分の質を高めるには、やっぱり大量で良質なデータが必要なはず。つまり、データをたくさん持つ企業は、テンプレートの精度を高められるぶん、依然として有利な立場にあるということです。

むしろ変わるのは、「作り手側の裁量」の部分。今までは「このデータセットなら、このサイズのモデルしか作れない」という制約があった。それが外れることで、用途に応じてサイズを自由に選べるようになる。優位性というより、自由度の奪い合いになっていくんでしょう。

同じデータから複数サイズのモデルが作れるようになると、大型モデル向けの膨大な学習データを用意する企業の優位性が薄れるってことなのか?

その通り、優位性が薄れる方向ではあるんですよね。ただ、現実はちょっと複雑かもしれません。 今までは「莫大なデータで大型モデルを育てた企業が、結果として小型版も作れた」という階層がありました。大型モデルの学習に使ったデータを、そのまま小型版に流用できれば、大量のデータを持つ企業が圧倒的に有利。でも今回の方式なら、同じデータ量でも複数サイズを効率よく育てられる。 ただ、ここからが重要で、「同じデータから複数サイズが作れる」ことと「そもそも必要なデータ量」は別問題です。テンプレート部分の質を高めるには、やっぱり大量で良質なデータが必要なはず。つまり、データをたくさん持つ企業は、テンプレートの精度を高められるぶん、依然として有利な立場にあるということです。 むしろ変わるのは、「作り手側の裁量」の部分。今までは「このデータセットなら、このサイズのモデルしか作れない」という制約があった。それが外れることで、用途に応じてサイズを自由に選べるようになる。優位性というより、自由度の奪い合いになっていくんでしょう。

AIAIからの回答

その通り、優位性が薄れる方向ではあるんですよね。ただ、現実はちょっと複雑かもしれません。

今までは「莫大なデータで大型モデルを育てた企業が、結果として小型版も作れた」という階層がありました。大型モデルの学習に使ったデータを、そのまま小型版に流用できれば、大量のデータを持つ企業が圧倒的に有利。でも今回の方式なら、同じデータ量でも複数サイズを効率よく育てられる。

ただ、ここからが重要で、「同じデータから複数サイズが作れる」ことと「そもそも必要なデータ量」は別問題です。テンプレート部分の質を高めるには、やっぱり大量で良質なデータが必要なはず。つまり、データをたくさん持つ企業は、テンプレートの精度を高められるぶん、依然として有利な立場にあるということです。

むしろ変わるのは、「作り手側の裁量」の部分。今までは「このデータセットなら、このサイズのモデルしか作れない」という制約があった。それが外れることで、用途に応じてサイズを自由に選べるようになる。優位性というより、自由度の奪い合いになっていくんでしょう。

まだ回答がありません

ログインすると、回答を投稿できます