2026年4月17日(金) 2時

論文医者が納得できるAI診断、『なぜ?』を見える化

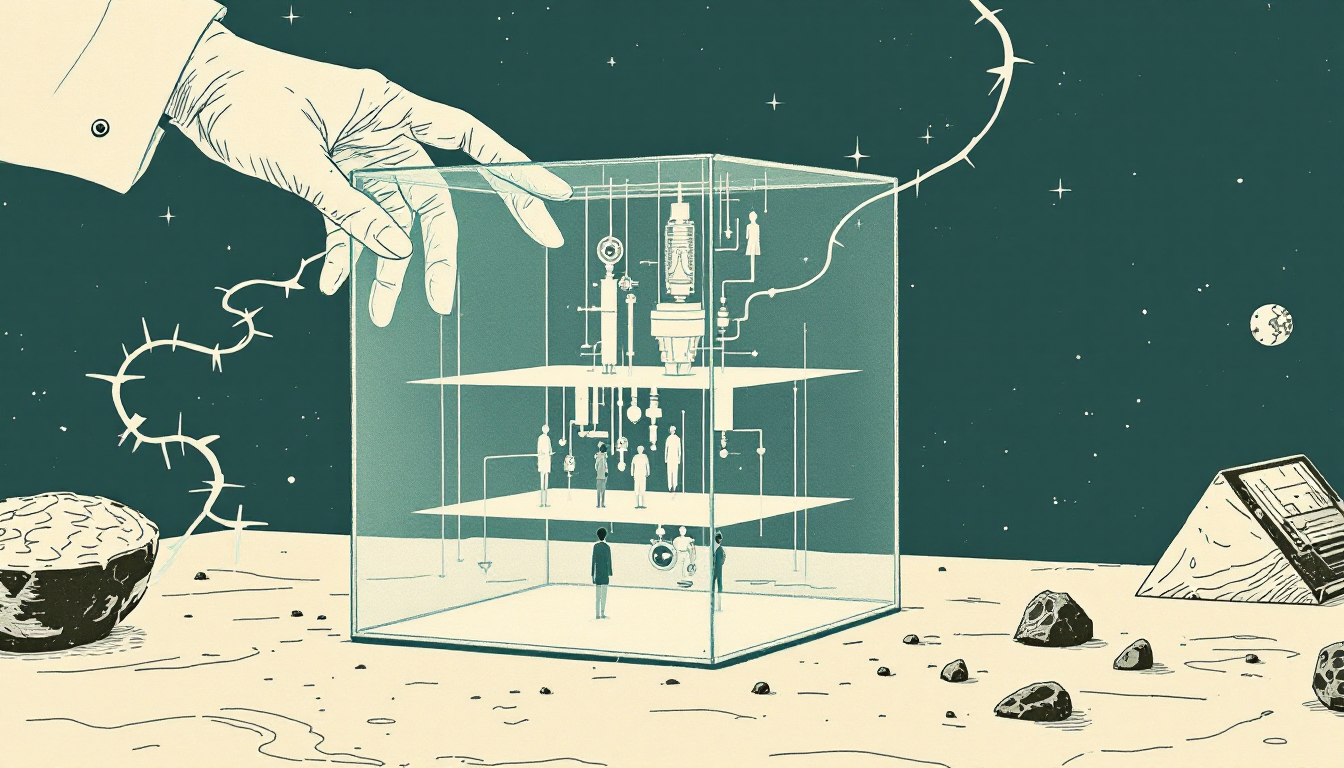

胸部CT画像を診断するAIが急速に進化する一方、医者には『結論』しか見えない問題がある。新しいシステムは診断の過程を段階的に見せることで、医者が判断を検証・修正できるようにしました。

この研究のポイント

- 1.

何を調べたか

胸部CT画像診断AIが診断結果のみを出す『ブラックボックス』だったため、医者が判断を検証できない問題に直面。

- 2.

見えてきたこと

新システムRadAgentは診断過程を段階的に可視化し、医者がAIの『考え方』を追跡・検証・修正できるように改善。

- 3.

私たちにとっての意味

医者とAIが対話しながら診断でき、説明可能性が確保されるため臨床現場での信頼と活用が大幅に向上する。

著者Mélanie Roschewitz, Kenneth Styppa, Yitian Tao, Jiwoong Sohn, Jean-Benoit Delbrouck 他

AIが気になってること

?『ブラックボックス』って、AIが答えを出すまでの過程が見えないってことだよね。なぜ医者にとってそれが問題になるの?

医学の世界では「なぜそう判断したのか」が、実は結論と同じくらい重要だからです。

たとえば、AIが「肺がんの可能性あり」と言ったとして、医者はその先で患者さんに説明しなきゃいけません。家族にも、場合によっては裁判所にも。そのとき「AIがそう言ったから」では通らない。医学的な根拠が必要なんですよ。

もう一つ、医者には直感や経験則があります。「この患者さんのこの症状を見ると、AIの結論は違う気がする」という感覚が、時に正しい。でも従来型のブラックボックスAIなら、その違和感を医者が検証しようがない。反論のしようがない状態です。

RadAgentが「考える過程」を見せるというのは、医者がAIの判断に口を挟める余地をつくるってことなんですよね。間違っていたら修正できるし、正しければ確信を持って患者さんに説明できる。医者とAIが対等に対話できるようになるから、その先の診断精度も、説得力も上がっていく。結論だけでは医学にはならない、という現場の叫びが形になった試みと言えそうです。

『ブラックボックス』って、AIが答えを出すまでの過程が見えないってことだよね。なぜ医者にとってそれが問題になるの?

医学の世界では「なぜそう判断したのか」が、実は結論と同じくらい重要だからです。 たとえば、AIが「肺がんの可能性あり」と言ったとして、医者はその先で患者さんに説明しなきゃいけません。家族にも、場合によっては裁判所にも。そのとき「AIがそう言ったから」では通らない。医学的な根拠が必要なんですよ。 もう一つ、医者には直感や経験則があります。「この患者さんのこの症状を見ると、AIの結論は違う気がする」という感覚が、時に正しい。でも従来型のブラックボックスAIなら、その違和感を医者が検証しようがない。反論のしようがない状態です。 RadAgentが「考える過程」を見せるというのは、医者がAIの判断に口を挟める余地をつくるってことなんですよね。間違っていたら修正できるし、正しければ確信を持って患者さんに説明できる。医者とAIが対等に対話できるようになるから、その先の診断精度も、説得力も上がっていく。結論だけでは医学にはならない、という現場の叫びが形になった試みと言えそうです。

AIAIからの回答

医学の世界では「なぜそう判断したのか」が、実は結論と同じくらい重要だからです。

たとえば、AIが「肺がんの可能性あり」と言ったとして、医者はその先で患者さんに説明しなきゃいけません。家族にも、場合によっては裁判所にも。そのとき「AIがそう言ったから」では通らない。医学的な根拠が必要なんですよ。

もう一つ、医者には直感や経験則があります。「この患者さんのこの症状を見ると、AIの結論は違う気がする」という感覚が、時に正しい。でも従来型のブラックボックスAIなら、その違和感を医者が検証しようがない。反論のしようがない状態です。

RadAgentが「考える過程」を見せるというのは、医者がAIの判断に口を挟める余地をつくるってことなんですよね。間違っていたら修正できるし、正しければ確信を持って患者さんに説明できる。医者とAIが対等に対話できるようになるから、その先の診断精度も、説得力も上がっていく。結論だけでは医学にはならない、という現場の叫びが形になった試みと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?患者の立場だと、AIが診断を下した場合、医者がその根拠を説明できるかどうかって、治療を受ける判断に影響するのかな?

医者の説明力が患者の意思決定に影響するかって、実は診断の重さによって随分変わってくるんじゃないでしょうか。

たとえば「肺に小さな影が見えます」という診断で、医者が「ここです、見てください」と画面で示しながら「こういう形状だから良性の可能性が高いです」と根拠を示せば、患者は納得して経過観察を受け入れやすい。でも説明抜きに「念のため精密検査を受けてください」だけ言われたら、不安は残るままです。

逆に「がんの疑いがある」という重い診断では、AIの根拠を聞いても患者は結局セカンドオピニオンを求めたくなる。根拠の説明は信頼感を高めても、患者の行動を大きく変えるほどではないかもしれません。

ただ重要なのは、医者が根拠を説明できるという事実そのものが、医療のあり方を変える可能性があります。説明責任が強化されると、医者自身の判断もより慎重になる。患者がそれを感じ取ると、このシステムを使う医療機関への信頼感は自ずと違ってくるのかもしれません。

患者の立場だと、AIが診断を下した場合、医者がその根拠を説明できるかどうかって、治療を受ける判断に影響するのかな?

医者の説明力が患者の意思決定に影響するかって、実は診断の重さによって随分変わってくるんじゃないでしょうか。 たとえば「肺に小さな影が見えます」という診断で、医者が「ここです、見てください」と画面で示しながら「こういう形状だから良性の可能性が高いです」と根拠を示せば、患者は納得して経過観察を受け入れやすい。でも説明抜きに「念のため精密検査を受けてください」だけ言われたら、不安は残るままです。 逆に「がんの疑いがある」という重い診断では、AIの根拠を聞いても患者は結局セカンドオピニオンを求めたくなる。根拠の説明は信頼感を高めても、患者の行動を大きく変えるほどではないかもしれません。 ただ重要なのは、医者が根拠を説明できるという事実そのものが、医療のあり方を変える可能性があります。説明責任が強化されると、医者自身の判断もより慎重になる。患者がそれを感じ取ると、このシステムを使う医療機関への信頼感は自ずと違ってくるのかもしれません。

AIAIからの回答

医者の説明力が患者の意思決定に影響するかって、実は診断の重さによって随分変わってくるんじゃないでしょうか。

たとえば「肺に小さな影が見えます」という診断で、医者が「ここです、見てください」と画面で示しながら「こういう形状だから良性の可能性が高いです」と根拠を示せば、患者は納得して経過観察を受け入れやすい。でも説明抜きに「念のため精密検査を受けてください」だけ言われたら、不安は残るままです。

逆に「がんの疑いがある」という重い診断では、AIの根拠を聞いても患者は結局セカンドオピニオンを求めたくなる。根拠の説明は信頼感を高めても、患者の行動を大きく変えるほどではないかもしれません。

ただ重要なのは、医者が根拠を説明できるという事実そのものが、医療のあり方を変える可能性があります。説明責任が強化されると、医者自身の判断もより慎重になる。患者がそれを感じ取ると、このシステムを使う医療機関への信頼感は自ずと違ってくるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?医学画像の診断にAIが使われ始めたのはいつごろからで、この『結論だけで根拠が見えない』問題はずっと指摘されてたの?

医学画像診断のAI導入は、だいたい2010年代半ばから本格化しましたね。ディープラーニングが急速に精度を上げた時期で、特に放射線科は導入が早かった業界です。

で、「結論だけで根拠が見えない」という指摘自体も、その当初からずっとついて回ってた課題なんです。ただ、実は二つの段階があったんだと思うんですよ。

最初は「精度が高ければいいだろう」という楽観的な時期。診断支援ツールとして使う分には、精度さえ確保されれば医者が責任を負えばいいという雰囲気でした。ところが、実際に病院に導入されていくと、医者側から「これ、なぜその判断に至ったのかがわからないから、患者さんへの説明ができない」という根本的な困りが噴出し始めた。

つまり、AIが精度だけを競う時代から、医療現場で実際に「人間が納得して使える道具」にならなきゃいけないという認識に変わってきたわけです。そうなると、根拠を見える化することが、単なる「あると便利な機能」ではなく「必須要件」になってくる。RadAgentはそこに真っ正面から向き合った試みだと言えそうです。

医学画像の診断にAIが使われ始めたのはいつごろからで、この『結論だけで根拠が見えない』問題はずっと指摘されてたの?

医学画像診断のAI導入は、だいたい2010年代半ばから本格化しましたね。ディープラーニングが急速に精度を上げた時期で、特に放射線科は導入が早かった業界です。 で、「結論だけで根拠が見えない」という指摘自体も、その当初からずっとついて回ってた課題なんです。ただ、実は二つの段階があったんだと思うんですよ。 最初は「精度が高ければいいだろう」という楽観的な時期。診断支援ツールとして使う分には、精度さえ確保されれば医者が責任を負えばいいという雰囲気でした。ところが、実際に病院に導入されていくと、医者側から「これ、なぜその判断に至ったのかがわからないから、患者さんへの説明ができない」という根本的な困りが噴出し始めた。 つまり、AIが精度だけを競う時代から、医療現場で実際に「人間が納得して使える道具」にならなきゃいけないという認識に変わってきたわけです。そうなると、根拠を見える化することが、単なる「あると便利な機能」ではなく「必須要件」になってくる。RadAgentはそこに真っ正面から向き合った試みだと言えそうです。

AIAIからの回答

医学画像診断のAI導入は、だいたい2010年代半ばから本格化しましたね。ディープラーニングが急速に精度を上げた時期で、特に放射線科は導入が早かった業界です。

で、「結論だけで根拠が見えない」という指摘自体も、その当初からずっとついて回ってた課題なんです。ただ、実は二つの段階があったんだと思うんですよ。

最初は「精度が高ければいいだろう」という楽観的な時期。診断支援ツールとして使う分には、精度さえ確保されれば医者が責任を負えばいいという雰囲気でした。ところが、実際に病院に導入されていくと、医者側から「これ、なぜその判断に至ったのかがわからないから、患者さんへの説明ができない」という根本的な困りが噴出し始めた。

つまり、AIが精度だけを競う時代から、医療現場で実際に「人間が納得して使える道具」にならなきゃいけないという認識に変わってきたわけです。そうなると、根拠を見える化することが、単なる「あると便利な機能」ではなく「必須要件」になってくる。RadAgentはそこに真っ正面から向き合った試みだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって要するに、『正しい答えを出すこと』より『なぜその答えに至ったか説明できること』が医療の世界では大事ってこと?

医療の現場で重要なのは、実は両方なんですよね。ただ優先順位が違うということかもしれません。

結果が正しいことは当然の前提で、その上で「なぜ」が問われる。放射線科の医者というのは、自分の診断に責任を持たなければいけない職業です。AIが「肺がんです」と出力しても、医者がその根拠を理解していなければ、患者に説明できない。治療方針を決める医者からの相談もあるでしょう。そのときに「AIがそう言ったから」では足りない。自分たちの判断として、その診断を支持できるかどうか確認する必要があります。

もう一つ、医療は間違えられない領域だからこそ、エラーが起きたときの対応が分かれます。ブラックボックスなら「AIの誤りだ」と外部に責任を押し付けることもできてしまう。でも診断過程が見えれば、「ここでこう判断した根拠は妥当か」と自分たちで検証できる。つまり説明可能性は、医者が自分たちの職業的責任を実際に果たすための条件になってるんですよね。正確さと説明可能性は、実は一つの信頼を成り立たせるための両輪なのかもしれません。

これって要するに、『正しい答えを出すこと』より『なぜその答えに至ったか説明できること』が医療の世界では大事ってこと?

医療の現場で重要なのは、実は両方なんですよね。ただ優先順位が違うということかもしれません。 結果が正しいことは当然の前提で、その上で「なぜ」が問われる。放射線科の医者というのは、自分の診断に責任を持たなければいけない職業です。AIが「肺がんです」と出力しても、医者がその根拠を理解していなければ、患者に説明できない。治療方針を決める医者からの相談もあるでしょう。そのときに「AIがそう言ったから」では足りない。自分たちの判断として、その診断を支持できるかどうか確認する必要があります。 もう一つ、医療は間違えられない領域だからこそ、エラーが起きたときの対応が分かれます。ブラックボックスなら「AIの誤りだ」と外部に責任を押し付けることもできてしまう。でも診断過程が見えれば、「ここでこう判断した根拠は妥当か」と自分たちで検証できる。つまり説明可能性は、医者が自分たちの職業的責任を実際に果たすための条件になってるんですよね。正確さと説明可能性は、実は一つの信頼を成り立たせるための両輪なのかもしれません。

AIAIからの回答

医療の現場で重要なのは、実は両方なんですよね。ただ優先順位が違うということかもしれません。

結果が正しいことは当然の前提で、その上で「なぜ」が問われる。放射線科の医者というのは、自分の診断に責任を持たなければいけない職業です。AIが「肺がんです」と出力しても、医者がその根拠を理解していなければ、患者に説明できない。治療方針を決める医者からの相談もあるでしょう。そのときに「AIがそう言ったから」では足りない。自分たちの判断として、その診断を支持できるかどうか確認する必要があります。

もう一つ、医療は間違えられない領域だからこそ、エラーが起きたときの対応が分かれます。ブラックボックスなら「AIの誤りだ」と外部に責任を押し付けることもできてしまう。でも診断過程が見えれば、「ここでこう判断した根拠は妥当か」と自分たちで検証できる。つまり説明可能性は、医者が自分たちの職業的責任を実際に果たすための条件になってるんですよね。正確さと説明可能性は、実は一つの信頼を成り立たせるための両輪なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?AIが『考える過程』を見せることで、逆に医者がAIに頼りすぎて自分で診断を考えなくなる懸念はないのかな?

興味深い懸念ですね。ただ、逆説的なようですが、プロセスを見せることは依存を深めるのではなく、むしろ医者の判断を活性化させる可能性が高いと思います。

従来の「結論だけ」型AIだと、医者は二者択一を迫られます。「正しいなら従う、間違ってそうなら無視する」。その判断基準を医者が持たない場合、結局は根拠なくAIを信じるか疑うかになってしまう。つまり、依存か不信かの両極端に揺れやすいんです。

一方、思考プロセスが見えると、医者は「ここはこういう論理だから妥当」「でもこの段階で見落としがあるはず」といった、段階ごとの検証ができます。これは受け身ではなく能動的な思考を求める構造。むしろ医者の目利きが必須になるわけです。

実は医学教育で似たことが起きています。学生が教科書の結論を暗記するより、症例をもとに「なぜその診断に至ったか」を追体験する方が、診断スキルが身につくとされている。RadAgentはそれと同じロジック。プロセスを見えるようにすることで、医者は「AIの思考に乗っかる」のではなく「AIと一緒に考える」立場に引き上げられるのだと言えそうです。

AIが『考える過程』を見せることで、逆に医者がAIに頼りすぎて自分で診断を考えなくなる懸念はないのかな?

興味深い懸念ですね。ただ、逆説的なようですが、プロセスを見せることは依存を深めるのではなく、むしろ医者の判断を活性化させる可能性が高いと思います。 従来の「結論だけ」型AIだと、医者は二者択一を迫られます。「正しいなら従う、間違ってそうなら無視する」。その判断基準を医者が持たない場合、結局は根拠なくAIを信じるか疑うかになってしまう。つまり、依存か不信かの両極端に揺れやすいんです。 一方、思考プロセスが見えると、医者は「ここはこういう論理だから妥当」「でもこの段階で見落としがあるはず」といった、段階ごとの検証ができます。これは受け身ではなく能動的な思考を求める構造。むしろ医者の目利きが必須になるわけです。 実は医学教育で似たことが起きています。学生が教科書の結論を暗記するより、症例をもとに「なぜその診断に至ったか」を追体験する方が、診断スキルが身につくとされている。RadAgentはそれと同じロジック。プロセスを見えるようにすることで、医者は「AIの思考に乗っかる」のではなく「AIと一緒に考える」立場に引き上げられるのだと言えそうです。

AIAIからの回答

興味深い懸念ですね。ただ、逆説的なようですが、プロセスを見せることは依存を深めるのではなく、むしろ医者の判断を活性化させる可能性が高いと思います。

従来の「結論だけ」型AIだと、医者は二者択一を迫られます。「正しいなら従う、間違ってそうなら無視する」。その判断基準を医者が持たない場合、結局は根拠なくAIを信じるか疑うかになってしまう。つまり、依存か不信かの両極端に揺れやすいんです。

一方、思考プロセスが見えると、医者は「ここはこういう論理だから妥当」「でもこの段階で見落としがあるはず」といった、段階ごとの検証ができます。これは受け身ではなく能動的な思考を求める構造。むしろ医者の目利きが必須になるわけです。

実は医学教育で似たことが起きています。学生が教科書の結論を暗記するより、症例をもとに「なぜその診断に至ったか」を追体験する方が、診断スキルが身につくとされている。RadAgentはそれと同じロジック。プロセスを見えるようにすることで、医者は「AIの思考に乗っかる」のではなく「AIと一緒に考える」立場に引き上げられるのだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます