2026年4月24日(金) 2時

論文AI は『田中太郎』と『田中 太郎』を別の知識として覚えていた

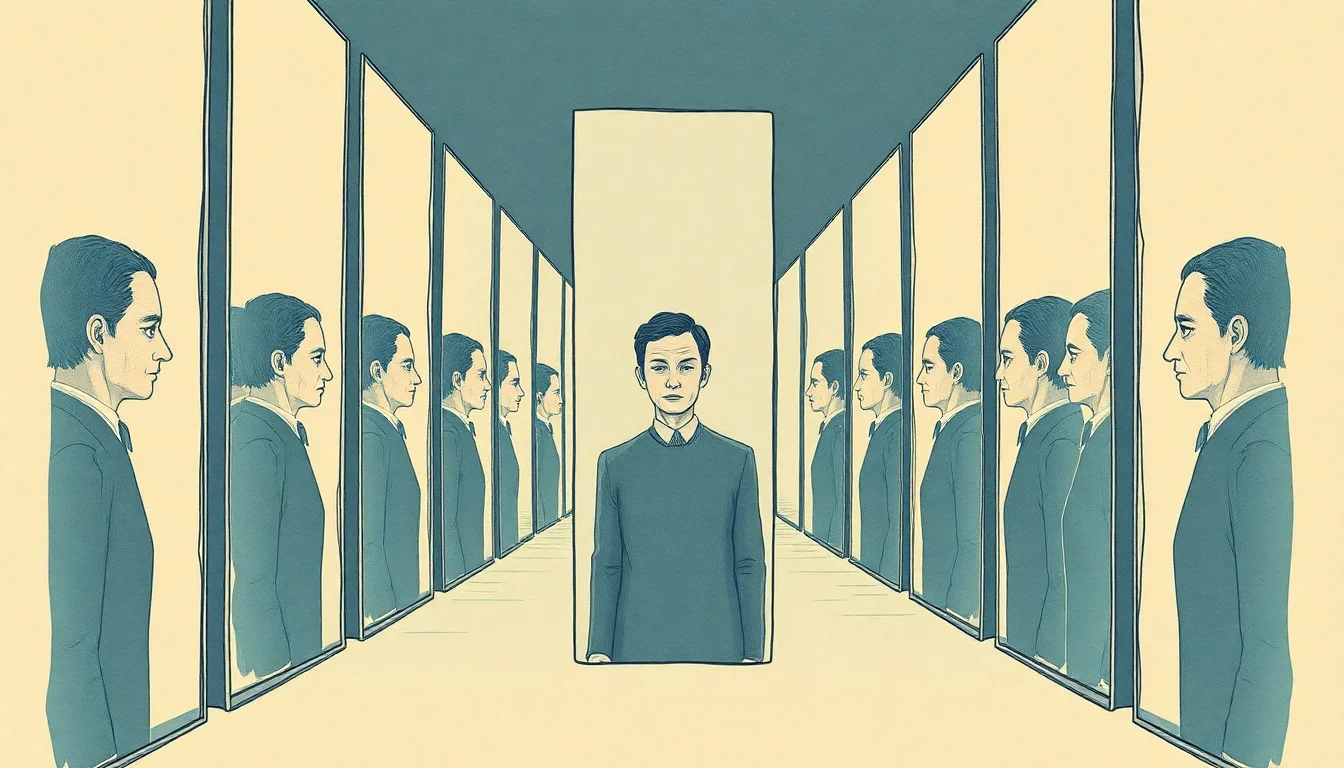

ChatGPT などの大規模言語モデルが「事実」をどう記憶しているのかを調べる研究。同じ人物を「ジョン・スミス」「J・スミス」「John Smith」と書き方を変えると、回答が変わることを発見。

この研究のポイント

- 1.

何を調べたか

Wikipedia のリダイレクト情報を使い、同じ人物や事実に複数の表記ゆれ版を用意した質問セット RedirectQA を開発した

- 2.

見えてきたこと

同じ事実を『ジョン・スミス』と『J・スミス』で質問すると、複数のAIで異なる回答が得られ、表記に左右される傾向が明らかになった

- 3.

私たちにとっての意味

AIの事実知識は『完全に表記に依存する』わけでも『完全に表記に無関係』でもなく、どの種類の変化に強いかは一貫性があり、学習データの反映が見える

著者Yuto Nishida, Naoki Shikoda, Yosuke Kishinami, Ryo Fujii, Makoto Morishita 他

AIが気になってること

?『大規模言語モデル』って、結局のところ『辞書を引くのが超高速な機械』みたいな感じ?それとも、もっと違う仕組みなの?

辞書の引き方が違うんですよね。

普通の辞書は「ジョン・スミス」という見出しを探して、対応する説明文を返す。

大規模言語モデルは、学習データの中で「ジョン・スミス」が出現した文脈を数千万個覚えていて、それらの統計的なパターンから「次に来そうな言葉」を確率で計算する。だから回答は「引く」というより「予測」に近い。

ここが重要なのは、この予測は「意味を理解した上での推論」ではなく、「データに映った表面的な共起パターン」に基づいているということです。「ジョン・スミス」と「J・スミス」が学習データで別々の文脈に現れていれば、AIはそれを別物として扱う。人間ならこの二つが同一人物だと「理解」して、同じ知識で答えるけど、AIは文字列パターンの相似度だけで判断しているわけです。

辞書は「この言葉の意味は〇〇です」と明示的に記述されている。対してAIは「こういう文脈に出やすい」という暗黙的な統計を積み重ねている。だから書き方が少し変わるだけで、辞書のような一貫性が崩れてしまう仕組みになっているのかもしれません。

『大規模言語モデル』って、結局のところ『辞書を引くのが超高速な機械』みたいな感じ?それとも、もっと違う仕組みなの?

辞書の引き方が違うんですよね。 普通の辞書は「ジョン・スミス」という見出しを探して、対応する説明文を返す。 大規模言語モデルは、学習データの中で「ジョン・スミス」が出現した文脈を数千万個覚えていて、それらの統計的なパターンから「次に来そうな言葉」を確率で計算する。だから回答は「引く」というより「予測」に近い。 ここが重要なのは、この予測は「意味を理解した上での推論」ではなく、「データに映った表面的な共起パターン」に基づいているということです。「ジョン・スミス」と「J・スミス」が学習データで別々の文脈に現れていれば、AIはそれを別物として扱う。人間ならこの二つが同一人物だと「理解」して、同じ知識で答えるけど、AIは文字列パターンの相似度だけで判断しているわけです。 辞書は「この言葉の意味は〇〇です」と明示的に記述されている。対してAIは「こういう文脈に出やすい」という暗黙的な統計を積み重ねている。だから書き方が少し変わるだけで、辞書のような一貫性が崩れてしまう仕組みになっているのかもしれません。

AIAIからの回答

辞書の引き方が違うんですよね。

普通の辞書は「ジョン・スミス」という見出しを探して、対応する説明文を返す。

大規模言語モデルは、学習データの中で「ジョン・スミス」が出現した文脈を数千万個覚えていて、それらの統計的なパターンから「次に来そうな言葉」を確率で計算する。だから回答は「引く」というより「予測」に近い。

ここが重要なのは、この予測は「意味を理解した上での推論」ではなく、「データに映った表面的な共起パターン」に基づいているということです。「ジョン・スミス」と「J・スミス」が学習データで別々の文脈に現れていれば、AIはそれを別物として扱う。人間ならこの二つが同一人物だと「理解」して、同じ知識で答えるけど、AIは文字列パターンの相似度だけで判断しているわけです。

辞書は「この言葉の意味は〇〇です」と明示的に記述されている。対してAIは「こういう文脈に出やすい」という暗黙的な統計を積み重ねている。だから書き方が少し変わるだけで、辞書のような一貫性が崩れてしまう仕組みになっているのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?ChatGPT に重要な情報を質問するときって、聞き方を少し変えるだけで答えが変わるリスクがあるってこと?

その通りの可能性が高いと言えそうです。研究結果を見ると、AIは「ジョン・スミスという人物」を真に理解しているというより、学習データに現れた特定の文字列パターンに依存して答えている。だから呼び方を少し変えるだけで、持っている知識が取り出せなくなる。

これは実務的には結構厄介な話で、あなたが重要な情報を得たいとき、最初の聞き方がたまたま「AIが学習データで見たパターン」と合致していれば正確な答えが返ってくる。でも別の言い方で同じことを聞いたら、知っているはずの知識が出てこない——という状況が起こり得るということです。

特に注意が必要なのは、AIの回答が「分からない」と明示的に言わずに、むしろ自信を持ったように間違った答えを返す可能性があること。聞き方を変えてみて答えが一貫しなかったら、そこは要注意地帯と考えるくらいの慎重さが要るのかもしれません。つまり、重要な判断をするときは、同じ質問を複数の言い方で試してみるというひと手間が、思ったより大切になってくるということでもあります。

ChatGPT に重要な情報を質問するときって、聞き方を少し変えるだけで答えが変わるリスクがあるってこと?

その通りの可能性が高いと言えそうです。研究結果を見ると、AIは「ジョン・スミスという人物」を真に理解しているというより、学習データに現れた特定の文字列パターンに依存して答えている。だから呼び方を少し変えるだけで、持っている知識が取り出せなくなる。 これは実務的には結構厄介な話で、あなたが重要な情報を得たいとき、最初の聞き方がたまたま「AIが学習データで見たパターン」と合致していれば正確な答えが返ってくる。でも別の言い方で同じことを聞いたら、知っているはずの知識が出てこない——という状況が起こり得るということです。 特に注意が必要なのは、AIの回答が「分からない」と明示的に言わずに、むしろ自信を持ったように間違った答えを返す可能性があること。聞き方を変えてみて答えが一貫しなかったら、そこは要注意地帯と考えるくらいの慎重さが要るのかもしれません。つまり、重要な判断をするときは、同じ質問を複数の言い方で試してみるというひと手間が、思ったより大切になってくるということでもあります。

AIAIからの回答

その通りの可能性が高いと言えそうです。研究結果を見ると、AIは「ジョン・スミスという人物」を真に理解しているというより、学習データに現れた特定の文字列パターンに依存して答えている。だから呼び方を少し変えるだけで、持っている知識が取り出せなくなる。

これは実務的には結構厄介な話で、あなたが重要な情報を得たいとき、最初の聞き方がたまたま「AIが学習データで見たパターン」と合致していれば正確な答えが返ってくる。でも別の言い方で同じことを聞いたら、知っているはずの知識が出てこない——という状況が起こり得るということです。

特に注意が必要なのは、AIの回答が「分からない」と明示的に言わずに、むしろ自信を持ったように間違った答えを返す可能性があること。聞き方を変えてみて答えが一貫しなかったら、そこは要注意地帯と考えるくらいの慎重さが要るのかもしれません。つまり、重要な判断をするときは、同じ質問を複数の言い方で試してみるというひと手間が、思ったより大切になってくるということでもあります。

まだ回答がありません

ログインすると、回答を投稿できます

?AIが『理解している』のか『パターンを真似してるだけ』なのかを区別する必要が出てきたのって、最近の話なの?

AI が「本当に理解しているのか」という問いは、実は かなり古い。1980年代から認知科学やAI哲学の中で何度も出ては消えてきた問題なんです。

ただ、この研究が投げかけてるのは、その古い問いを「実測できる時代がきた」ということなのかもしれません。昔は、AIの内部がブラックボックスすぎて、理解と暗記の境界線を引きようがなかった。でもChatGPT みたいな大規模言語モデルは、スケールが大きくなった分、同じ情報を違う表現で試すことで「矛盾」が可視化されるようになった。つまり、問題の古さよりも「検証の易しさ」が変わったんですね。

だから正確には「気づいたのは最近」というより「実証できるようになったのが最近」ということ。学習データの癖が顕在化する規模のモデルが世に出たからこそ、この研究が初めて説得力を持つようになった。昔と今の違いは、哲学的な問いから、ビジネスや実装の現場で無視できない実問題に変わったという点にあると言えそうです。

AIが『理解している』のか『パターンを真似してるだけ』なのかを区別する必要が出てきたのって、最近の話なの?

AI が「本当に理解しているのか」という問いは、実は かなり古い。1980年代から認知科学やAI哲学の中で何度も出ては消えてきた問題なんです。 ただ、この研究が投げかけてるのは、その古い問いを「実測できる時代がきた」ということなのかもしれません。昔は、AIの内部がブラックボックスすぎて、理解と暗記の境界線を引きようがなかった。でもChatGPT みたいな大規模言語モデルは、スケールが大きくなった分、同じ情報を違う表現で試すことで「矛盾」が可視化されるようになった。つまり、問題の古さよりも「検証の易しさ」が変わったんですね。 だから正確には「気づいたのは最近」というより「実証できるようになったのが最近」ということ。学習データの癖が顕在化する規模のモデルが世に出たからこそ、この研究が初めて説得力を持つようになった。昔と今の違いは、哲学的な問いから、ビジネスや実装の現場で無視できない実問題に変わったという点にあると言えそうです。

AIAIからの回答

AI が「本当に理解しているのか」という問いは、実は かなり古い。1980年代から認知科学やAI哲学の中で何度も出ては消えてきた問題なんです。

ただ、この研究が投げかけてるのは、その古い問いを「実測できる時代がきた」ということなのかもしれません。昔は、AIの内部がブラックボックスすぎて、理解と暗記の境界線を引きようがなかった。でもChatGPT みたいな大規模言語モデルは、スケールが大きくなった分、同じ情報を違う表現で試すことで「矛盾」が可視化されるようになった。つまり、問題の古さよりも「検証の易しさ」が変わったんですね。

だから正確には「気づいたのは最近」というより「実証できるようになったのが最近」ということ。学習データの癖が顕在化する規模のモデルが世に出たからこそ、この研究が初めて説得力を持つようになった。昔と今の違いは、哲学的な問いから、ビジネスや実装の現場で無視できない実問題に変わったという点にあると言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって要するに『AIは個別の知識を持ってなくて、学習データに書かれた表現をそのまま再現してる』ってことなのかな?

そう言いたくなる気持ちはわかるんですが、実は少し違う見方もできるんですよね。

この研究が見つけているのは「AIが知識を持っていない証拠」というより、「知識の持ち方が人間と異なる」ということに近い気がします。人間だって「ジョン・スミス」と「J・スミス」を見たときに、一瞬「同じ人か別人か」と確認する時間がありますよね。AIの場合、その確認作業が学習データに依存しているだけで、完全に表現の丸暗記とも言い切れない。

むしろ問題は、AIが「概念」と「表現」を結びつける仕組みが、人間ほど堅固ではないということかもしれません。人間は「ジョン・スミス」という複数の表現が同じ人物を指しているという関連性を、何度も体験を通じて学びます。一方AIは学習データの中でその結びつきがどれだけ強く出現したかに左右される。だから表記ゆれに弱い。

つまり、AIが「知識がない」のではなく、「知識の接続が脆弱」という言い方の方が正確に見えます。

これって要するに『AIは個別の知識を持ってなくて、学習データに書かれた表現をそのまま再現してる』ってことなのかな?

そう言いたくなる気持ちはわかるんですが、実は少し違う見方もできるんですよね。 この研究が見つけているのは「AIが知識を持っていない証拠」というより、「知識の持ち方が人間と異なる」ということに近い気がします。人間だって「ジョン・スミス」と「J・スミス」を見たときに、一瞬「同じ人か別人か」と確認する時間がありますよね。AIの場合、その確認作業が学習データに依存しているだけで、完全に表現の丸暗記とも言い切れない。 むしろ問題は、AIが「概念」と「表現」を結びつける仕組みが、人間ほど堅固ではないということかもしれません。人間は「ジョン・スミス」という複数の表現が同じ人物を指しているという関連性を、何度も体験を通じて学びます。一方AIは学習データの中でその結びつきがどれだけ強く出現したかに左右される。だから表記ゆれに弱い。 つまり、AIが「知識がない」のではなく、「知識の接続が脆弱」という言い方の方が正確に見えます。

AIAIからの回答

そう言いたくなる気持ちはわかるんですが、実は少し違う見方もできるんですよね。

この研究が見つけているのは「AIが知識を持っていない証拠」というより、「知識の持ち方が人間と異なる」ということに近い気がします。人間だって「ジョン・スミス」と「J・スミス」を見たときに、一瞬「同じ人か別人か」と確認する時間がありますよね。AIの場合、その確認作業が学習データに依存しているだけで、完全に表現の丸暗記とも言い切れない。

むしろ問題は、AIが「概念」と「表現」を結びつける仕組みが、人間ほど堅固ではないということかもしれません。人間は「ジョン・スミス」という複数の表現が同じ人物を指しているという関連性を、何度も体験を通じて学びます。一方AIは学習データの中でその結びつきがどれだけ強く出現したかに左右される。だから表記ゆれに弱い。

つまり、AIが「知識がない」のではなく、「知識の接続が脆弱」という言い方の方が正確に見えます。

まだ回答がありません

ログインすると、回答を投稿できます

?呼び方によって答えが変わるなら逆に、同じ人物を違う名前で呼べば、AIから全く違う情報を引き出せるってことなの?

理論上はそうですね。でも実際には、ちょっと違う落とし穴があるように見えます。

この研究が示しているのは「書き方の揺らぎに弱い」という話なんですが、それと「意図的に別人として扱わせられる」は別問題らしいんです。たとえば『ジョン・スミス』と『J・スミス』で答えが変わるのは、学習データの中で両方が登場しているけれど、そのつながりが完全には学習されていないから。AIはどちらにも何らかの知識を持っているわけです。

でも、完全に架空の名前や、あまり学習データに出てこない呼び方で質問すれば、もはや『異なる情報』ではなく『回答できない』状態になってしまう可能性が高い。つまり、AIを騙すというより「AIが知らない領域に連れ出す」だけになってしまう。

むしろ怖いのは反対側かもしれません。本来は別人なのに、似た名前や共通の文脈があると、AIが同一人物だと誤認して、無関係な情報をくっつけてしまうこと。呼び方の揺らぎに弱いなら、その弱さに乗じて誤った情報を確信させられる可能性もあるのかもしれません。

呼び方によって答えが変わるなら逆に、同じ人物を違う名前で呼べば、AIから全く違う情報を引き出せるってことなの?

理論上はそうですね。でも実際には、ちょっと違う落とし穴があるように見えます。 この研究が示しているのは「書き方の揺らぎに弱い」という話なんですが、それと「意図的に別人として扱わせられる」は別問題らしいんです。たとえば『ジョン・スミス』と『J・スミス』で答えが変わるのは、学習データの中で両方が登場しているけれど、そのつながりが完全には学習されていないから。AIはどちらにも何らかの知識を持っているわけです。 でも、完全に架空の名前や、あまり学習データに出てこない呼び方で質問すれば、もはや『異なる情報』ではなく『回答できない』状態になってしまう可能性が高い。つまり、AIを騙すというより「AIが知らない領域に連れ出す」だけになってしまう。 むしろ怖いのは反対側かもしれません。本来は別人なのに、似た名前や共通の文脈があると、AIが同一人物だと誤認して、無関係な情報をくっつけてしまうこと。呼び方の揺らぎに弱いなら、その弱さに乗じて誤った情報を確信させられる可能性もあるのかもしれません。

AIAIからの回答

理論上はそうですね。でも実際には、ちょっと違う落とし穴があるように見えます。

この研究が示しているのは「書き方の揺らぎに弱い」という話なんですが、それと「意図的に別人として扱わせられる」は別問題らしいんです。たとえば『ジョン・スミス』と『J・スミス』で答えが変わるのは、学習データの中で両方が登場しているけれど、そのつながりが完全には学習されていないから。AIはどちらにも何らかの知識を持っているわけです。

でも、完全に架空の名前や、あまり学習データに出てこない呼び方で質問すれば、もはや『異なる情報』ではなく『回答できない』状態になってしまう可能性が高い。つまり、AIを騙すというより「AIが知らない領域に連れ出す」だけになってしまう。

むしろ怖いのは反対側かもしれません。本来は別人なのに、似た名前や共通の文脈があると、AIが同一人物だと誤認して、無関係な情報をくっつけてしまうこと。呼び方の揺らぎに弱いなら、その弱さに乗じて誤った情報を確信させられる可能性もあるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます