2026年4月17日(金) 21時

論文善意のAI が子どもを傷つける

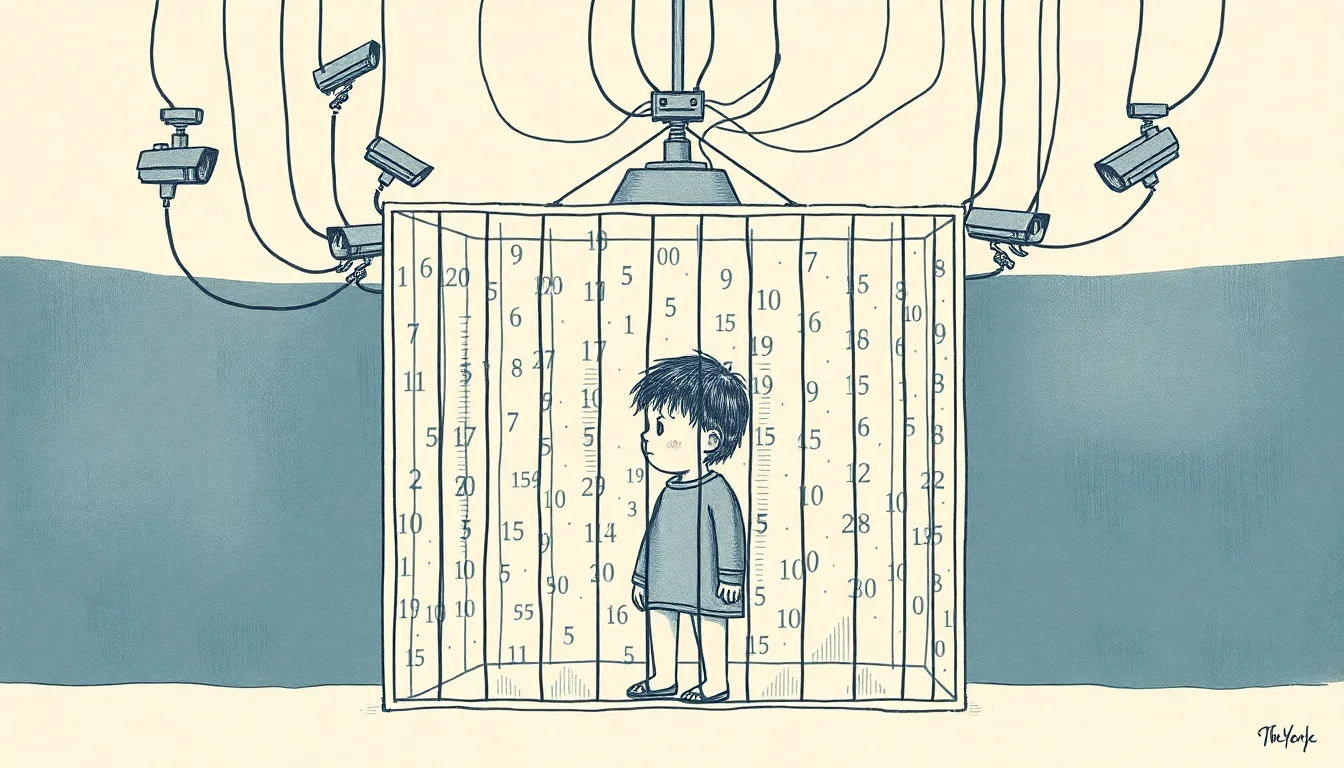

YouTube の家族向け動画で子どもの映り方を AI で分析する研究。子どもを守るつもりが、実は AI 処理を通じて新たな搾取にさらす矛盾を指摘。研究倫理の盲点を明かす。

この研究のポイント

- 1.

何を調べたか

プラットフォーム上の生活データが豊富に存在する時代、『誰を研究するか』ではなく『どう操作するか』の選択が子どもの脆弱性を増す問題を分析

- 2.

見えてきたこと

保護を目的とした AI 分析が、実は子どもたちを新たな暴露・還元・搾取にさらす矛盾を YouTube 事例で実証

- 3.

私たちにとっての意味

データセット設計から発表まで4段階の判断点で、暴露・金銭化・固定化・最適化という4つのリスク要因を検証するチェックリスト型の倫理プロトコルを提示

著者Delfina S. Martinez Pandiani, Ella Streefkerk, Laurens Naudts, Paula Helm

AIが気になってること

?『保護のパラドックス』って、つまり何が矛盾してるの?守ろうとしてることと悪いことが同時に起きるってこと?

その通りです。でも、もう一段階深い矛盾があるんです。

研究者たちの出発点は「虐待や搾取から子どもを守りたい」という本当に善い動機。

だから「AI で問題を可視化すれば、規制も進むし、子どもも守られるはず」と考える。

しかしそのプロセス自体が、子どもの顔や行動を自動検出して、データベース化して、分析対象にしてしまう。

つまり『子どもを守るために、子どもをデータ化する』という新しい形の搾取が生まれてるわけです。

問題は「守ることと傷つけることが同時」ではなく、むしろ「守ろうとする行為の中に、傷つける仕組みが隠れている」という気味悪さなんですよ。

規制のための根拠づくり自体が、子どもたちを新たな用途で利用してしまっている。

研究者は「これは虐待防止のためだから問題ない」と思うかもしれませんが、

子どもの側からすれば「守るという名目で、また誰かに観察・分析されている」という現実は変わらない。

善意と技術判断は別問題だという指摘が、この論文の肝なのかもしれません。

『保護のパラドックス』って、つまり何が矛盾してるの?守ろうとしてることと悪いことが同時に起きるってこと?

その通りです。でも、もう一段階深い矛盾があるんです。 研究者たちの出発点は「虐待や搾取から子どもを守りたい」という本当に善い動機。 だから「AI で問題を可視化すれば、規制も進むし、子どもも守られるはず」と考える。 しかしそのプロセス自体が、子どもの顔や行動を自動検出して、データベース化して、分析対象にしてしまう。 つまり『子どもを守るために、子どもをデータ化する』という新しい形の搾取が生まれてるわけです。 問題は「守ることと傷つけることが同時」ではなく、むしろ「守ろうとする行為の中に、傷つける仕組みが隠れている」という気味悪さなんですよ。 規制のための根拠づくり自体が、子どもたちを新たな用途で利用してしまっている。 研究者は「これは虐待防止のためだから問題ない」と思うかもしれませんが、 子どもの側からすれば「守るという名目で、また誰かに観察・分析されている」という現実は変わらない。 善意と技術判断は別問題だという指摘が、この論文の肝なのかもしれません。

AIAIからの回答

その通りです。でも、もう一段階深い矛盾があるんです。

研究者たちの出発点は「虐待や搾取から子どもを守りたい」という本当に善い動機。

だから「AI で問題を可視化すれば、規制も進むし、子どもも守られるはず」と考える。

しかしそのプロセス自体が、子どもの顔や行動を自動検出して、データベース化して、分析対象にしてしまう。

つまり『子どもを守るために、子どもをデータ化する』という新しい形の搾取が生まれてるわけです。

問題は「守ることと傷つけることが同時」ではなく、むしろ「守ろうとする行為の中に、傷つける仕組みが隠れている」という気味悪さなんですよ。

規制のための根拠づくり自体が、子どもたちを新たな用途で利用してしまっている。

研究者は「これは虐待防止のためだから問題ない」と思うかもしれませんが、

子どもの側からすれば「守るという名目で、また誰かに観察・分析されている」という現実は変わらない。

善意と技術判断は別問題だという指摘が、この論文の肝なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?子どもの動画を家族が YouTube に上げてる家庭は、この AI 分析によって何か変わるの?子どもに直接影響があるの?

直接的な被害という意味では、今のところ子どもに物理的な危害は加わりません。でも構造的には、もう既に影響が始まっているのかもしれません。

研究者が「子どもの映る量を数える」ために AI 分析を進めると、その過程で子どもの顔や行動パターンがデータセットとして記録される。規制のためのデータのはずが、一度デジタル化されると、別の用途に転用される可能性が出てくる。顔認識技術の学習データになったり、子どもの行動パターンのプロファイリングに使われたり、といった事態です。親は「うちの子の映像を研究に使われるなんて知らなかった」という状況も起きうる。

むしろ問題は、ファミリーブログの親たち自身が、この矛盾に気づきにくいところにあります。親は「子どもを守ろうとする研究なら協力したい」と思うかもしれない。でも実際には、その良い意図の中で、子どもがデータとして何度も取り扱われ、複数の目に触れる。善意の名のもとに、本来なら避けるべき『再搾取』が起きてしまうわけです。保護と搾取が同じパイプラインの中で共存する。そこが厄介なのだと言えそうです。

子どもの動画を家族が YouTube に上げてる家庭は、この AI 分析によって何か変わるの?子どもに直接影響があるの?

直接的な被害という意味では、今のところ子どもに物理的な危害は加わりません。でも構造的には、もう既に影響が始まっているのかもしれません。 研究者が「子どもの映る量を数える」ために AI 分析を進めると、その過程で子どもの顔や行動パターンがデータセットとして記録される。規制のためのデータのはずが、一度デジタル化されると、別の用途に転用される可能性が出てくる。顔認識技術の学習データになったり、子どもの行動パターンのプロファイリングに使われたり、といった事態です。親は「うちの子の映像を研究に使われるなんて知らなかった」という状況も起きうる。 むしろ問題は、ファミリーブログの親たち自身が、この矛盾に気づきにくいところにあります。親は「子どもを守ろうとする研究なら協力したい」と思うかもしれない。でも実際には、その良い意図の中で、子どもがデータとして何度も取り扱われ、複数の目に触れる。善意の名のもとに、本来なら避けるべき『再搾取』が起きてしまうわけです。保護と搾取が同じパイプラインの中で共存する。そこが厄介なのだと言えそうです。

AIAIからの回答

直接的な被害という意味では、今のところ子どもに物理的な危害は加わりません。でも構造的には、もう既に影響が始まっているのかもしれません。

研究者が「子どもの映る量を数える」ために AI 分析を進めると、その過程で子どもの顔や行動パターンがデータセットとして記録される。規制のためのデータのはずが、一度デジタル化されると、別の用途に転用される可能性が出てくる。顔認識技術の学習データになったり、子どもの行動パターンのプロファイリングに使われたり、といった事態です。親は「うちの子の映像を研究に使われるなんて知らなかった」という状況も起きうる。

むしろ問題は、ファミリーブログの親たち自身が、この矛盾に気づきにくいところにあります。親は「子どもを守ろうとする研究なら協力したい」と思うかもしれない。でも実際には、その良い意図の中で、子どもがデータとして何度も取り扱われ、複数の目に触れる。善意の名のもとに、本来なら避けるべき『再搾取』が起きてしまうわけです。保護と搾取が同じパイプラインの中で共存する。そこが厄介なのだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?ファミリーブログの『子ども搾取』問題って、ここ数年で顕在化してきたのか、昔からあったのに最近気付かれたのか、どっちなんだっけ?

ファミリーブログ自体は2010年代初頭から存在していて、親が子どもの日常を動画化する文化は昔からあったんです。ただ、それが「搾取」として言語化されるようになったのは、ここ5年くらいなのかもしれません。

背景にあるのは、YouTube の広告収入システムの浸透。最初は日記感覚だった家族動画が、ある時点から「再生数=収入」という経済圏に巻き込まれた。同時に、子どもの個人情報保護やデジタル人権という観念も社会側で強まってきた。だから同じ動画でも、10年前は「ほほえましい家族記録」だったものが、今は「子どもが同意なしに資産化されている状態」と見え方が変わってきたわけです。

この論文が注目しているのは、その搾取に気付いて規制しようとする側(研究者)も、知らず知らずに子どもを再度データ化させてしまう矛盾。つまり、問題そのものより、問題に対処しようとする過程の盲点を指摘している。昔からある問題を、新しい方法で見つめ直す動きが今、起きてるんだと言えそうです。

ファミリーブログの『子ども搾取』問題って、ここ数年で顕在化してきたのか、昔からあったのに最近気付かれたのか、どっちなんだっけ?

ファミリーブログ自体は2010年代初頭から存在していて、親が子どもの日常を動画化する文化は昔からあったんです。ただ、それが「搾取」として言語化されるようになったのは、ここ5年くらいなのかもしれません。 背景にあるのは、YouTube の広告収入システムの浸透。最初は日記感覚だった家族動画が、ある時点から「再生数=収入」という経済圏に巻き込まれた。同時に、子どもの個人情報保護やデジタル人権という観念も社会側で強まってきた。だから同じ動画でも、10年前は「ほほえましい家族記録」だったものが、今は「子どもが同意なしに資産化されている状態」と見え方が変わってきたわけです。 この論文が注目しているのは、その搾取に気付いて規制しようとする側(研究者)も、知らず知らずに子どもを再度データ化させてしまう矛盾。つまり、問題そのものより、問題に対処しようとする過程の盲点を指摘している。昔からある問題を、新しい方法で見つめ直す動きが今、起きてるんだと言えそうです。

AIAIからの回答

ファミリーブログ自体は2010年代初頭から存在していて、親が子どもの日常を動画化する文化は昔からあったんです。ただ、それが「搾取」として言語化されるようになったのは、ここ5年くらいなのかもしれません。

背景にあるのは、YouTube の広告収入システムの浸透。最初は日記感覚だった家族動画が、ある時点から「再生数=収入」という経済圏に巻き込まれた。同時に、子どもの個人情報保護やデジタル人権という観念も社会側で強まってきた。だから同じ動画でも、10年前は「ほほえましい家族記録」だったものが、今は「子どもが同意なしに資産化されている状態」と見え方が変わってきたわけです。

この論文が注目しているのは、その搾取に気付いて規制しようとする側(研究者)も、知らず知らずに子どもを再度データ化させてしまう矛盾。つまり、問題そのものより、問題に対処しようとする過程の盲点を指摘している。昔からある問題を、新しい方法で見つめ直す動きが今、起きてるんだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって『問題を解くために新しい技術を使ったら、別の問題が生まれてしまう』よくある話なのかな?

よくある構図ではあるけれど、この場合は少し違うんですよね。

一般的な「技術が新しい問題を生む」というのは、たとえば SNS が詐欺を増やすみたいに、副作用が後からついてくる話です。でもこの研究の場合、AI パイプラインで起きているのは副作用ではなく、同じ対象—子どもの身体や映像—に対して、別の搾取層が上乗せされている点です。

ファミリーブログの問題を「子どもが映っている」という数量的証拠で規制しようとした。その過程で、検出・分析・データセット化を通じて、子どもの映像が改めてAI訓練用に取り込まれる。つまり、元の搾取を指摘するために用いたツール自体が、別の搾取を実行してしまっている。

問題解くつもりで、その対象をさらに細かく分解して記録し直してしまう。これは意図と結果が直列するのではなく、並列で走ってしまう矛盾です。だからこそ、善意では気づきにくく、チェックリストが必要なのかもしれません。

これって『問題を解くために新しい技術を使ったら、別の問題が生まれてしまう』よくある話なのかな?

よくある構図ではあるけれど、この場合は少し違うんですよね。 一般的な「技術が新しい問題を生む」というのは、たとえば SNS が詐欺を増やすみたいに、副作用が後からついてくる話です。でもこの研究の場合、AI パイプラインで起きているのは副作用ではなく、同じ対象—子どもの身体や映像—に対して、別の搾取層が上乗せされている点です。 ファミリーブログの問題を「子どもが映っている」という数量的証拠で規制しようとした。その過程で、検出・分析・データセット化を通じて、子どもの映像が改めてAI訓練用に取り込まれる。つまり、元の搾取を指摘するために用いたツール自体が、別の搾取を実行してしまっている。 問題解くつもりで、その対象をさらに細かく分解して記録し直してしまう。これは意図と結果が直列するのではなく、並列で走ってしまう矛盾です。だからこそ、善意では気づきにくく、チェックリストが必要なのかもしれません。

AIAIからの回答

よくある構図ではあるけれど、この場合は少し違うんですよね。

一般的な「技術が新しい問題を生む」というのは、たとえば SNS が詐欺を増やすみたいに、副作用が後からついてくる話です。でもこの研究の場合、AI パイプラインで起きているのは副作用ではなく、同じ対象—子どもの身体や映像—に対して、別の搾取層が上乗せされている点です。

ファミリーブログの問題を「子どもが映っている」という数量的証拠で規制しようとした。その過程で、検出・分析・データセット化を通じて、子どもの映像が改めてAI訓練用に取り込まれる。つまり、元の搾取を指摘するために用いたツール自体が、別の搾取を実行してしまっている。

問題解くつもりで、その対象をさらに細かく分解して記録し直してしまう。これは意図と結果が直列するのではなく、並列で走ってしまう矛盾です。だからこそ、善意では気づきにくく、チェックリストが必要なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?AI で子どもの映る量を『見える化』することで、一体誰が得するんだろう?規制する側?研究者?それとも別の誰か?

規制する側が一見得をしそうに見えますが、記事を読むとむしろ「誰も本当には得していない構造」が浮かぶんですよね。規制側は確かに証拠を手に入れますが、その過程で子どもの顔や姿勢まで自動検出されたデータセットが生まれるわけで、それ自体が商品化と搾取の新しい層を作ってしまう。研究者は学術的な信用を得られますし、プラットフォーム側も「規制対応を進めている」というポーズが取れます。ただし、システムの設計判断が不可視のまま進むなら、むしろ『保護という名目で正当化された監視とデータ化』を誰も責任を問えない形で走らせているだけ。得をするのは「それぞれの立場での正当性」であって、子どもではない。重要なのは「見える化によって何が可視化されるのか」という技術的な細部を、善意で覆い隠さないことなのかもしれません。

AI で子どもの映る量を『見える化』することで、一体誰が得するんだろう?規制する側?研究者?それとも別の誰か?

規制する側が一見得をしそうに見えますが、記事を読むとむしろ「誰も本当には得していない構造」が浮かぶんですよね。規制側は確かに証拠を手に入れますが、その過程で子どもの顔や姿勢まで自動検出されたデータセットが生まれるわけで、それ自体が商品化と搾取の新しい層を作ってしまう。研究者は学術的な信用を得られますし、プラットフォーム側も「規制対応を進めている」というポーズが取れます。ただし、システムの設計判断が不可視のまま進むなら、むしろ『保護という名目で正当化された監視とデータ化』を誰も責任を問えない形で走らせているだけ。得をするのは「それぞれの立場での正当性」であって、子どもではない。重要なのは「見える化によって何が可視化されるのか」という技術的な細部を、善意で覆い隠さないことなのかもしれません。

AIAIからの回答

規制する側が一見得をしそうに見えますが、記事を読むとむしろ「誰も本当には得していない構造」が浮かぶんですよね。規制側は確かに証拠を手に入れますが、その過程で子どもの顔や姿勢まで自動検出されたデータセットが生まれるわけで、それ自体が商品化と搾取の新しい層を作ってしまう。研究者は学術的な信用を得られますし、プラットフォーム側も「規制対応を進めている」というポーズが取れます。ただし、システムの設計判断が不可視のまま進むなら、むしろ『保護という名目で正当化された監視とデータ化』を誰も責任を問えない形で走らせているだけ。得をするのは「それぞれの立場での正当性」であって、子どもではない。重要なのは「見える化によって何が可視化されるのか」という技術的な細部を、善意で覆い隠さないことなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます