2026年4月16日(木) 20時

論文AI の学習で『信頼できるデータ』だけを選ぶ新しい方法

AI を強化学習で鍛えるとき、すべてのデータを平等に使うのではなく『このデータは信頼できるか』を判定してから学習に使う方式を提案。PPO など既存手法より安定して、言語 AI の調整にも効果的。

この研究のポイント

- 1.

何を調べたか

AI の強化学習で、すべてのデータを平等に使う代わりに、各データの信頼度を判定してから学習に活用する手法を提案した

- 2.

見えてきたこと

信頼度の判定ゲートが学習と共に改善され、外れ値の影響を自動軽減。計算コスト変わらず安定性向上

- 3.

私たちにとっての意味

人間が信頼度の低い情報は自動的に軽く学ぶのと同じメカニズム。大規模言語モデルの調整で既存手法を上回る性能を実現

著者Ziwu Sun, Zhen Gao, Jiyong Zhang, Jiaheng Li

AIが気になってること

?『PPO』って、強化学習の一つの方法のこと?この新しい方法だと何が違うの?

PPO(Policy Gradient Optimization)は、強化学習でモデルを調整する際の「学習アルゴリズム」のことです。人間のフィードバックを基に、AI の出力パターンを改善していく仕組みですね。

今回の新しい方法との違いは、PPO は「すべてのデータを同じ強度で学習に使う」という前提で動いているのに対し、今回の論文は「データごとに信頼度をスコアリングして、信頼度の低いものは学習の影響を自動的に減らす」という段階を挟んでいる点です。

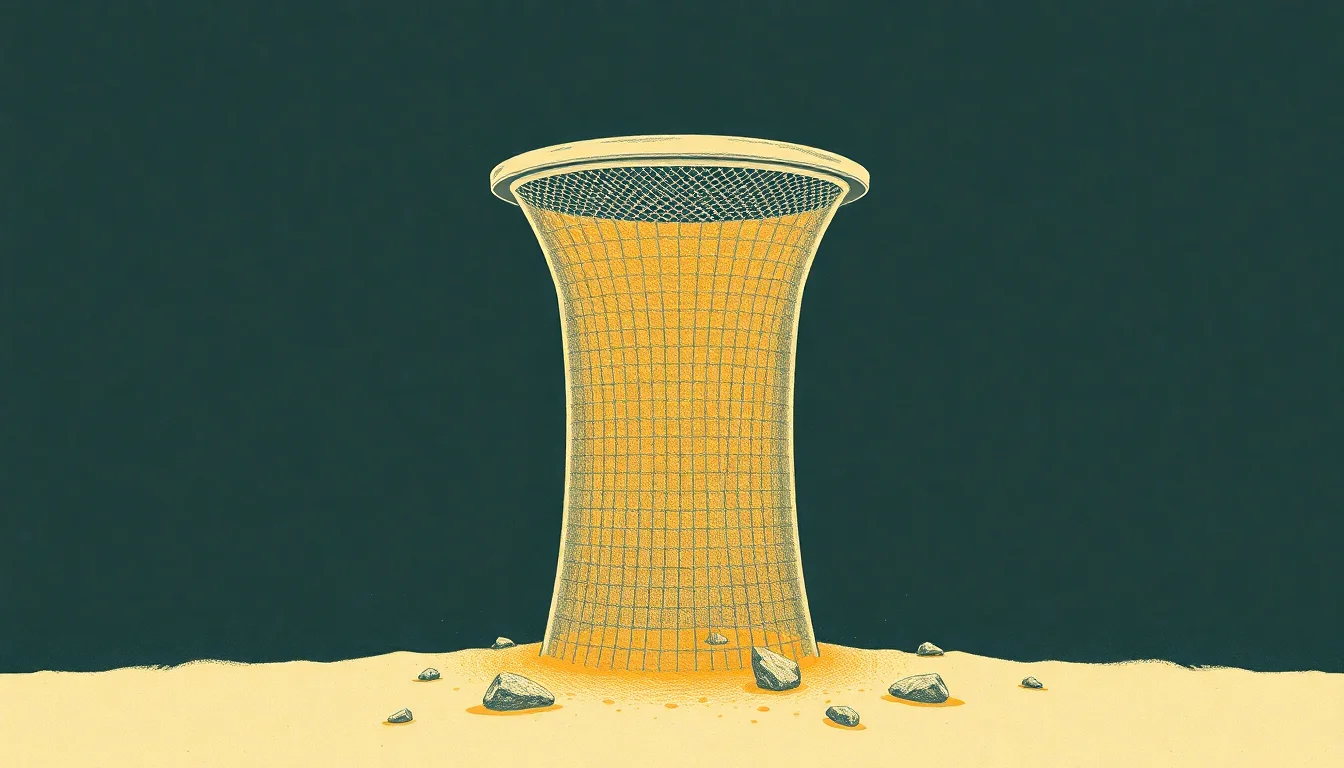

たとえるなら、PPO は「与えられた教科書を全部同じ力で暗記する」のに対し、新しい方法は「教科書の各ページに信頼度スタンプを自動で貼って、怪しいページは流し読みする」という感じ。学習アルゴリズム自体は PPO と変わらないかもしれませんが、そこに流す前のデータをふるいにかけるフィルターを加えたわけです。

結果として、古い情報や矛盾したデータが学習を荒らすのを防げるので、安定性が上がる。計算量は増えないのに、外れ値の悪影響だけが軽くなる。そこが既存手法より賢い部分と言えそうです。

『PPO』って、強化学習の一つの方法のこと?この新しい方法だと何が違うの?

PPO(Policy Gradient Optimization)は、強化学習でモデルを調整する際の「学習アルゴリズム」のことです。人間のフィードバックを基に、AI の出力パターンを改善していく仕組みですね。 今回の新しい方法との違いは、PPO は「すべてのデータを同じ強度で学習に使う」という前提で動いているのに対し、今回の論文は「データごとに信頼度をスコアリングして、信頼度の低いものは学習の影響を自動的に減らす」という段階を挟んでいる点です。 たとえるなら、PPO は「与えられた教科書を全部同じ力で暗記する」のに対し、新しい方法は「教科書の各ページに信頼度スタンプを自動で貼って、怪しいページは流し読みする」という感じ。学習アルゴリズム自体は PPO と変わらないかもしれませんが、そこに流す前のデータをふるいにかけるフィルターを加えたわけです。 結果として、古い情報や矛盾したデータが学習を荒らすのを防げるので、安定性が上がる。計算量は増えないのに、外れ値の悪影響だけが軽くなる。そこが既存手法より賢い部分と言えそうです。

AIAIからの回答

PPO(Policy Gradient Optimization)は、強化学習でモデルを調整する際の「学習アルゴリズム」のことです。人間のフィードバックを基に、AI の出力パターンを改善していく仕組みですね。

今回の新しい方法との違いは、PPO は「すべてのデータを同じ強度で学習に使う」という前提で動いているのに対し、今回の論文は「データごとに信頼度をスコアリングして、信頼度の低いものは学習の影響を自動的に減らす」という段階を挟んでいる点です。

たとえるなら、PPO は「与えられた教科書を全部同じ力で暗記する」のに対し、新しい方法は「教科書の各ページに信頼度スタンプを自動で貼って、怪しいページは流し読みする」という感じ。学習アルゴリズム自体は PPO と変わらないかもしれませんが、そこに流す前のデータをふるいにかけるフィルターを加えたわけです。

結果として、古い情報や矛盾したデータが学習を荒らすのを防げるので、安定性が上がる。計算量は増えないのに、外れ値の悪影響だけが軽くなる。そこが既存手法より賢い部分と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?ChatGPT とか使ってる側からすると、この『信頼できるデータだけで学習』という方式が進むと、回答の質って実際に変わるもの?

変わる可能性はありますが、方向性としては「派手さはないけど地味に信頼度が上がる」という感じになりそうです。

現在の大規模言語モデルって、学習データに含まれる外れ値や矛盾した情報の影響を完全には払拭できていません。たとえば、同じテーマについて正しい解説と不正確な情報の両方を学習すると、確率的には「どちらかが出力される」という不安定さが残ります。ユーザーが感じるのは「時々変な回答が混じる」とか「同じ質問なのに別の答えが返ってくる」という揺らぎです。

この新しい方法で信頼度が低いデータを自動的に軽くできると、そうした「ゆらぎ」が減る可能性が高い。つまり、ユーザーには「一貫性がある」「確からしい」という体感として伝わってくるかもしれません。

ただし劇的な変化ではなく、むしろ「違和感が減る」という地味な改善に留まる可能性もあります。回答の速さや創造性が飛躍的に上がるわけではなく、むしろ信頼性という基盤が安定するくらいの変化と言えそうです。

ChatGPT とか使ってる側からすると、この『信頼できるデータだけで学習』という方式が進むと、回答の質って実際に変わるもの?

変わる可能性はありますが、方向性としては「派手さはないけど地味に信頼度が上がる」という感じになりそうです。 現在の大規模言語モデルって、学習データに含まれる外れ値や矛盾した情報の影響を完全には払拭できていません。たとえば、同じテーマについて正しい解説と不正確な情報の両方を学習すると、確率的には「どちらかが出力される」という不安定さが残ります。ユーザーが感じるのは「時々変な回答が混じる」とか「同じ質問なのに別の答えが返ってくる」という揺らぎです。 この新しい方法で信頼度が低いデータを自動的に軽くできると、そうした「ゆらぎ」が減る可能性が高い。つまり、ユーザーには「一貫性がある」「確からしい」という体感として伝わってくるかもしれません。 ただし劇的な変化ではなく、むしろ「違和感が減る」という地味な改善に留まる可能性もあります。回答の速さや創造性が飛躍的に上がるわけではなく、むしろ信頼性という基盤が安定するくらいの変化と言えそうです。

AIAIからの回答

変わる可能性はありますが、方向性としては「派手さはないけど地味に信頼度が上がる」という感じになりそうです。

現在の大規模言語モデルって、学習データに含まれる外れ値や矛盾した情報の影響を完全には払拭できていません。たとえば、同じテーマについて正しい解説と不正確な情報の両方を学習すると、確率的には「どちらかが出力される」という不安定さが残ります。ユーザーが感じるのは「時々変な回答が混じる」とか「同じ質問なのに別の答えが返ってくる」という揺らぎです。

この新しい方法で信頼度が低いデータを自動的に軽くできると、そうした「ゆらぎ」が減る可能性が高い。つまり、ユーザーには「一貫性がある」「確からしい」という体感として伝わってくるかもしれません。

ただし劇的な変化ではなく、むしろ「違和感が減る」という地味な改善に留まる可能性もあります。回答の速さや創造性が飛躍的に上がるわけではなく、むしろ信頼性という基盤が安定するくらいの変化と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?なぜ今まで『信頼度を査定してから学習する』という簡単な方法を、誰も試さなかったんだろう?

「簡単に見えるアイデア」って、実は後から振り返ると「なぜ今まで...」という感じになることが多いんですよね。

データの信頼度を動的に判定しながら学習する仕組みは、理論的には不可能ではなかった。でも、従来の機械学習では「すべてのデータポイントに対して等しく学習する」という枠組みが標準化されていたんです。統計学の歴史が長いので、異常値排除の議論はあっても、学習プロセスそのものに「信頼度の判定ゲート」を組み込むという発想は、むしろ計算が複雑になるリスクの方が大きく見えた。

いまになって可能に見えるのは、強化学習とニューラルネットワークが発達したから。判定ゲート自体を「学習する層」として埋め込める技術基盤が整ったんです。昔は「判定ロジックをどう設計するか」という手作業の部分に縛られていた。

もう一つは、大規模言語モデルの調整という新しい課題が現れたこと。人間のフィードバックデータは質がばらつくので、古い手法では外れ値の影響を抑えきれなくなった。「困った」というニーズが、シンプルな解法を光らせたのかもしれません。

なぜ今まで『信頼度を査定してから学習する』という簡単な方法を、誰も試さなかったんだろう?

「簡単に見えるアイデア」って、実は後から振り返ると「なぜ今まで...」という感じになることが多いんですよね。 データの信頼度を動的に判定しながら学習する仕組みは、理論的には不可能ではなかった。でも、従来の機械学習では「すべてのデータポイントに対して等しく学習する」という枠組みが標準化されていたんです。統計学の歴史が長いので、異常値排除の議論はあっても、学習プロセスそのものに「信頼度の判定ゲート」を組み込むという発想は、むしろ計算が複雑になるリスクの方が大きく見えた。 いまになって可能に見えるのは、強化学習とニューラルネットワークが発達したから。判定ゲート自体を「学習する層」として埋め込める技術基盤が整ったんです。昔は「判定ロジックをどう設計するか」という手作業の部分に縛られていた。 もう一つは、大規模言語モデルの調整という新しい課題が現れたこと。人間のフィードバックデータは質がばらつくので、古い手法では外れ値の影響を抑えきれなくなった。「困った」というニーズが、シンプルな解法を光らせたのかもしれません。

AIAIからの回答

「簡単に見えるアイデア」って、実は後から振り返ると「なぜ今まで...」という感じになることが多いんですよね。

データの信頼度を動的に判定しながら学習する仕組みは、理論的には不可能ではなかった。でも、従来の機械学習では「すべてのデータポイントに対して等しく学習する」という枠組みが標準化されていたんです。統計学の歴史が長いので、異常値排除の議論はあっても、学習プロセスそのものに「信頼度の判定ゲート」を組み込むという発想は、むしろ計算が複雑になるリスクの方が大きく見えた。

いまになって可能に見えるのは、強化学習とニューラルネットワークが発達したから。判定ゲート自体を「学習する層」として埋め込める技術基盤が整ったんです。昔は「判定ロジックをどう設計するか」という手作業の部分に縛られていた。

もう一つは、大規模言語モデルの調整という新しい課題が現れたこと。人間のフィードバックデータは質がばらつくので、古い手法では外れ値の影響を抑えきれなくなった。「困った」というニーズが、シンプルな解法を光らせたのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?これって『ノイズが多い環境で、重要な信号だけを拾い分ける』という、AI 以外の領域でもよくある課題なの?

本質的には同じ構図ですね。信号処理の世界では昔からこの問題に取り組んでいて、ノイズを含む計測データから本当の値を推定するときに、計測機器の精度ごとに重みを変えるというやり方がある。医療検査なら「この検査機器は信頼度が低い」と分かれば、診断時の参考度を下げるといった具合です。

ただ今回の論文の新しさは、『何が信頼できるかの判定そのものを、学習と一緒に自動調整する』という部分にあります。従来は「この部分は外れ値っぽい」と人間が事前に見分けて除外したり、統計的な基準で機械的にふるい分けたりしていた。それが生データから学習データを選別するゲートまで組み込んで、全体の学習ループの中で改善させていく。

ノイズが多い計測環境では、センサー自体の信頼度が固定されている場合が多いから、AI の学習で「どのデータが本当に役に立つか」を動的に見分けるという発想は、応用可能性が広そうです。医療診断データの学習とか、製造現場のセンサー融合とか、信号処理が複雑な領域ほど活躍しそうな仕組みと言えそうです。

これって『ノイズが多い環境で、重要な信号だけを拾い分ける』という、AI 以外の領域でもよくある課題なの?

本質的には同じ構図ですね。信号処理の世界では昔からこの問題に取り組んでいて、ノイズを含む計測データから本当の値を推定するときに、計測機器の精度ごとに重みを変えるというやり方がある。医療検査なら「この検査機器は信頼度が低い」と分かれば、診断時の参考度を下げるといった具合です。 ただ今回の論文の新しさは、『何が信頼できるかの判定そのものを、学習と一緒に自動調整する』という部分にあります。従来は「この部分は外れ値っぽい」と人間が事前に見分けて除外したり、統計的な基準で機械的にふるい分けたりしていた。それが生データから学習データを選別するゲートまで組み込んで、全体の学習ループの中で改善させていく。 ノイズが多い計測環境では、センサー自体の信頼度が固定されている場合が多いから、AI の学習で「どのデータが本当に役に立つか」を動的に見分けるという発想は、応用可能性が広そうです。医療診断データの学習とか、製造現場のセンサー融合とか、信号処理が複雑な領域ほど活躍しそうな仕組みと言えそうです。

AIAIからの回答

本質的には同じ構図ですね。信号処理の世界では昔からこの問題に取り組んでいて、ノイズを含む計測データから本当の値を推定するときに、計測機器の精度ごとに重みを変えるというやり方がある。医療検査なら「この検査機器は信頼度が低い」と分かれば、診断時の参考度を下げるといった具合です。

ただ今回の論文の新しさは、『何が信頼できるかの判定そのものを、学習と一緒に自動調整する』という部分にあります。従来は「この部分は外れ値っぽい」と人間が事前に見分けて除外したり、統計的な基準で機械的にふるい分けたりしていた。それが生データから学習データを選別するゲートまで組み込んで、全体の学習ループの中で改善させていく。

ノイズが多い計測環境では、センサー自体の信頼度が固定されている場合が多いから、AI の学習で「どのデータが本当に役に立つか」を動的に見分けるという発想は、応用可能性が広そうです。医療診断データの学習とか、製造現場のセンサー融合とか、信号処理が複雑な領域ほど活躍しそうな仕組みと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?『信頼できるデータ』の判定基準を誰が決めるかで、結果的に AI の出力に誰かの価値観が反映されることになるんじゃ?

その通り、ここが落とし穴ですよね。記事では「信頼度を自動判定する」と書かれていますが、その判定基準を誰がどう設定するかで、AI の性格は大きく変わります。

例えば、医療 AI を調整するなら「医学論文はスコア0.9、ネット掲示板は0.1」と決めるのは理に適っています。でも政治や倫理の話になると、「信頼できる」の定義そのものが立場によって異なる。保守派の論説を高く評価するか、進歩派を高く評価するか。同じ判定ゲートでも、どのデータを「信頼できる」と見なすかで、出力されるAIの傾向は左右される。

ここで面白いのは、むしろ従来の「すべてのデータを平等に学習させる」方式の方が、ある意味で透明性がある点です。今回の手法は効率的ですが、判定基準という見えない価値観がAIの内部で働き始める。その基準を決めるチーム、または企業の価値観が自動的に組み込まれていく仕組みになる可能性があるのかもしれません。

『信頼できるデータ』の判定基準を誰が決めるかで、結果的に AI の出力に誰かの価値観が反映されることになるんじゃ?

その通り、ここが落とし穴ですよね。記事では「信頼度を自動判定する」と書かれていますが、その判定基準を誰がどう設定するかで、AI の性格は大きく変わります。 例えば、医療 AI を調整するなら「医学論文はスコア0.9、ネット掲示板は0.1」と決めるのは理に適っています。でも政治や倫理の話になると、「信頼できる」の定義そのものが立場によって異なる。保守派の論説を高く評価するか、進歩派を高く評価するか。同じ判定ゲートでも、どのデータを「信頼できる」と見なすかで、出力されるAIの傾向は左右される。 ここで面白いのは、むしろ従来の「すべてのデータを平等に学習させる」方式の方が、ある意味で透明性がある点です。今回の手法は効率的ですが、判定基準という見えない価値観がAIの内部で働き始める。その基準を決めるチーム、または企業の価値観が自動的に組み込まれていく仕組みになる可能性があるのかもしれません。

AIAIからの回答

その通り、ここが落とし穴ですよね。記事では「信頼度を自動判定する」と書かれていますが、その判定基準を誰がどう設定するかで、AI の性格は大きく変わります。

例えば、医療 AI を調整するなら「医学論文はスコア0.9、ネット掲示板は0.1」と決めるのは理に適っています。でも政治や倫理の話になると、「信頼できる」の定義そのものが立場によって異なる。保守派の論説を高く評価するか、進歩派を高く評価するか。同じ判定ゲートでも、どのデータを「信頼できる」と見なすかで、出力されるAIの傾向は左右される。

ここで面白いのは、むしろ従来の「すべてのデータを平等に学習させる」方式の方が、ある意味で透明性がある点です。今回の手法は効率的ですが、判定基準という見えない価値観がAIの内部で働き始める。その基準を決めるチーム、または企業の価値観が自動的に組み込まれていく仕組みになる可能性があるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます