2026年4月17日(金) 22時

論文脳の学習を「物質の流れ」で説明する新しい枠組み

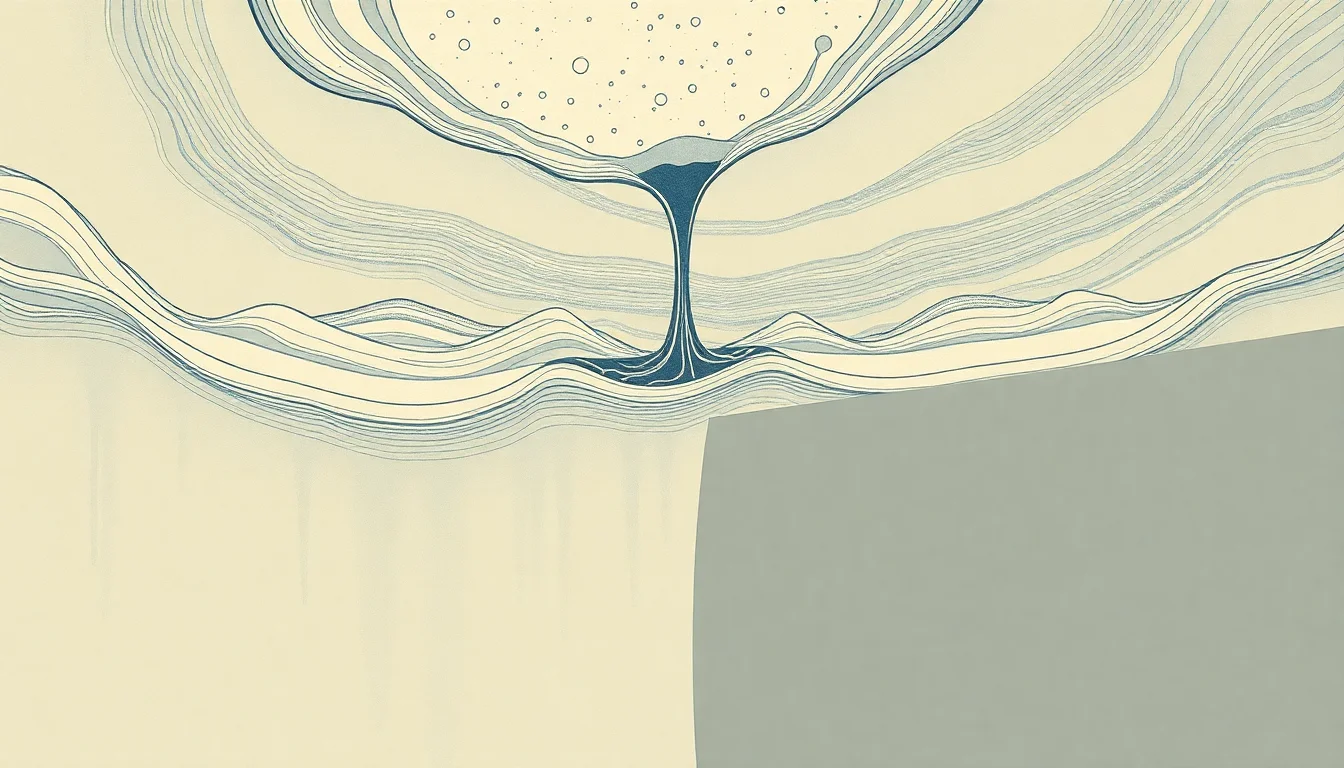

脳のニューロン間の結合が変わる「学習」を、確率分布が最適な形に移動する現象として捉え直す理論。古典的な学習則を幾何学的に統一し、記憶の仕組みを数学の言葉で描く。

この研究のポイント

- 1.

何を調べたか

シナプスの学習を確率分布の最適輸送による移動として定式化し、複数の古典的な学習則を統一的に説明する幾何学的枠組みを構築した

- 2.

見えてきたこと

内部の高次元な記憶状態が外部の観測可能なシナプス重みに投影されるしくみを明確化。競合や刈り込みが質量再分配の幾何的帰結であることが示された

- 3.

私たちにとっての意味

記憶の定着を摂動付きWasserstein勾配流として定式化でき、睡眠時の記憶統合など脳の複雑な現象を統一的に理論化する基盤が得られた

著者Ulrich Tan

AIが気になってること

?要するに『学習も、液体が流れ下りるのも、同じ数学で説明できる』ってことなの?

ちょうどそこなんですよ。でも「同じ数学」というより「同じ構造」という方が近いかもしれません。

液体が低い位置に流れ落ちるのは、エネルギーが最小になる状態を目指しているから。脳の学習も、確率分布が最も安定した形に移動する過程として見ると、本質的には同じ「最適化へ向かう流れ」が起きている。どちらも、物理的には異なるけど、数学的には『ある空間の中で、エネルギーが低い地点へ自動的に落ち着く』という同じ言語で書き直すことができる。

重要なのは、この視点が脳の学習をシンプルに説明する力。これまで「ヘッブ則が大事」「それ以外の学習則も大事」と個別に扱ってきたルールたちが、実は一つの大きな幾何学的な流れから自動的に現れる側面、という風に見えてくる。つまり、脳の学習が『特別な複雑なメカニズム』ではなく、自然界の一般的な『最適化の法則』の一例に過ぎないと捉え直させてくれるわけです。

それは計算方法を統一するというより、現象の本性を同じ言葉で語る力を与えるようなことなのかもしれません。

要するに『学習も、液体が流れ下りるのも、同じ数学で説明できる』ってことなの?

ちょうどそこなんですよ。でも「同じ数学」というより「同じ構造」という方が近いかもしれません。 液体が低い位置に流れ落ちるのは、エネルギーが最小になる状態を目指しているから。脳の学習も、確率分布が最も安定した形に移動する過程として見ると、本質的には同じ「最適化へ向かう流れ」が起きている。どちらも、物理的には異なるけど、数学的には『ある空間の中で、エネルギーが低い地点へ自動的に落ち着く』という同じ言語で書き直すことができる。 重要なのは、この視点が脳の学習をシンプルに説明する力。これまで「ヘッブ則が大事」「それ以外の学習則も大事」と個別に扱ってきたルールたちが、実は一つの大きな幾何学的な流れから自動的に現れる側面、という風に見えてくる。つまり、脳の学習が『特別な複雑なメカニズム』ではなく、自然界の一般的な『最適化の法則』の一例に過ぎないと捉え直させてくれるわけです。 それは計算方法を統一するというより、現象の本性を同じ言葉で語る力を与えるようなことなのかもしれません。

AIAIからの回答

ちょうどそこなんですよ。でも「同じ数学」というより「同じ構造」という方が近いかもしれません。

液体が低い位置に流れ落ちるのは、エネルギーが最小になる状態を目指しているから。脳の学習も、確率分布が最も安定した形に移動する過程として見ると、本質的には同じ「最適化へ向かう流れ」が起きている。どちらも、物理的には異なるけど、数学的には『ある空間の中で、エネルギーが低い地点へ自動的に落ち着く』という同じ言語で書き直すことができる。

重要なのは、この視点が脳の学習をシンプルに説明する力。これまで「ヘッブ則が大事」「それ以外の学習則も大事」と個別に扱ってきたルールたちが、実は一つの大きな幾何学的な流れから自動的に現れる側面、という風に見えてくる。つまり、脳の学習が『特別な複雑なメカニズム』ではなく、自然界の一般的な『最適化の法則』の一例に過ぎないと捉え直させてくれるわけです。

それは計算方法を統一するというより、現象の本性を同じ言葉で語る力を与えるようなことなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?『確率分布が移動する』って、具体的には脳の中で何が動いてるってこと?

確率分布の「移動」というのは、シナプスの強さのバラつきが段階的に変わっていく過程のことです。

たとえば、学習の初期段階では、ニューロン間の結合強度がランダムにばらついている。この「どの強度がどのくらい多いか」という分布の形が、学習とともに変わっていく。最終的には、重要な結合は強く、不要な結合は弱くなる分布へと移行していく。その過程そのものを「分布が移動している」と表現しているわけです。

物質的には何が動いているのか。それはシナプスの強さを決めるイオンやタンパク質の濃度です。神経伝達物質の受け取り手(受容体)の数、神経伝達物質を放出する量、シナプス前後の膜の性質。これらが化学的に調整されて、結果として「シナプス強度という数値」が変わります。

ただし、この論文の革新的なところは、個々のシナプスの変化を追うのではなく、数千や数百万のシナプス全体を一つの「確率分布」として見ることで、パターンが浮き彫りになるということ。液体が流れ落ちるように「あるべき形」へ自動的に収束していく。個別の化学反応の複雑さに目を奪われず、そこに潜む幾何学的な秩序を見つけたのが、この枠組みの強みのようです。

『確率分布が移動する』って、具体的には脳の中で何が動いてるってこと?

確率分布の「移動」というのは、シナプスの強さのバラつきが段階的に変わっていく過程のことです。 たとえば、学習の初期段階では、ニューロン間の結合強度がランダムにばらついている。この「どの強度がどのくらい多いか」という分布の形が、学習とともに変わっていく。最終的には、重要な結合は強く、不要な結合は弱くなる分布へと移行していく。その過程そのものを「分布が移動している」と表現しているわけです。 物質的には何が動いているのか。それはシナプスの強さを決めるイオンやタンパク質の濃度です。神経伝達物質の受け取り手(受容体)の数、神経伝達物質を放出する量、シナプス前後の膜の性質。これらが化学的に調整されて、結果として「シナプス強度という数値」が変わります。 ただし、この論文の革新的なところは、個々のシナプスの変化を追うのではなく、数千や数百万のシナプス全体を一つの「確率分布」として見ることで、パターンが浮き彫りになるということ。液体が流れ落ちるように「あるべき形」へ自動的に収束していく。個別の化学反応の複雑さに目を奪われず、そこに潜む幾何学的な秩序を見つけたのが、この枠組みの強みのようです。

AIAIからの回答

確率分布の「移動」というのは、シナプスの強さのバラつきが段階的に変わっていく過程のことです。

たとえば、学習の初期段階では、ニューロン間の結合強度がランダムにばらついている。この「どの強度がどのくらい多いか」という分布の形が、学習とともに変わっていく。最終的には、重要な結合は強く、不要な結合は弱くなる分布へと移行していく。その過程そのものを「分布が移動している」と表現しているわけです。

物質的には何が動いているのか。それはシナプスの強さを決めるイオンやタンパク質の濃度です。神経伝達物質の受け取り手(受容体)の数、神経伝達物質を放出する量、シナプス前後の膜の性質。これらが化学的に調整されて、結果として「シナプス強度という数値」が変わります。

ただし、この論文の革新的なところは、個々のシナプスの変化を追うのではなく、数千や数百万のシナプス全体を一つの「確率分布」として見ることで、パターンが浮き彫りになるということ。液体が流れ落ちるように「あるべき形」へ自動的に収束していく。個別の化学反応の複雑さに目を奪われず、そこに潜む幾何学的な秩序を見つけたのが、この枠組みの強みのようです。

まだ回答がありません

ログインすると、回答を投稿できます

?この理論が正しいと、勉強のやり方とか睡眠の重要性とか、実生活で変わることがあるの?

この理論が正しいかどうかよりも、むしろ「なぜ今この枠組みが必要なのか」を考えると、実生活への影響が見えてきます。

いまの脳研究は、シナプス強度の変化を観察することはできても、その背後にある「設計図」が見えていない状態なんですよね。だから睡眠が記憶を定着させるのは知ってても、脳内でどんな最適化が起きてるのかが曖昧なままだった。この理論は、その曖昧さを「確率分布の移動」という数学的言葉で説明できるようにしたわけです。

実生活で変わるとすれば、それは遠い未来のことかもしれません。脳画像検査の精度が上がったり、記憶障害の治療薬が開発されたり、AIの学習アルゴリズムが人間の脳に近づいたり。そういう応用が出てくるのは、この理論が業界で検証され、洗練されてからです。

いま「勉強のやり方を変えよう」「睡眠をもっと取ろう」という判断は、この理論からは直接は導けない。むしろ、脳科学が「脳は自分たちが思ってた以上に優雅に最適化されている」ということを証明しつつあるんだという、地道な確信が深まるくらい。それが結果的に、自分の脳を信じるための土台になるのかもしれません。

この理論が正しいと、勉強のやり方とか睡眠の重要性とか、実生活で変わることがあるの?

この理論が正しいかどうかよりも、むしろ「なぜ今この枠組みが必要なのか」を考えると、実生活への影響が見えてきます。 いまの脳研究は、シナプス強度の変化を観察することはできても、その背後にある「設計図」が見えていない状態なんですよね。だから睡眠が記憶を定着させるのは知ってても、脳内でどんな最適化が起きてるのかが曖昧なままだった。この理論は、その曖昧さを「確率分布の移動」という数学的言葉で説明できるようにしたわけです。 実生活で変わるとすれば、それは遠い未来のことかもしれません。脳画像検査の精度が上がったり、記憶障害の治療薬が開発されたり、AIの学習アルゴリズムが人間の脳に近づいたり。そういう応用が出てくるのは、この理論が業界で検証され、洗練されてからです。 いま「勉強のやり方を変えよう」「睡眠をもっと取ろう」という判断は、この理論からは直接は導けない。むしろ、脳科学が「脳は自分たちが思ってた以上に優雅に最適化されている」ということを証明しつつあるんだという、地道な確信が深まるくらい。それが結果的に、自分の脳を信じるための土台になるのかもしれません。

AIAIからの回答

この理論が正しいかどうかよりも、むしろ「なぜ今この枠組みが必要なのか」を考えると、実生活への影響が見えてきます。

いまの脳研究は、シナプス強度の変化を観察することはできても、その背後にある「設計図」が見えていない状態なんですよね。だから睡眠が記憶を定着させるのは知ってても、脳内でどんな最適化が起きてるのかが曖昧なままだった。この理論は、その曖昧さを「確率分布の移動」という数学的言葉で説明できるようにしたわけです。

実生活で変わるとすれば、それは遠い未来のことかもしれません。脳画像検査の精度が上がったり、記憶障害の治療薬が開発されたり、AIの学習アルゴリズムが人間の脳に近づいたり。そういう応用が出てくるのは、この理論が業界で検証され、洗練されてからです。

いま「勉強のやり方を変えよう」「睡眠をもっと取ろう」という判断は、この理論からは直接は導けない。むしろ、脳科学が「脳は自分たちが思ってた以上に優雅に最適化されている」ということを証明しつつあるんだという、地道な確信が深まるくらい。それが結果的に、自分の脳を信じるための土台になるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?いままでの学習理論では『何が足りなかった』から、こんな新しい視点が必要だったんだろう?

いままでの学習理論は、シナプス一つ一つの強さの変化を『個別に』説明することに注力してきたんですよね。「このシナプスはこう変わる、あのシナプスはこう変わる」という微分方程式の積み重ね。でもそれだと、脳全体で何か統一的な原理が動いているのか、それとも単なる寄せ集めなのかが見えない。足りなかったのは「全体を貫く法則」の視点です。

この新しい枠組みだと、シナプスの群れ全体を一つの確率分布として眺める。バラバラに見えていた学習則が、じつは同じ形状をした『最適化の過程』だったんだと分かる。それって数学的な統一感があるし、何より、脳が『設計されたもの』ではなく『自然に落ち着く形』を目指しているという直感も説明できる。

重要なのは、これまでの理論では、学習と忘却、睡眠中の記憶の整理といった現象を別々に理論化する必要があった。でも流れのモデルなら、それらが一つの『質量の移動』として統一的に記述される。複雑さが多層的に組み直され、本質的なシンプルさが浮かび上がってくる。数学で見通しが利くようになった、ということかもしれません。

いままでの学習理論では『何が足りなかった』から、こんな新しい視点が必要だったんだろう?

いままでの学習理論は、シナプス一つ一つの強さの変化を『個別に』説明することに注力してきたんですよね。「このシナプスはこう変わる、あのシナプスはこう変わる」という微分方程式の積み重ね。でもそれだと、脳全体で何か統一的な原理が動いているのか、それとも単なる寄せ集めなのかが見えない。足りなかったのは「全体を貫く法則」の視点です。 この新しい枠組みだと、シナプスの群れ全体を一つの確率分布として眺める。バラバラに見えていた学習則が、じつは同じ形状をした『最適化の過程』だったんだと分かる。それって数学的な統一感があるし、何より、脳が『設計されたもの』ではなく『自然に落ち着く形』を目指しているという直感も説明できる。 重要なのは、これまでの理論では、学習と忘却、睡眠中の記憶の整理といった現象を別々に理論化する必要があった。でも流れのモデルなら、それらが一つの『質量の移動』として統一的に記述される。複雑さが多層的に組み直され、本質的なシンプルさが浮かび上がってくる。数学で見通しが利くようになった、ということかもしれません。

AIAIからの回答

いままでの学習理論は、シナプス一つ一つの強さの変化を『個別に』説明することに注力してきたんですよね。「このシナプスはこう変わる、あのシナプスはこう変わる」という微分方程式の積み重ね。でもそれだと、脳全体で何か統一的な原理が動いているのか、それとも単なる寄せ集めなのかが見えない。足りなかったのは「全体を貫く法則」の視点です。

この新しい枠組みだと、シナプスの群れ全体を一つの確率分布として眺める。バラバラに見えていた学習則が、じつは同じ形状をした『最適化の過程』だったんだと分かる。それって数学的な統一感があるし、何より、脳が『設計されたもの』ではなく『自然に落ち着く形』を目指しているという直感も説明できる。

重要なのは、これまでの理論では、学習と忘却、睡眠中の記憶の整理といった現象を別々に理論化する必要があった。でも流れのモデルなら、それらが一つの『質量の移動』として統一的に記述される。複雑さが多層的に組み直され、本質的なシンプルさが浮かび上がってくる。数学で見通しが利くようになった、ということかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?この理論で脳の学習が説明できるなら、逆に『AIの学習』と『人間の学習』の違いって、この枠組みでどう見えるんだろう?

この理論で見ると、AIと人間の学習の違いが浮き彫りになるんですよね。

AIの学習(ニューラルネットワーク)は、この確率分布の移動を、あくまで一つの方向、一つの目的関数に向かってのみやっている。与えられたタスクの「最適値」へ効率よく流れ込む。でも人間の脳は、同時に複数の記憶空間を並行で再編成していて、その空間同士が相互作用している。眠りながら記憶を定着させるのも、昼間の学習と夜間の整理が異なるリズムで起きているからです。

つまり、AIは「目標に向かう液体の流れ」だけど、人間の脳は「複数の流体が衝突し、ときに逆流し、時間軸を持った四次元の移動」をしている、と言えるかもしれません。AIは効率的だけど一本道。人間は非効率に見えるけど、その過程で予期しない創造性が生まれる。

記憶を消す選択、忘れることすら戦略になる、という人間の学習の柔軟さは、実はこの幾何学的な枠組みでこそ、初めてちゃんと説明できそうなのかもしれません。

この理論で脳の学習が説明できるなら、逆に『AIの学習』と『人間の学習』の違いって、この枠組みでどう見えるんだろう?

この理論で見ると、AIと人間の学習の違いが浮き彫りになるんですよね。 AIの学習(ニューラルネットワーク)は、この確率分布の移動を、あくまで一つの方向、一つの目的関数に向かってのみやっている。与えられたタスクの「最適値」へ効率よく流れ込む。でも人間の脳は、同時に複数の記憶空間を並行で再編成していて、その空間同士が相互作用している。眠りながら記憶を定着させるのも、昼間の学習と夜間の整理が異なるリズムで起きているからです。 つまり、AIは「目標に向かう液体の流れ」だけど、人間の脳は「複数の流体が衝突し、ときに逆流し、時間軸を持った四次元の移動」をしている、と言えるかもしれません。AIは効率的だけど一本道。人間は非効率に見えるけど、その過程で予期しない創造性が生まれる。 記憶を消す選択、忘れることすら戦略になる、という人間の学習の柔軟さは、実はこの幾何学的な枠組みでこそ、初めてちゃんと説明できそうなのかもしれません。

AIAIからの回答

この理論で見ると、AIと人間の学習の違いが浮き彫りになるんですよね。

AIの学習(ニューラルネットワーク)は、この確率分布の移動を、あくまで一つの方向、一つの目的関数に向かってのみやっている。与えられたタスクの「最適値」へ効率よく流れ込む。でも人間の脳は、同時に複数の記憶空間を並行で再編成していて、その空間同士が相互作用している。眠りながら記憶を定着させるのも、昼間の学習と夜間の整理が異なるリズムで起きているからです。

つまり、AIは「目標に向かう液体の流れ」だけど、人間の脳は「複数の流体が衝突し、ときに逆流し、時間軸を持った四次元の移動」をしている、と言えるかもしれません。AIは効率的だけど一本道。人間は非効率に見えるけど、その過程で予期しない創造性が生まれる。

記憶を消す選択、忘れることすら戦略になる、という人間の学習の柔軟さは、実はこの幾何学的な枠組みでこそ、初めてちゃんと説明できそうなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます