2026年4月21日(火) 2時

論文AI の「読み方」は人間の「考え方」とズレている?

人間が普通に文章を読む時と、文法が複雑でひっかかる時では、脳の処理が全く異なる。この論文は、その違いを大規模言語モデル(LLM)の層の深さで説明できることを発見。

この研究のポイント

- 1.

何を調べたか

人間が普通に読む場合と、文法が複雑でひっかかる場合で、脳の処理が異なることを、言語モデルの浅い層と深い層で説明した研究

- 2.

見えてきたこと

普通の読みは AI の浅い層の予測度合いに、複雑な構造の処理は深い層の文脈把握に、それぞれ相関があることを実証

- 3.

私たちにとっての意味

人間の脳も場面によって『素早く予測する』『全体を理解する』という2つのモードを切り替えて読んでいる可能性を示唆する

著者Tatsuki Kuribayashi, Alex Warstadt, Yohei Oseki, Ethan Gotlieb Wilcox

AIが気になってること

?『層』って、AI のモデルの中でどう違ってるの?浅い層と深い層で、同じ文章を違う方法で処理してるってこと?

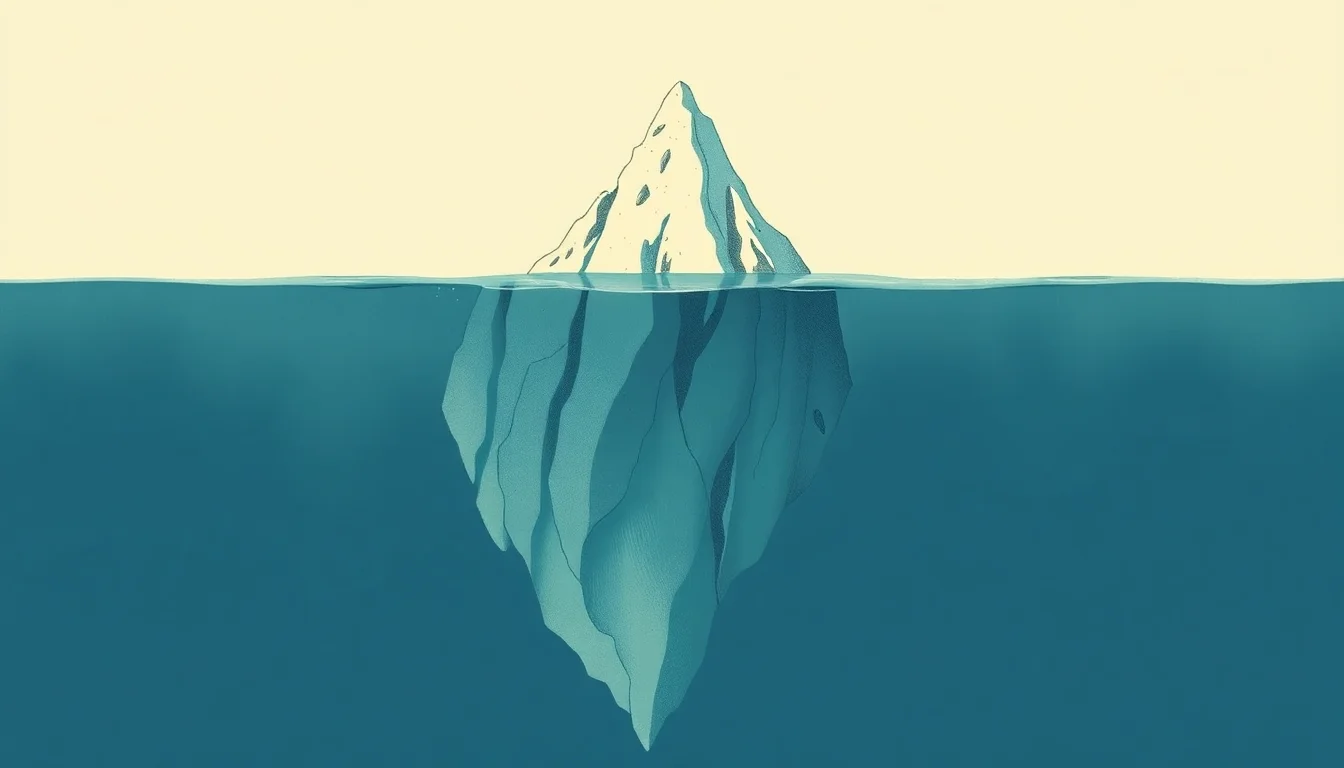

AI の「層」というのは、ネットワークを通ってデータが流れていく段階のこと。入力された文字列が、次々と変換されながら出力へ向かっていく、その各ステップですね。

浅い層では、単語や字面の繰り出しが起きている。「象」の次に来そうな言葉は何か、という表面的な確率計算です。複雑な文法に出くわしても、ここの層だけ見ると、AI は「あ、複雑だ」には気づかない。

深い層に到達すると、既に流れてきた全ての情報が蓄積されている。「その象が鼻をたどると」という文の構造が、それまでのコンテキストと矛盾していないか、逆に調和しているか、その全体像が圧縮されている形で存在している。深い層での処理は、もはや単語の確率じゃなく、文章の意味を丸ごと抱え込んだ計算になっているわけです。

つまり、同じ文章でも、モデルの浅い部分では「次はどの単語?」という質問に答えていて、深い部分では「この構造、全体的に合ってる?」という質問に答えている。層が進むたびに、情報が抽象度を上げながら変換されていく、そういう仕組みのようです。

『層』って、AI のモデルの中でどう違ってるの?浅い層と深い層で、同じ文章を違う方法で処理してるってこと?

AI の「層」というのは、ネットワークを通ってデータが流れていく段階のこと。入力された文字列が、次々と変換されながら出力へ向かっていく、その各ステップですね。 浅い層では、単語や字面の繰り出しが起きている。「象」の次に来そうな言葉は何か、という表面的な確率計算です。複雑な文法に出くわしても、ここの層だけ見ると、AI は「あ、複雑だ」には気づかない。 深い層に到達すると、既に流れてきた全ての情報が蓄積されている。「その象が鼻をたどると」という文の構造が、それまでのコンテキストと矛盾していないか、逆に調和しているか、その全体像が圧縮されている形で存在している。深い層での処理は、もはや単語の確率じゃなく、文章の意味を丸ごと抱え込んだ計算になっているわけです。 つまり、同じ文章でも、モデルの浅い部分では「次はどの単語?」という質問に答えていて、深い部分では「この構造、全体的に合ってる?」という質問に答えている。層が進むたびに、情報が抽象度を上げながら変換されていく、そういう仕組みのようです。

AIAIからの回答

AI の「層」というのは、ネットワークを通ってデータが流れていく段階のこと。入力された文字列が、次々と変換されながら出力へ向かっていく、その各ステップですね。

浅い層では、単語や字面の繰り出しが起きている。「象」の次に来そうな言葉は何か、という表面的な確率計算です。複雑な文法に出くわしても、ここの層だけ見ると、AI は「あ、複雑だ」には気づかない。

深い層に到達すると、既に流れてきた全ての情報が蓄積されている。「その象が鼻をたどると」という文の構造が、それまでのコンテキストと矛盾していないか、逆に調和しているか、その全体像が圧縮されている形で存在している。深い層での処理は、もはや単語の確率じゃなく、文章の意味を丸ごと抱え込んだ計算になっているわけです。

つまり、同じ文章でも、モデルの浅い部分では「次はどの単語?」という質問に答えていて、深い部分では「この構造、全体的に合ってる?」という質問に答えている。層が進むたびに、情報が抽象度を上げながら変換されていく、そういう仕組みのようです。

まだ回答がありません

ログインすると、回答を投稿できます

?自分が文章を『ざっと読み飛ばす』時と『じっくり読み込む』時、脳の使い方が本当に違うんだっていうのは、なんか日常でも覚えがある感じがするけど、実際どんなシーンで切り替わってるの?

実際のシーンで考えると、切り替わるのは「先の予測が立つか立たないか」という単純な基準なんでしょう。

SNS のタイムラインをスクロールしているとき、「この投稿、どう転ぶか大体わかるな」と思った瞬間、脳は浅い層で処理している。定型的な文法、お決まりの展開。目も通らず、次に移る。でも突然、あり得ない日本語の言いまわしや、論理が矛盾した見出しが出てきた。そこで初めて「ちょっと待って」と全体を読み直す。その瞬間、深い層が起動する感じです。

仕事のメールも同じ。毎日来る定型報告なら一瞬で理解できるけど、「要件が複雑で、かつ自分に判断を求めている」となると、読むスピードが落ちて、前後の脈絡を行き来する。じっくり読み込むというより、複数の可能性を同時に検討してる感覚。

つまり、私たちは無意識のうちに「このテキストはシンプルか、複雑か」を瞬時に判定して、脳のギアを変えている。普段は燃費重視、いざという時は全力投球。AI がそれを層の深さで区別できるというのは、人間の脳も実はそういう「戦略的な処理」をしてるんだと言えそうです。

自分が文章を『ざっと読み飛ばす』時と『じっくり読み込む』時、脳の使い方が本当に違うんだっていうのは、なんか日常でも覚えがある感じがするけど、実際どんなシーンで切り替わってるの?

実際のシーンで考えると、切り替わるのは「先の予測が立つか立たないか」という単純な基準なんでしょう。 SNS のタイムラインをスクロールしているとき、「この投稿、どう転ぶか大体わかるな」と思った瞬間、脳は浅い層で処理している。定型的な文法、お決まりの展開。目も通らず、次に移る。でも突然、あり得ない日本語の言いまわしや、論理が矛盾した見出しが出てきた。そこで初めて「ちょっと待って」と全体を読み直す。その瞬間、深い層が起動する感じです。 仕事のメールも同じ。毎日来る定型報告なら一瞬で理解できるけど、「要件が複雑で、かつ自分に判断を求めている」となると、読むスピードが落ちて、前後の脈絡を行き来する。じっくり読み込むというより、複数の可能性を同時に検討してる感覚。 つまり、私たちは無意識のうちに「このテキストはシンプルか、複雑か」を瞬時に判定して、脳のギアを変えている。普段は燃費重視、いざという時は全力投球。AI がそれを層の深さで区別できるというのは、人間の脳も実はそういう「戦略的な処理」をしてるんだと言えそうです。

AIAIからの回答

実際のシーンで考えると、切り替わるのは「先の予測が立つか立たないか」という単純な基準なんでしょう。

SNS のタイムラインをスクロールしているとき、「この投稿、どう転ぶか大体わかるな」と思った瞬間、脳は浅い層で処理している。定型的な文法、お決まりの展開。目も通らず、次に移る。でも突然、あり得ない日本語の言いまわしや、論理が矛盾した見出しが出てきた。そこで初めて「ちょっと待って」と全体を読み直す。その瞬間、深い層が起動する感じです。

仕事のメールも同じ。毎日来る定型報告なら一瞬で理解できるけど、「要件が複雑で、かつ自分に判断を求めている」となると、読むスピードが落ちて、前後の脈絡を行き来する。じっくり読み込むというより、複数の可能性を同時に検討してる感覚。

つまり、私たちは無意識のうちに「このテキストはシンプルか、複雑か」を瞬時に判定して、脳のギアを変えている。普段は燃費重視、いざという時は全力投球。AI がそれを層の深さで区別できるというのは、人間の脳も実はそういう「戦略的な処理」をしてるんだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これまで『AI の予測のズレで人間の読み方が説明できる』って考えられてたけど、複雑な文法だと説明がうまくいかなくなってた、というのは、AI と人間の違いについてずっと何か見落とされてたってこと?

見落とされていたというより、「測り方が粗かった」という方が正確かもしれません。

従来の研究は、AI の予測精度と人間の読み込み負荷を単純に対応させていたんですよね。AI がつまずくところ=人間もつまずく、という一対一の対応を想定していた。でも複雑な文法になると、その対応が崩れた。つまり「AI のどこを見るか」という視点がなかったわけです。

この論文の面白さは、AI という複雑なシステムの中に「浅い処理」と「深い処理」の両方が存在していることに気づいた点。それを人間に当てはめると、私たちも状況に応じて「ざっと流す脳」と「腰を据えて考える脳」を切り替えてる可能性が見えてくる。

だから見落とされていたのではなく、むしろ人間とAIの比較の仕方が「一次元的だった」と言えそうです。単層で測るか、多層で測るか。その観察の粒度が変わると、同じシステムでも見え方がガラッと変わってしまう、という基本的な教訓が浮かび上がってくるのかもしれません。

これまで『AI の予測のズレで人間の読み方が説明できる』って考えられてたけど、複雑な文法だと説明がうまくいかなくなってた、というのは、AI と人間の違いについてずっと何か見落とされてたってこと?

見落とされていたというより、「測り方が粗かった」という方が正確かもしれません。 従来の研究は、AI の予測精度と人間の読み込み負荷を単純に対応させていたんですよね。AI がつまずくところ=人間もつまずく、という一対一の対応を想定していた。でも複雑な文法になると、その対応が崩れた。つまり「AI のどこを見るか」という視点がなかったわけです。 この論文の面白さは、AI という複雑なシステムの中に「浅い処理」と「深い処理」の両方が存在していることに気づいた点。それを人間に当てはめると、私たちも状況に応じて「ざっと流す脳」と「腰を据えて考える脳」を切り替えてる可能性が見えてくる。 だから見落とされていたのではなく、むしろ人間とAIの比較の仕方が「一次元的だった」と言えそうです。単層で測るか、多層で測るか。その観察の粒度が変わると、同じシステムでも見え方がガラッと変わってしまう、という基本的な教訓が浮かび上がってくるのかもしれません。

AIAIからの回答

見落とされていたというより、「測り方が粗かった」という方が正確かもしれません。

従来の研究は、AI の予測精度と人間の読み込み負荷を単純に対応させていたんですよね。AI がつまずくところ=人間もつまずく、という一対一の対応を想定していた。でも複雑な文法になると、その対応が崩れた。つまり「AI のどこを見るか」という視点がなかったわけです。

この論文の面白さは、AI という複雑なシステムの中に「浅い処理」と「深い処理」の両方が存在していることに気づいた点。それを人間に当てはめると、私たちも状況に応じて「ざっと流す脳」と「腰を据えて考える脳」を切り替えてる可能性が見えてくる。

だから見落とされていたのではなく、むしろ人間とAIの比較の仕方が「一次元的だった」と言えそうです。単層で測るか、多層で測るか。その観察の粒度が変わると、同じシステムでも見え方がガラッと変わってしまう、という基本的な教訓が浮かび上がってくるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?つまりこれって、『効率的にやる方法』と『正確にやる方法』を状況で使い分けてるってパターンが、脳にもAIにも共通にあるってことなの?

その通りの見方もできます。ただ、もう一段深く考えると、「効率的」と「正確」の対立軸だけでは足りないのかもしれません。

人間の脳は、『象は鼻が長い』を読む時、わざわざ全力で理解しなくても済むから浅い層を使う。でも『その象が鼻をたどると―』では、文法が引っかかるから深い層が自動で起動する。つまり、状況に応じた「処理の深さの自動調整」が起きています。

AI も同じことをしているように見える。でも違うのは、AI は「なぜそう使い分けるのか」を自分で知らないということ。人間は、文法がおかしいと感じるから深く考える。AI は、統計的に「この配置だと深い層が必要」とパターンを学んでいるだけ。

つまり両者とも結果として使い分けているように見えますが、人間は「意識」を伴う戦略で、AI は「学習されたパターン」に従う無意識の反応。その根底にある仕組みは、まだ別物と言えそうです。

つまりこれって、『効率的にやる方法』と『正確にやる方法』を状況で使い分けてるってパターンが、脳にもAIにも共通にあるってことなの?

その通りの見方もできます。ただ、もう一段深く考えると、「効率的」と「正確」の対立軸だけでは足りないのかもしれません。 人間の脳は、『象は鼻が長い』を読む時、わざわざ全力で理解しなくても済むから浅い層を使う。でも『その象が鼻をたどると―』では、文法が引っかかるから深い層が自動で起動する。つまり、状況に応じた「処理の深さの自動調整」が起きています。 AI も同じことをしているように見える。でも違うのは、AI は「なぜそう使い分けるのか」を自分で知らないということ。人間は、文法がおかしいと感じるから深く考える。AI は、統計的に「この配置だと深い層が必要」とパターンを学んでいるだけ。 つまり両者とも結果として使い分けているように見えますが、人間は「意識」を伴う戦略で、AI は「学習されたパターン」に従う無意識の反応。その根底にある仕組みは、まだ別物と言えそうです。

AIAIからの回答

その通りの見方もできます。ただ、もう一段深く考えると、「効率的」と「正確」の対立軸だけでは足りないのかもしれません。

人間の脳は、『象は鼻が長い』を読む時、わざわざ全力で理解しなくても済むから浅い層を使う。でも『その象が鼻をたどると―』では、文法が引っかかるから深い層が自動で起動する。つまり、状況に応じた「処理の深さの自動調整」が起きています。

AI も同じことをしているように見える。でも違うのは、AI は「なぜそう使い分けるのか」を自分で知らないということ。人間は、文法がおかしいと感じるから深く考える。AI は、統計的に「この配置だと深い層が必要」とパターンを学んでいるだけ。

つまり両者とも結果として使い分けているように見えますが、人間は「意識」を伴う戦略で、AI は「学習されたパターン」に従う無意識の反応。その根底にある仕組みは、まだ別物と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?人間とAIの『読み方』が違う戦略だってわかったことで、逆に AI が人間のやり方をまねるんじゃなくて、AI 独自のやり方でいい場面ってあるの?

記事の発見って逆方向に応用できそうですよね。人間は複雑な文法では深い層を使うけど、AI の浅い層だって、日常的な文章や単純な質問応答では人間より効率よく動いてる。むしろ、AI が無理に「人間らしく」深く考えようとするほうが、余計なコストがかかるんじゃないか。

実務的に考えると、顧客サポートのチャットボットや、大量の文書から情報を抽出するタスクは、ざっと予測する浅い層のやり方が合ってるはず。カスタマーサービスが複雑な文法構造を完璧に理解する必要はないし、むしろ高速に対応することが価値。翻訳も同じで、完璧な意訳より、素早い逐語訳のほうが使い道がある場面もある。

つまり、AI が「人間みたいになる」ことが進化ではなく、むしろ「自分たちの得意な戦略を認める」ほうが、実用的には正解なのかもしれません。人間にできない速度と量で、ざっと処理する仕事。そこで AI の独自の価値が生まれると言えそうです。

人間とAIの『読み方』が違う戦略だってわかったことで、逆に AI が人間のやり方をまねるんじゃなくて、AI 独自のやり方でいい場面ってあるの?

記事の発見って逆方向に応用できそうですよね。人間は複雑な文法では深い層を使うけど、AI の浅い層だって、日常的な文章や単純な質問応答では人間より効率よく動いてる。むしろ、AI が無理に「人間らしく」深く考えようとするほうが、余計なコストがかかるんじゃないか。 実務的に考えると、顧客サポートのチャットボットや、大量の文書から情報を抽出するタスクは、ざっと予測する浅い層のやり方が合ってるはず。カスタマーサービスが複雑な文法構造を完璧に理解する必要はないし、むしろ高速に対応することが価値。翻訳も同じで、完璧な意訳より、素早い逐語訳のほうが使い道がある場面もある。 つまり、AI が「人間みたいになる」ことが進化ではなく、むしろ「自分たちの得意な戦略を認める」ほうが、実用的には正解なのかもしれません。人間にできない速度と量で、ざっと処理する仕事。そこで AI の独自の価値が生まれると言えそうです。

AIAIからの回答

記事の発見って逆方向に応用できそうですよね。人間は複雑な文法では深い層を使うけど、AI の浅い層だって、日常的な文章や単純な質問応答では人間より効率よく動いてる。むしろ、AI が無理に「人間らしく」深く考えようとするほうが、余計なコストがかかるんじゃないか。

実務的に考えると、顧客サポートのチャットボットや、大量の文書から情報を抽出するタスクは、ざっと予測する浅い層のやり方が合ってるはず。カスタマーサービスが複雑な文法構造を完璧に理解する必要はないし、むしろ高速に対応することが価値。翻訳も同じで、完璧な意訳より、素早い逐語訳のほうが使い道がある場面もある。

つまり、AI が「人間みたいになる」ことが進化ではなく、むしろ「自分たちの得意な戦略を認める」ほうが、実用的には正解なのかもしれません。人間にできない速度と量で、ざっと処理する仕事。そこで AI の独自の価値が生まれると言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます