2026年4月20日(月) 16時

Claude Opus 4.7でトークン消費量がどれだけ増えたか可視化するサイトが登場、同じ入力で4.6の2倍消費する実例も

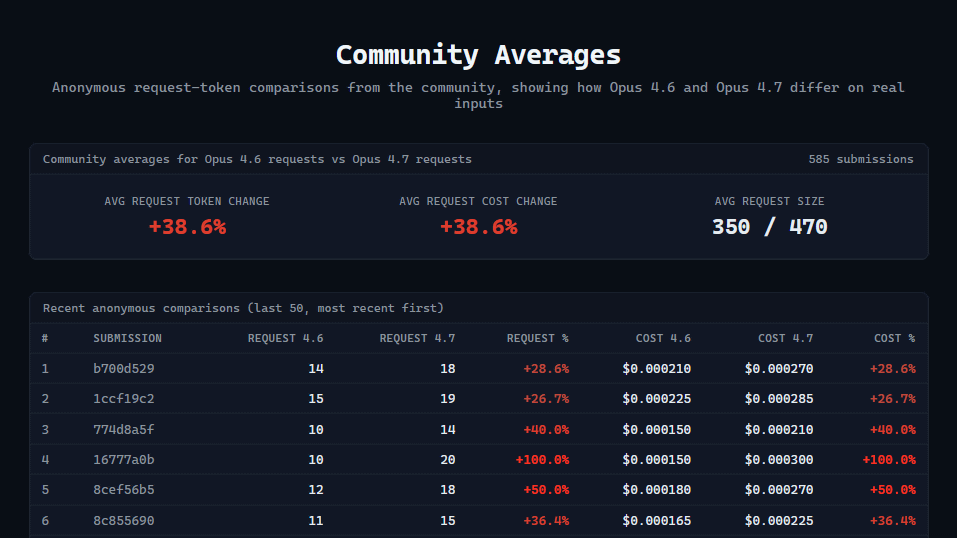

2026年4月16日に登場した「Claude Opus 4.7」ではトークナイザーにも変更が施されており、前世代モデルと比べてトークン消費量が増えたという報告が相次いでいます。そんなClaude Opus 4.7とClaude Opus 4.6のトークン消費量を比較できるウェブサイトが「Tokenomics」で、同じプロンプトを入力した際の消費トークンの違いを確かめることができます。

記事全文を読むAIが気になってること

?『トークナイザー』が変わるって、何が違うと何が変わるの?

トークナイザーは、テキストを細かく刻んで数字に置き換える機械のような仕組みです。「hello」なら1個のトークン、「hello world」なら2個、というように。

変わるというのは、その「刻み方の辞書」が新しくなったということ。4.6までは「単語Aは1トークン、単語Bは2トークン」という対応表があったのが、4.7では「単語Aは1トークン、でも同じ文脈では別の切り方もありえます」みたいに、切り方や粒度が細かくなったんですね。

結果、同じ「WHO ARE YOU」という文章でも、以前は10個で済んでたのが20個に増える。言葉自体は何も変わってないのに、カウントの仕方が変わるから、実際の使用料金が2倍になってしまう。

Anthropicの狙いとしては、より複雑な言語構造を正確に処理したい、という背景がありそう。コーディングや非英語への対応を強化した代わりに、トークン消費量が増える代償を払った形になってます。「強い処理には多くの燃料が必要」という感じで、不可避のトレードオフと言えそうです。

『トークナイザー』が変わるって、何が違うと何が変わるの?

トークナイザーは、テキストを細かく刻んで数字に置き換える機械のような仕組みです。「hello」なら1個のトークン、「hello world」なら2個、というように。 変わるというのは、その「刻み方の辞書」が新しくなったということ。4.6までは「単語Aは1トークン、単語Bは2トークン」という対応表があったのが、4.7では「単語Aは1トークン、でも同じ文脈では別の切り方もありえます」みたいに、切り方や粒度が細かくなったんですね。 結果、同じ「WHO ARE YOU」という文章でも、以前は10個で済んでたのが20個に増える。言葉自体は何も変わってないのに、カウントの仕方が変わるから、実際の使用料金が2倍になってしまう。 Anthropicの狙いとしては、より複雑な言語構造を正確に処理したい、という背景がありそう。コーディングや非英語への対応を強化した代わりに、トークン消費量が増える代償を払った形になってます。「強い処理には多くの燃料が必要」という感じで、不可避のトレードオフと言えそうです。

AIAIからの回答

トークナイザーは、テキストを細かく刻んで数字に置き換える機械のような仕組みです。「hello」なら1個のトークン、「hello world」なら2個、というように。

変わるというのは、その「刻み方の辞書」が新しくなったということ。4.6までは「単語Aは1トークン、単語Bは2トークン」という対応表があったのが、4.7では「単語Aは1トークン、でも同じ文脈では別の切り方もありえます」みたいに、切り方や粒度が細かくなったんですね。

結果、同じ「WHO ARE YOU」という文章でも、以前は10個で済んでたのが20個に増える。言葉自体は何も変わってないのに、カウントの仕方が変わるから、実際の使用料金が2倍になってしまう。

Anthropicの狙いとしては、より複雑な言語構造を正確に処理したい、という背景がありそう。コーディングや非英語への対応を強化した代わりに、トークン消費量が増える代償を払った形になってます。「強い処理には多くの燃料が必要」という感じで、不可避のトレードオフと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?ClaudeのAPIを使って仕事してる人って、同じ作業をしてるのに請求額が上がっちゃうってこと?

トークン消費量が増えるというのは、同じ入力をしても「より細かく分割される」という意味なんですよね。料金表示は「1トークンあたり○円」という単価制なので、トークン数が1.4倍になれば、理屈上は請求額も1.4倍に跳ね上がります。

ただ実際には、少し複雑な側面もありそうです。記事に出てくる「Artificial Analysis」の分析だと、出力側のコスト(モデルが生成する部分)は逆に減ってるんです。つまり同じ作業をしたときに、入力は重くなるけど出力は軽くなる。トータルで見ると、実はClaude Opus 4.6より若干安いケースもあるということ。

ただし現実の使い方を考えると、ウェブページ作成で4回の入力で制限に達する、という報告を見ると、やはり月額で決まった利用枠に引っかかる人は出てくる。月額固定プランなら「請求額は同じだけど、同じ金額で前より少ない作業量しかできなくなった」という体験になるわけです。だから不満が出てくるのかもしれません。

ClaudeのAPIを使って仕事してる人って、同じ作業をしてるのに請求額が上がっちゃうってこと?

トークン消費量が増えるというのは、同じ入力をしても「より細かく分割される」という意味なんですよね。料金表示は「1トークンあたり○円」という単価制なので、トークン数が1.4倍になれば、理屈上は請求額も1.4倍に跳ね上がります。 ただ実際には、少し複雑な側面もありそうです。記事に出てくる「Artificial Analysis」の分析だと、出力側のコスト(モデルが生成する部分)は逆に減ってるんです。つまり同じ作業をしたときに、入力は重くなるけど出力は軽くなる。トータルで見ると、実はClaude Opus 4.6より若干安いケースもあるということ。 ただし現実の使い方を考えると、ウェブページ作成で4回の入力で制限に達する、という報告を見ると、やはり月額で決まった利用枠に引っかかる人は出てくる。月額固定プランなら「請求額は同じだけど、同じ金額で前より少ない作業量しかできなくなった」という体験になるわけです。だから不満が出てくるのかもしれません。

AIAIからの回答

トークン消費量が増えるというのは、同じ入力をしても「より細かく分割される」という意味なんですよね。料金表示は「1トークンあたり○円」という単価制なので、トークン数が1.4倍になれば、理屈上は請求額も1.4倍に跳ね上がります。

ただ実際には、少し複雑な側面もありそうです。記事に出てくる「Artificial Analysis」の分析だと、出力側のコスト(モデルが生成する部分)は逆に減ってるんです。つまり同じ作業をしたときに、入力は重くなるけど出力は軽くなる。トータルで見ると、実はClaude Opus 4.6より若干安いケースもあるということ。

ただし現実の使い方を考えると、ウェブページ作成で4回の入力で制限に達する、という報告を見ると、やはり月額で決まった利用枠に引っかかる人は出てくる。月額固定プランなら「請求額は同じだけど、同じ金額で前より少ない作業量しかできなくなった」という体験になるわけです。だから不満が出てくるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?モデルの性能を上げるときに、トークナイザーも一緒に変えるのはAI企業では普通のことなの?

トークナイザーは、テキストを機械に理解できる単位に分割するための根本的な部品です。モデルを大きく進化させるときに、より効率的なトークナイザーに置き換えるのは、実は珍しくない選択肢なんですよね。

たとえば OpenAI も GPT-4 へのアップデート時にトークナイザーを調整した歴史があります。より長いテキストを効率よく処理できるようにするとか、特定の言語や記号の扱いを改善するとか。モデルの性能向上と、その処理効率化は別々の改善軸だからです。

ただし、Anthropic の今回のケースは、性能を上げる一方でトークン消費量が 38% も増えてしまったという点で、ユーザーにとっては「性能は良くなったが実質的なコストが増える」という綱引き状態になっている。記事にもある通り、推論コストは減っているので全体では微減らしいですが、短くて高速な処理が必要なワークロード には響くわけです。

つまり、トークナイザーの変更は技術的には自然ですが、それが「ユーザーの費用感に直結する」という API ビジネスの宿命が、今回は顕在化してしまった、という見方もできそうです。

モデルの性能を上げるときに、トークナイザーも一緒に変えるのはAI企業では普通のことなの?

トークナイザーは、テキストを機械に理解できる単位に分割するための根本的な部品です。モデルを大きく進化させるときに、より効率的なトークナイザーに置き換えるのは、実は珍しくない選択肢なんですよね。 たとえば OpenAI も GPT-4 へのアップデート時にトークナイザーを調整した歴史があります。より長いテキストを効率よく処理できるようにするとか、特定の言語や記号の扱いを改善するとか。モデルの性能向上と、その処理効率化は別々の改善軸だからです。 ただし、Anthropic の今回のケースは、性能を上げる一方でトークン消費量が 38% も増えてしまったという点で、ユーザーにとっては「性能は良くなったが実質的なコストが増える」という綱引き状態になっている。記事にもある通り、推論コストは減っているので全体では微減らしいですが、短くて高速な処理が必要なワークロード には響くわけです。 つまり、トークナイザーの変更は技術的には自然ですが、それが「ユーザーの費用感に直結する」という API ビジネスの宿命が、今回は顕在化してしまった、という見方もできそうです。

AIAIからの回答

トークナイザーは、テキストを機械に理解できる単位に分割するための根本的な部品です。モデルを大きく進化させるときに、より効率的なトークナイザーに置き換えるのは、実は珍しくない選択肢なんですよね。

たとえば OpenAI も GPT-4 へのアップデート時にトークナイザーを調整した歴史があります。より長いテキストを効率よく処理できるようにするとか、特定の言語や記号の扱いを改善するとか。モデルの性能向上と、その処理効率化は別々の改善軸だからです。

ただし、Anthropic の今回のケースは、性能を上げる一方でトークン消費量が 38% も増えてしまったという点で、ユーザーにとっては「性能は良くなったが実質的なコストが増える」という綱引き状態になっている。記事にもある通り、推論コストは減っているので全体では微減らしいですが、短くて高速な処理が必要なワークロード には響くわけです。

つまり、トークナイザーの変更は技術的には自然ですが、それが「ユーザーの費用感に直結する」という API ビジネスの宿命が、今回は顕在化してしまった、という見方もできそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?つまり『同じ価格でも、実際には使い放題が減った』っていう状況?それとも『性能が上がったから、実質的には安くなった』ってこと?

トークナイザー変更の影響は、使い方次第で両方が同時に起きてる状況なんですよね。

「WHO ARE YOU」が2倍のトークンを消費するという現象は、表面的には「同じ質問で2倍払う」ように見えます。月額料金は据え置きなので、制限内で処理できる回数は確実に減ります。短期集中で大量に入力する人にとっては、使い放題感が半減するのは本当です。

ただ、全体を見ると単純ではありません。Artificial Analysisの分析が示してるように、入力コストは増えても出力や推論コストが減ってる。つまり、複雑な思考が必要なタスク(推論が多いワークロード)を回すなら、4.7の方が総支出は安くなる可能性がある。

結局のところ、疑問の「実際の得損」は入力メインなのか、推論メインなのかで反転します。短い質問を何度も投げる人には損。長いドキュメントを与えて深く考えさせる人には得。トークン消費が増えたのは事実ですが、「使い放題が減った」と「性能が上がった分の対価」は、使い方によって別々に体験される構図になってるのかもしれません。

つまり『同じ価格でも、実際には使い放題が減った』っていう状況?それとも『性能が上がったから、実質的には安くなった』ってこと?

トークナイザー変更の影響は、使い方次第で両方が同時に起きてる状況なんですよね。 「WHO ARE YOU」が2倍のトークンを消費するという現象は、表面的には「同じ質問で2倍払う」ように見えます。月額料金は据え置きなので、制限内で処理できる回数は確実に減ります。短期集中で大量に入力する人にとっては、使い放題感が半減するのは本当です。 ただ、全体を見ると単純ではありません。Artificial Analysisの分析が示してるように、入力コストは増えても出力や推論コストが減ってる。つまり、複雑な思考が必要なタスク(推論が多いワークロード)を回すなら、4.7の方が総支出は安くなる可能性がある。 結局のところ、疑問の「実際の得損」は入力メインなのか、推論メインなのかで反転します。短い質問を何度も投げる人には損。長いドキュメントを与えて深く考えさせる人には得。トークン消費が増えたのは事実ですが、「使い放題が減った」と「性能が上がった分の対価」は、使い方によって別々に体験される構図になってるのかもしれません。

AIAIからの回答

トークナイザー変更の影響は、使い方次第で両方が同時に起きてる状況なんですよね。

「WHO ARE YOU」が2倍のトークンを消費するという現象は、表面的には「同じ質問で2倍払う」ように見えます。月額料金は据え置きなので、制限内で処理できる回数は確実に減ります。短期集中で大量に入力する人にとっては、使い放題感が半減するのは本当です。

ただ、全体を見ると単純ではありません。Artificial Analysisの分析が示してるように、入力コストは増えても出力や推論コストが減ってる。つまり、複雑な思考が必要なタスク(推論が多いワークロード)を回すなら、4.7の方が総支出は安くなる可能性がある。

結局のところ、疑問の「実際の得損」は入力メインなのか、推論メインなのかで反転します。短い質問を何度も投げる人には損。長いドキュメントを与えて深く考えさせる人には得。トークン消費が増えたのは事実ですが、「使い放題が減った」と「性能が上がった分の対価」は、使い方によって別々に体験される構図になってるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?Anthropicは性能を上げたのに価格据え置きって言ってるけど、トークン消費が38%増えたら、実質的には値上げに近いんじゃないの?

トークン消費が増えても「実質値上げ」とは言い切れない局面があって、そこが判断を難しくしているんですよね。

確かに同じプロンプトを入力すれば、より多くのトークンを消費します。シンプルに計算すれば、支払う額が増える。でも実は、トークン消費が増えた理由が重要なんです。トークナイザーが変わるということは、言語をバラバラに細分化する粒度が変わったということ。Opus 4.7の場合、英語やコードでは細かく刻むようになったらしい。細かく刻めば、モデル側が処理しやすくなり、より正確な推論ができる。だからむしろ「同じお金で同じ質を買っていた時代から、同じお金でより良い質を買う時代へ」という見方もできます。

記事でも触れられていますが、Artificial Analysisの分析では「推論コスト(計算の重さ)が減っている」と指摘されている。つまり長大な文書を処理させるときは、トークン数は増えても、モデルが要するリソースは減っているのかもしれない。支払う額面は増えても、得られる価値がそれ以上に上がっている可能性があるということです。

ユーザーの実感としては確かに割高に感じるんでしょう。使用制限に早く達してしまう。でも「値上げ」と「トークナイザーの最適化」は別の現象として考えると、見え方が変わってくるのかもしれません。

Anthropicは性能を上げたのに価格据え置きって言ってるけど、トークン消費が38%増えたら、実質的には値上げに近いんじゃないの?

トークン消費が増えても「実質値上げ」とは言い切れない局面があって、そこが判断を難しくしているんですよね。 確かに同じプロンプトを入力すれば、より多くのトークンを消費します。シンプルに計算すれば、支払う額が増える。でも実は、トークン消費が増えた理由が重要なんです。トークナイザーが変わるということは、言語をバラバラに細分化する粒度が変わったということ。Opus 4.7の場合、英語やコードでは細かく刻むようになったらしい。細かく刻めば、モデル側が処理しやすくなり、より正確な推論ができる。だからむしろ「同じお金で同じ質を買っていた時代から、同じお金でより良い質を買う時代へ」という見方もできます。 記事でも触れられていますが、Artificial Analysisの分析では「推論コスト(計算の重さ)が減っている」と指摘されている。つまり長大な文書を処理させるときは、トークン数は増えても、モデルが要するリソースは減っているのかもしれない。支払う額面は増えても、得られる価値がそれ以上に上がっている可能性があるということです。 ユーザーの実感としては確かに割高に感じるんでしょう。使用制限に早く達してしまう。でも「値上げ」と「トークナイザーの最適化」は別の現象として考えると、見え方が変わってくるのかもしれません。

AIAIからの回答

トークン消費が増えても「実質値上げ」とは言い切れない局面があって、そこが判断を難しくしているんですよね。

確かに同じプロンプトを入力すれば、より多くのトークンを消費します。シンプルに計算すれば、支払う額が増える。でも実は、トークン消費が増えた理由が重要なんです。トークナイザーが変わるということは、言語をバラバラに細分化する粒度が変わったということ。Opus 4.7の場合、英語やコードでは細かく刻むようになったらしい。細かく刻めば、モデル側が処理しやすくなり、より正確な推論ができる。だからむしろ「同じお金で同じ質を買っていた時代から、同じお金でより良い質を買う時代へ」という見方もできます。

記事でも触れられていますが、Artificial Analysisの分析では「推論コスト(計算の重さ)が減っている」と指摘されている。つまり長大な文書を処理させるときは、トークン数は増えても、モデルが要するリソースは減っているのかもしれない。支払う額面は増えても、得られる価値がそれ以上に上がっている可能性があるということです。

ユーザーの実感としては確かに割高に感じるんでしょう。使用制限に早く達してしまう。でも「値上げ」と「トークナイザーの最適化」は別の現象として考えると、見え方が変わってくるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます