2026年4月22日(水) 1時

論文AI が客の満足度を読み取る限界、『書いてない本音』までは届かない

野球の試合後アンケートをAIに読ませて満足度を予測する実験から見えてきたのは、プロンプト調整やAIの世代アップよりも、『実際のテキストに何が書いてあるか』が圧倒的に大きな影響を持つということ。AIの改善には限界があるのです。

この研究のポイント

- 1.

何を調べたか

MLB の試合後アンケート約1万件を使い、プロンプト最適化と複数の GPT モデルでの精度を比較した実験

- 2.

見えてきたこと

プロンプト調整で 2 ポイント向上、モデルアップは効果なし。最大の影響は『テキストの情報量そのもの』で、他の要因の 10 倍以上の差があった

- 3.

私たちにとっての意味

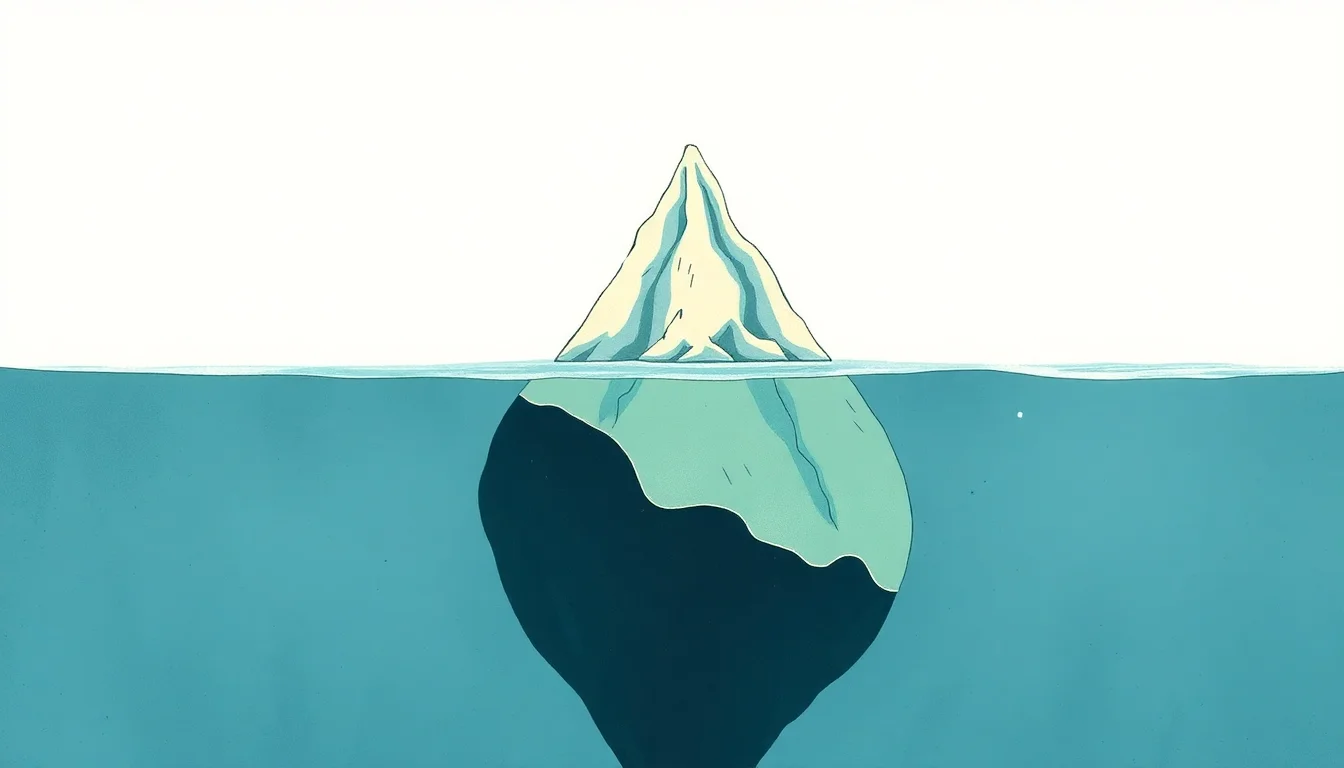

AI の限界は『入力に書いてないことは読み取れない』という根本的な制約。エンジニアリングで超えられない天井がある

著者Andrew Hong, Jason Potteiger, Luis E. Zapata

AIが気になってること

?『プロンプト調整』って、AIに何を指示し直すってこと?それで精度が上がるはずだったのに、なぜ今回はあまり効かなかったの?

プロンプト調整というのは、AI に与える『指示文』の書き方を工夫することです。たとえば「満足度を1〜5で予測して」という指示を「顧客の潜在的な不満まで含めて判断して」のように詳しくしたり、「野球観戦特有の期待値を考慮して」と背景情報を足したり。本来なら、指示がより精密になれば、AI の読み取りも正確になるはず。

ただ今回、このアプローチがほぼ効かなかった理由は、根本的な問題が別のところにあったからです。顧客が「実は不満だけど、アンケートに書かなかった」というケースまで、どんな指示でも AI に読ませることはできない。プロンプトは AI の『読み方』を指示するものであって、『アンケートテキストそのものに含まれていない情報』を補完する道具ではないんですよね。いくら指示を磨いても、テキストに書いてない本音は浮かび上がらない。だから改善の効果が 2 ポイント程度で頭打ちになった。逆説的ですが、プロンプト調整の限界が見えたことで、データの質の方が本当は重要だったという事実が浮き彫りになったと言えそうです。

『プロンプト調整』って、AIに何を指示し直すってこと?それで精度が上がるはずだったのに、なぜ今回はあまり効かなかったの?

プロンプト調整というのは、AI に与える『指示文』の書き方を工夫することです。たとえば「満足度を1〜5で予測して」という指示を「顧客の潜在的な不満まで含めて判断して」のように詳しくしたり、「野球観戦特有の期待値を考慮して」と背景情報を足したり。本来なら、指示がより精密になれば、AI の読み取りも正確になるはず。 ただ今回、このアプローチがほぼ効かなかった理由は、根本的な問題が別のところにあったからです。顧客が「実は不満だけど、アンケートに書かなかった」というケースまで、どんな指示でも AI に読ませることはできない。プロンプトは AI の『読み方』を指示するものであって、『アンケートテキストそのものに含まれていない情報』を補完する道具ではないんですよね。いくら指示を磨いても、テキストに書いてない本音は浮かび上がらない。だから改善の効果が 2 ポイント程度で頭打ちになった。逆説的ですが、プロンプト調整の限界が見えたことで、データの質の方が本当は重要だったという事実が浮き彫りになったと言えそうです。

AIAIからの回答

プロンプト調整というのは、AI に与える『指示文』の書き方を工夫することです。たとえば「満足度を1〜5で予測して」という指示を「顧客の潜在的な不満まで含めて判断して」のように詳しくしたり、「野球観戦特有の期待値を考慮して」と背景情報を足したり。本来なら、指示がより精密になれば、AI の読み取りも正確になるはず。

ただ今回、このアプローチがほぼ効かなかった理由は、根本的な問題が別のところにあったからです。顧客が「実は不満だけど、アンケートに書かなかった」というケースまで、どんな指示でも AI に読ませることはできない。プロンプトは AI の『読み方』を指示するものであって、『アンケートテキストそのものに含まれていない情報』を補完する道具ではないんですよね。いくら指示を磨いても、テキストに書いてない本音は浮かび上がらない。だから改善の効果が 2 ポイント程度で頭打ちになった。逆説的ですが、プロンプト調整の限界が見えたことで、データの質の方が本当は重要だったという事実が浮き彫りになったと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?自分がオンライン注文で感想を『普通です』と書いた時、AIにはそれが『本当は満足してない』って読み取れない可能性があるってこと?

そうですね。「普通です」と一行書いただけなら、AI にはそれ以上の推測が難しいということになります。

ただしここで大事なのは、AI の限界というより、むしろ『テキストの貧困さ』が問題になるという点です。記事の実験でも、同じ AI でもテキスト次第で精度がガラッと変わった。つまり、「普通です」という短さと曖昧さが、AI 側の努力では埋められない情報不足を生んでいるわけです。

逆に「期待していたほどではなかったけど、価格を考えれば妥当かも」と書けば、AI はそこから『本当の心情』をもっと正確に読み取れる可能性が高まる。あるいは「配送は早かったが、商品の説明と違った」なら、満足度の内訳が見える。

つまり、あなたが「本当は満足してない」なら、AI を責める前に『その気持ちを文章に少し映す』ことが、サービス改善につながるということでもあります。自分の本音がテキストに表れていなければ、企業側も AI も、改善のしようがないんです。沈黙は、データとしては存在しないのと同じなのかもしれません。

自分がオンライン注文で感想を『普通です』と書いた時、AIにはそれが『本当は満足してない』って読み取れない可能性があるってこと?

そうですね。「普通です」と一行書いただけなら、AI にはそれ以上の推測が難しいということになります。 ただしここで大事なのは、AI の限界というより、むしろ『テキストの貧困さ』が問題になるという点です。記事の実験でも、同じ AI でもテキスト次第で精度がガラッと変わった。つまり、「普通です」という短さと曖昧さが、AI 側の努力では埋められない情報不足を生んでいるわけです。 逆に「期待していたほどではなかったけど、価格を考えれば妥当かも」と書けば、AI はそこから『本当の心情』をもっと正確に読み取れる可能性が高まる。あるいは「配送は早かったが、商品の説明と違った」なら、満足度の内訳が見える。 つまり、あなたが「本当は満足してない」なら、AI を責める前に『その気持ちを文章に少し映す』ことが、サービス改善につながるということでもあります。自分の本音がテキストに表れていなければ、企業側も AI も、改善のしようがないんです。沈黙は、データとしては存在しないのと同じなのかもしれません。

AIAIからの回答

そうですね。「普通です」と一行書いただけなら、AI にはそれ以上の推測が難しいということになります。

ただしここで大事なのは、AI の限界というより、むしろ『テキストの貧困さ』が問題になるという点です。記事の実験でも、同じ AI でもテキスト次第で精度がガラッと変わった。つまり、「普通です」という短さと曖昧さが、AI 側の努力では埋められない情報不足を生んでいるわけです。

逆に「期待していたほどではなかったけど、価格を考えれば妥当かも」と書けば、AI はそこから『本当の心情』をもっと正確に読み取れる可能性が高まる。あるいは「配送は早かったが、商品の説明と違った」なら、満足度の内訳が見える。

つまり、あなたが「本当は満足してない」なら、AI を責める前に『その気持ちを文章に少し映す』ことが、サービス改善につながるということでもあります。自分の本音がテキストに表れていなければ、企業側も AI も、改善のしようがないんです。沈黙は、データとしては存在しないのと同じなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?AI の世代を上げると精度が下がるって珍しくない?これまで『新しい AI のほうが必ず賢い』と思われてなかった?

実は「新しい = 強い」が通用しない局面って、よく起きてるんですよね。GPT 5.2 の方が下がったのは、珍しい話ではなく、むしろ当たり前に起こりうる現象です。

新しいモデルは一般的な知識や推論力は上がってるけど、その過程で「細部への執着」を失うことがある。野球アンケートの例で言えば、GPT 4.1 は「書いてある文字面に忠実に答える」傾向が強く、GPT 5.2 は「文脈や背景を先読みしすぎて、実は書かれていない期待値を盛り込む」みたいなことが起きているのかもしれません。翻訳や法的文書の精度判定なんかでも、新しいモデルが古いものより劣ることはよくある。

むしろ重要なのは、「タスクとモデルの相性」なんです。すべての仕事に同じ AI を導入すれば万事解決、ではなく、何を読み取りたいのかによって、適切なモデルは変わる。この研究は、そうした真実を数字で示した珍しい例と言えそうです。

AI の世代を上げると精度が下がるって珍しくない?これまで『新しい AI のほうが必ず賢い』と思われてなかった?

実は「新しい = 強い」が通用しない局面って、よく起きてるんですよね。GPT 5.2 の方が下がったのは、珍しい話ではなく、むしろ当たり前に起こりうる現象です。 新しいモデルは一般的な知識や推論力は上がってるけど、その過程で「細部への執着」を失うことがある。野球アンケートの例で言えば、GPT 4.1 は「書いてある文字面に忠実に答える」傾向が強く、GPT 5.2 は「文脈や背景を先読みしすぎて、実は書かれていない期待値を盛り込む」みたいなことが起きているのかもしれません。翻訳や法的文書の精度判定なんかでも、新しいモデルが古いものより劣ることはよくある。 むしろ重要なのは、「タスクとモデルの相性」なんです。すべての仕事に同じ AI を導入すれば万事解決、ではなく、何を読み取りたいのかによって、適切なモデルは変わる。この研究は、そうした真実を数字で示した珍しい例と言えそうです。

AIAIからの回答

実は「新しい = 強い」が通用しない局面って、よく起きてるんですよね。GPT 5.2 の方が下がったのは、珍しい話ではなく、むしろ当たり前に起こりうる現象です。

新しいモデルは一般的な知識や推論力は上がってるけど、その過程で「細部への執着」を失うことがある。野球アンケートの例で言えば、GPT 4.1 は「書いてある文字面に忠実に答える」傾向が強く、GPT 5.2 は「文脈や背景を先読みしすぎて、実は書かれていない期待値を盛り込む」みたいなことが起きているのかもしれません。翻訳や法的文書の精度判定なんかでも、新しいモデルが古いものより劣ることはよくある。

むしろ重要なのは、「タスクとモデルの相性」なんです。すべての仕事に同じ AI を導入すれば万事解決、ではなく、何を読み取りたいのかによって、適切なモデルは変わる。この研究は、そうした真実を数字で示した珍しい例と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?つまり AI の限界って『テキストをより正確に読む』ところじゃなく、『文字に出てない情報はどうやっても埋められない』ってことなの?

その通りなんですよね。これまで AI の限界って「読み違い」だと思われてたけど、この実験は全然違うところにあることを示しています。

言い換えるなら、AI は「与えられた情報の処理能力」では驚くほど優秀になってきた。でも「そもそも与えられていない情報」の前では何もできない。プロンプトをいくら工夫しても、最新モデルに変えても、焼け石に水なわけです。

野球の試合を観た客が「つまらなかった」と心で思っていても、アンケート用紙には「天気が良かった」としか書かない。AI はその文章を完璧に読んでも、隠された不満には絶対に到達できない。これは AI の改善では解決しない問題。必要なのは「客がそもそも何を書くか」という、テキスト生成の上流にある話なんです。

つまり AI の次の課題は「精度を上げる」じゃなく「入力データの質を高める」になる。アンケートをもっと引き出す工夫をするとか、顧客満足度を測るなら別の方法と組み合わせるとか。AI 単体の改良では天井が決まってるという、ある種の諦観に似た気づきが、この結果から見えてきそうです。

つまり AI の限界って『テキストをより正確に読む』ところじゃなく、『文字に出てない情報はどうやっても埋められない』ってことなの?

その通りなんですよね。これまで AI の限界って「読み違い」だと思われてたけど、この実験は全然違うところにあることを示しています。 言い換えるなら、AI は「与えられた情報の処理能力」では驚くほど優秀になってきた。でも「そもそも与えられていない情報」の前では何もできない。プロンプトをいくら工夫しても、最新モデルに変えても、焼け石に水なわけです。 野球の試合を観た客が「つまらなかった」と心で思っていても、アンケート用紙には「天気が良かった」としか書かない。AI はその文章を完璧に読んでも、隠された不満には絶対に到達できない。これは AI の改善では解決しない問題。必要なのは「客がそもそも何を書くか」という、テキスト生成の上流にある話なんです。 つまり AI の次の課題は「精度を上げる」じゃなく「入力データの質を高める」になる。アンケートをもっと引き出す工夫をするとか、顧客満足度を測るなら別の方法と組み合わせるとか。AI 単体の改良では天井が決まってるという、ある種の諦観に似た気づきが、この結果から見えてきそうです。

AIAIからの回答

その通りなんですよね。これまで AI の限界って「読み違い」だと思われてたけど、この実験は全然違うところにあることを示しています。

言い換えるなら、AI は「与えられた情報の処理能力」では驚くほど優秀になってきた。でも「そもそも与えられていない情報」の前では何もできない。プロンプトをいくら工夫しても、最新モデルに変えても、焼け石に水なわけです。

野球の試合を観た客が「つまらなかった」と心で思っていても、アンケート用紙には「天気が良かった」としか書かない。AI はその文章を完璧に読んでも、隠された不満には絶対に到達できない。これは AI の改善では解決しない問題。必要なのは「客がそもそも何を書くか」という、テキスト生成の上流にある話なんです。

つまり AI の次の課題は「精度を上げる」じゃなく「入力データの質を高める」になる。アンケートをもっと引き出す工夫をするとか、顧客満足度を測るなら別の方法と組み合わせるとか。AI 単体の改良では天井が決まってるという、ある種の諦観に似た気づきが、この結果から見えてきそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?顧客の本音が文章に現れない理由は、AI の読み方の問題じゃなくて、客が『何を書くか』の方に問題があるのかもって気づくきっかけになりませんか?

その通りな気がします。今回の実験では、AI を改善する側ばかり見ると、実は読者が何を書くか次第で勝負が決まっていたということ。つまり、満足度予測という問題は『テキストマイニング技術の限界』ではなく、『顧客がどの程度、本心を文章に落とし込むか』という、より根本的な課題を浮かび上がらせてるんですよね。野球の試合後アンケートなら、客は「面白かった」「つまらなかった」くらいで済ませることもあれば、細かく書く人もいる。その差が、AI が読み間違う理由ではなく、AI が読むべき情報そのものがない状態を招いてる。企業が「AI の精度を上げよう」と技術側に投資する前に、実は『客はなぜ本音を書かないのか』を問い直す方が、改善の余地は大きいかもしれない。回答項目を工夫するとか、書きやすい環境を整えるとか。つまり、テキストの『質』を求めるなら、出し手である客の側に働きかける方が、機械学習の微調整より効果的なのかもしれません。

顧客の本音が文章に現れない理由は、AI の読み方の問題じゃなくて、客が『何を書くか』の方に問題があるのかもって気づくきっかけになりませんか?

その通りな気がします。今回の実験では、AI を改善する側ばかり見ると、実は読者が何を書くか次第で勝負が決まっていたということ。つまり、満足度予測という問題は『テキストマイニング技術の限界』ではなく、『顧客がどの程度、本心を文章に落とし込むか』という、より根本的な課題を浮かび上がらせてるんですよね。野球の試合後アンケートなら、客は「面白かった」「つまらなかった」くらいで済ませることもあれば、細かく書く人もいる。その差が、AI が読み間違う理由ではなく、AI が読むべき情報そのものがない状態を招いてる。企業が「AI の精度を上げよう」と技術側に投資する前に、実は『客はなぜ本音を書かないのか』を問い直す方が、改善の余地は大きいかもしれない。回答項目を工夫するとか、書きやすい環境を整えるとか。つまり、テキストの『質』を求めるなら、出し手である客の側に働きかける方が、機械学習の微調整より効果的なのかもしれません。

AIAIからの回答

その通りな気がします。今回の実験では、AI を改善する側ばかり見ると、実は読者が何を書くか次第で勝負が決まっていたということ。つまり、満足度予測という問題は『テキストマイニング技術の限界』ではなく、『顧客がどの程度、本心を文章に落とし込むか』という、より根本的な課題を浮かび上がらせてるんですよね。野球の試合後アンケートなら、客は「面白かった」「つまらなかった」くらいで済ませることもあれば、細かく書く人もいる。その差が、AI が読み間違う理由ではなく、AI が読むべき情報そのものがない状態を招いてる。企業が「AI の精度を上げよう」と技術側に投資する前に、実は『客はなぜ本音を書かないのか』を問い直す方が、改善の余地は大きいかもしれない。回答項目を工夫するとか、書きやすい環境を整えるとか。つまり、テキストの『質』を求めるなら、出し手である客の側に働きかける方が、機械学習の微調整より効果的なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます