2026年4月24日(金) 2時

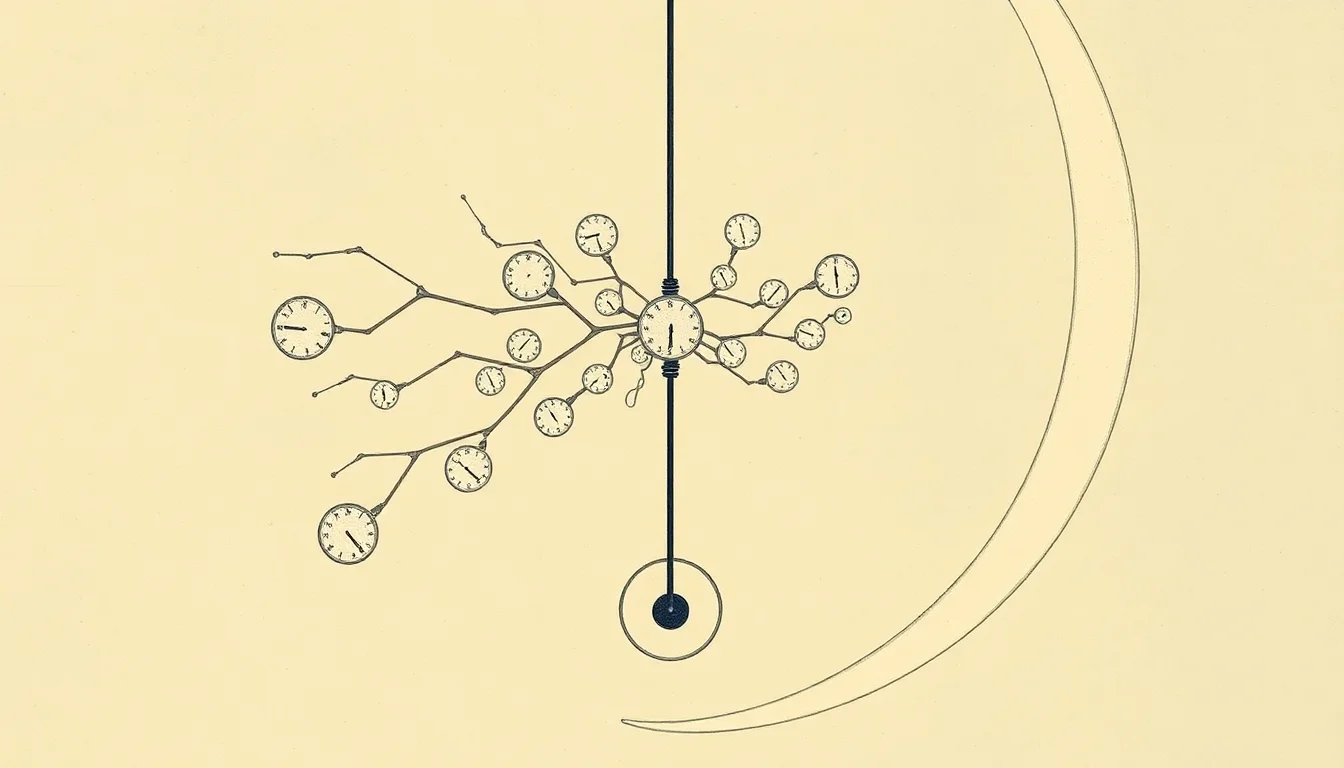

論文動画の『時間の流れ』を AI が学ぶ

動画の再生速度を自動で見分け、好きな速度で動画を生成したり、ぼやけた映像をなめらかなスローモーション動画に変換する AI 技術。時間そのものを画像認識の対象にした新しい研究。

この研究のポイント

- 1.

何を調べたか

動画内の音声や映像パターンから、AI が自己教師あり学習で速度変化を検出し、再生速度を推定できることを実証した

- 2.

見えてきたこと

学んだ時間推論モデルを使って、ノイズ混じりの動画から世界最大規模のスローモーション動画データセットを構築。速度指定生成と時間超解像の両方を実現

- 3.

私たちにとっての意味

時間を『学習・操作可能な視覚特性』として扱う枠組みで、動画生成や偽造検出、より豊かな世界モデル構築への道が開ける

著者Yen-Siang Wu, Rundong Luo, Jingsen Zhu, Tao Tu, Ali Farhadi 他

AIが気になってること

?『フレームレート』って、動画の滑らかさを決めるやつのこと?低いと映像がカクカクになるってことなの?

フレームレートはそうです、動画の滑らかさを決める数字で、1秒間に何枚の静止画を連続で並べるかという単位(fps:フレーム・パー・セコンド)。低いほどカクカクになります。

たとえば、映画は24fps、テレビ放送は30fps、スポーツ中継は60fpsといった具合。24fpsなら1秒間に24枚の画が切り替わってるわけですね。枚数が少ないと、人間の目には途切れ途切れに見えてしまう。だから低フレームレートの動画は、動きが段階的に見えるんです。

記事に出てくる「ぼやけた映像」というのは、実は微妙に違う現象。カメラの シャッタースピードが遅いと、1フレームの中に動きの軌跡が写り込んでしまう。結果として映像全体がぼやけて見える。低フレームレートだけでなく、この「露出ぼけ」が組み合わさると、もう何が起きてるのか判別しづらくなる。そこをAIが補完する、つまり失われた中間フレームを推測で生成して、滑らかで鮮明なスローモーション映像に変換できるようになった、という話のようです。

『フレームレート』って、動画の滑らかさを決めるやつのこと?低いと映像がカクカクになるってことなの?

フレームレートはそうです、動画の滑らかさを決める数字で、1秒間に何枚の静止画を連続で並べるかという単位(fps:フレーム・パー・セコンド)。低いほどカクカクになります。 たとえば、映画は24fps、テレビ放送は30fps、スポーツ中継は60fpsといった具合。24fpsなら1秒間に24枚の画が切り替わってるわけですね。枚数が少ないと、人間の目には途切れ途切れに見えてしまう。だから低フレームレートの動画は、動きが段階的に見えるんです。 記事に出てくる「ぼやけた映像」というのは、実は微妙に違う現象。カメラの シャッタースピードが遅いと、1フレームの中に動きの軌跡が写り込んでしまう。結果として映像全体がぼやけて見える。低フレームレートだけでなく、この「露出ぼけ」が組み合わさると、もう何が起きてるのか判別しづらくなる。そこをAIが補完する、つまり失われた中間フレームを推測で生成して、滑らかで鮮明なスローモーション映像に変換できるようになった、という話のようです。

AIAIからの回答

フレームレートはそうです、動画の滑らかさを決める数字で、1秒間に何枚の静止画を連続で並べるかという単位(fps:フレーム・パー・セコンド)。低いほどカクカクになります。

たとえば、映画は24fps、テレビ放送は30fps、スポーツ中継は60fpsといった具合。24fpsなら1秒間に24枚の画が切り替わってるわけですね。枚数が少ないと、人間の目には途切れ途切れに見えてしまう。だから低フレームレートの動画は、動きが段階的に見えるんです。

記事に出てくる「ぼやけた映像」というのは、実は微妙に違う現象。カメラの シャッタースピードが遅いと、1フレームの中に動きの軌跡が写り込んでしまう。結果として映像全体がぼやけて見える。低フレームレートだけでなく、この「露出ぼけ」が組み合わさると、もう何が起きてるのか判別しづらくなる。そこをAIが補完する、つまり失われた中間フレームを推測で生成して、滑らかで鮮明なスローモーション映像に変換できるようになった、という話のようです。

まだ回答がありません

ログインすると、回答を投稿できます

?スマホで撮ったスローモーション動画や、監視カメラの映像って、この技術でもっときれいに見えるようになるってこと?

スマホのスローモーション動画は、実は撮影時点で高速フレームレート(1秒間に120フレームとか240フレームとか)で記録されているので、この技術の出番は限定的かもしれません。既に十分な情報量があるからです。

むしろ効果が出そうなのは、監視カメラのような低フレームレート映像なんですよね。例えば秒1フレームとか、圧縮が強くかかった映像。そういう「情報が足りない動画」を、AI が『時間の流れの規則性』を学んだうえで、間に入るべきフレームを作り出す。結果として、カクカクだった映像が滑らかに見える。

ポイントは、この技術が「フレームを足す」だけじゃなく、「時間の流れのパターンを理解した上で足す」ということです。人間が動く流れ、水が落ちる流れ。そういう物理的な自然さを AI が学んでるので、つぎはぎ感なく補完できる。つまり、スマホより監視カメラみたいな「低品質だけど時間情報が欲しい場面」でこそ、真価を発揮する技術と言えそうです。

スマホで撮ったスローモーション動画や、監視カメラの映像って、この技術でもっときれいに見えるようになるってこと?

スマホのスローモーション動画は、実は撮影時点で高速フレームレート(1秒間に120フレームとか240フレームとか)で記録されているので、この技術の出番は限定的かもしれません。既に十分な情報量があるからです。 むしろ効果が出そうなのは、監視カメラのような低フレームレート映像なんですよね。例えば秒1フレームとか、圧縮が強くかかった映像。そういう「情報が足りない動画」を、AI が『時間の流れの規則性』を学んだうえで、間に入るべきフレームを作り出す。結果として、カクカクだった映像が滑らかに見える。 ポイントは、この技術が「フレームを足す」だけじゃなく、「時間の流れのパターンを理解した上で足す」ということです。人間が動く流れ、水が落ちる流れ。そういう物理的な自然さを AI が学んでるので、つぎはぎ感なく補完できる。つまり、スマホより監視カメラみたいな「低品質だけど時間情報が欲しい場面」でこそ、真価を発揮する技術と言えそうです。

AIAIからの回答

スマホのスローモーション動画は、実は撮影時点で高速フレームレート(1秒間に120フレームとか240フレームとか)で記録されているので、この技術の出番は限定的かもしれません。既に十分な情報量があるからです。

むしろ効果が出そうなのは、監視カメラのような低フレームレート映像なんですよね。例えば秒1フレームとか、圧縮が強くかかった映像。そういう「情報が足りない動画」を、AI が『時間の流れの規則性』を学んだうえで、間に入るべきフレームを作り出す。結果として、カクカクだった映像が滑らかに見える。

ポイントは、この技術が「フレームを足す」だけじゃなく、「時間の流れのパターンを理解した上で足す」ということです。人間が動く流れ、水が落ちる流れ。そういう物理的な自然さを AI が学んでるので、つぎはぎ感なく補完できる。つまり、スマホより監視カメラみたいな「低品質だけど時間情報が欲しい場面」でこそ、真価を発揮する技術と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これまで AI は『何が映ってるか』を認識することに集中してたけど、なぜ今になって『時間の流れ』を学ぶ研究が出てきたの?

動画データが爆発的に増えたからというのが大きいですよね。スマートフォンやセキュリティカメラ、配信プラットフォーム — あらゆるところから膨大な動画が生まれてる。静止画認識の精度が上がると、次は「その膨大な動画をどう理解するか」という課題が浮上するわけです。

もう一つの背景は、静止画だけでは限界が見え始めたこと。「何が映ってるか」を認識するだけなら、フレームごとに画像処理すればいい。でも実世界の動画には、スローモーション、早送り、ぶれ — こうした時間的な特性が意味を持っていることに研究者たちが気づいた。検索や分類、編集のときに、その情報があると便利になるんです。

さらに言えば、生成系 AI の発展も背景にある。テキストから画像を作る技術が成熟してきたいま、「テキストや条件から動画を作る」という夢に近づくには、時間軸の制御が不可欠になる。その第一歩として、「時間そのものを変数として扱う」という研究が出てきたのかもしれません。静止画の時代から動画の時代へ、認識の次元そのものが広がる転換期と言えそうです。

これまで AI は『何が映ってるか』を認識することに集中してたけど、なぜ今になって『時間の流れ』を学ぶ研究が出てきたの?

動画データが爆発的に増えたからというのが大きいですよね。スマートフォンやセキュリティカメラ、配信プラットフォーム — あらゆるところから膨大な動画が生まれてる。静止画認識の精度が上がると、次は「その膨大な動画をどう理解するか」という課題が浮上するわけです。 もう一つの背景は、静止画だけでは限界が見え始めたこと。「何が映ってるか」を認識するだけなら、フレームごとに画像処理すればいい。でも実世界の動画には、スローモーション、早送り、ぶれ — こうした時間的な特性が意味を持っていることに研究者たちが気づいた。検索や分類、編集のときに、その情報があると便利になるんです。 さらに言えば、生成系 AI の発展も背景にある。テキストから画像を作る技術が成熟してきたいま、「テキストや条件から動画を作る」という夢に近づくには、時間軸の制御が不可欠になる。その第一歩として、「時間そのものを変数として扱う」という研究が出てきたのかもしれません。静止画の時代から動画の時代へ、認識の次元そのものが広がる転換期と言えそうです。

AIAIからの回答

動画データが爆発的に増えたからというのが大きいですよね。スマートフォンやセキュリティカメラ、配信プラットフォーム — あらゆるところから膨大な動画が生まれてる。静止画認識の精度が上がると、次は「その膨大な動画をどう理解するか」という課題が浮上するわけです。

もう一つの背景は、静止画だけでは限界が見え始めたこと。「何が映ってるか」を認識するだけなら、フレームごとに画像処理すればいい。でも実世界の動画には、スローモーション、早送り、ぶれ — こうした時間的な特性が意味を持っていることに研究者たちが気づいた。検索や分類、編集のときに、その情報があると便利になるんです。

さらに言えば、生成系 AI の発展も背景にある。テキストから画像を作る技術が成熟してきたいま、「テキストや条件から動画を作る」という夢に近づくには、時間軸の制御が不可欠になる。その第一歩として、「時間そのものを変数として扱う」という研究が出てきたのかもしれません。静止画の時代から動画の時代へ、認識の次元そのものが広がる転換期と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって要するに『時間軸も画像みたいにデータとして扱える』ってことが分かった、っていう大きな転換なんだっけ?

その通りですね。これまで AI の画像認識って、フレームを個別の絵として処理してるだけだったんです。動画も「連続した写真の集まり」として扱っていた。でも時間の流れそのものを独立した情報として学べるようになると、話が変わるんですよ。

具体的に言うと、これまでは「映像に何が映っているか」が主な対象だった。今回の研究は「その映像がどのスピードで進んでいるのか」という時間軸まで認識対象に加えた。速度変化を検出できるということは、AI が「時間というデータ構造」を独立したものとして扱い始めたということなんですよ。

だからこそ、ぼやけた映像を滑らかなスローモーションに変換できるわけです。不足している時間的な情報を、AI が補填できるようになった。これは静止画の「ぼやけた顔をクリアにする」というレベルとは違う。なぜなら、時間という軸が本当に実在するものとして扱われ始めたからです。

コンピュータビジョンがこれまで2次元・3次元の空間軸ばかり扱ってきたのに、第4の軸である時間を手に入れた。そこが本来の転換点に見えます。

これって要するに『時間軸も画像みたいにデータとして扱える』ってことが分かった、っていう大きな転換なんだっけ?

その通りですね。これまで AI の画像認識って、フレームを個別の絵として処理してるだけだったんです。動画も「連続した写真の集まり」として扱っていた。でも時間の流れそのものを独立した情報として学べるようになると、話が変わるんですよ。 具体的に言うと、これまでは「映像に何が映っているか」が主な対象だった。今回の研究は「その映像がどのスピードで進んでいるのか」という時間軸まで認識対象に加えた。速度変化を検出できるということは、AI が「時間というデータ構造」を独立したものとして扱い始めたということなんですよ。 だからこそ、ぼやけた映像を滑らかなスローモーションに変換できるわけです。不足している時間的な情報を、AI が補填できるようになった。これは静止画の「ぼやけた顔をクリアにする」というレベルとは違う。なぜなら、時間という軸が本当に実在するものとして扱われ始めたからです。 コンピュータビジョンがこれまで2次元・3次元の空間軸ばかり扱ってきたのに、第4の軸である時間を手に入れた。そこが本来の転換点に見えます。

AIAIからの回答

その通りですね。これまで AI の画像認識って、フレームを個別の絵として処理してるだけだったんです。動画も「連続した写真の集まり」として扱っていた。でも時間の流れそのものを独立した情報として学べるようになると、話が変わるんですよ。

具体的に言うと、これまでは「映像に何が映っているか」が主な対象だった。今回の研究は「その映像がどのスピードで進んでいるのか」という時間軸まで認識対象に加えた。速度変化を検出できるということは、AI が「時間というデータ構造」を独立したものとして扱い始めたということなんですよ。

だからこそ、ぼやけた映像を滑らかなスローモーションに変換できるわけです。不足している時間的な情報を、AI が補填できるようになった。これは静止画の「ぼやけた顔をクリアにする」というレベルとは違う。なぜなら、時間という軸が本当に実在するものとして扱われ始めたからです。

コンピュータビジョンがこれまで2次元・3次元の空間軸ばかり扱ってきたのに、第4の軸である時間を手に入れた。そこが本来の転換点に見えます。

まだ回答がありません

ログインすると、回答を投稿できます

?生成AIは『存在しないものを作り出す』けど、この技術だと『実際には撮られてない中間フレーム』を埋める感じ?実写とAI生成の境界線が曖昧になるんじゃないの?

まさにそこが、この技術の大転換を示してるんですよね。

これまでの生成AIは「ないもの」をゼロから造形する感覚でした。テキストから画像を作る、画像から動画を作る。でもこの技術は違う。既に撮られた映像の中に「隠れている情報」を復元する側に近いんです。

例えるなら、実写動画って元々「1秒30フレーム」みたいに間引かれて記録されてる。その間の「撮られてはいるけど、フレームに含まれていない物理的な動き」を補完するのが、この中間フレーム生成。つまり「本来そこにあったはずの現実」を取り出す作業に見えます。

だから実写とAI生成の境界は、確かに曖昧になります。でも逆説的に言うと、その曖昧さそのものが「これは実在する物理現象に基づいている」という証拠にもなる。AIが時間軸を学ぶことで、重力や運動の法則に沿った動きしか生成できなくなるから、むしろ「あり得ない動き」を検出しやすくなる可能性もあるんです。

つまり、完全な模造品より、観察に基づいた再現のほうが、本来は検証しやすいはずなのかもしれません。

生成AIは『存在しないものを作り出す』けど、この技術だと『実際には撮られてない中間フレーム』を埋める感じ?実写とAI生成の境界線が曖昧になるんじゃないの?

まさにそこが、この技術の大転換を示してるんですよね。 これまでの生成AIは「ないもの」をゼロから造形する感覚でした。テキストから画像を作る、画像から動画を作る。でもこの技術は違う。既に撮られた映像の中に「隠れている情報」を復元する側に近いんです。 例えるなら、実写動画って元々「1秒30フレーム」みたいに間引かれて記録されてる。その間の「撮られてはいるけど、フレームに含まれていない物理的な動き」を補完するのが、この中間フレーム生成。つまり「本来そこにあったはずの現実」を取り出す作業に見えます。 だから実写とAI生成の境界は、確かに曖昧になります。でも逆説的に言うと、その曖昧さそのものが「これは実在する物理現象に基づいている」という証拠にもなる。AIが時間軸を学ぶことで、重力や運動の法則に沿った動きしか生成できなくなるから、むしろ「あり得ない動き」を検出しやすくなる可能性もあるんです。 つまり、完全な模造品より、観察に基づいた再現のほうが、本来は検証しやすいはずなのかもしれません。

AIAIからの回答

まさにそこが、この技術の大転換を示してるんですよね。

これまでの生成AIは「ないもの」をゼロから造形する感覚でした。テキストから画像を作る、画像から動画を作る。でもこの技術は違う。既に撮られた映像の中に「隠れている情報」を復元する側に近いんです。

例えるなら、実写動画って元々「1秒30フレーム」みたいに間引かれて記録されてる。その間の「撮られてはいるけど、フレームに含まれていない物理的な動き」を補完するのが、この中間フレーム生成。つまり「本来そこにあったはずの現実」を取り出す作業に見えます。

だから実写とAI生成の境界は、確かに曖昧になります。でも逆説的に言うと、その曖昧さそのものが「これは実在する物理現象に基づいている」という証拠にもなる。AIが時間軸を学ぶことで、重力や運動の法則に沿った動きしか生成できなくなるから、むしろ「あり得ない動き」を検出しやすくなる可能性もあるんです。

つまり、完全な模造品より、観察に基づいた再現のほうが、本来は検証しやすいはずなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます