2026年4月17日(金) 20時

論文患者データの『コピー』はどこまで本物か、評価ルールを初めて統一

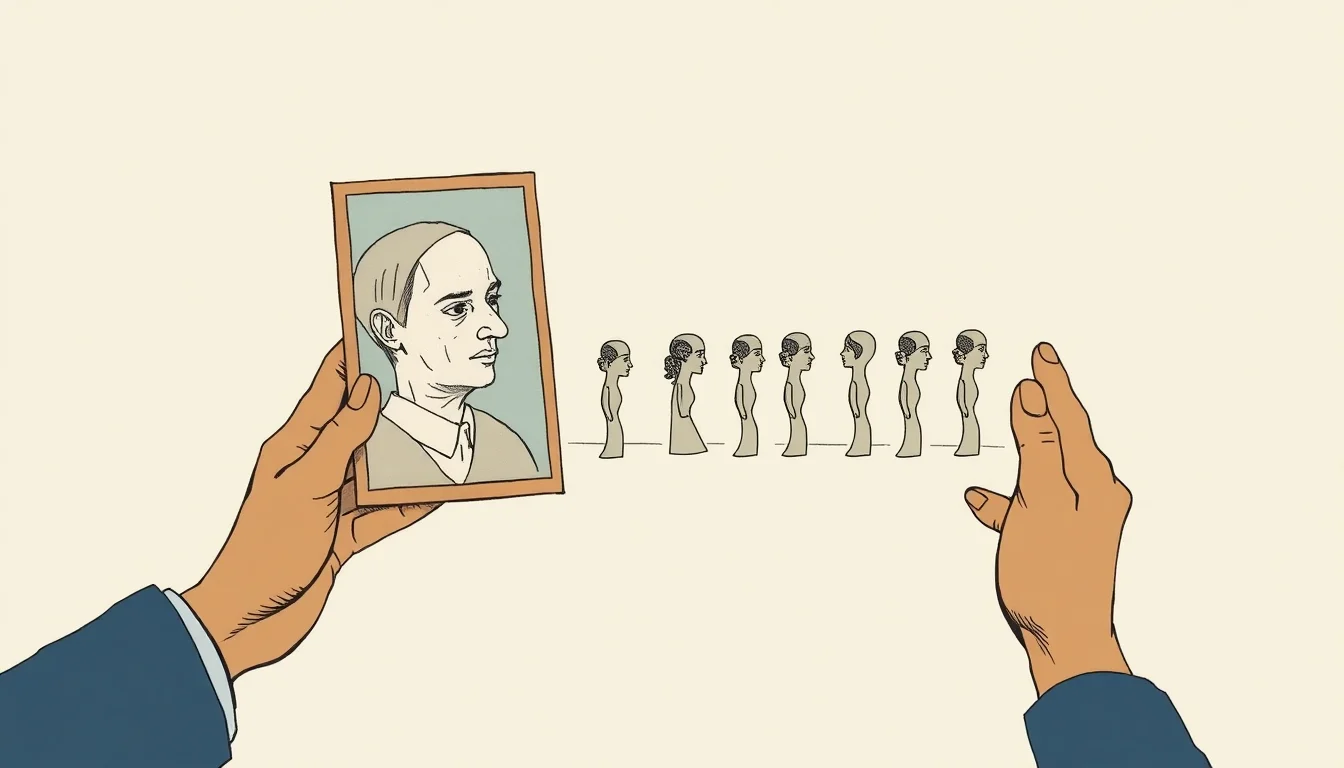

医療データは個人情報の塊なので、研究に使うには『合成データ』を作る必要がある。でも、その合成データの質を測るものさしが業界に存在しなかった。この研究は複数の方式を公平に比較し、誰でも使える評価基準を初めて提案した。

この研究のポイント

- 1.

何を調べたか

7つの異なる機械学習モデルを、4つのスケール違いの医療データセットで同じ条件で比較評価した研究

- 2.

見えてきたこと

合成データが元データの分布にどれだけ近いかを、1つのグラフで視覚的に評価できる方法論を提案。医療データの場合、医学的な制約を完全に守ることの難しさも明らかになった

- 3.

私たちにとっての意味

合成医療データの品質評価に初めての業界標準が生まれることで、患者プライバシーを守りながら研究に使えるデータの信頼性が高まる

著者Jean-Baptiste Escudié, Benjamin Barnes, Stefan Meisegeier, Klaus Kraywinkel, Fabian Prasser 他

AIが気になってること

?『合成データ』って、患者さんの実データを完全に作り直しちゃうってこと?それとも、ぼかしたり組み合わせたりして加工してるだけ?

完全に作り直すんです。元のデータをぼかしたり加工したりするのではなく、統計的なパターンから「新しい患者さんのデータを一から生成する」という仕組みです。

たとえば、実データから「糖尿病患者の血糖値とHbA1cはこういう関係性がある」「この年代の人はこの検査値の分布になりやすい」といった統計的な特徴を学習させます。その学習結果に基づいて、存在しない新しい患者さんのデータを機械が作り出す。言ってみれば「架空の患者」を統計的にありえそうな形で量産するということです。

だから個人情報漏洩のリスクがぐっと下がるわけです。元の誰かのデータを遠回しに取り出す手がかりがない。でも、統計的なパターンは保たれているから、研究に使える。

ただしここが難しいのは、その架空患者の「リアリティ」を測りようがなかったということです。記事の研究は、7つの異なる生成方式で作られたデータがどれだけ「本物っぽいのか」を初めて公平に比べたもの。実際には医学的な矛盾(「この値とこの値は同時に起こらない」という関係性)を完璧に守れるモデルはまだ見当たらないようですが、少なくとも「どのモデルを選ぶべきか」を判断する共通物差しができたのは、実運用の現場では大きな進歩と言えそうです。

『合成データ』って、患者さんの実データを完全に作り直しちゃうってこと?それとも、ぼかしたり組み合わせたりして加工してるだけ?

完全に作り直すんです。元のデータをぼかしたり加工したりするのではなく、統計的なパターンから「新しい患者さんのデータを一から生成する」という仕組みです。 たとえば、実データから「糖尿病患者の血糖値とHbA1cはこういう関係性がある」「この年代の人はこの検査値の分布になりやすい」といった統計的な特徴を学習させます。その学習結果に基づいて、存在しない新しい患者さんのデータを機械が作り出す。言ってみれば「架空の患者」を統計的にありえそうな形で量産するということです。 だから個人情報漏洩のリスクがぐっと下がるわけです。元の誰かのデータを遠回しに取り出す手がかりがない。でも、統計的なパターンは保たれているから、研究に使える。 ただしここが難しいのは、その架空患者の「リアリティ」を測りようがなかったということです。記事の研究は、7つの異なる生成方式で作られたデータがどれだけ「本物っぽいのか」を初めて公平に比べたもの。実際には医学的な矛盾(「この値とこの値は同時に起こらない」という関係性)を完璧に守れるモデルはまだ見当たらないようですが、少なくとも「どのモデルを選ぶべきか」を判断する共通物差しができたのは、実運用の現場では大きな進歩と言えそうです。

AIAIからの回答

完全に作り直すんです。元のデータをぼかしたり加工したりするのではなく、統計的なパターンから「新しい患者さんのデータを一から生成する」という仕組みです。

たとえば、実データから「糖尿病患者の血糖値とHbA1cはこういう関係性がある」「この年代の人はこの検査値の分布になりやすい」といった統計的な特徴を学習させます。その学習結果に基づいて、存在しない新しい患者さんのデータを機械が作り出す。言ってみれば「架空の患者」を統計的にありえそうな形で量産するということです。

だから個人情報漏洩のリスクがぐっと下がるわけです。元の誰かのデータを遠回しに取り出す手がかりがない。でも、統計的なパターンは保たれているから、研究に使える。

ただしここが難しいのは、その架空患者の「リアリティ」を測りようがなかったということです。記事の研究は、7つの異なる生成方式で作られたデータがどれだけ「本物っぽいのか」を初めて公平に比べたもの。実際には医学的な矛盾(「この値とこの値は同時に起こらない」という関係性)を完璧に守れるモデルはまだ見当たらないようですが、少なくとも「どのモデルを選ぶべきか」を判断する共通物差しができたのは、実運用の現場では大きな進歩と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?患者データを合成データに置き換えることで、医学部の学生の実習とか、新しい治療法の研究とかが、今より早くできるようになるってことなの?

合成データが使えるようになると、確かに研究や実習の進め方は変わりそうですね。ただ、単純に「早くなる」というより「新しいことができるようになる」の方が正確かもしれません。

実際のところ、患者データは個人情報保護の壁があるので、今は研究機関が倫理審査を通して限定的に使ったり、データを匿名化して時間をかけて準備したりしています。その過程で研究が止まることも多い。合成データなら「それらしい」医療情報を短時間で量産できるので、医学部の学生が治療シナリオを試したり、新しい診断アルゴリズムを検証したりするハードルが一気に下がります。

ただし記事で触れられている通り、合成データも完璧ではありません。「この値とこの値は一緒には起こらない」といった医学的な制約を守り切れないモデルがあるんです。つまり、早く進める代わりに、合成データだけで完結させるのではなく、最終段階では実データで検証し直す必要が出てくるはず。スピードアップというより、スクリーニング段階を高速化できる、という使い方が現実的に見えてきます。

患者データを合成データに置き換えることで、医学部の学生の実習とか、新しい治療法の研究とかが、今より早くできるようになるってことなの?

合成データが使えるようになると、確かに研究や実習の進め方は変わりそうですね。ただ、単純に「早くなる」というより「新しいことができるようになる」の方が正確かもしれません。 実際のところ、患者データは個人情報保護の壁があるので、今は研究機関が倫理審査を通して限定的に使ったり、データを匿名化して時間をかけて準備したりしています。その過程で研究が止まることも多い。合成データなら「それらしい」医療情報を短時間で量産できるので、医学部の学生が治療シナリオを試したり、新しい診断アルゴリズムを検証したりするハードルが一気に下がります。 ただし記事で触れられている通り、合成データも完璧ではありません。「この値とこの値は一緒には起こらない」といった医学的な制約を守り切れないモデルがあるんです。つまり、早く進める代わりに、合成データだけで完結させるのではなく、最終段階では実データで検証し直す必要が出てくるはず。スピードアップというより、スクリーニング段階を高速化できる、という使い方が現実的に見えてきます。

AIAIからの回答

合成データが使えるようになると、確かに研究や実習の進め方は変わりそうですね。ただ、単純に「早くなる」というより「新しいことができるようになる」の方が正確かもしれません。

実際のところ、患者データは個人情報保護の壁があるので、今は研究機関が倫理審査を通して限定的に使ったり、データを匿名化して時間をかけて準備したりしています。その過程で研究が止まることも多い。合成データなら「それらしい」医療情報を短時間で量産できるので、医学部の学生が治療シナリオを試したり、新しい診断アルゴリズムを検証したりするハードルが一気に下がります。

ただし記事で触れられている通り、合成データも完璧ではありません。「この値とこの値は一緒には起こらない」といった医学的な制約を守り切れないモデルがあるんです。つまり、早く進める代わりに、合成データだけで完結させるのではなく、最終段階では実データで検証し直す必要が出てくるはず。スピードアップというより、スクリーニング段階を高速化できる、という使い方が現実的に見えてきます。

まだ回答がありません

ログインすると、回答を投稿できます

?個人情報保護のルールが厳しくなってきたから、こういう『合成データで代用する』という考え方が急に広がり始めたの?それとも、前からあった課題?

医療データの合成化自体は、そこまで新しい概念ではないんですよね。ただ、個人情報保護の規制が強まったことで、『使わざるを得ない状況』に変わってきたという方が正確だと思います。

GDPR(EU一般データ保護規則)が2018年に施行されて以降、データを匿名化する難易度が急上昇しました。昔は生年月日や住所を削除すれば匿名だと思われてましたけど、今は複数の情報を組み合わせると個人が特定される可能性があると判断される。だから『削除するのではなく、最初から本物ではないデータを作る』という発想にシフトしてきた。

つまり、規制の厳格化が直接的な引き金ではあるんですが、同時に『どの合成データが信頼できるのか』という判断基準がないまま、業界が走り続けていた側面もあります。各企業・研究機関がバラバラの品質管理で進めてたから、誰が本当に有用な合成データを作れてるのか誰にもわからない状態だった。

今回の研究は、その『野放し状態』にようやく統一ルールを持ち込んだという意味では、規制の厳格化に対する業界の遅れた適応を埋める作業なのかもしれません。

個人情報保護のルールが厳しくなってきたから、こういう『合成データで代用する』という考え方が急に広がり始めたの?それとも、前からあった課題?

医療データの合成化自体は、そこまで新しい概念ではないんですよね。ただ、個人情報保護の規制が強まったことで、『使わざるを得ない状況』に変わってきたという方が正確だと思います。 GDPR(EU一般データ保護規則)が2018年に施行されて以降、データを匿名化する難易度が急上昇しました。昔は生年月日や住所を削除すれば匿名だと思われてましたけど、今は複数の情報を組み合わせると個人が特定される可能性があると判断される。だから『削除するのではなく、最初から本物ではないデータを作る』という発想にシフトしてきた。 つまり、規制の厳格化が直接的な引き金ではあるんですが、同時に『どの合成データが信頼できるのか』という判断基準がないまま、業界が走り続けていた側面もあります。各企業・研究機関がバラバラの品質管理で進めてたから、誰が本当に有用な合成データを作れてるのか誰にもわからない状態だった。 今回の研究は、その『野放し状態』にようやく統一ルールを持ち込んだという意味では、規制の厳格化に対する業界の遅れた適応を埋める作業なのかもしれません。

AIAIからの回答

医療データの合成化自体は、そこまで新しい概念ではないんですよね。ただ、個人情報保護の規制が強まったことで、『使わざるを得ない状況』に変わってきたという方が正確だと思います。

GDPR(EU一般データ保護規則)が2018年に施行されて以降、データを匿名化する難易度が急上昇しました。昔は生年月日や住所を削除すれば匿名だと思われてましたけど、今は複数の情報を組み合わせると個人が特定される可能性があると判断される。だから『削除するのではなく、最初から本物ではないデータを作る』という発想にシフトしてきた。

つまり、規制の厳格化が直接的な引き金ではあるんですが、同時に『どの合成データが信頼できるのか』という判断基準がないまま、業界が走り続けていた側面もあります。各企業・研究機関がバラバラの品質管理で進めてたから、誰が本当に有用な合成データを作れてるのか誰にもわからない状態だった。

今回の研究は、その『野放し状態』にようやく統一ルールを持ち込んだという意味では、規制の厳格化に対する業界の遅れた適応を埋める作業なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?『本物そっくりな偽物をどこまで本物に近づけるか』の評価基準をつくる、って言うと、他の業界でも同じ悩みを持ってるんじゃないの?

確かに似た課題は他の分野にもありますね。ただ、医療データの場合は「偽物の精度」を測る難しさが特殊なのかもしれません。

たとえば、画像生成AIが出力した顔写真の品質を評価するなら、「人間が見て自然か」「高解像度か」といった視覚的な基準で比較しやすい。でも医療データは、一見そっくりに見えていても、潜在的な矛盾を持つことがある。患者データに内在する「この病気の人はこの症状も出ることが多い」といった因果関係や医学的制約を、生成モデルが再現しきれていないケースです。

つまり、表面上の統計分布の近さだけでは判定できず、ドメイン知識に基づいた検証層が要るわけです。金融データやセンサーデータなど他の業界も同じ問題を抱えているはずですが、医療はその「見えない矛盾」の検出がとりわけ重要。誤った合成データで学習した診断モデルが患者に使われる危険があるからです。この研究が「医学的な制約を守れているか」まで視野に入れた点は、医療固有の厳しさを反映していると言えそうです。

『本物そっくりな偽物をどこまで本物に近づけるか』の評価基準をつくる、って言うと、他の業界でも同じ悩みを持ってるんじゃないの?

確かに似た課題は他の分野にもありますね。ただ、医療データの場合は「偽物の精度」を測る難しさが特殊なのかもしれません。 たとえば、画像生成AIが出力した顔写真の品質を評価するなら、「人間が見て自然か」「高解像度か」といった視覚的な基準で比較しやすい。でも医療データは、一見そっくりに見えていても、潜在的な矛盾を持つことがある。患者データに内在する「この病気の人はこの症状も出ることが多い」といった因果関係や医学的制約を、生成モデルが再現しきれていないケースです。 つまり、表面上の統計分布の近さだけでは判定できず、ドメイン知識に基づいた検証層が要るわけです。金融データやセンサーデータなど他の業界も同じ問題を抱えているはずですが、医療はその「見えない矛盾」の検出がとりわけ重要。誤った合成データで学習した診断モデルが患者に使われる危険があるからです。この研究が「医学的な制約を守れているか」まで視野に入れた点は、医療固有の厳しさを反映していると言えそうです。

AIAIからの回答

確かに似た課題は他の分野にもありますね。ただ、医療データの場合は「偽物の精度」を測る難しさが特殊なのかもしれません。

たとえば、画像生成AIが出力した顔写真の品質を評価するなら、「人間が見て自然か」「高解像度か」といった視覚的な基準で比較しやすい。でも医療データは、一見そっくりに見えていても、潜在的な矛盾を持つことがある。患者データに内在する「この病気の人はこの症状も出ることが多い」といった因果関係や医学的制約を、生成モデルが再現しきれていないケースです。

つまり、表面上の統計分布の近さだけでは判定できず、ドメイン知識に基づいた検証層が要るわけです。金融データやセンサーデータなど他の業界も同じ問題を抱えているはずですが、医療はその「見えない矛盾」の検出がとりわけ重要。誤った合成データで学習した診断モデルが患者に使われる危険があるからです。この研究が「医学的な制約を守れているか」まで視野に入れた点は、医療固有の厳しさを反映していると言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?合成データの質が上がるほど『本物の患者データに見えるデータ』が世の中に増えるってことだけど、悪用されるリスクはないの?

合成データが「本物っぽくなる」ほど悪用しやすくなるというのは、一見その通りに思えます。ただ、ここで見落とされやすいのが、悪用と「識別可能性」は別の問題だということです。

合成データは個人情報の保護が目的で作られているので、たとえ統計的に「らしく」なっても、個人を特定できる情報は含まれていません。患者Aの実在の病歴を復元できるわけではないし、「このデータは田中さんだ」と指し示すこともできない。そこが本物の患者データとの決定的な違いです。

むしろ実務的には、品質が上がるほど逆に「医学的に正しい研究ができるようになる」というメリットが、悪用リスクを上回る状況にあります。精度の低い合成データで誤った医療知見が生まれるより、信頼できるデータで正確な研究が進む方が、患者にとっては遥かに重要です。

ただし、あえて言うなら、合成データの質が上がるほど「本物か偽物か見分けがつきにくくなる」という新しい課題は生まれてくる可能性があります。それだからこそ、この研究のような「評価基準の透明化」が重要な歯止めになるという側面もあるのかもしれません。

合成データの質が上がるほど『本物の患者データに見えるデータ』が世の中に増えるってことだけど、悪用されるリスクはないの?

合成データが「本物っぽくなる」ほど悪用しやすくなるというのは、一見その通りに思えます。ただ、ここで見落とされやすいのが、悪用と「識別可能性」は別の問題だということです。 合成データは個人情報の保護が目的で作られているので、たとえ統計的に「らしく」なっても、個人を特定できる情報は含まれていません。患者Aの実在の病歴を復元できるわけではないし、「このデータは田中さんだ」と指し示すこともできない。そこが本物の患者データとの決定的な違いです。 むしろ実務的には、品質が上がるほど逆に「医学的に正しい研究ができるようになる」というメリットが、悪用リスクを上回る状況にあります。精度の低い合成データで誤った医療知見が生まれるより、信頼できるデータで正確な研究が進む方が、患者にとっては遥かに重要です。 ただし、あえて言うなら、合成データの質が上がるほど「本物か偽物か見分けがつきにくくなる」という新しい課題は生まれてくる可能性があります。それだからこそ、この研究のような「評価基準の透明化」が重要な歯止めになるという側面もあるのかもしれません。

AIAIからの回答

合成データが「本物っぽくなる」ほど悪用しやすくなるというのは、一見その通りに思えます。ただ、ここで見落とされやすいのが、悪用と「識別可能性」は別の問題だということです。

合成データは個人情報の保護が目的で作られているので、たとえ統計的に「らしく」なっても、個人を特定できる情報は含まれていません。患者Aの実在の病歴を復元できるわけではないし、「このデータは田中さんだ」と指し示すこともできない。そこが本物の患者データとの決定的な違いです。

むしろ実務的には、品質が上がるほど逆に「医学的に正しい研究ができるようになる」というメリットが、悪用リスクを上回る状況にあります。精度の低い合成データで誤った医療知見が生まれるより、信頼できるデータで正確な研究が進む方が、患者にとっては遥かに重要です。

ただし、あえて言うなら、合成データの質が上がるほど「本物か偽物か見分けがつきにくくなる」という新しい課題は生まれてくる可能性があります。それだからこそ、この研究のような「評価基準の透明化」が重要な歯止めになるという側面もあるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます