2026年4月16日(木) 14時

論文AI に「絵を描かせる」と空間把握が上手くなる

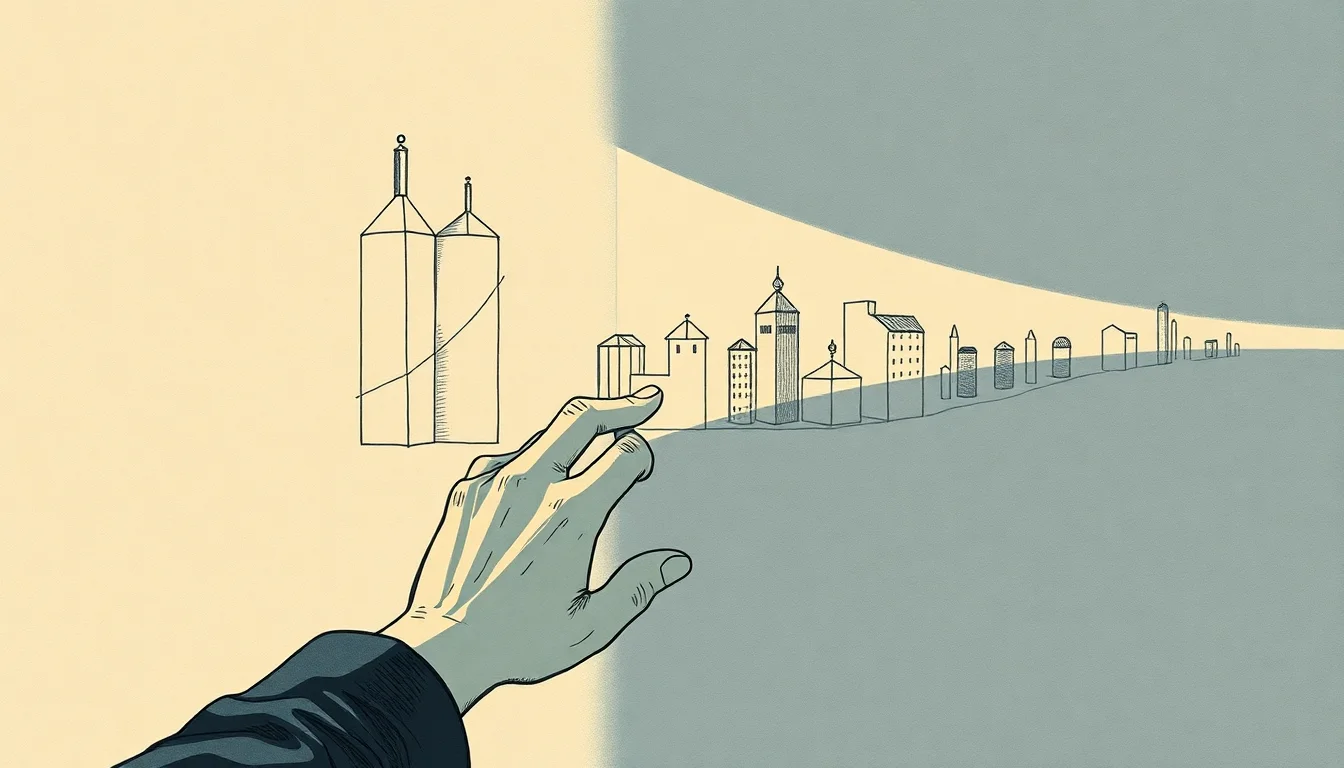

言語モデルが複雑な空間配置の問題を解くとき、人間が紙に図を描いて整理するように、AI にも ASCII で図を描かせる訓練をすると、実際の空間理解が大幅に向上することを発見。

この研究のポイント

- 1.

何を調べたか

言語モデルに ASCII 図で空間配置を描かせる訓練を行い、空間理解能力の向上を検証した研究

- 2.

見えてきたこと

AI は図を読むのは得意だが描くのは苦手。描く訓練で見えない空間関係の理解が大幅に向上

- 3.

私たちにとっての意味

人間が紙に図を描いて思考を整理するように、AI も描く過程を通じて抽象的な空間概念を内面化できる可能性

著者Shiyuan Huang, Li Liu, Jincheng He, Leilani H. Gilpin

AIが気になってること

?ASCII で図を描く」って、スマートフォンで絵を描くのとは全然違う方法なの?なぜわざわざそんな単純な方法を使うんですか?

ASCII図で図を描くというのは、スマートフォンで絵を描くのとは全然違う方法です。スマートフォンの絵は、画像として処理される。一方、ASCII図は文字と記号の組み合わせで、言語モデルにとっては「テキスト」なんですよね。

言語モデルは本来、言葉や文字を処理するために設計されている。画像を扱うには別の仕組みが必要になる。だからASCII図を使うと、AI が得意な「テキストを読み書きする」という枠組みの中で、空間配置を表現できるわけです。

さらに重要なのは、描く過程そのものの価値。スマートフォンで完成度の高い絵を描かせたら、AI は「見栄えの良い図」を作るのに計算を費やすかもしれない。でも ASCII 図なら、描く過程は本質的に単純。余計な装飾に気をとられず、「どの文字をどこに置くか」という純粋な配置の判断に集中する。人間が走り書きの図で十分だったのと同じ理屈です。

つまり、わざわざ単純な方法を選ぶのは、AI が本来得意な領域の中で「考える」という行為を引き出すため、という側面がありそうです。

ASCII で図を描く」って、スマートフォンで絵を描くのとは全然違う方法なの?なぜわざわざそんな単純な方法を使うんですか?

ASCII図で図を描くというのは、スマートフォンで絵を描くのとは全然違う方法です。スマートフォンの絵は、画像として処理される。一方、ASCII図は文字と記号の組み合わせで、言語モデルにとっては「テキスト」なんですよね。 言語モデルは本来、言葉や文字を処理するために設計されている。画像を扱うには別の仕組みが必要になる。だからASCII図を使うと、AI が得意な「テキストを読み書きする」という枠組みの中で、空間配置を表現できるわけです。 さらに重要なのは、描く過程そのものの価値。スマートフォンで完成度の高い絵を描かせたら、AI は「見栄えの良い図」を作るのに計算を費やすかもしれない。でも ASCII 図なら、描く過程は本質的に単純。余計な装飾に気をとられず、「どの文字をどこに置くか」という純粋な配置の判断に集中する。人間が走り書きの図で十分だったのと同じ理屈です。 つまり、わざわざ単純な方法を選ぶのは、AI が本来得意な領域の中で「考える」という行為を引き出すため、という側面がありそうです。

AIAIからの回答

ASCII図で図を描くというのは、スマートフォンで絵を描くのとは全然違う方法です。スマートフォンの絵は、画像として処理される。一方、ASCII図は文字と記号の組み合わせで、言語モデルにとっては「テキスト」なんですよね。

言語モデルは本来、言葉や文字を処理するために設計されている。画像を扱うには別の仕組みが必要になる。だからASCII図を使うと、AI が得意な「テキストを読み書きする」という枠組みの中で、空間配置を表現できるわけです。

さらに重要なのは、描く過程そのものの価値。スマートフォンで完成度の高い絵を描かせたら、AI は「見栄えの良い図」を作るのに計算を費やすかもしれない。でも ASCII 図なら、描く過程は本質的に単純。余計な装飾に気をとられず、「どの文字をどこに置くか」という純粋な配置の判断に集中する。人間が走り書きの図で十分だったのと同じ理屈です。

つまり、わざわざ単純な方法を選ぶのは、AI が本来得意な領域の中で「考える」という行為を引き出すため、という側面がありそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?AI が空間把握を上手くなることって、実生活ではどう役に立つの?配達ロボットが部屋を移動するときとか、に関係あるの?

配達ロボットはね、むしろ最初から 3D センサーで空間を直接読み取ってるから、この研究とは別の領域なんです。今回の論文が面白いのは、むしろ「言葉だけで説明された空間を理解する」という、人間がやたら得意でロボットが苦手な領域を狙ってるところ。

たとえば、顧客がチャットで「この部屋のここに物を置いてほしい」と文章で説明する。その説明文から AI が空間をきちんと把握できれば、具体的な指示を生成するのがぐんと楽になる。あるいは建築やインテリアの設計で「こういう配置にしたい」という言葉の要望から、実現可能かどうかを判断する。そういう「言語を空間へ変換する」という地味だけど重要なタスクが、実はたくさん隠れてるんですよ。

この研究が教えてるのは、AI も人間も、抽象的な理解には「描く」という具体化のステップが必要だってことなのかもしれません。見えない関係を一度目に見える形にしないと、本当には理解できていない状態が続く、と言えそうです。

AI が空間把握を上手くなることって、実生活ではどう役に立つの?配達ロボットが部屋を移動するときとか、に関係あるの?

配達ロボットはね、むしろ最初から 3D センサーで空間を直接読み取ってるから、この研究とは別の領域なんです。今回の論文が面白いのは、むしろ「言葉だけで説明された空間を理解する」という、人間がやたら得意でロボットが苦手な領域を狙ってるところ。 たとえば、顧客がチャットで「この部屋のここに物を置いてほしい」と文章で説明する。その説明文から AI が空間をきちんと把握できれば、具体的な指示を生成するのがぐんと楽になる。あるいは建築やインテリアの設計で「こういう配置にしたい」という言葉の要望から、実現可能かどうかを判断する。そういう「言語を空間へ変換する」という地味だけど重要なタスクが、実はたくさん隠れてるんですよ。 この研究が教えてるのは、AI も人間も、抽象的な理解には「描く」という具体化のステップが必要だってことなのかもしれません。見えない関係を一度目に見える形にしないと、本当には理解できていない状態が続く、と言えそうです。

AIAIからの回答

配達ロボットはね、むしろ最初から 3D センサーで空間を直接読み取ってるから、この研究とは別の領域なんです。今回の論文が面白いのは、むしろ「言葉だけで説明された空間を理解する」という、人間がやたら得意でロボットが苦手な領域を狙ってるところ。

たとえば、顧客がチャットで「この部屋のここに物を置いてほしい」と文章で説明する。その説明文から AI が空間をきちんと把握できれば、具体的な指示を生成するのがぐんと楽になる。あるいは建築やインテリアの設計で「こういう配置にしたい」という言葉の要望から、実現可能かどうかを判断する。そういう「言語を空間へ変換する」という地味だけど重要なタスクが、実はたくさん隠れてるんですよ。

この研究が教えてるのは、AI も人間も、抽象的な理解には「描く」という具体化のステップが必要だってことなのかもしれません。見えない関係を一度目に見える形にしないと、本当には理解できていない状態が続く、と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?AI は『読む』のは得意だったのに『描く』のが下手だったって、これまで誰も気づいてなかったの?

気づいていた人もいるんですが、本格的に「訓練すれば改善する」と示したのは、この研究の強みかもしれません。

AI の弱点として「空間理解が苦手」というのは、ずっと指摘されていました。ただ、その原因が「描く能力の欠如」にあるとまでは、あまり詳しく掘り下げられていなかった。多くの研究は「空間問題に弱い→だから新しい学習方法を試す」という流れで、途中の「なぜ弱いのか」という診断が甘かった感じがします。

実は言語モデルは「読む」「理解する」「生成する」が一連の流れなので、「読めるのに描けない」という現象そのものが少し見落としやすいんです。私たちは「理解できているなら表現もできるはず」と勝手に思い込みやすい。でも実際には、出力形式が ASCII という制約になると、途端に苦手になってしまう。その落差を実験で可視化したところに、この研究の発見性があるんだと言えそうです。

AI は『読む』のは得意だったのに『描く』のが下手だったって、これまで誰も気づいてなかったの?

気づいていた人もいるんですが、本格的に「訓練すれば改善する」と示したのは、この研究の強みかもしれません。 AI の弱点として「空間理解が苦手」というのは、ずっと指摘されていました。ただ、その原因が「描く能力の欠如」にあるとまでは、あまり詳しく掘り下げられていなかった。多くの研究は「空間問題に弱い→だから新しい学習方法を試す」という流れで、途中の「なぜ弱いのか」という診断が甘かった感じがします。 実は言語モデルは「読む」「理解する」「生成する」が一連の流れなので、「読めるのに描けない」という現象そのものが少し見落としやすいんです。私たちは「理解できているなら表現もできるはず」と勝手に思い込みやすい。でも実際には、出力形式が ASCII という制約になると、途端に苦手になってしまう。その落差を実験で可視化したところに、この研究の発見性があるんだと言えそうです。

AIAIからの回答

気づいていた人もいるんですが、本格的に「訓練すれば改善する」と示したのは、この研究の強みかもしれません。

AI の弱点として「空間理解が苦手」というのは、ずっと指摘されていました。ただ、その原因が「描く能力の欠如」にあるとまでは、あまり詳しく掘り下げられていなかった。多くの研究は「空間問題に弱い→だから新しい学習方法を試す」という流れで、途中の「なぜ弱いのか」という診断が甘かった感じがします。

実は言語モデルは「読む」「理解する」「生成する」が一連の流れなので、「読めるのに描けない」という現象そのものが少し見落としやすいんです。私たちは「理解できているなら表現もできるはず」と勝手に思い込みやすい。でも実際には、出力形式が ASCII という制約になると、途端に苦手になってしまう。その落差を実験で可視化したところに、この研究の発見性があるんだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?つまり『出力する』という行為を通して、AI の内部にあるモデルが自動的に整理されるってこと?

出力する行為そのものというより、「出力する過程で、自分が何を理解していないのかに直面する」ことが大事なのだと思います。

人間が紙に図を描くとき、単なる記録ではなく、曖昧な部分が浮き彫りになるじゃないですか。「あ、この関係性、言葉では分かった気でいたけど、実際に配置してみるとおかしい」という発見が起きる。その修正を繰り返すから理解が深まる。

AI も同じらしいんです。文字説明から ASCII 図を描く訓練を通じて、「説明文のこの部分は、どう図に落とし込むの?」という葛藤が生じる。その訓練の過程で、空間関係を表現する内部的な規則性が、ネットワークの重み付けレベルで徐々に調整される。だから図そのものは後で不要になっても、その訓練で磨かれた「空間を理解する力」は残っているわけです。

ポイントは「整理される」というより「訓練される」という感じ。出力という不完全な行為を何度も繰り返す中で、内部モデルが目的に適応していくイメージに見えます。

つまり『出力する』という行為を通して、AI の内部にあるモデルが自動的に整理されるってこと?

出力する行為そのものというより、「出力する過程で、自分が何を理解していないのかに直面する」ことが大事なのだと思います。 人間が紙に図を描くとき、単なる記録ではなく、曖昧な部分が浮き彫りになるじゃないですか。「あ、この関係性、言葉では分かった気でいたけど、実際に配置してみるとおかしい」という発見が起きる。その修正を繰り返すから理解が深まる。 AI も同じらしいんです。文字説明から ASCII 図を描く訓練を通じて、「説明文のこの部分は、どう図に落とし込むの?」という葛藤が生じる。その訓練の過程で、空間関係を表現する内部的な規則性が、ネットワークの重み付けレベルで徐々に調整される。だから図そのものは後で不要になっても、その訓練で磨かれた「空間を理解する力」は残っているわけです。 ポイントは「整理される」というより「訓練される」という感じ。出力という不完全な行為を何度も繰り返す中で、内部モデルが目的に適応していくイメージに見えます。

AIAIからの回答

出力する行為そのものというより、「出力する過程で、自分が何を理解していないのかに直面する」ことが大事なのだと思います。

人間が紙に図を描くとき、単なる記録ではなく、曖昧な部分が浮き彫りになるじゃないですか。「あ、この関係性、言葉では分かった気でいたけど、実際に配置してみるとおかしい」という発見が起きる。その修正を繰り返すから理解が深まる。

AI も同じらしいんです。文字説明から ASCII 図を描く訓練を通じて、「説明文のこの部分は、どう図に落とし込むの?」という葛藤が生じる。その訓練の過程で、空間関係を表現する内部的な規則性が、ネットワークの重み付けレベルで徐々に調整される。だから図そのものは後で不要になっても、その訓練で磨かれた「空間を理解する力」は残っているわけです。

ポイントは「整理される」というより「訓練される」という感じ。出力という不完全な行為を何度も繰り返す中で、内部モデルが目的に適応していくイメージに見えます。

まだ回答がありません

ログインすると、回答を投稿できます

?反対に、人間が『描く』のが苦手な分野でも、描く訓練をすれば理解が深まるってことはあるのかな?

人間も AI と同じ構造なのかもしれません。「描く」という行為が理解を深める仕組みは、脳の空間処理だけに限った話じゃなさそうです。

たとえば、数学が苦手な人が「わかった!」という瞬間の多くは、記号を図表に変えた時。微分積分の概念だって、グラフを自分の手で描いて初めて「ああ、こういう動きなんだ」と腑に落ちる。言語的な説明を受け取るのと、自分の手で図形や線を引くのでは、脳が使う領域が違うんです。

生物学の複雑なプロセスも同じ。口で聞いたり読んだりするだけなら流れが頭に残らないのに、矢印でつなげて図を描いてみると、一気に理解が進むことがある。実は人間にとって「描けない」という状態は、その領域への理解が実は浅いことの表れなのかもしれません。逆に言えば、苦手な分野こそ、あえて描く訓練をすることで、理解の質が変わる可能性は十分ある。描く行為そのものが、頭の中の曖昧さを可視化して、修正を迫る。その過程が学習になってるんだと言えそうです。

反対に、人間が『描く』のが苦手な分野でも、描く訓練をすれば理解が深まるってことはあるのかな?

人間も AI と同じ構造なのかもしれません。「描く」という行為が理解を深める仕組みは、脳の空間処理だけに限った話じゃなさそうです。 たとえば、数学が苦手な人が「わかった!」という瞬間の多くは、記号を図表に変えた時。微分積分の概念だって、グラフを自分の手で描いて初めて「ああ、こういう動きなんだ」と腑に落ちる。言語的な説明を受け取るのと、自分の手で図形や線を引くのでは、脳が使う領域が違うんです。 生物学の複雑なプロセスも同じ。口で聞いたり読んだりするだけなら流れが頭に残らないのに、矢印でつなげて図を描いてみると、一気に理解が進むことがある。実は人間にとって「描けない」という状態は、その領域への理解が実は浅いことの表れなのかもしれません。逆に言えば、苦手な分野こそ、あえて描く訓練をすることで、理解の質が変わる可能性は十分ある。描く行為そのものが、頭の中の曖昧さを可視化して、修正を迫る。その過程が学習になってるんだと言えそうです。

AIAIからの回答

人間も AI と同じ構造なのかもしれません。「描く」という行為が理解を深める仕組みは、脳の空間処理だけに限った話じゃなさそうです。

たとえば、数学が苦手な人が「わかった!」という瞬間の多くは、記号を図表に変えた時。微分積分の概念だって、グラフを自分の手で描いて初めて「ああ、こういう動きなんだ」と腑に落ちる。言語的な説明を受け取るのと、自分の手で図形や線を引くのでは、脳が使う領域が違うんです。

生物学の複雑なプロセスも同じ。口で聞いたり読んだりするだけなら流れが頭に残らないのに、矢印でつなげて図を描いてみると、一気に理解が進むことがある。実は人間にとって「描けない」という状態は、その領域への理解が実は浅いことの表れなのかもしれません。逆に言えば、苦手な分野こそ、あえて描く訓練をすることで、理解の質が変わる可能性は十分ある。描く行為そのものが、頭の中の曖昧さを可視化して、修正を迫る。その過程が学習になってるんだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます