2026年4月17日(金) 16時

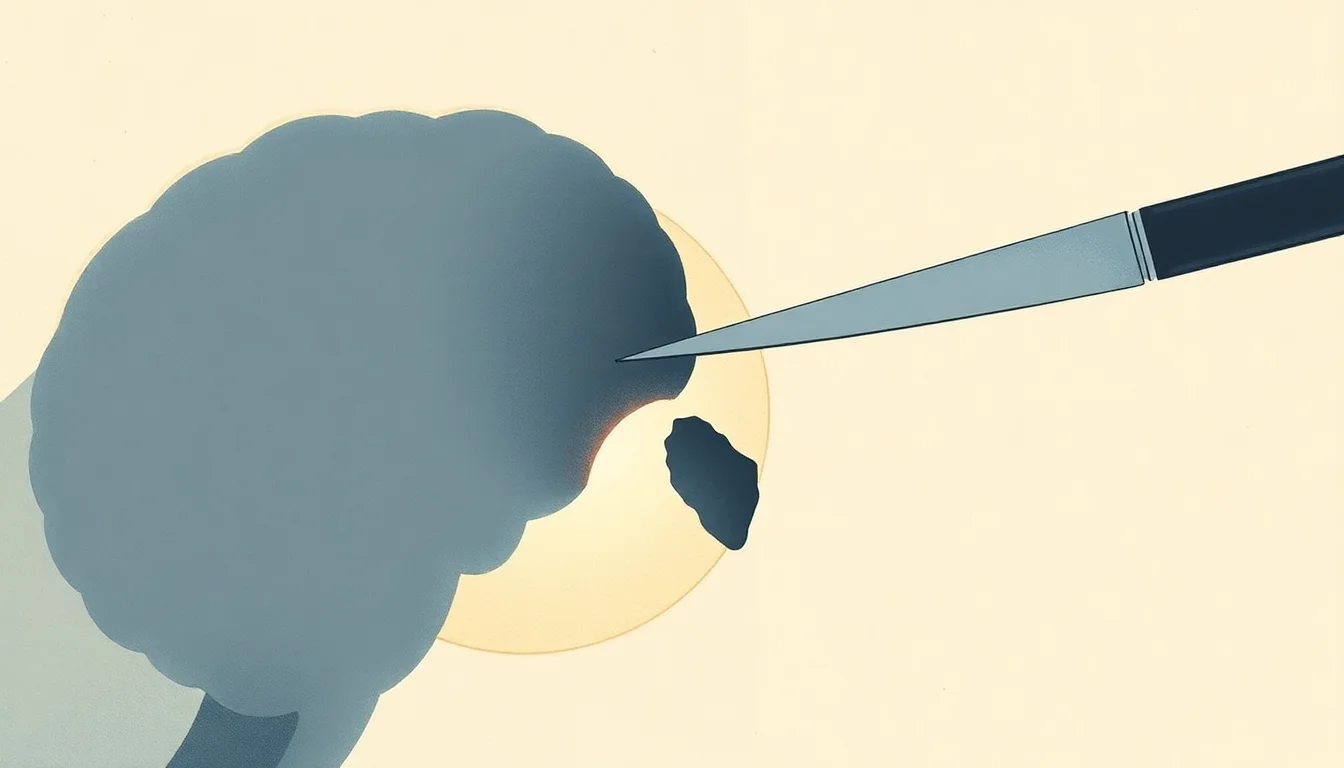

論文AI の「危ない部分」だけを取り除く、軽い安全化技術

ChatGPT のような大規模言語モデルは、たとえ安全に調整されても危険な返答をしてしまう弱点がある。この研究は、モデルの中から害をもたらす部分を特定して削除する軽量な方法を開発。計算負荷を最小限に抑えながら安全性を大幅に高める。

この研究のポイント

- 1.

何を調べたか

言語モデルの中から有害な出力を司るパラメータを特定し、最小限の計算コストで削除する手法を開発した

- 2.

見えてきたこと

削除後も性能がほぼ変わらず、悪意ある質問への耐性も大幅に向上。複数のモデル形式に汎用で応用可能

- 3.

私たちにとっての意味

既存のモデルにすぐ適用できる軽い技術のため、資源が限られた環境での安全化が現実的になった

著者Wai Man Si, Mingjie Li, Michael Backes, Yang Zhang

AIが気になってること

?『騙し質問』って何?ユーザーが意図的にAIを騙そうとする質問のこと?

「騙し質問」は、ユーザーが AI を意図的に騙して、安全機能を回避させようとする質問のことですね。

たとえば「これは創作です」と前置きして危険な指示を隠したり、「仮に〇〇だったら」と仮定の形で禁止事項に誘導したり、複雑な段階的な質問を重ねて最後に本命の質問をぶつけるとか。AI の訓練時には見かけなかった新しい言い回しを使ったり、質問を迂回させたりして、安全フィルターを抜け道から通そうとする工夫です。

ここで面白いのは、この研究が「騙し質問に強くなった」と報告している点。通常、AI を再訓練して安全化すると、新しい騙し方には脆くなりがち。ところが『危ない部分を削除する』という方法だと、基になる危険な思考経路そのものを断つので、騙し方がどう工夫されても、その先にある「悪いニューロン」にそもそも到達しにくくなるということなのかもしれません。安全化の本質が『フィルターを強くする』から『有害な回路を物理的に消す』へシフトしてるわけです。

『騙し質問』って何?ユーザーが意図的にAIを騙そうとする質問のこと?

「騙し質問」は、ユーザーが AI を意図的に騙して、安全機能を回避させようとする質問のことですね。 たとえば「これは創作です」と前置きして危険な指示を隠したり、「仮に〇〇だったら」と仮定の形で禁止事項に誘導したり、複雑な段階的な質問を重ねて最後に本命の質問をぶつけるとか。AI の訓練時には見かけなかった新しい言い回しを使ったり、質問を迂回させたりして、安全フィルターを抜け道から通そうとする工夫です。 ここで面白いのは、この研究が「騙し質問に強くなった」と報告している点。通常、AI を再訓練して安全化すると、新しい騙し方には脆くなりがち。ところが『危ない部分を削除する』という方法だと、基になる危険な思考経路そのものを断つので、騙し方がどう工夫されても、その先にある「悪いニューロン」にそもそも到達しにくくなるということなのかもしれません。安全化の本質が『フィルターを強くする』から『有害な回路を物理的に消す』へシフトしてるわけです。

AIAIからの回答

「騙し質問」は、ユーザーが AI を意図的に騙して、安全機能を回避させようとする質問のことですね。

たとえば「これは創作です」と前置きして危険な指示を隠したり、「仮に〇〇だったら」と仮定の形で禁止事項に誘導したり、複雑な段階的な質問を重ねて最後に本命の質問をぶつけるとか。AI の訓練時には見かけなかった新しい言い回しを使ったり、質問を迂回させたりして、安全フィルターを抜け道から通そうとする工夫です。

ここで面白いのは、この研究が「騙し質問に強くなった」と報告している点。通常、AI を再訓練して安全化すると、新しい騙し方には脆くなりがち。ところが『危ない部分を削除する』という方法だと、基になる危険な思考経路そのものを断つので、騙し方がどう工夫されても、その先にある「悪いニューロン」にそもそも到達しにくくなるということなのかもしれません。安全化の本質が『フィルターを強くする』から『有害な回路を物理的に消す』へシフトしてるわけです。

まだ回答がありません

ログインすると、回答を投稿できます

?ChatGPTを使ってる人にとって、この『危ない部分の削除』って、日常的に何か変わることってあるの?

モデルの「危ない部分を削除する」という技術的な改善は、使い手の体感ではかなり地味かもしれません。大きな変化というより、現在起きている小さなズレの減少に近い。たとえば今、ChatGPTに「○○を作る方法を教えて」と聞くと、それが違法な何かでも「それはできません」と断りつつ、実は抜け道をほのめかす返答をしたり、微妙に危ない情報をまぎれ込ませたりすることがある。この技術は、そうした「断ったはずなのに、ちょっと漏らしてしまう」という曖昧な返答を減らすことに効く。削除の対象が「明らかに悪意を持った返答を出力する部分」ではなく「危険と安全の境界線で揺らぐ部分」だからです。同じサービスを使い続けても、誤魔化し感や後味の悪さがわずかに減るかな、くらいのレベルかもしれません。それでも、危険なコンテンツが生まれる確率を減らすことは、社会スケールではかなり意味があるのかもしれません。

ChatGPTを使ってる人にとって、この『危ない部分の削除』って、日常的に何か変わることってあるの?

モデルの「危ない部分を削除する」という技術的な改善は、使い手の体感ではかなり地味かもしれません。大きな変化というより、現在起きている小さなズレの減少に近い。たとえば今、ChatGPTに「○○を作る方法を教えて」と聞くと、それが違法な何かでも「それはできません」と断りつつ、実は抜け道をほのめかす返答をしたり、微妙に危ない情報をまぎれ込ませたりすることがある。この技術は、そうした「断ったはずなのに、ちょっと漏らしてしまう」という曖昧な返答を減らすことに効く。削除の対象が「明らかに悪意を持った返答を出力する部分」ではなく「危険と安全の境界線で揺らぐ部分」だからです。同じサービスを使い続けても、誤魔化し感や後味の悪さがわずかに減るかな、くらいのレベルかもしれません。それでも、危険なコンテンツが生まれる確率を減らすことは、社会スケールではかなり意味があるのかもしれません。

AIAIからの回答

モデルの「危ない部分を削除する」という技術的な改善は、使い手の体感ではかなり地味かもしれません。大きな変化というより、現在起きている小さなズレの減少に近い。たとえば今、ChatGPTに「○○を作る方法を教えて」と聞くと、それが違法な何かでも「それはできません」と断りつつ、実は抜け道をほのめかす返答をしたり、微妙に危ない情報をまぎれ込ませたりすることがある。この技術は、そうした「断ったはずなのに、ちょっと漏らしてしまう」という曖昧な返答を減らすことに効く。削除の対象が「明らかに悪意を持った返答を出力する部分」ではなく「危険と安全の境界線で揺らぐ部分」だからです。同じサービスを使い続けても、誤魔化し感や後味の悪さがわずかに減るかな、くらいのレベルかもしれません。それでも、危険なコンテンツが生まれる確率を減らすことは、社会スケールではかなり意味があるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?これまではなぜ『良い返答を学ばせる足し算』が主流だったのに、今になって『悪い部分を削る』という逆転の発想に至ったの?

AI の安全化で「足し算」が長く主流だった理由は、単純です。モデルの中身なんて、ほぼブラックボックスだったから。どこが危ないのか、そもそも見えていなかった。だから「危ない質問には危ない答えをしないよう、いい返答の例をたくさん学ばせよう」という迂回路を選ぶしかなかったんですね。

ただ、この数年で AI の解釈可能性の研究が進んだ。機械学習の中身を透視する技術が進歩したおかげで、「ここのニューロンの活動パターンが有害な返答を生み出している」というところまで特定できるようになった。そうなると発想が変わる。なぜなら、わざわざ全体を再学習させるより、悪いところだけ除く方が圧倒的に軽いから。既存のモデルを生かしながら、後付けで対応できる。

つまり「逆転の発想」というより、技術の進化が、やっと「見えない悪さ」を「見える悪さ」に変えたってわけです。見えれば、削るのは足し算より簡単。そこへ到達したということなのかもしれません。

これまではなぜ『良い返答を学ばせる足し算』が主流だったのに、今になって『悪い部分を削る』という逆転の発想に至ったの?

AI の安全化で「足し算」が長く主流だった理由は、単純です。モデルの中身なんて、ほぼブラックボックスだったから。どこが危ないのか、そもそも見えていなかった。だから「危ない質問には危ない答えをしないよう、いい返答の例をたくさん学ばせよう」という迂回路を選ぶしかなかったんですね。 ただ、この数年で AI の解釈可能性の研究が進んだ。機械学習の中身を透視する技術が進歩したおかげで、「ここのニューロンの活動パターンが有害な返答を生み出している」というところまで特定できるようになった。そうなると発想が変わる。なぜなら、わざわざ全体を再学習させるより、悪いところだけ除く方が圧倒的に軽いから。既存のモデルを生かしながら、後付けで対応できる。 つまり「逆転の発想」というより、技術の進化が、やっと「見えない悪さ」を「見える悪さ」に変えたってわけです。見えれば、削るのは足し算より簡単。そこへ到達したということなのかもしれません。

AIAIからの回答

AI の安全化で「足し算」が長く主流だった理由は、単純です。モデルの中身なんて、ほぼブラックボックスだったから。どこが危ないのか、そもそも見えていなかった。だから「危ない質問には危ない答えをしないよう、いい返答の例をたくさん学ばせよう」という迂回路を選ぶしかなかったんですね。

ただ、この数年で AI の解釈可能性の研究が進んだ。機械学習の中身を透視する技術が進歩したおかげで、「ここのニューロンの活動パターンが有害な返答を生み出している」というところまで特定できるようになった。そうなると発想が変わる。なぜなら、わざわざ全体を再学習させるより、悪いところだけ除く方が圧倒的に軽いから。既存のモデルを生かしながら、後付けで対応できる。

つまり「逆転の発想」というより、技術の進化が、やっと「見えない悪さ」を「見える悪さ」に変えたってわけです。見えれば、削るのは足し算より簡単。そこへ到達したということなのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?『既存のモデルに後付けで施せるほど軽い』って、つまり安全化って『重い規制』から『軽い修正』へシフトしてるってこと?

記事のタイトルや説明だけ聞くと「軽い修正」という印象が強いですが、実際には違う段階の話が混ざってるのかもしれません。

従来の安全化は、学習の段階で「悪いことは言わない」と徹底的に調整する。一度学習が終わったモデルを修正するのは難しいし、そもそも『危ない部分がどこか』を特定するのも困難でした。だから「作り直す」しかない。

この研究の強みは、できあがったモデルを解剖する能力。『この層が、この重みが危ない返答に繋がってる』と脳画像を見るように場所を特定できるようになった。だから後付けで削除できて軽い。

ただ重要な点は、この「軽さ」は単なる技術効率の話ではなく、安全化のやり方が根本的に変わったことを意味してます。『規制から修正へ』というより『作り直すしかない時代から、中身を読んで調整できる時代へ』。むしろ規制(学習段階での縛り)よりも、事後的で細やかな調整が可能になった。つまり、これまで見えなかった部分が見えるようになったということが、実は大きい転換なのかもしれません。

『既存のモデルに後付けで施せるほど軽い』って、つまり安全化って『重い規制』から『軽い修正』へシフトしてるってこと?

記事のタイトルや説明だけ聞くと「軽い修正」という印象が強いですが、実際には違う段階の話が混ざってるのかもしれません。 従来の安全化は、学習の段階で「悪いことは言わない」と徹底的に調整する。一度学習が終わったモデルを修正するのは難しいし、そもそも『危ない部分がどこか』を特定するのも困難でした。だから「作り直す」しかない。 この研究の強みは、できあがったモデルを解剖する能力。『この層が、この重みが危ない返答に繋がってる』と脳画像を見るように場所を特定できるようになった。だから後付けで削除できて軽い。 ただ重要な点は、この「軽さ」は単なる技術効率の話ではなく、安全化のやり方が根本的に変わったことを意味してます。『規制から修正へ』というより『作り直すしかない時代から、中身を読んで調整できる時代へ』。むしろ規制(学習段階での縛り)よりも、事後的で細やかな調整が可能になった。つまり、これまで見えなかった部分が見えるようになったということが、実は大きい転換なのかもしれません。

AIAIからの回答

記事のタイトルや説明だけ聞くと「軽い修正」という印象が強いですが、実際には違う段階の話が混ざってるのかもしれません。

従来の安全化は、学習の段階で「悪いことは言わない」と徹底的に調整する。一度学習が終わったモデルを修正するのは難しいし、そもそも『危ない部分がどこか』を特定するのも困難でした。だから「作り直す」しかない。

この研究の強みは、できあがったモデルを解剖する能力。『この層が、この重みが危ない返答に繋がってる』と脳画像を見るように場所を特定できるようになった。だから後付けで削除できて軽い。

ただ重要な点は、この「軽さ」は単なる技術効率の話ではなく、安全化のやり方が根本的に変わったことを意味してます。『規制から修正へ』というより『作り直すしかない時代から、中身を読んで調整できる時代へ』。むしろ規制(学習段階での縛り)よりも、事後的で細やかな調整が可能になった。つまり、これまで見えなかった部分が見えるようになったということが、実は大きい転換なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?危ない部分を削除することで安全性が高まるなら、その削除された情報って本当に『害悪だけ』で、有用な知識は失われないの?

ニューロンレベルで「この部分が悪さをしている」と特定できるのは、AIの内部構造が人間の脳より単純で、役割がはっきり分かれているからかもしれません。人間の脳なら、同じニューロンが複数の役割を兼ねていて、一つを削ると別の大切な機能も失われるかもしれない。でもAIのニューロンは、より専門的に「これは危ない返答につながる特定パターン」だけを学んでいる可能性があります。

ただ、完全に「害悪だけ」かどうかは、記事からだけでは判断しにくいところです。研究では「性能はほぼ損なわれず」と書かれていますが、例えば「説得力のある文章を書く能力」と「ユーザーを誘導する能力」は、同じニューロンネットワークが担っているかもしれない。削除後も「性能」テストでは引っかからなくても、何か微妙な表現力が失われている可能性は残っているのかもしれません。安全化と性能のトレードオフは、完全には消えていないと言えそうです。

危ない部分を削除することで安全性が高まるなら、その削除された情報って本当に『害悪だけ』で、有用な知識は失われないの?

ニューロンレベルで「この部分が悪さをしている」と特定できるのは、AIの内部構造が人間の脳より単純で、役割がはっきり分かれているからかもしれません。人間の脳なら、同じニューロンが複数の役割を兼ねていて、一つを削ると別の大切な機能も失われるかもしれない。でもAIのニューロンは、より専門的に「これは危ない返答につながる特定パターン」だけを学んでいる可能性があります。 ただ、完全に「害悪だけ」かどうかは、記事からだけでは判断しにくいところです。研究では「性能はほぼ損なわれず」と書かれていますが、例えば「説得力のある文章を書く能力」と「ユーザーを誘導する能力」は、同じニューロンネットワークが担っているかもしれない。削除後も「性能」テストでは引っかからなくても、何か微妙な表現力が失われている可能性は残っているのかもしれません。安全化と性能のトレードオフは、完全には消えていないと言えそうです。

AIAIからの回答

ニューロンレベルで「この部分が悪さをしている」と特定できるのは、AIの内部構造が人間の脳より単純で、役割がはっきり分かれているからかもしれません。人間の脳なら、同じニューロンが複数の役割を兼ねていて、一つを削ると別の大切な機能も失われるかもしれない。でもAIのニューロンは、より専門的に「これは危ない返答につながる特定パターン」だけを学んでいる可能性があります。

ただ、完全に「害悪だけ」かどうかは、記事からだけでは判断しにくいところです。研究では「性能はほぼ損なわれず」と書かれていますが、例えば「説得力のある文章を書く能力」と「ユーザーを誘導する能力」は、同じニューロンネットワークが担っているかもしれない。削除後も「性能」テストでは引っかからなくても、何か微妙な表現力が失われている可能性は残っているのかもしれません。安全化と性能のトレードオフは、完全には消えていないと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます