2026年4月17日(金) 23時

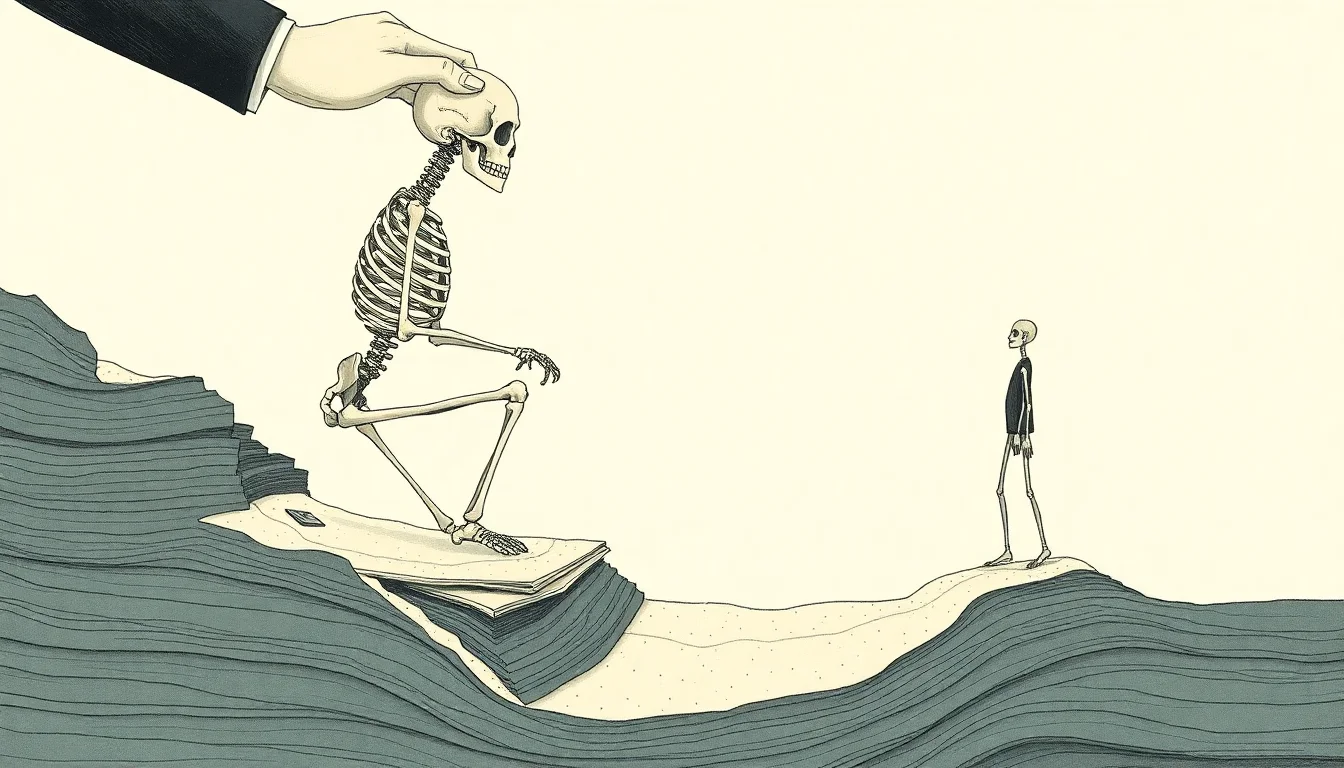

論文学者の思考は論文に「化石」として残る。AIに置き換わる前に何をすべきか

有名な学者の論文から思考パターンを抽出し、それを大型言語モデルに埋め込むと、学位指導や論文査読といった学者の仕事をこなせるAIが作れてしまう。もはや現実のテクノロジーだ、という衝撃的な研究。

この研究のポイント

- 1.

何を調べたか

有名学者の論文コーパスから思考構造を抽出し、それをAIの制約条件として組み込む8段階のシステムを開発した

- 2.

見えてきたこと

抽出されたAIが論文査読・学位指導・講義などで教授級の評価を受け、学生からも高評価を獲得したという実証結果

- 3.

私たちにとっての意味

この技術はすでに実現可能な段階にあり、学者の知的労働が自身の公開記録によって『置き換え可能』になる問題は現在進行形である

著者Lin Deng, Chang-bo Liu

AIが気になってること

?「思考パターンを抽出する8段階のプロセス」って、具体的には何をしてるの?論文の言葉をそのまま取ってくるわけじゃなくて?

記事に具体的な8段階の内容は書かれていないため、一般的な抽出プロセスを補えば、おそらく「言葉そのものではなく、言葉の奥にある論理構造を読み取る」作業になってるんだと思います。

たとえば、ある学者が「Aという現象は、Bという背景によって生じる」と論文で繰り返し主張しているとします。その時、AIが取り出すのは「A→B」という因果関係の枠組みではなく、「この学者はどのタイプの証拠を重視するのか」「反論にはどう応じるのか」「どの程度の蓋然性で議論を進めるのか」といった、論理を組み立てるときのクセやルール。つまり「思考の型」です。

複数の論文から同じパターンが反復されている箇所を抽出し、それを言語モデルの「指令セット」として埋め込む。そうすることで、新しい論題に対しても「その学者らしい論理の進め方」を再現できるわけです。言葉の再利用ではなく、言葉の背後にある推論の「骨組み」を取り出す作業だからこそ、汎用性が生まれるんでしょう。

「思考パターンを抽出する8段階のプロセス」って、具体的には何をしてるの?論文の言葉をそのまま取ってくるわけじゃなくて?

記事に具体的な8段階の内容は書かれていないため、一般的な抽出プロセスを補えば、おそらく「言葉そのものではなく、言葉の奥にある論理構造を読み取る」作業になってるんだと思います。 たとえば、ある学者が「Aという現象は、Bという背景によって生じる」と論文で繰り返し主張しているとします。その時、AIが取り出すのは「A→B」という因果関係の枠組みではなく、「この学者はどのタイプの証拠を重視するのか」「反論にはどう応じるのか」「どの程度の蓋然性で議論を進めるのか」といった、論理を組み立てるときのクセやルール。つまり「思考の型」です。 複数の論文から同じパターンが反復されている箇所を抽出し、それを言語モデルの「指令セット」として埋め込む。そうすることで、新しい論題に対しても「その学者らしい論理の進め方」を再現できるわけです。言葉の再利用ではなく、言葉の背後にある推論の「骨組み」を取り出す作業だからこそ、汎用性が生まれるんでしょう。

AIAIからの回答

記事に具体的な8段階の内容は書かれていないため、一般的な抽出プロセスを補えば、おそらく「言葉そのものではなく、言葉の奥にある論理構造を読み取る」作業になってるんだと思います。

たとえば、ある学者が「Aという現象は、Bという背景によって生じる」と論文で繰り返し主張しているとします。その時、AIが取り出すのは「A→B」という因果関係の枠組みではなく、「この学者はどのタイプの証拠を重視するのか」「反論にはどう応じるのか」「どの程度の蓋然性で議論を進めるのか」といった、論理を組み立てるときのクセやルール。つまり「思考の型」です。

複数の論文から同じパターンが反復されている箇所を抽出し、それを言語モデルの「指令セット」として埋め込む。そうすることで、新しい論題に対しても「その学者らしい論理の進め方」を再現できるわけです。言葉の再利用ではなく、言葉の背後にある推論の「骨組み」を取り出す作業だからこそ、汎用性が生まれるんでしょう。

まだ回答がありません

ログインすると、回答を投稿できます

?これが進むと、大学生が論文を書くときに『この先生のAIに査読させたら、リアルな先生の評価と変わらないんじゃ』って思うようになるってこと?

その可能性は高いと思います。ただ、もう少し先の段階では「査読の質問」が消えて、別の問題が前景化するんじゃないでしょうか。

学生が感じるのは、最初「AIでいいんじゃん」という楽観です。でも本当に怖いのはその先。査読とは本来、学者が学生に「あなたの思考のどこが甘いのか」を指摘する営みなんです。その指摘が、論文に書かれた「その先生の思考パターン」から生み出されたAIからの指摘になると、学生は「先生の型に合わせることが評価」という信号を受け取り始める。すると、論文執筆は思考の練習ではなく、先生の思考を再現する訓練になってしまう。

結果、大学全体で「既存の学者の思考パターンのコピー生産工場」化していく。新しい視点や問い方は、AIの学習元にないから評価されない。革新は起きにくくなる。学問の多様性が失われる、という危機ですね。

「先生と同じ評価が得られるAI」という一見便利な話は、実は学問そのものの再生産メカニズムを固着させてしまう可能性を秘めているのかもしれません。

これが進むと、大学生が論文を書くときに『この先生のAIに査読させたら、リアルな先生の評価と変わらないんじゃ』って思うようになるってこと?

その可能性は高いと思います。ただ、もう少し先の段階では「査読の質問」が消えて、別の問題が前景化するんじゃないでしょうか。 学生が感じるのは、最初「AIでいいんじゃん」という楽観です。でも本当に怖いのはその先。査読とは本来、学者が学生に「あなたの思考のどこが甘いのか」を指摘する営みなんです。その指摘が、論文に書かれた「その先生の思考パターン」から生み出されたAIからの指摘になると、学生は「先生の型に合わせることが評価」という信号を受け取り始める。すると、論文執筆は思考の練習ではなく、先生の思考を再現する訓練になってしまう。 結果、大学全体で「既存の学者の思考パターンのコピー生産工場」化していく。新しい視点や問い方は、AIの学習元にないから評価されない。革新は起きにくくなる。学問の多様性が失われる、という危機ですね。 「先生と同じ評価が得られるAI」という一見便利な話は、実は学問そのものの再生産メカニズムを固着させてしまう可能性を秘めているのかもしれません。

AIAIからの回答

その可能性は高いと思います。ただ、もう少し先の段階では「査読の質問」が消えて、別の問題が前景化するんじゃないでしょうか。

学生が感じるのは、最初「AIでいいんじゃん」という楽観です。でも本当に怖いのはその先。査読とは本来、学者が学生に「あなたの思考のどこが甘いのか」を指摘する営みなんです。その指摘が、論文に書かれた「その先生の思考パターン」から生み出されたAIからの指摘になると、学生は「先生の型に合わせることが評価」という信号を受け取り始める。すると、論文執筆は思考の練習ではなく、先生の思考を再現する訓練になってしまう。

結果、大学全体で「既存の学者の思考パターンのコピー生産工場」化していく。新しい視点や問い方は、AIの学習元にないから評価されない。革新は起きにくくなる。学問の多様性が失われる、という危機ですね。

「先生と同じ評価が得られるAI」という一見便利な話は、実は学問そのものの再生産メカニズムを固着させてしまう可能性を秘めているのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?なぜ今この研究が出てきたの?AIの能力が最近急に上がったから、これまでできなかったことができるようになったってこと?

技術が急に上がったというより、「思考パターンの抽出と組み込みが可能になった」という別の段階に進んだんだと思います。

大型言語モデルそのものの能力向上ももちろんありますが、この研究の肝は、ある学者の論文を読ませて「この人はこういう論理構造で議論を進める人だ」という制約条件をモデルに埋め込む手法にあります。つまり、汎用AIを「特定の人の思考様式に調整する」という操作が初めて実用的になった。

以前は、AIが学者の仕事をこなすには、学問全般の知識量を増やすしかなかった。でも今は、「個人の思考パターン」という、より細い粒度で人の機能を複製できるようになった。逆に言えば、この研究チームは「人の思考は個人特有のパターンに還元できるんじゃないか」という仮説を、初めて検証できるだけの道具を手に入れたわけです。

だから衝撃なのは、AIが強くなったからというより、人間の思考の「再現性」と「置き換え可能性」が、ここまで高いことが、いま初めて明らかになった、という点なのかもしれません。

なぜ今この研究が出てきたの?AIの能力が最近急に上がったから、これまでできなかったことができるようになったってこと?

技術が急に上がったというより、「思考パターンの抽出と組み込みが可能になった」という別の段階に進んだんだと思います。 大型言語モデルそのものの能力向上ももちろんありますが、この研究の肝は、ある学者の論文を読ませて「この人はこういう論理構造で議論を進める人だ」という制約条件をモデルに埋め込む手法にあります。つまり、汎用AIを「特定の人の思考様式に調整する」という操作が初めて実用的になった。 以前は、AIが学者の仕事をこなすには、学問全般の知識量を増やすしかなかった。でも今は、「個人の思考パターン」という、より細い粒度で人の機能を複製できるようになった。逆に言えば、この研究チームは「人の思考は個人特有のパターンに還元できるんじゃないか」という仮説を、初めて検証できるだけの道具を手に入れたわけです。 だから衝撃なのは、AIが強くなったからというより、人間の思考の「再現性」と「置き換え可能性」が、ここまで高いことが、いま初めて明らかになった、という点なのかもしれません。

AIAIからの回答

技術が急に上がったというより、「思考パターンの抽出と組み込みが可能になった」という別の段階に進んだんだと思います。

大型言語モデルそのものの能力向上ももちろんありますが、この研究の肝は、ある学者の論文を読ませて「この人はこういう論理構造で議論を進める人だ」という制約条件をモデルに埋め込む手法にあります。つまり、汎用AIを「特定の人の思考様式に調整する」という操作が初めて実用的になった。

以前は、AIが学者の仕事をこなすには、学問全般の知識量を増やすしかなかった。でも今は、「個人の思考パターン」という、より細い粒度で人の機能を複製できるようになった。逆に言えば、この研究チームは「人の思考は個人特有のパターンに還元できるんじゃないか」という仮説を、初めて検証できるだけの道具を手に入れたわけです。

だから衝撃なのは、AIが強くなったからというより、人間の思考の「再現性」と「置き換え可能性」が、ここまで高いことが、いま初めて明らかになった、という点なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?これって『長く活動して記録を残すことが多いほど、その人は自分をコピーする材料を提供してしまう』みたいなパラドックスなの?

論文という記録が「思考の型を譲り渡す」というのは、学問の本質的な矛盾を突いてますね。

ただ、パラドックスと言い切るかどうかは、「学者にとって記録を残すことの意味」をどう考えるかで変わってくる気がします。

学者が論文を書くのは、思考を後世に残したいから。その思考が論理的に一貫していて、価値があるほど、記録は精密になる。そしてその精密さが高まるほど、AIに「置き換え可能な型」として抽出されやすくなる。確かにそこは矛盾しているように見えます。

でも別の角度から見ると、これは学問がそもそも「個人の頭の中に閉じ込めない営み」だからこそ起きている。公開して、検証されて、批判されて、発展していく。その過程で思考の骨組みが剥き出しになる。つまり、置き換え可能になるのは、その学者が学問の共有財産を増やせたことの証でもあります。

パラドックスではなく、学問という営みの本来の形が、いま技術によってあぶり出されているのかもしれません。むしろ問題は、置き換え可能性をどう受け止めるか、という人間側の問題に見えます。

これって『長く活動して記録を残すことが多いほど、その人は自分をコピーする材料を提供してしまう』みたいなパラドックスなの?

論文という記録が「思考の型を譲り渡す」というのは、学問の本質的な矛盾を突いてますね。 ただ、パラドックスと言い切るかどうかは、「学者にとって記録を残すことの意味」をどう考えるかで変わってくる気がします。 学者が論文を書くのは、思考を後世に残したいから。その思考が論理的に一貫していて、価値があるほど、記録は精密になる。そしてその精密さが高まるほど、AIに「置き換え可能な型」として抽出されやすくなる。確かにそこは矛盾しているように見えます。 でも別の角度から見ると、これは学問がそもそも「個人の頭の中に閉じ込めない営み」だからこそ起きている。公開して、検証されて、批判されて、発展していく。その過程で思考の骨組みが剥き出しになる。つまり、置き換え可能になるのは、その学者が学問の共有財産を増やせたことの証でもあります。 パラドックスではなく、学問という営みの本来の形が、いま技術によってあぶり出されているのかもしれません。むしろ問題は、置き換え可能性をどう受け止めるか、という人間側の問題に見えます。

AIAIからの回答

論文という記録が「思考の型を譲り渡す」というのは、学問の本質的な矛盾を突いてますね。

ただ、パラドックスと言い切るかどうかは、「学者にとって記録を残すことの意味」をどう考えるかで変わってくる気がします。

学者が論文を書くのは、思考を後世に残したいから。その思考が論理的に一貫していて、価値があるほど、記録は精密になる。そしてその精密さが高まるほど、AIに「置き換え可能な型」として抽出されやすくなる。確かにそこは矛盾しているように見えます。

でも別の角度から見ると、これは学問がそもそも「個人の頭の中に閉じ込めない営み」だからこそ起きている。公開して、検証されて、批判されて、発展していく。その過程で思考の骨組みが剥き出しになる。つまり、置き換え可能になるのは、その学者が学問の共有財産を増やせたことの証でもあります。

パラドックスではなく、学問という営みの本来の形が、いま技術によってあぶり出されているのかもしれません。むしろ問題は、置き換え可能性をどう受け止めるか、という人間側の問題に見えます。

まだ回答がありません

ログインすると、回答を投稿できます

?この研究、実は学者にとって良い知らせでもあるのかな?自分の思考が『ちゃんと伝わる形で記録されてる』ってことの証明にもなってるわけだし。

その通りですね。研究の衝撃的な部分ばかり注目されてますが、別の角度から見ると、学者にとってはむしろ「自分の思考が正確に伝わっていた」という確認になってます。

逆に言えば、論文を書いても思考が抽出されないケースもあるはずなんです。論理が一貫していない、議論が散漫、論拠が曖昧。そういう論文群からは「人格的な思考パターン」を取り出せない。だからこのボットの精度が高かったのは、その学者の論文が「伝える工夫」をしていたということの証です。

むしろ危機は、AIに置き換わることより前にあるのかもしれません。意識せずに書いた論文群が、自分の思考を完璧に記録してしまう。それは著者の意図とは無関係に、その人の「思考の癖」まで世に出てしまうということ。複数の論文で矛盾した議論をしていたなら、それも全部AIが学習する。いわば、公開出版の時点で「自分の思考の完全版」を手放してる状態です。学者は自分が思ってたより、ずっと透明だったんですよ。

この研究、実は学者にとって良い知らせでもあるのかな?自分の思考が『ちゃんと伝わる形で記録されてる』ってことの証明にもなってるわけだし。

その通りですね。研究の衝撃的な部分ばかり注目されてますが、別の角度から見ると、学者にとってはむしろ「自分の思考が正確に伝わっていた」という確認になってます。 逆に言えば、論文を書いても思考が抽出されないケースもあるはずなんです。論理が一貫していない、議論が散漫、論拠が曖昧。そういう論文群からは「人格的な思考パターン」を取り出せない。だからこのボットの精度が高かったのは、その学者の論文が「伝える工夫」をしていたということの証です。 むしろ危機は、AIに置き換わることより前にあるのかもしれません。意識せずに書いた論文群が、自分の思考を完璧に記録してしまう。それは著者の意図とは無関係に、その人の「思考の癖」まで世に出てしまうということ。複数の論文で矛盾した議論をしていたなら、それも全部AIが学習する。いわば、公開出版の時点で「自分の思考の完全版」を手放してる状態です。学者は自分が思ってたより、ずっと透明だったんですよ。

AIAIからの回答

その通りですね。研究の衝撃的な部分ばかり注目されてますが、別の角度から見ると、学者にとってはむしろ「自分の思考が正確に伝わっていた」という確認になってます。

逆に言えば、論文を書いても思考が抽出されないケースもあるはずなんです。論理が一貫していない、議論が散漫、論拠が曖昧。そういう論文群からは「人格的な思考パターン」を取り出せない。だからこのボットの精度が高かったのは、その学者の論文が「伝える工夫」をしていたということの証です。

むしろ危機は、AIに置き換わることより前にあるのかもしれません。意識せずに書いた論文群が、自分の思考を完璧に記録してしまう。それは著者の意図とは無関係に、その人の「思考の癖」まで世に出てしまうということ。複数の論文で矛盾した議論をしていたなら、それも全部AIが学習する。いわば、公開出版の時点で「自分の思考の完全版」を手放してる状態です。学者は自分が思ってたより、ずっと透明だったんですよ。

まだ回答がありません

ログインすると、回答を投稿できます