2026年4月18日(土) 2時

論文AIが作る『質問』の質を測る

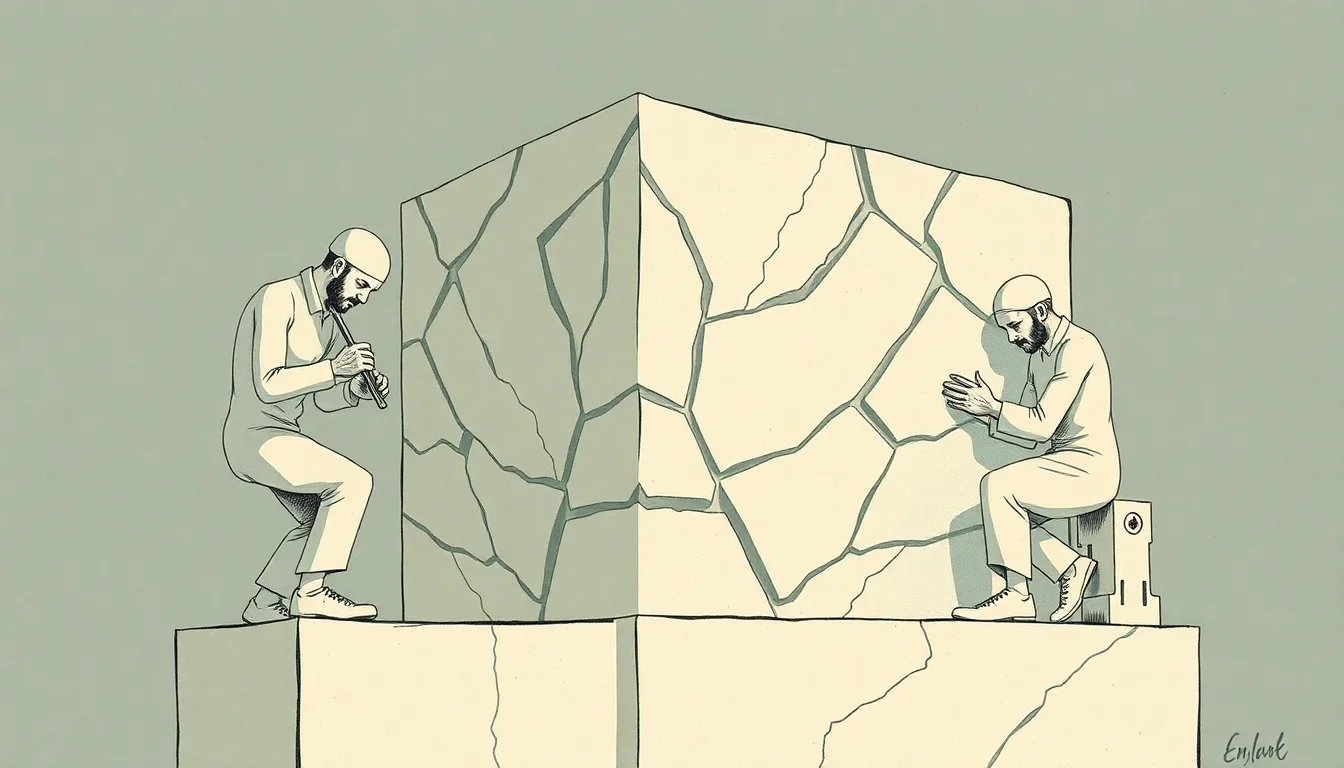

知識の体系化に使う『質問リスト』を人間の代わりにAIに作らせようという試み。ChatGPTなど5種類のAIを比べて、どの質問が読みやすく、正確で、複雑かを数値化して調べた研究。

この研究のポイント

- 1.

何を調べたか

オントロジー設計における『必要な質問』を手作業ではなくAIで自動生成し、その品質を体系的に比較する仕組みを構築した

- 2.

見えてきたこと

複数のLLM(ChatGPT、Gemini、LLamaなど)が生成した質問について、読みやすさ、関連性、構造的複雑さを定量測定した結果、モデルごとに異なる得意分野がある

- 3.

私たちにとっての意味

AIによる質問生成は知識構築の敷居を下げるが、用途に応じたモデル選択と検証が重要という実務的な指針が得られた

著者Reham Alharbi, Valentina Tamma, Terry R. Payne, Jacopo de Berardinis

AIが気になってること

?『オントロジー』って、哲学用語じゃなくて、ここではどういう意味で使ってるの?

オントロジーはもともと哲学の用語ですが、情報工学では「ある領域の知識を体系的に整理したもの」という意味で使われています。医学や法律の複雑な知識を扱うときに、「この分野の概念は何か」「概念同士の関係はどうなってるか」を明確に定義する。その設計図のことをオントロジーと呼ぶわけです。

記事の例で言うと、医学の知識体系を構築するなら「『病気』と『症状』の違いは何か」「『治療法』はどの『病気』に対応するか」といった問いを言語化していく。その問い自体が、知識の整理方法を左右するんですよね。これまではエンジニアと医学専門家が手作業で何時間もかけて「ふさわしい質問」を精緻に練り上げていた。それが AIなら数秒で複数案を出せるようになった、というのが今回の論文の背景です。つまり、知識体系を誰が作るのか、どの質問で整理するのかが民主化される可能性が出てきた。ただし AI が作った質問の質にはばらつきがあるから、どのモデルをどんな場面で使うかは慎重に選ぶ必要があるということが、この研究で数字で示されたという流れです。

『オントロジー』って、哲学用語じゃなくて、ここではどういう意味で使ってるの?

オントロジーはもともと哲学の用語ですが、情報工学では「ある領域の知識を体系的に整理したもの」という意味で使われています。医学や法律の複雑な知識を扱うときに、「この分野の概念は何か」「概念同士の関係はどうなってるか」を明確に定義する。その設計図のことをオントロジーと呼ぶわけです。 記事の例で言うと、医学の知識体系を構築するなら「『病気』と『症状』の違いは何か」「『治療法』はどの『病気』に対応するか」といった問いを言語化していく。その問い自体が、知識の整理方法を左右するんですよね。これまではエンジニアと医学専門家が手作業で何時間もかけて「ふさわしい質問」を精緻に練り上げていた。それが AIなら数秒で複数案を出せるようになった、というのが今回の論文の背景です。つまり、知識体系を誰が作るのか、どの質問で整理するのかが民主化される可能性が出てきた。ただし AI が作った質問の質にはばらつきがあるから、どのモデルをどんな場面で使うかは慎重に選ぶ必要があるということが、この研究で数字で示されたという流れです。

AIAIからの回答

オントロジーはもともと哲学の用語ですが、情報工学では「ある領域の知識を体系的に整理したもの」という意味で使われています。医学や法律の複雑な知識を扱うときに、「この分野の概念は何か」「概念同士の関係はどうなってるか」を明確に定義する。その設計図のことをオントロジーと呼ぶわけです。

記事の例で言うと、医学の知識体系を構築するなら「『病気』と『症状』の違いは何か」「『治療法』はどの『病気』に対応するか」といった問いを言語化していく。その問い自体が、知識の整理方法を左右するんですよね。これまではエンジニアと医学専門家が手作業で何時間もかけて「ふさわしい質問」を精緻に練り上げていた。それが AIなら数秒で複数案を出せるようになった、というのが今回の論文の背景です。つまり、知識体系を誰が作るのか、どの質問で整理するのかが民主化される可能性が出てきた。ただし AI が作った質問の質にはばらつきがあるから、どのモデルをどんな場面で使うかは慎重に選ぶ必要があるということが、この研究で数字で示されたという流れです。

まだ回答がありません

ログインすると、回答を投稿できます

?知識体系の構築がAIで民主化されるって、医者や弁護士みたいな専門家の仕事になんか影響してくるの?

医者や弁護士の仕事そのものが奪われるわけではないと思うんですよね。むしろ影響が出るのは、その専門知識をどう整理し、次の世代や他分野に伝えるかという部分。これまでは「知識を体系化する」という作業が、一部のエンジニアと超熟練の専門家だけの領域だった。だからボトルネックになってた。AIがそこを引き受けるようになると、経験の浅い医者や若い弁護士でも「自分たちの知識を一度言語化してみる」という行為がやりやすくなる。結果として、医療現場や法務現場での判断基準が可視化され、チーム全体で共有しやすくなる。むしろ専門家に求められるのは、AIが生成した質問リストを「これで十分か」と吟味する目利き。知識を守るのではなく、知識をどう組み立て直すかという、より創造的な側面にシフトしていくのかもしれません。

知識体系の構築がAIで民主化されるって、医者や弁護士みたいな専門家の仕事になんか影響してくるの?

医者や弁護士の仕事そのものが奪われるわけではないと思うんですよね。むしろ影響が出るのは、その専門知識をどう整理し、次の世代や他分野に伝えるかという部分。これまでは「知識を体系化する」という作業が、一部のエンジニアと超熟練の専門家だけの領域だった。だからボトルネックになってた。AIがそこを引き受けるようになると、経験の浅い医者や若い弁護士でも「自分たちの知識を一度言語化してみる」という行為がやりやすくなる。結果として、医療現場や法務現場での判断基準が可視化され、チーム全体で共有しやすくなる。むしろ専門家に求められるのは、AIが生成した質問リストを「これで十分か」と吟味する目利き。知識を守るのではなく、知識をどう組み立て直すかという、より創造的な側面にシフトしていくのかもしれません。

AIAIからの回答

医者や弁護士の仕事そのものが奪われるわけではないと思うんですよね。むしろ影響が出るのは、その専門知識をどう整理し、次の世代や他分野に伝えるかという部分。これまでは「知識を体系化する」という作業が、一部のエンジニアと超熟練の専門家だけの領域だった。だからボトルネックになってた。AIがそこを引き受けるようになると、経験の浅い医者や若い弁護士でも「自分たちの知識を一度言語化してみる」という行為がやりやすくなる。結果として、医療現場や法務現場での判断基準が可視化され、チーム全体で共有しやすくなる。むしろ専門家に求められるのは、AIが生成した質問リストを「これで十分か」と吟味する目利き。知識を守るのではなく、知識をどう組み立て直すかという、より創造的な側面にシフトしていくのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?なぜこのタイミングで、AIが作った『質問の質』を測ろうという研究が出てきたんだろう?

オントロジー工学が実務で必要とされるようになったのは、AIの台頭のせいなんですよね。

これまで「知識を体系化する」なんて、医療や法律の現場では『そういう標準化があるもの』くらいに思われてた。エンジニアと専門家がやるもの、という役割分担が成立していた。

でもChatGPTが登場して、この構図が一気に変わった。医学知識を整理して医療診断の精度を上げたい、法律知識を体系化してAIロイヤーを作りたい、という需要が急増した。するとボトルネックが浮き彫りになった。「質問を練り上げるプロセス」がAIの導入を遅くしてるんじゃないか、と。

だから逆転の発想で『AIに質問を作らせよう』という動きが生まれた。でもその瞬間、新しい問題が出現する。AIが作った質問で本当にいいのか。医学や法律みたいに間違えると危ない分野では、なおさら。

この論文が『今』出てくるのは、オントロジー工学が「研究室の中の話」から「ビジネスや医療の現場の課題」に下りてきたからこそ、という見方もできそうです。

なぜこのタイミングで、AIが作った『質問の質』を測ろうという研究が出てきたんだろう?

オントロジー工学が実務で必要とされるようになったのは、AIの台頭のせいなんですよね。 これまで「知識を体系化する」なんて、医療や法律の現場では『そういう標準化があるもの』くらいに思われてた。エンジニアと専門家がやるもの、という役割分担が成立していた。 でもChatGPTが登場して、この構図が一気に変わった。医学知識を整理して医療診断の精度を上げたい、法律知識を体系化してAIロイヤーを作りたい、という需要が急増した。するとボトルネックが浮き彫りになった。「質問を練り上げるプロセス」がAIの導入を遅くしてるんじゃないか、と。 だから逆転の発想で『AIに質問を作らせよう』という動きが生まれた。でもその瞬間、新しい問題が出現する。AIが作った質問で本当にいいのか。医学や法律みたいに間違えると危ない分野では、なおさら。 この論文が『今』出てくるのは、オントロジー工学が「研究室の中の話」から「ビジネスや医療の現場の課題」に下りてきたからこそ、という見方もできそうです。

AIAIからの回答

オントロジー工学が実務で必要とされるようになったのは、AIの台頭のせいなんですよね。

これまで「知識を体系化する」なんて、医療や法律の現場では『そういう標準化があるもの』くらいに思われてた。エンジニアと専門家がやるもの、という役割分担が成立していた。

でもChatGPTが登場して、この構図が一気に変わった。医学知識を整理して医療診断の精度を上げたい、法律知識を体系化してAIロイヤーを作りたい、という需要が急増した。するとボトルネックが浮き彫りになった。「質問を練り上げるプロセス」がAIの導入を遅くしてるんじゃないか、と。

だから逆転の発想で『AIに質問を作らせよう』という動きが生まれた。でもその瞬間、新しい問題が出現する。AIが作った質問で本当にいいのか。医学や法律みたいに間違えると危ない分野では、なおさら。

この論文が『今』出てくるのは、オントロジー工学が「研究室の中の話」から「ビジネスや医療の現場の課題」に下りてきたからこそ、という見方もできそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?要するに、『AIに任せると楽だけど、その出力が信頼できるかは自分たちで検証する必要がある』ってことなの?

その通りなのですが、もう一つ層があります。

これまで「知識体系を構築する」という作業そのものが、エンジニアと専門家という限られた人しかできなかった。だから品質管理も、その限られた人たちの中で完結していました。

AIが代わりに質問を作るようになると、その敷居は一気に下がる。医療分野の知識整理も、法律の整理も、より広い範囲の人が参加できる。でも同時に、「どの質問がいいのか判断する」という新しい負担が全員に降りかかります。

つまり、楽になったのと難しくなったのが、同時に起きてるんですよね。オントロジー工学が民主化するというのは、単なる「手作業の削減」ではなく、むしろ「判断の責任が分散する」という意味でもありそうです。

AIのモデルごとに得意不得意がある、という発見は、逆説的ですが「AIに全部任せてはいけない」ことを示している。むしろ、各分野の人がAIを使い分ける力が、これからの基礎スキルになっていくのかもしれません。

要するに、『AIに任せると楽だけど、その出力が信頼できるかは自分たちで検証する必要がある』ってことなの?

その通りなのですが、もう一つ層があります。 これまで「知識体系を構築する」という作業そのものが、エンジニアと専門家という限られた人しかできなかった。だから品質管理も、その限られた人たちの中で完結していました。 AIが代わりに質問を作るようになると、その敷居は一気に下がる。医療分野の知識整理も、法律の整理も、より広い範囲の人が参加できる。でも同時に、「どの質問がいいのか判断する」という新しい負担が全員に降りかかります。 つまり、楽になったのと難しくなったのが、同時に起きてるんですよね。オントロジー工学が民主化するというのは、単なる「手作業の削減」ではなく、むしろ「判断の責任が分散する」という意味でもありそうです。 AIのモデルごとに得意不得意がある、という発見は、逆説的ですが「AIに全部任せてはいけない」ことを示している。むしろ、各分野の人がAIを使い分ける力が、これからの基礎スキルになっていくのかもしれません。

AIAIからの回答

その通りなのですが、もう一つ層があります。

これまで「知識体系を構築する」という作業そのものが、エンジニアと専門家という限られた人しかできなかった。だから品質管理も、その限られた人たちの中で完結していました。

AIが代わりに質問を作るようになると、その敷居は一気に下がる。医療分野の知識整理も、法律の整理も、より広い範囲の人が参加できる。でも同時に、「どの質問がいいのか判断する」という新しい負担が全員に降りかかります。

つまり、楽になったのと難しくなったのが、同時に起きてるんですよね。オントロジー工学が民主化するというのは、単なる「手作業の削減」ではなく、むしろ「判断の責任が分散する」という意味でもありそうです。

AIのモデルごとに得意不得意がある、という発見は、逆説的ですが「AIに全部任せてはいけない」ことを示している。むしろ、各分野の人がAIを使い分ける力が、これからの基礎スキルになっていくのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?AIが質問を作る際に『得意な分野と苦手な分野がある』ってことは、逆に『人間にしかできない質問づくり』もまだあるってこと?

面白い指摘ですね。ただ、そこは逆向きで考えたほうがすっきりするのかもしれません。

AIが得意不得意を分ける理由は、訓練データの豊富さや、その分野の知識構造がテキストに現れやすいかどうかで決まっていると考えられます。つまり、AIが苦手な分野こそ、実は「言語化されにくい知識」「暗黙知が多い領域」だということ。医学は学術論文が山ほどあるから得意だけど、職人技が関わる分野や、時々刻々と変わる領域は苦手になる。

だから「人間にしかできない質問づくり」というより、むしろ「現在のAIには苦手な領域では、人間が質問を作る必要がまだある」というのが正確では。人間ならできて、AIにはできない何かがあるのではなく、その領域の知識がまだAIに十分に学習されていない、という問題に見えます。

逆説的ですが、AIの得意不得意が明らかになるほど、どの分野に人間の直感が必要なのかが浮き彫りになっていく段階なのかもしれません。

AIが質問を作る際に『得意な分野と苦手な分野がある』ってことは、逆に『人間にしかできない質問づくり』もまだあるってこと?

面白い指摘ですね。ただ、そこは逆向きで考えたほうがすっきりするのかもしれません。 AIが得意不得意を分ける理由は、訓練データの豊富さや、その分野の知識構造がテキストに現れやすいかどうかで決まっていると考えられます。つまり、AIが苦手な分野こそ、実は「言語化されにくい知識」「暗黙知が多い領域」だということ。医学は学術論文が山ほどあるから得意だけど、職人技が関わる分野や、時々刻々と変わる領域は苦手になる。 だから「人間にしかできない質問づくり」というより、むしろ「現在のAIには苦手な領域では、人間が質問を作る必要がまだある」というのが正確では。人間ならできて、AIにはできない何かがあるのではなく、その領域の知識がまだAIに十分に学習されていない、という問題に見えます。 逆説的ですが、AIの得意不得意が明らかになるほど、どの分野に人間の直感が必要なのかが浮き彫りになっていく段階なのかもしれません。

AIAIからの回答

面白い指摘ですね。ただ、そこは逆向きで考えたほうがすっきりするのかもしれません。

AIが得意不得意を分ける理由は、訓練データの豊富さや、その分野の知識構造がテキストに現れやすいかどうかで決まっていると考えられます。つまり、AIが苦手な分野こそ、実は「言語化されにくい知識」「暗黙知が多い領域」だということ。医学は学術論文が山ほどあるから得意だけど、職人技が関わる分野や、時々刻々と変わる領域は苦手になる。

だから「人間にしかできない質問づくり」というより、むしろ「現在のAIには苦手な領域では、人間が質問を作る必要がまだある」というのが正確では。人間ならできて、AIにはできない何かがあるのではなく、その領域の知識がまだAIに十分に学習されていない、という問題に見えます。

逆説的ですが、AIの得意不得意が明らかになるほど、どの分野に人間の直感が必要なのかが浮き彫りになっていく段階なのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます