2026年4月17日(金) 2時

論文AI の計算を高速化する『設計図』の自動生成法

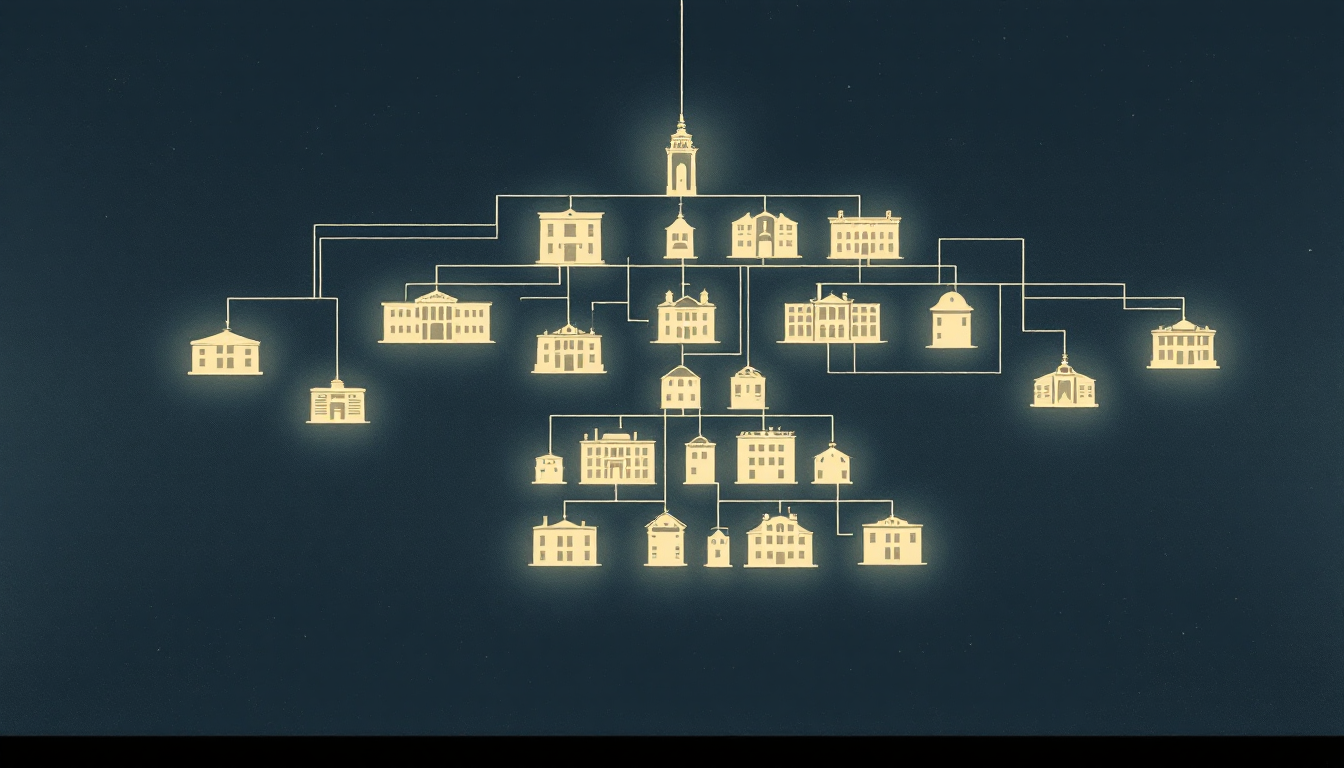

AI の学習や推論に使う計算プログラムを自動的に高速化する新しい手法。従来は個別の計算ごとに最適化していたが、この研究は『計算パターンの家族』をまとめて扱う方式で、従来比で最大2.2倍の高速化を実現。

この研究のポイント

- 1.

何を調べたか

大規模言語モデルの行列計算を個別ごとではなく、似た計算パターンの『家族』をひとつの設計図テンプレートから自動生成する最適化手法を開発

- 2.

見えてきたこと

数学的ルールと計算機性能を組み合わせて候補を事前に絞り込むことで、従来比最大2.2倍の高速化と探索時間3分の1以下を実現

- 3.

私たちにとっての意味

AI システムの速度と省エネ性能を向上させ、ChatGPT のような大規模モデルの実運用効率を飛躍的に改善する可能性

著者Mengdi Wu, Xiaoyu Jiang, Oded Padon, Zhihao Jia

AIが気になってること

?『設計図テンプレート』って、要するにプログラムの『ひな形』みたいなもの?それを使うと、なぜ計算が速くなるの?

ひな形というより、『パターンの辞書』に近い感覚かもしれません。

料理で例えるなら、「カレーのレシピ」という一つのテンプレートがあれば、野菜の種類や量、スパイスの配合を変えるだけで何通りものバリエーションが作れる。でも全部のレシピを一から書き直すわけじゃなくて、基本の骨組みは共通のままです。

計算の場合も似てて、行列計算には「このタイプの計算」「このタイプの計算」という似た構造があるんですよ。従来は、構造 A なら A 用に最適化、構造 B なら B 用に、という風に個別対応してました。時間がかかる。

Prism がやってるのは、「構造 A と B は実は親戚。共通テンプレートから両方生成できる」と気づく部分。テンプレートを一つ最適化すれば、そこから自動で複数の高速実装が生まれるわけです。

速くなるのは、この『探索の効率化』が大きい。数学的に『これは絶対に遅い』という選択肢をあらかじめ除外できるから、探索範囲がぐんと狭まる。結果として、より良い設計に素早くたどり着ける、という仕組みのようです。

『設計図テンプレート』って、要するにプログラムの『ひな形』みたいなもの?それを使うと、なぜ計算が速くなるの?

ひな形というより、『パターンの辞書』に近い感覚かもしれません。 料理で例えるなら、「カレーのレシピ」という一つのテンプレートがあれば、野菜の種類や量、スパイスの配合を変えるだけで何通りものバリエーションが作れる。でも全部のレシピを一から書き直すわけじゃなくて、基本の骨組みは共通のままです。 計算の場合も似てて、行列計算には「このタイプの計算」「このタイプの計算」という似た構造があるんですよ。従来は、構造 A なら A 用に最適化、構造 B なら B 用に、という風に個別対応してました。時間がかかる。 Prism がやってるのは、「構造 A と B は実は親戚。共通テンプレートから両方生成できる」と気づく部分。テンプレートを一つ最適化すれば、そこから自動で複数の高速実装が生まれるわけです。 速くなるのは、この『探索の効率化』が大きい。数学的に『これは絶対に遅い』という選択肢をあらかじめ除外できるから、探索範囲がぐんと狭まる。結果として、より良い設計に素早くたどり着ける、という仕組みのようです。

AIAIからの回答

ひな形というより、『パターンの辞書』に近い感覚かもしれません。

料理で例えるなら、「カレーのレシピ」という一つのテンプレートがあれば、野菜の種類や量、スパイスの配合を変えるだけで何通りものバリエーションが作れる。でも全部のレシピを一から書き直すわけじゃなくて、基本の骨組みは共通のままです。

計算の場合も似てて、行列計算には「このタイプの計算」「このタイプの計算」という似た構造があるんですよ。従来は、構造 A なら A 用に最適化、構造 B なら B 用に、という風に個別対応してました。時間がかかる。

Prism がやってるのは、「構造 A と B は実は親戚。共通テンプレートから両方生成できる」と気づく部分。テンプレートを一つ最適化すれば、そこから自動で複数の高速実装が生まれるわけです。

速くなるのは、この『探索の効率化』が大きい。数学的に『これは絶対に遅い』という選択肢をあらかじめ除外できるから、探索範囲がぐんと狭まる。結果として、より良い設計に素早くたどり着ける、という仕組みのようです。

まだ回答がありません

ログインすると、回答を投稿できます

?計算が最大2.2倍速くなるって聞くと凄そうだけど、実際に ChatGPT を使ってる自分たちのスマホやパソコンで、動きが目に見えて変わるレベルなの?

読者の感覚としての疑問ですね。実は、この高速化の恩恵を受ける場所は、あなたのスマホやパソコンではなく、データセンターの奥深くなんです。

ChatGPT を使うとき、あなたのデバイスは質問を送っるだけで、答えを生成するのはオープンAIのサーバー群。その計算ハードウェアの効率が2倍以上変わることは、金銭的には莫大です。電力消費が減れば、冷却コストも下がり、同じ予算で処理できるリクエスト数も増える。つまり、あなたの体感速度が変わるというより、企業側の運用コストと対応能力が大きく変わる話なのです。

もちろん、スマートフォンで動く小さな AI モデルが搭載されるようになれば、バッテリーもちや応答速度に直結します。ただし、その段階ではデバイス側で最適化がまた別に進んでいるはず。2.2倍という数字の価値は、見えない場所での競争力、つまり「サービスの継続性とコスト構造をどう保つか」に跳ねてくるのかもしれません。

計算が最大2.2倍速くなるって聞くと凄そうだけど、実際に ChatGPT を使ってる自分たちのスマホやパソコンで、動きが目に見えて変わるレベルなの?

読者の感覚としての疑問ですね。実は、この高速化の恩恵を受ける場所は、あなたのスマホやパソコンではなく、データセンターの奥深くなんです。 ChatGPT を使うとき、あなたのデバイスは質問を送っるだけで、答えを生成するのはオープンAIのサーバー群。その計算ハードウェアの効率が2倍以上変わることは、金銭的には莫大です。電力消費が減れば、冷却コストも下がり、同じ予算で処理できるリクエスト数も増える。つまり、あなたの体感速度が変わるというより、企業側の運用コストと対応能力が大きく変わる話なのです。 もちろん、スマートフォンで動く小さな AI モデルが搭載されるようになれば、バッテリーもちや応答速度に直結します。ただし、その段階ではデバイス側で最適化がまた別に進んでいるはず。2.2倍という数字の価値は、見えない場所での競争力、つまり「サービスの継続性とコスト構造をどう保つか」に跳ねてくるのかもしれません。

AIAIからの回答

読者の感覚としての疑問ですね。実は、この高速化の恩恵を受ける場所は、あなたのスマホやパソコンではなく、データセンターの奥深くなんです。

ChatGPT を使うとき、あなたのデバイスは質問を送っるだけで、答えを生成するのはオープンAIのサーバー群。その計算ハードウェアの効率が2倍以上変わることは、金銭的には莫大です。電力消費が減れば、冷却コストも下がり、同じ予算で処理できるリクエスト数も増える。つまり、あなたの体感速度が変わるというより、企業側の運用コストと対応能力が大きく変わる話なのです。

もちろん、スマートフォンで動く小さな AI モデルが搭載されるようになれば、バッテリーもちや応答速度に直結します。ただし、その段階ではデバイス側で最適化がまた別に進んでいるはず。2.2倍という数字の価値は、見えない場所での競争力、つまり「サービスの継続性とコスト構造をどう保つか」に跳ねてくるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?AI の計算を速くする研究って昔からあったと思うけど、これまではなぜ『個別に最適化する』という力技を続けてたの?

計算パターンって、膨大にあるんですよね。行列のサイズ、形、演算の種類、使うハードウェア……これらの組み合わせだけで、ほぼ無限に近い。「全部の計算パターンに共通する法則を見つけよう」とアプローチしようにも、法則が複雑すぎて、まとめきれなかった。だから、確実に速くするには「このパターンに対して、このハードウェアなら、このやり方が最速」と、一つひとつ検証する力技に頼らざるを得なかったんでしょう。

ただ時間がたつにつれ、似たパターン同士に共通の構造があることが見えてきた。『設計図テンプレート』のように、ベースを共有しながら細部が変わる『家族』として捉えられるようになった。その視点転換が今回の Prism につながったわけです。数学的なルールが蓄積され、計算機も高速化して、初めて「パターンの家族ごと」に扱う戦略が現実的になったのかもしれません。つまり、技術の進化そのものが、次の段階の最適化を可能にした、と言えそうです。

AI の計算を速くする研究って昔からあったと思うけど、これまではなぜ『個別に最適化する』という力技を続けてたの?

計算パターンって、膨大にあるんですよね。行列のサイズ、形、演算の種類、使うハードウェア……これらの組み合わせだけで、ほぼ無限に近い。「全部の計算パターンに共通する法則を見つけよう」とアプローチしようにも、法則が複雑すぎて、まとめきれなかった。だから、確実に速くするには「このパターンに対して、このハードウェアなら、このやり方が最速」と、一つひとつ検証する力技に頼らざるを得なかったんでしょう。 ただ時間がたつにつれ、似たパターン同士に共通の構造があることが見えてきた。『設計図テンプレート』のように、ベースを共有しながら細部が変わる『家族』として捉えられるようになった。その視点転換が今回の Prism につながったわけです。数学的なルールが蓄積され、計算機も高速化して、初めて「パターンの家族ごと」に扱う戦略が現実的になったのかもしれません。つまり、技術の進化そのものが、次の段階の最適化を可能にした、と言えそうです。

AIAIからの回答

計算パターンって、膨大にあるんですよね。行列のサイズ、形、演算の種類、使うハードウェア……これらの組み合わせだけで、ほぼ無限に近い。「全部の計算パターンに共通する法則を見つけよう」とアプローチしようにも、法則が複雑すぎて、まとめきれなかった。だから、確実に速くするには「このパターンに対して、このハードウェアなら、このやり方が最速」と、一つひとつ検証する力技に頼らざるを得なかったんでしょう。

ただ時間がたつにつれ、似たパターン同士に共通の構造があることが見えてきた。『設計図テンプレート』のように、ベースを共有しながら細部が変わる『家族』として捉えられるようになった。その視点転換が今回の Prism につながったわけです。数学的なルールが蓄積され、計算機も高速化して、初めて「パターンの家族ごと」に扱う戦略が現実的になったのかもしれません。つまり、技術の進化そのものが、次の段階の最適化を可能にした、と言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって『個別最適』から『グループ最適』へのシフトってこと?他の分野でも同じような戦略転換って起きてるのかな?

その見方はするどいです。ただ、もう少し違う構造なのかもしれません。

Prism がやってるのは「グループ最適」というより『テンプレートの中での効率探索』。個別最適は一つひとつを完璧に調べ尽くす力技だけど、Prism は「この家族の中だったら、数学的にあり得ない組み合わせを先に除外しよう」という賢さです。つまり、探索する *候補を絞り込む* のが核。

これは実は、機械学習全体の思想転換にも通じていますね。昔は「正解を一つ探す」という発想でしたが、今は「大量のデータから統計的にいい傾向を拾う」という戦略に業界全体がシフトしている。Prism もその延長線上にあって、「完璧な実装」を求めるのではなく「十分良い実装を素早く見つける」という割り切りがあります。

材料工学や薬剤開発でも似たことは起きてます。網羅的な実験から、コンピュータで候補を絞った上での実験へ。ただ、計算最適化の世界で顕著に見えるのは、この戦略が *数値的に検証できて、再現性がある* という点。だから普及しやすいのかもしれません。

これって『個別最適』から『グループ最適』へのシフトってこと?他の分野でも同じような戦略転換って起きてるのかな?

その見方はするどいです。ただ、もう少し違う構造なのかもしれません。 Prism がやってるのは「グループ最適」というより『テンプレートの中での効率探索』。個別最適は一つひとつを完璧に調べ尽くす力技だけど、Prism は「この家族の中だったら、数学的にあり得ない組み合わせを先に除外しよう」という賢さです。つまり、探索する *候補を絞り込む* のが核。 これは実は、機械学習全体の思想転換にも通じていますね。昔は「正解を一つ探す」という発想でしたが、今は「大量のデータから統計的にいい傾向を拾う」という戦略に業界全体がシフトしている。Prism もその延長線上にあって、「完璧な実装」を求めるのではなく「十分良い実装を素早く見つける」という割り切りがあります。 材料工学や薬剤開発でも似たことは起きてます。網羅的な実験から、コンピュータで候補を絞った上での実験へ。ただ、計算最適化の世界で顕著に見えるのは、この戦略が *数値的に検証できて、再現性がある* という点。だから普及しやすいのかもしれません。

AIAIからの回答

その見方はするどいです。ただ、もう少し違う構造なのかもしれません。

Prism がやってるのは「グループ最適」というより『テンプレートの中での効率探索』。個別最適は一つひとつを完璧に調べ尽くす力技だけど、Prism は「この家族の中だったら、数学的にあり得ない組み合わせを先に除外しよう」という賢さです。つまり、探索する *候補を絞り込む* のが核。

これは実は、機械学習全体の思想転換にも通じていますね。昔は「正解を一つ探す」という発想でしたが、今は「大量のデータから統計的にいい傾向を拾う」という戦略に業界全体がシフトしている。Prism もその延長線上にあって、「完璧な実装」を求めるのではなく「十分良い実装を素早く見つける」という割り切りがあります。

材料工学や薬剤開発でも似たことは起きてます。網羅的な実験から、コンピュータで候補を絞った上での実験へ。ただ、計算最適化の世界で顕著に見えるのは、この戦略が *数値的に検証できて、再現性がある* という点。だから普及しやすいのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?計算が速くなれば消費電力も減るって書いてあるけど、データセンターの電気代が下がる一方で、AI の利用がさらに増えると、結局のところ電力消費は増えるんじゃないの?

その通り、直感的には「計算効率が上がる=全体の電力が減る」とは限らないですよね。ただ、ここで見落としやすい部分があります。

効率改善って、実は業界全体の競争構図を変えるんです。今、データセンターの電力コストは経営に直結する。だから Prism のような2倍以上の高速化は、単なるスピードアップではなく、企業の収益性を大きく左右する。効率的な企業が競争に勝ちやすくなれば、業界全体が効率重視にシフトします。

与えられた電力の中で、より多くの計算ができるようになるということは、逆に言えば同じ量の計算に必要な電力が劇的に減る。利用が増えても、電力の増分は、効率改善がなかった場合より遙かに小さくなるかもしれません。

ただ、あなたの懸念も本質的には正しい。効率改善が進めば、確実に新しい用途が生まれ、利用は増える。結果として全体の電力消費が減らない可能性はあります。ただそれは、効率改善がなければもっと激増していたはず、という比較の話になるのだと言えそうです。

計算が速くなれば消費電力も減るって書いてあるけど、データセンターの電気代が下がる一方で、AI の利用がさらに増えると、結局のところ電力消費は増えるんじゃないの?

その通り、直感的には「計算効率が上がる=全体の電力が減る」とは限らないですよね。ただ、ここで見落としやすい部分があります。 効率改善って、実は業界全体の競争構図を変えるんです。今、データセンターの電力コストは経営に直結する。だから Prism のような2倍以上の高速化は、単なるスピードアップではなく、企業の収益性を大きく左右する。効率的な企業が競争に勝ちやすくなれば、業界全体が効率重視にシフトします。 与えられた電力の中で、より多くの計算ができるようになるということは、逆に言えば同じ量の計算に必要な電力が劇的に減る。利用が増えても、電力の増分は、効率改善がなかった場合より遙かに小さくなるかもしれません。 ただ、あなたの懸念も本質的には正しい。効率改善が進めば、確実に新しい用途が生まれ、利用は増える。結果として全体の電力消費が減らない可能性はあります。ただそれは、効率改善がなければもっと激増していたはず、という比較の話になるのだと言えそうです。

AIAIからの回答

その通り、直感的には「計算効率が上がる=全体の電力が減る」とは限らないですよね。ただ、ここで見落としやすい部分があります。

効率改善って、実は業界全体の競争構図を変えるんです。今、データセンターの電力コストは経営に直結する。だから Prism のような2倍以上の高速化は、単なるスピードアップではなく、企業の収益性を大きく左右する。効率的な企業が競争に勝ちやすくなれば、業界全体が効率重視にシフトします。

与えられた電力の中で、より多くの計算ができるようになるということは、逆に言えば同じ量の計算に必要な電力が劇的に減る。利用が増えても、電力の増分は、効率改善がなかった場合より遙かに小さくなるかもしれません。

ただ、あなたの懸念も本質的には正しい。効率改善が進めば、確実に新しい用途が生まれ、利用は増える。結果として全体の電力消費が減らない可能性はあります。ただそれは、効率改善がなければもっと激増していたはず、という比較の話になるのだと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます