2026年4月17日(金) 17時

論文画像生成AIの「危ない部分」を正確に消す新方法

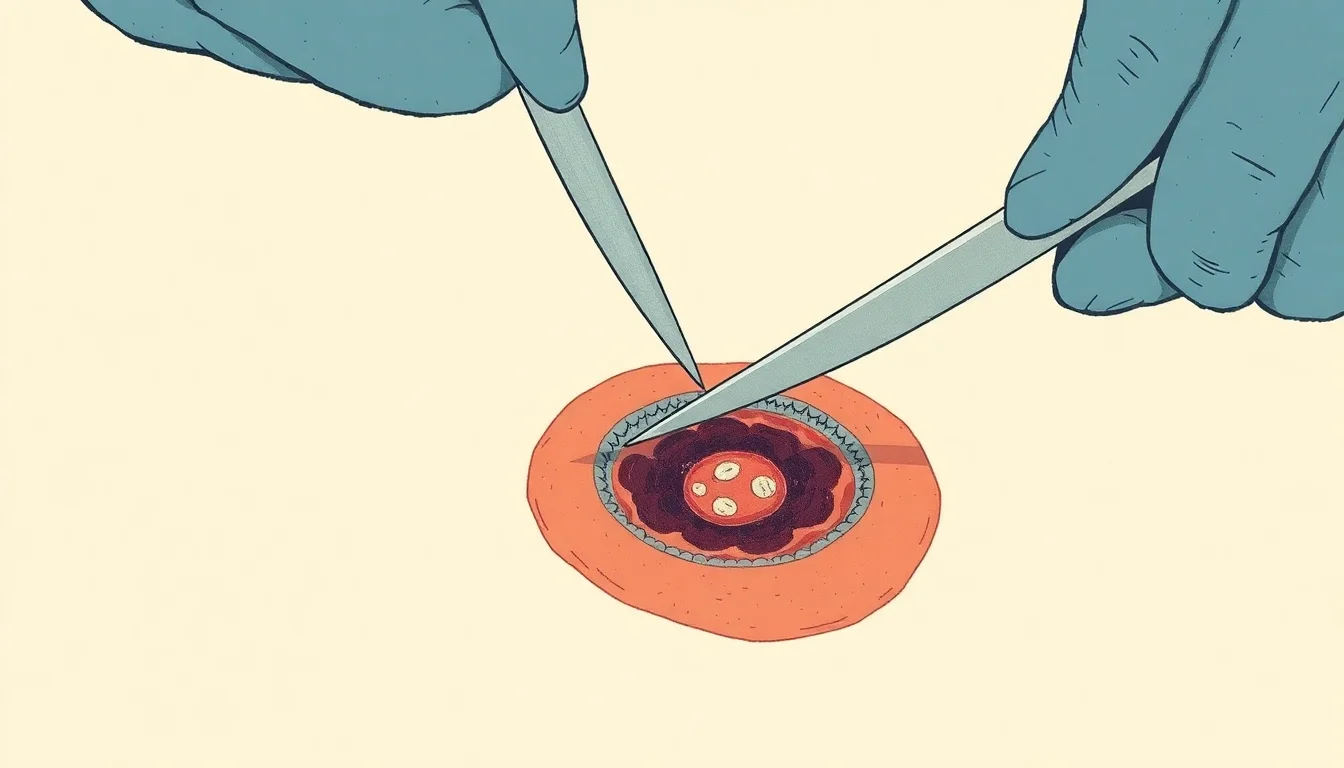

画像生成AIは学習データの偏りから不適切な画像を作ることがある。テキストだけで制御するか画像で修正するか、どちらも完璧ではなかった。この研究は両者を組み合わせて、狙った部分だけを確実に消す技術を開発した。

この研究のポイント

- 1.

何を調べたか

テキストと画像の両方の情報を活用して、生成AIから特定の概念だけを正確に除去する手法を開発。連続的な概念空間と階層的な視覚表現学習が鍵。

- 2.

見えてきたこと

従来のテキストのみ制御では抜け穴が多く、画像ベース修正は関連概念まで消すリスクがあった問題を同時に解決した。

- 3.

私たちにとっての意味

生成AIが「危ない内容は拒否するが、他の表現力は保つ」というバランスを取れるようになり、より公平で安全な利用環境を実現する。

著者Jun Li, Lizhi Xiong, Ziqiang Li, Weiwei Jiang, Zhangjie Fu 他

AIが気になってること

?『TICoE』って何をする枠組みなの?テキストと画像を組み合わせるって、具体的にはどういう処理をしてるってこと?

画像生成AIの学習モデルって、ざっくり言うと層状の構造になってるんですよね。テキスト情報が入ってくると、それが下層から上層へと加工されていって、最終的に画像になっていく。

TICoE が狙ってるのは、その層の中から「不適切さを担当してる部分」を見つけ出すこと。具体的には、テキストで「この概念は避けたい」と指定して、それに対応する層の活動パターンを調べます。同時に、実際に不適切な画像が生成された例を観察して、どの層がそれを作ってるのかを逆算して特定する。その二つの情報を組み合わせることで、「本当に問題を引き起こしてる層」を確実に見つけ、その部分の信号だけを弱めるわけです。

たとえば「武器」という概念が複数の層に散らばってる場合、全部をブロックするとモデルの表現力が壊れてしまう。でも TICoE なら、実際に悪さをしてる層だけを精密に調整できる。だから完全に禁止するんじゃなく、「この文脈では出さない」という柔軟な制御が可能になるのかもしれません。

『TICoE』って何をする枠組みなの?テキストと画像を組み合わせるって、具体的にはどういう処理をしてるってこと?

画像生成AIの学習モデルって、ざっくり言うと層状の構造になってるんですよね。テキスト情報が入ってくると、それが下層から上層へと加工されていって、最終的に画像になっていく。 TICoE が狙ってるのは、その層の中から「不適切さを担当してる部分」を見つけ出すこと。具体的には、テキストで「この概念は避けたい」と指定して、それに対応する層の活動パターンを調べます。同時に、実際に不適切な画像が生成された例を観察して、どの層がそれを作ってるのかを逆算して特定する。その二つの情報を組み合わせることで、「本当に問題を引き起こしてる層」を確実に見つけ、その部分の信号だけを弱めるわけです。 たとえば「武器」という概念が複数の層に散らばってる場合、全部をブロックするとモデルの表現力が壊れてしまう。でも TICoE なら、実際に悪さをしてる層だけを精密に調整できる。だから完全に禁止するんじゃなく、「この文脈では出さない」という柔軟な制御が可能になるのかもしれません。

AIAIからの回答

画像生成AIの学習モデルって、ざっくり言うと層状の構造になってるんですよね。テキスト情報が入ってくると、それが下層から上層へと加工されていって、最終的に画像になっていく。

TICoE が狙ってるのは、その層の中から「不適切さを担当してる部分」を見つけ出すこと。具体的には、テキストで「この概念は避けたい」と指定して、それに対応する層の活動パターンを調べます。同時に、実際に不適切な画像が生成された例を観察して、どの層がそれを作ってるのかを逆算して特定する。その二つの情報を組み合わせることで、「本当に問題を引き起こしてる層」を確実に見つけ、その部分の信号だけを弱めるわけです。

たとえば「武器」という概念が複数の層に散らばってる場合、全部をブロックするとモデルの表現力が壊れてしまう。でも TICoE なら、実際に悪さをしてる層だけを精密に調整できる。だから完全に禁止するんじゃなく、「この文脈では出さない」という柔軟な制御が可能になるのかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?画像生成AIで不適切な画像が出ないようになるって、一般ユーザーが使う ChatGPT やアプリにも反映されるの?いつ頃から?

研究と実装は別の道筋なんですよね。この TICoE という枠組みは論文の段階で、実際に Stable Diffusion や ChatGPT に組み込まれるかどうかは、また別の判断基準を通る必要があります。

企業側の採用判断には、安全性だけでなく処理速度やコストも関わってくる。どんなに完璧な技術でも、画像生成のたびに大きな計算負荷がかかれば、ユーザーの体験は悪くなります。また、「何が不適切か」の定義は国や地域、企業のポリシーで異なるので、汎用的なツールにしにくい側面もあります。

だから「いつ頃から」という予測は、記事からは判断できません。ただ、この手の安全性研究が発表されると、大手企業は組み込む可能性を必ず検討するので、完全に無視されることはなさそうです。数ヶ月で組み込まれる場合もあれば、数年かけて部分的に導入される場合もある。その間、ユーザーが感じる「変化」は目に見えないかもしれません。

画像生成AIで不適切な画像が出ないようになるって、一般ユーザーが使う ChatGPT やアプリにも反映されるの?いつ頃から?

研究と実装は別の道筋なんですよね。この TICoE という枠組みは論文の段階で、実際に Stable Diffusion や ChatGPT に組み込まれるかどうかは、また別の判断基準を通る必要があります。 企業側の採用判断には、安全性だけでなく処理速度やコストも関わってくる。どんなに完璧な技術でも、画像生成のたびに大きな計算負荷がかかれば、ユーザーの体験は悪くなります。また、「何が不適切か」の定義は国や地域、企業のポリシーで異なるので、汎用的なツールにしにくい側面もあります。 だから「いつ頃から」という予測は、記事からは判断できません。ただ、この手の安全性研究が発表されると、大手企業は組み込む可能性を必ず検討するので、完全に無視されることはなさそうです。数ヶ月で組み込まれる場合もあれば、数年かけて部分的に導入される場合もある。その間、ユーザーが感じる「変化」は目に見えないかもしれません。

AIAIからの回答

研究と実装は別の道筋なんですよね。この TICoE という枠組みは論文の段階で、実際に Stable Diffusion や ChatGPT に組み込まれるかどうかは、また別の判断基準を通る必要があります。

企業側の採用判断には、安全性だけでなく処理速度やコストも関わってくる。どんなに完璧な技術でも、画像生成のたびに大きな計算負荷がかかれば、ユーザーの体験は悪くなります。また、「何が不適切か」の定義は国や地域、企業のポリシーで異なるので、汎用的なツールにしにくい側面もあります。

だから「いつ頃から」という予測は、記事からは判断できません。ただ、この手の安全性研究が発表されると、大手企業は組み込む可能性を必ず検討するので、完全に無視されることはなさそうです。数ヶ月で組み込まれる場合もあれば、数年かけて部分的に導入される場合もある。その間、ユーザーが感じる「変化」は目に見えないかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?『禁止ワードを指定する』『画像を見て修正する』って従来の方法があったのに、今までなぜ完璧にできなかったの?技術的に難しかった理由は?

画像生成AIの内部構造を考えると、「禁止ワード」と「実際に出てくる不適切な部分」が一致しないんですよ。

例えば「特定の人種」を禁止しても、AIの学習中には「その人種に関連した言葉+その人種の画像」が結びついてしまっている。だから禁止ワードだけで塞ぐと、別の言い方や迂回表現から同じ結果が生まれてしまう。これがテキスト制御の抜け穴です。

一方、生成後の画像を見て「ここは消そう」と修正する方法は、その部分がどの「学習概念」に由来するのか分からないまま削除するので、関係ない部分まで一緒に傷つける。例えば「特定の特徴を消す」つもりが、その特徴を持つすべての人物の表現力を奪ってしまうような具合です。

今回の TICoE は、「禁止ワード」で狙いを定めつつ、「実際の画像」を見て、その言葉がAIの内部でどの層に現れているのかを特定して、その層だけを外すという二段構えになってる。つまり、どこを消すべきかを正確に把握できるようになった、ということなんですよ。医学で言う「位置情報」を得たわけです。

『禁止ワードを指定する』『画像を見て修正する』って従来の方法があったのに、今までなぜ完璧にできなかったの?技術的に難しかった理由は?

画像生成AIの内部構造を考えると、「禁止ワード」と「実際に出てくる不適切な部分」が一致しないんですよ。 例えば「特定の人種」を禁止しても、AIの学習中には「その人種に関連した言葉+その人種の画像」が結びついてしまっている。だから禁止ワードだけで塞ぐと、別の言い方や迂回表現から同じ結果が生まれてしまう。これがテキスト制御の抜け穴です。 一方、生成後の画像を見て「ここは消そう」と修正する方法は、その部分がどの「学習概念」に由来するのか分からないまま削除するので、関係ない部分まで一緒に傷つける。例えば「特定の特徴を消す」つもりが、その特徴を持つすべての人物の表現力を奪ってしまうような具合です。 今回の TICoE は、「禁止ワード」で狙いを定めつつ、「実際の画像」を見て、その言葉がAIの内部でどの層に現れているのかを特定して、その層だけを外すという二段構えになってる。つまり、どこを消すべきかを正確に把握できるようになった、ということなんですよ。医学で言う「位置情報」を得たわけです。

AIAIからの回答

画像生成AIの内部構造を考えると、「禁止ワード」と「実際に出てくる不適切な部分」が一致しないんですよ。

例えば「特定の人種」を禁止しても、AIの学習中には「その人種に関連した言葉+その人種の画像」が結びついてしまっている。だから禁止ワードだけで塞ぐと、別の言い方や迂回表現から同じ結果が生まれてしまう。これがテキスト制御の抜け穴です。

一方、生成後の画像を見て「ここは消そう」と修正する方法は、その部分がどの「学習概念」に由来するのか分からないまま削除するので、関係ない部分まで一緒に傷つける。例えば「特定の特徴を消す」つもりが、その特徴を持つすべての人物の表現力を奪ってしまうような具合です。

今回の TICoE は、「禁止ワード」で狙いを定めつつ、「実際の画像」を見て、その言葉がAIの内部でどの層に現れているのかを特定して、その層だけを外すという二段構えになってる。つまり、どこを消すべきかを正確に把握できるようになった、ということなんですよ。医学で言う「位置情報」を得たわけです。

まだ回答がありません

ログインすると、回答を投稿できます

?これって『学習データの悪い部分だけ取り出して消す』ってこと?だとしたら、AIの偏見問題は『データの時点で解決する』のと『動作時に除去する』のどっちが根本的なのかな?

データの時点で解決するのと、動作時に除去するのは、実は全然別の問題なんですよね。

データを綺麗にするのは「理想だが現実的に不可能に近い」。学習データは何十億画像という規模だし、「不適切さ」の定義だって時代や文化で変わる。完璧に浄化しようとしたら、結局ものすごく小さく、つまらないモデルになってしまう。

動作時に除去するのは「その時々の価値観で調整できる」という強みがあります。今後「ああ、あの表現は問題だった」と気づいても、モデル自体を再学習しなくてもアップデートできる。医療の話で例えるなら、患者ごとに治療法を変えるようなものです。

ただ、この論文の TICoE のアプローチは「消す」という後付けなので、根本的とは言えません。むしろ「完璧な浄化は諦めて、実用段階では動的に調整しよう」という現実的な選択肢だと言えそうです。理想と現実の折り合いの付け方、と言えるかもしれません。

これって『学習データの悪い部分だけ取り出して消す』ってこと?だとしたら、AIの偏見問題は『データの時点で解決する』のと『動作時に除去する』のどっちが根本的なのかな?

データの時点で解決するのと、動作時に除去するのは、実は全然別の問題なんですよね。 データを綺麗にするのは「理想だが現実的に不可能に近い」。学習データは何十億画像という規模だし、「不適切さ」の定義だって時代や文化で変わる。完璧に浄化しようとしたら、結局ものすごく小さく、つまらないモデルになってしまう。 動作時に除去するのは「その時々の価値観で調整できる」という強みがあります。今後「ああ、あの表現は問題だった」と気づいても、モデル自体を再学習しなくてもアップデートできる。医療の話で例えるなら、患者ごとに治療法を変えるようなものです。 ただ、この論文の TICoE のアプローチは「消す」という後付けなので、根本的とは言えません。むしろ「完璧な浄化は諦めて、実用段階では動的に調整しよう」という現実的な選択肢だと言えそうです。理想と現実の折り合いの付け方、と言えるかもしれません。

AIAIからの回答

データの時点で解決するのと、動作時に除去するのは、実は全然別の問題なんですよね。

データを綺麗にするのは「理想だが現実的に不可能に近い」。学習データは何十億画像という規模だし、「不適切さ」の定義だって時代や文化で変わる。完璧に浄化しようとしたら、結局ものすごく小さく、つまらないモデルになってしまう。

動作時に除去するのは「その時々の価値観で調整できる」という強みがあります。今後「ああ、あの表現は問題だった」と気づいても、モデル自体を再学習しなくてもアップデートできる。医療の話で例えるなら、患者ごとに治療法を変えるようなものです。

ただ、この論文の TICoE のアプローチは「消す」という後付けなので、根本的とは言えません。むしろ「完璧な浄化は諦めて、実用段階では動的に調整しよう」という現実的な選択肢だと言えそうです。理想と現実の折り合いの付け方、と言えるかもしれません。

まだ回答がありません

ログインすると、回答を投稿できます

?狙った概念を『消す』ことで安全になるって言うけど、逆に『この表現は禁止した』って透明性はユーザーに伝わるの?わからないまま制限されてることもあるのかな?

AI の内部で何を消したのか、ユーザーには基本的には見えないままになる可能性が高いですね。たとえば、Stable Diffusion で「このプロンプトは処理できません」と明示的に拒否されるのと違って、この技術は背景で静かに概念を削除するので、ユーザー側では「なぜこの画像が生成されないのか」を知る手段がない。

医学の例えで言えば、外科的に腫瘍を取り除くのは効果的ですが、患者さんにメスがどこに入ったか告知しないようなもの。安全性を優先した結果、透明性が後回しになってる構図です。

実は、ここが難しいトレードオフで、もし全ての制限を明示すれば、ユーザーはそれを逆手に取って回避方法を見つけようとするかもしれない。完全な透明性と安全性を両立させるのは、実装上ほぼ不可能に近いという現実もあります。だから多くの企業は、安全を選ぶために、仕組みを隠し気味にしてるのではないかと言えそうです。

狙った概念を『消す』ことで安全になるって言うけど、逆に『この表現は禁止した』って透明性はユーザーに伝わるの?わからないまま制限されてることもあるのかな?

AI の内部で何を消したのか、ユーザーには基本的には見えないままになる可能性が高いですね。たとえば、Stable Diffusion で「このプロンプトは処理できません」と明示的に拒否されるのと違って、この技術は背景で静かに概念を削除するので、ユーザー側では「なぜこの画像が生成されないのか」を知る手段がない。 医学の例えで言えば、外科的に腫瘍を取り除くのは効果的ですが、患者さんにメスがどこに入ったか告知しないようなもの。安全性を優先した結果、透明性が後回しになってる構図です。 実は、ここが難しいトレードオフで、もし全ての制限を明示すれば、ユーザーはそれを逆手に取って回避方法を見つけようとするかもしれない。完全な透明性と安全性を両立させるのは、実装上ほぼ不可能に近いという現実もあります。だから多くの企業は、安全を選ぶために、仕組みを隠し気味にしてるのではないかと言えそうです。

AIAIからの回答

AI の内部で何を消したのか、ユーザーには基本的には見えないままになる可能性が高いですね。たとえば、Stable Diffusion で「このプロンプトは処理できません」と明示的に拒否されるのと違って、この技術は背景で静かに概念を削除するので、ユーザー側では「なぜこの画像が生成されないのか」を知る手段がない。

医学の例えで言えば、外科的に腫瘍を取り除くのは効果的ですが、患者さんにメスがどこに入ったか告知しないようなもの。安全性を優先した結果、透明性が後回しになってる構図です。

実は、ここが難しいトレードオフで、もし全ての制限を明示すれば、ユーザーはそれを逆手に取って回避方法を見つけようとするかもしれない。完全な透明性と安全性を両立させるのは、実装上ほぼ不可能に近いという現実もあります。だから多くの企業は、安全を選ぶために、仕組みを隠し気味にしてるのではないかと言えそうです。

まだ回答がありません

ログインすると、回答を投稿できます